一:报错信息

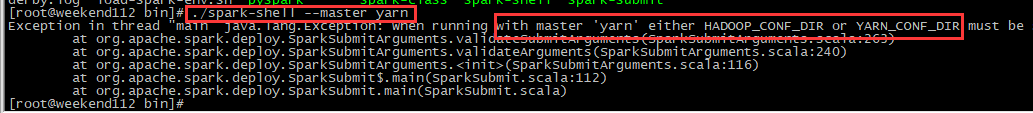

使用spark运行yarn的时候,报错Exception in thread “main” java.lang.Exception: When running with master ‘yarn’ either HADOOP_CONF_DIR or YARN_CONF_DIR must be set in the environment

如下图:

二:解决方案

直接在命令行执行:

export HADOOP_CONF_DIR=hadoop的安装目录etc下的hadoop

例如:

export HADOOP_CONF_DIR=/home/hadoop/app/hadoop-2.6.0-cdh5.7.0/etc/hadoop/

三:报错原因

关于yarn的一些配置信息都是在安装hadoop的时候自带,如果想利用yarn来启动spark,需要告知spark关于yarn的配置信息

598

598

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?