filebeat 配置优化

-

实验环境

本架构采用 filebeat + ELK搭建,将suricata节点收集到的日志数据通过filebeat 发送到logstash,由logstash 发送到 elasticsearch 进行索引。

- filebeat: 单核,主存3GB。

- ELK: 双核,主存8GB

-

问题描述

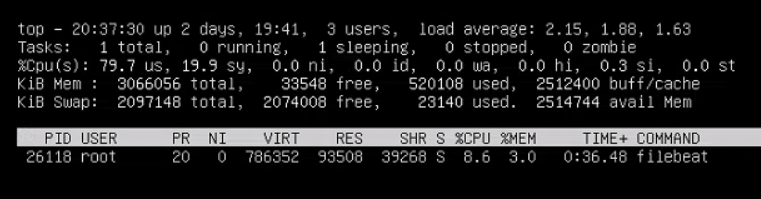

通过kibana的监视工具xpack可以看到,elasticsearch 的索引速度基本在250/s 以下。在filebeat 节点上通过top命令也可以看到,CPU和内存利用率也不高。

-

配置优化

首先,根据官方文档,查找到几个可以优化的选项:

- harvester_buffer_size: 每个harvester获取日志数据时使用的缓冲区大小,单位是byte

- filebeat.spool_size: filebeat 读取数据后将事件放入内存队列,适当增大size可以避免频繁的更新队列,单位字节

- filebeat.idle_timeout: 设置队列超时时

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

900

900

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?