1.摘要

本文研究了图像情感分类中的无监督域自适应(UDA)问题。具体来说,我们通过在情绪一致的情况下连续调整图像的周期来开发新的周期性共识模型CycleEmotionGAN。通过交替优化CycleGAN损失,情感语义一致性损失和目标分类损失,CycleEmotionGAN可以使源域图像具有与目标域相似的分布,而无需使用对齐的图像对。同时,保留源图像的注释信息。已经对ArtPhoto和FI数据集进行了广泛的实验,结果表明CycleEmotionGAN明显优于最新的UDA方法。

2.介绍

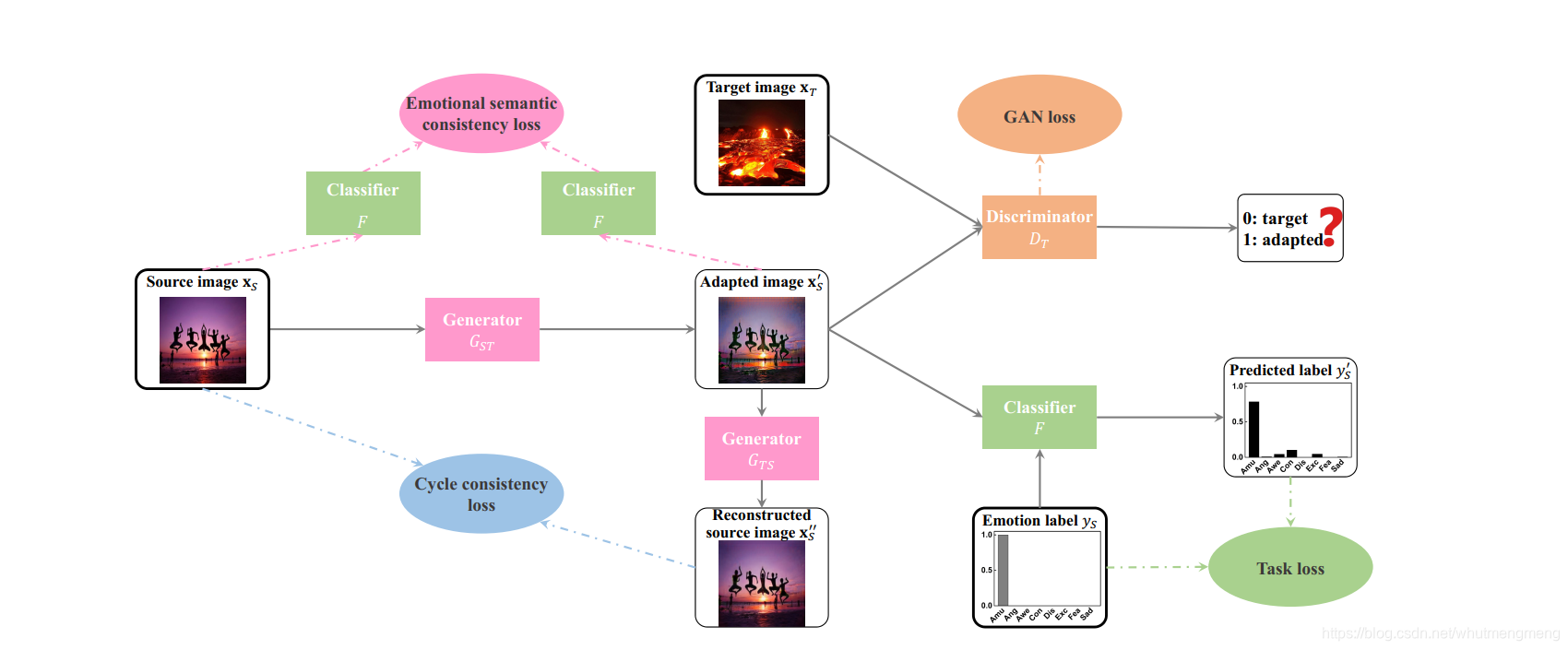

在本文中,我们研究了在一个源域中对图像情绪进行分类并将其适应于另一目标域的无监督域适应(UDA)问题。开发了一种新颖的周期一致对抗模型,称为CycleEmotionGAN,用于图像情感分类。类似于周期一致的生成对抗网络(CycleGAN),使用对抗损失,映射Gst:Xs->Xt 可以使源图像XS适应目标图像XT,从而使来自Gst(Xs)的图像分布与分布Xt难以区分。由于此映射的约束严重不足,因此反映射Gts:Xt->Xs被耦合,并且引入了循环一致性损失来强制执行Gts(Gst(Xs))≈xS(反之亦然)。为了保留源图像的注释信息,我们用情绪语义一致性(ESC)损失来补充CycleGAN损失,这会惩罚自适应图像和源图像之间的大语义变化。

通过这种方式,CycleEmotionGAN模型可以修改源域图像,使其看起来好像是从目标域中绘制的,同时保留了注释信息。同时,训练分类网络以学习图像内容与情绪之间的映射。也就是说,我们交替优化CycleGAN损失,ESC损失和分类损失。在ArtPhoto和FI数据集证明了提出的UDA方法对图像情绪进行分类的有效性。

总而言之,本文的贡献包括三个方面:

1.我们建议以一种无监督的方式使图像情感从一个源域适应到一个目标域。据我们所知,这是关于图像情感分类的第一个领域适应性工作。

2.我们针对图像情感分类开发了一种新颖的周期一致对抗模型CycleEmotionGAN,该模型交替优化了CycleGAN损失,ESC损失和目标分类损失。由于情感语义一致性的损失,在保留源图像的注释信息的同时,改编后的图像无法与目标图像区分开。

3.我们对ArtPhoto和FI数据集进行了广泛的实验,结果证明了所提出的CycleEmotionGAN模型的优越性

3.模型

在本文中,我们专注于单源,同类和无监督域自适应,即仅使用一个源域,在同一空间中观察到源域和目标域的标记,而目标域则完全未标记。假设从源分布PS(x; y)绘制的源图像和相应的情感标签分别为Xs和Ys,从目标分布PT(x)绘制的目标图像为XT。我们的目标是学习一个模型,该模型可以将来自目标域的图像正确分类为L个情感类别(本文中L = 8)之一基于{Xs,Xt}和Xt。

CycleEmotionGAN的主要思想是学习映射Gst:Xs-> Xt使源图像Xs适应目标图像Xt。对Gst的要求是,鉴别器Dt无法将适配图像X's与目标图像Xt区别开来,并且必须保留Xs的情感标签。因为映射Gst不稳定且容易失败,所以反映射Gts:Xt-> Xs与周期一致性损失一起使用,以强制执行Gts(Gst(Xs))≈Xs(反之亦然)。为了保留源图像的情感标签,我们用情感语义一致性(ESC)丢失来补充CycleGAN丢失,这会惩罚自适应图像和源图像之间的较大语义差异。通过这种方式,CycleEmotionGAN模型可以使源域图像与目标域无法区分,同时保留注释信息。最后,我们可以在适应的数据集fX0 S上训练分类器F;就像训练图像X0 S和测试图像XT来自相同分布一样。该框架如图2所示。

3.1CycleGAN损失

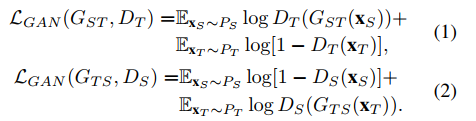

CycleGAN旨在学习两种映射 Gst:Xs->Xt和Gts:Xt->Xs 两个域S和T之间给定的样本Xs和Xt。 同时,训练了两个鉴别器Dt和Ds,其中Dt的目的是区分图像Xt和Gst(Xs),Ds的目的是区分图像Xs和Gts(Xt)。 与(Zhu et al.2017a)中一样,CycleGAN损失包含两个项。 一种是对抗性损失(Goodfellow等,2014),它使生成图像的分布与目标域中的数据分布相匹配:

另一个是周期一致性损失,可确保学习到的映射Gst和Gts保持周期一致,从而防止它们相互矛盾。 以这种方式,图像转换周期能够将重建的图像带回到原始图像。 即Gts(Gst(Xs))≈Xs和Gst(Gts(Xt))≈Xt。 根据(Zhu et al.2017a),循环一致性损失定义为:

其中α控制GAN损耗相对于循环一致性损耗的相对重要性。

3.2情感语义一致性损失

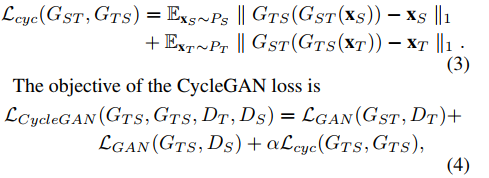

除了从源图像生成适应的图像之外,生成器Gst还应保留源图像的情感标签。 这是使训练分类器能够使用的基本要素,该分类器使用适应的图像以及与源图像相对应的情感标签。 为此,我们建议使用情感语义一致性损失来最小化源图像和适应图像的预测情感之间的差异:

![]()

d(.,.)是用来衡量两个情感标签之间的距离的。 因此,随着ESC损失而增加的CycleGAN损失为:

其中λ控制CycleGAN损耗相对于ESC损耗的相对重要性。

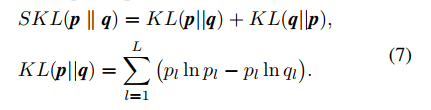

在这里,我们采用两种策略来定义d(.,.)。 首先,由于网络F的输出是一个概率分布,每个元素代表相应情感的概率,因此我们使用对称的Kullback-Leibler发散(SKL)来度量两个分布p和q之间的距离:

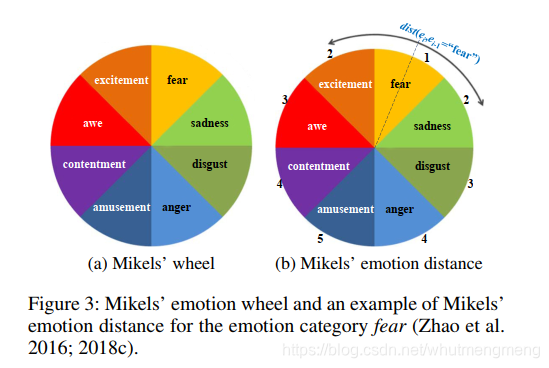

其次,受情感理论研究的启发,我们采用了Mikels'Wheel(Zhao等人,2016)(确定了两种情感之间的关系)来测量两种情感之间的相似度,从相似到完全相反。 配对情感距离定义为1+“从一种情感到另一种情感所需的步数”,如图3所示。配对情感相似性定义为配对情感距离的倒数。d(·;·)等于1- 成对的情感相似性。

3.3分类损失

通常,学习一个单独的任务模型,它基于适应的源图像X‘s和经过CycleGAN之后的相应情感标签Ys(Zhu等人,2017a),以执行最终的适应任务。 与此相反,拟议的CycleEmotionGAN增强了分类器F(X's)->y's,该分类器将情感y's分配给自适应图像x's.类似于基于CNN的情感分类方法(You et al.2016) 通过最小化以下交叉熵损失来优化F:

其中σ是softmax函数,而1是指标函数。

3.4CycleEmotionGAN

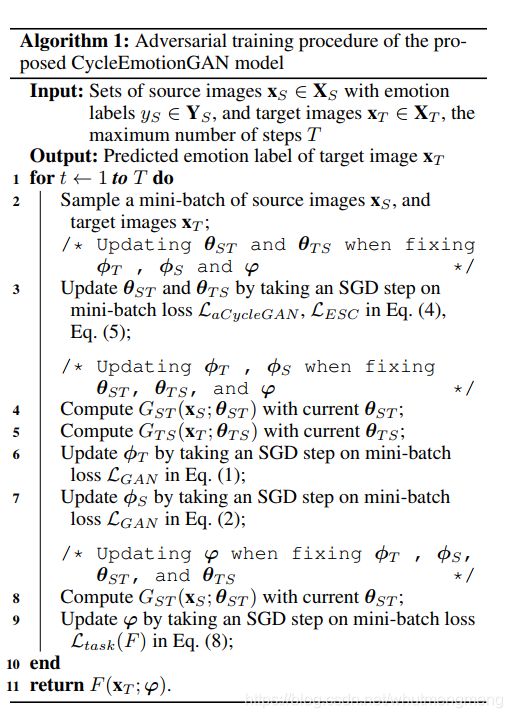

在我们的实现中,生成器Gst和Gts是具有残差连接的卷积神经网络,可保持原始图像的分辨率,如图2所示。鉴别器Dt,Ds和分类器F也是卷积神经网络。 通过在两个随机梯度下降(SGD)步骤之间交替来实现对建议的CycleEmotionGAN模型的优化。 在第一步中,我们使用SGD更新Dt,Ds和F,同时保持Gst和Gts固定。

在第二步中,我们修复Dt,Ds和F,并使用SGD更新Gst和Gts。 详细的训练过程如算法1所示,其中θst,θts,φs,φt和’分别是Gst,Gts,Ds,Dt和F的参数。

4.实验

4.1数据集

艺术(ArtPhoto)数据集(Machajdik和Hanbury 2010)由806张艺术照片组成,这些照片来自一个按情感类别组织的照片分享网站。艺术家拍摄照片,上传到网站,并确定照片的情感类别。艺术家试图通过有意识地操纵情感对象、灯光、颜色等,通过照片唤起观众的某种情感。在这个数据集中,每个图像都被分配到八个Mikels情感类别中的一个。

Flickr和Instagram(FI)数据集(You et al。2016)是从Flickr和Instagram中的300万张弱标签网页图片中收集的,使用Mikels的八种情感类别进行标记。一个由225名亚马逊机械土耳其公司(AMT)的工人组成的小组被雇佣来标记这些图像。每个图像分配给5个AMT工人。总共有23308张图片接收到至少三个工人之间的协议,包含在FI数据集中。

4.2评估指标

与(You et al.2016; Yang et al.2018a)相似,我们采用分类精度(Acc)评估结果。 Acc定义为所有正确预测的比例。 0≤Acc≤1,值越大表示性能越好。

4.3基准

据我们所知,CycleEmotionGAN是第一项关于无监督域自适应的工作,用于对图像情绪进行分类。 为了证明其有效性,我们将其与以下基准进行了比较:(1)仅源代码,即在源域上训练并直接在目标域上进行测试; (2)CycleGAN(Zhu et al.2017a),即首先一致地使源图像适应于适应的图像,然后利用来自相应源图像的情感标签在适应的源图像上训练分类器。 为了进行比较,我们还报告了oracle设置的结果,其中在目标域上对回归器进行了训练和测试。

4.4实施细节

Gst和Gts生成器采用CycleGAN架构(Zhu等人,2017a),对于样式域转移已显示出令人印象深刻的结果。该网络包含两个stride-2卷积,几个残差块和两个带有stride 1 2的分数步卷积。我们将9个块用于256×256和更高分辨率的训练图像。类似于(Johnson,Alahi,and Fei-Fei 2016 ),我们使用实例规范化。

鉴别器Dt和Ds使用70×70的PatchGAN(Johnson,Alahi和Fei-Fei 2016),旨在对70×70重叠的图像补丁是真实的还是假的进行分类。全图像鉴别器,并且可以完全卷积的方式应用于任意大小的图像。

分类器F基于ResNet101(He et al.2016)架构,并使用针对ImageNet分类训练的权重进行初始化。最后一个FL层的输出更改为L,这可以在L个情感类别上产生概率分布。原始损耗层被替换为来自等式的交叉熵损耗,公式(8)。

与CycleGAN(Zhu等,2017a)类似,我们遵循Shrivastava的策略(Shrivastava等,2017),并使用生成的图像历史而不是最新的生成网络生成的图像来更新鉴别器。 50个先前生成的图像。等式中的α (Zhu et al.2017a)在所有实验中将(4)设置为10。式中的λ (6)分别将SKL和Midels的d(·;·)车轮定义分别设置为10和5。我们还对结果对λ的敏感性进行了实证分析。我们使用批量大小为1的Adam求解器。所有生成器和判别器网络都从零开始学习,学习率为0.0002,而分类器F的学习率为0.0001。

4.5结果及分析

表1(从源ArtPhoto到目标FI)和表2(从源FI到目标ArtPhoto)显示了建议的CycleEmotionGAN模型与通过分类精度测量的最新方法之间的性能比较。 )。

从结果来看,我们有以下观察。 (1)仅源方法,即直接将在源域上训练的模型转移到目标域在两种适应设置中表现最差。由于域偏移或数据集偏差的影响,在两个域中,观察到的图像和情感标签的联合概率分布差异很大。这导致模型从源域到目标域的可移植性较低。 (2)CycleGAN和CycleEmotionGAN这两种自适应方法都优于纯源方法,其中CycleEmotionGAN的效果更好。这证明了CycleEmotionGAN在无监督领域自适应中对图像情绪进行分类的有效性。具体而言,通过分类精度衡量,CycleEmotionGAN相对于纯来源和CycleGAN的相对性能改进从源ArtPhoto到目标FI分别为24.94%和11.11%,从源FI到目标ArtPhoto分别为26.08%和16.01%。这些结果表明,相对于最新方法,所提出的CycleEmotionGAN模型可以实现出色的性能。性能的改进得益于CycleEmotionGAN中对CycleGAN丢失,情感语义一致性丢失和分类丢失的交替探索。 (3)SKL和Mikels的车轮距离测量都在CycleEmotioGAN模型中起作用。从源ArtPhoto到目标FI,Mikels的转轮性能都比SKL略好。 (4)对于相对相似的情感类别,例如娱乐,满足和兴奋,仅源模型非常不平衡,当从ArtPhoto转到FI时,娱乐归为兴奋。 CycleGAN和CycleEmotionGAN模型可以更好地区分这些情绪类别。 (5)对于娱乐等情感类别,ArtPhoto和FI之间的图像差异很大。使用直接在FI上训练的模型在ArtPhoto上进行测试时,分类精度为0。使用CycleGAN传输图像样式后,性能得到了显着改善。 (6)oracle方法,即使用在相同域上训练的模型在目标域上进行测试,可以达到最佳性能。但是,使用来自目标域的地面真相情感标签来训练此模型,这些标签在无监督域适应中当然不可用。 (7)在所有适应方法和预言方法之间仍然存在明显的性能差距,尤其是在从小型ArtPhoto适应大型FI的情况下。由于情绪的复杂性和主观性(Yang et al.2018b),有效地适应图像情绪仍然是一个具有挑战性的问题。

我们在图4中可视化了ArtPhoto和FI之间的图像空间自适应结果。我们可以看到,CycleGAN和CycleEmotionGAN都可以使源图像在视觉上更类似于目标图像,而CycleEmotionGAN的性能更好。例如,与原始源图像中的色相和CycleGAN适应的图像中的色相相比,CycleEmotionGAN在最后一列中适应的图像(c)的色相与目标相类似。这进一步证明了所提出的CycleEmotionGAN模型的有效性。

参数灵敏度。我们研究了方程中超参数λ的影响。 (6)性能上。图5和图6给出了情绪分类表现变化的图示。我们可以观察到,通常,性能随着λ的变化先上升然后下降。这证实了交替优化ESC损失和CycleGAN损失的有效性,因为两者之间的良好折衷可以增强可转移性。

5.结论

本文在解决图像情感分类的无监督域自适应(UDA)问题方面取得了重大进展。提出了一种新的循环一致性对抗模型,称之为循环一致性运动模型,它将循环一致性缺失与情感语义一致性缺失互补。采用对称化的KL散度和Mikels的轮距两种方法来保持源图像的情感标签。循环损失、ESC损失和分类损失的交替优化使得循环运动能够使源域图像具有与目标域图像相似的分布。在ArtPhoto和FI数据集上进行的大量实验表明,CycleEmotionGAN在图像情感分类方面明显优于最新的UDA方法,为了进一步的研究,我们计划将CycleEmotionGAN模型扩展到其他图像情感识别(IER)任务,如情感分布学习。同时,我们也探讨了当源域和目标域使用不同的情感模型以及当存在多个源域时,能够很好地适应的方法。

提出CycleEmotionGAN模型,一种新型周期一致对抗网络,用于图像情感分类的无监督域适应。通过交替优化CycleGAN损失、情感语义一致性损失和分类损失,该模型在ArtPhoto和FI数据集上显著超越现有UDA方法。

提出CycleEmotionGAN模型,一种新型周期一致对抗网络,用于图像情感分类的无监督域适应。通过交替优化CycleGAN损失、情感语义一致性损失和分类损失,该模型在ArtPhoto和FI数据集上显著超越现有UDA方法。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?