CS231n学习笔记——损失函数

从上一节的线性分类器角度出发,设定一个函数,以分类器的权重W作为输入,定量评估W的好坏,即为损失函数。然后找到一种可行方式,在W的可行域里找到一个最合适的W,使损失函数最小——优化问题

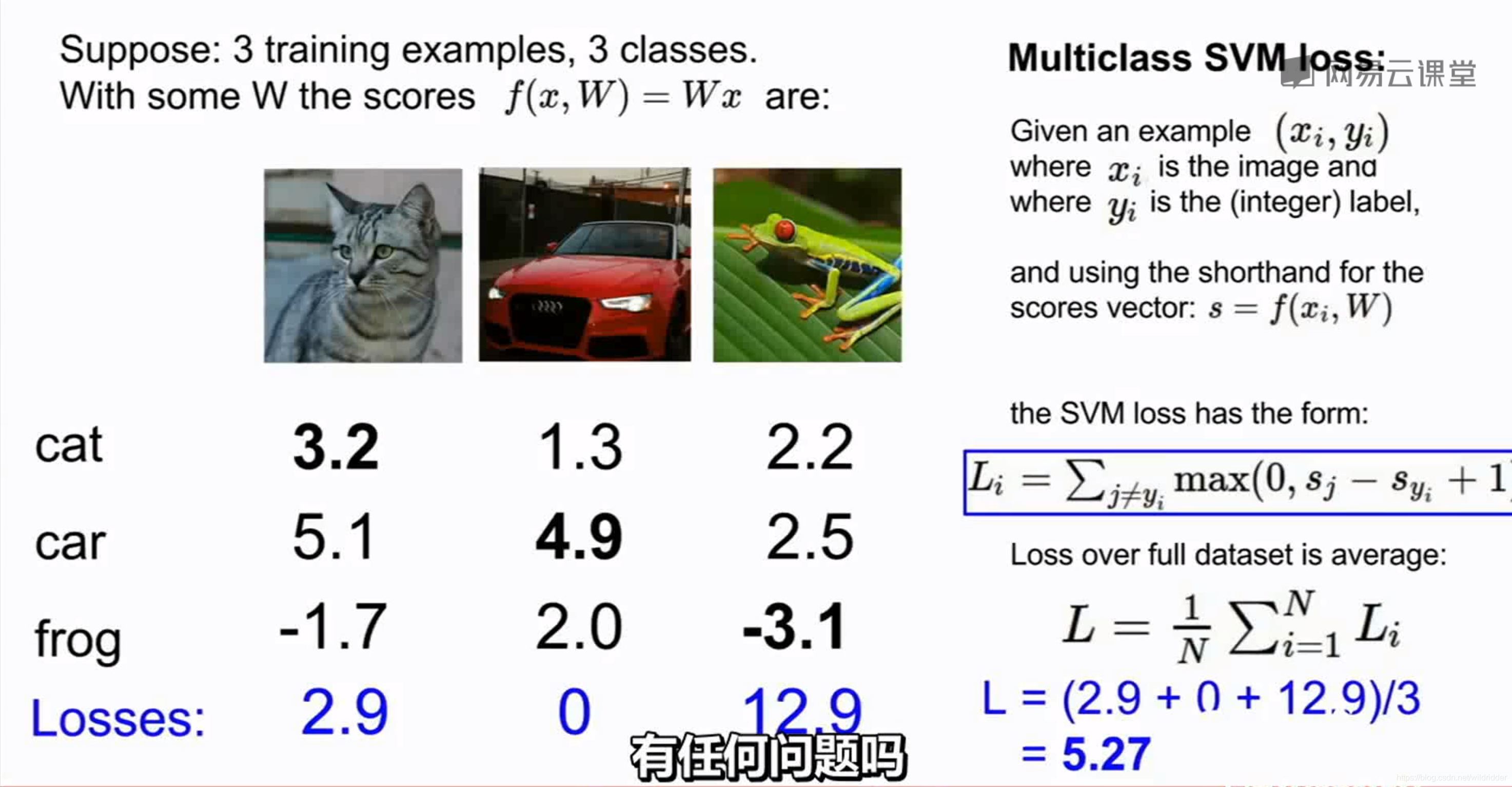

多分类器SVM损失函数

s是分类器的预测分数,yi是这个样本正确分类的标签。图中式子Sj-Syi+1意思是其他标签的分数减去正确标签的分数值加1,然后在这个值和0之间取最大值,作为loss。也就是说,如果正确标签的分数比非正确标签的分数值大1以上的话,这个loss等于0,否则loss为一个正数。

比如第一个loss=max(0,5.1-3.2+1)+max(0,-1.7-3.2+1)=2.9+0=2.9

总的loss越大表明参数W的表现越差。

如果找到一个W使loss=0,那么2W也能使loss=0。所以其实有很多W能使loss最小,即W并不唯一。

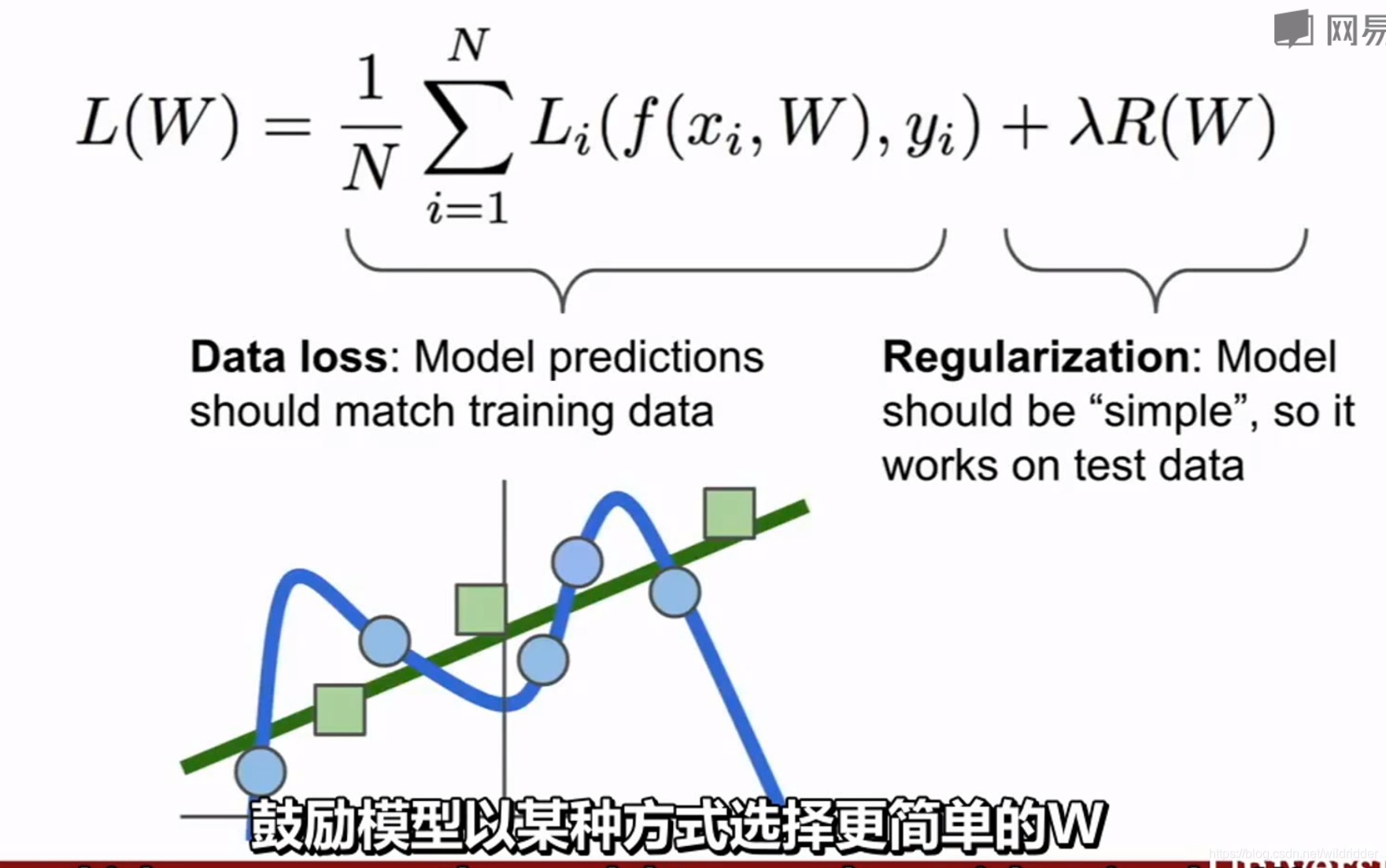

所以如果我们过度在意分类器在数据集上的表现,可能会出现过拟合现象,这时我们需要在loss的计算公式里面引入正则化项,激励模型选择更简单的分类器W

有很多种方法来衡量模型的复杂度,比如L1、L2正则化。 以上即为多类别SVM损失函数。

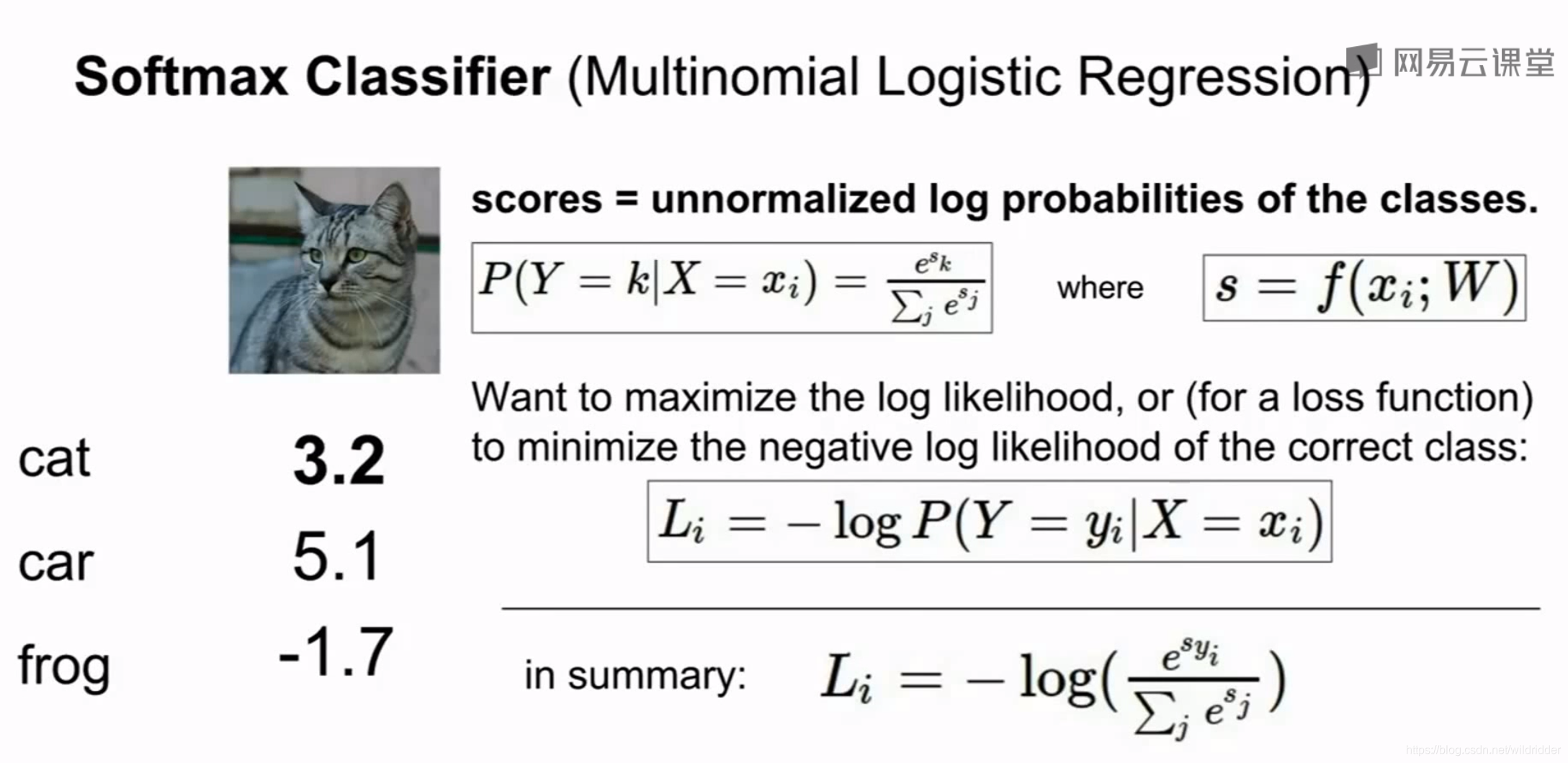

除了线性回归之外,另一个很有用的是多项逻辑回归,Softmax Classifier。

SVM针对多类别分类,给出了这十个类别的得分,但并没有解释这些得分的含义,

但是softmax函数将这些分数整理成概率分布,即样本属于每一类的概率分别是多少,这些概率之和等于一。

算出概率之后,用 - log P来表示损失函数的大小,因为概率越大表示参数越好,则损失函数应该越小,所以加上一个负号,log函数在0~1内是递增的负值,转化后损失函数Li变成概率P的减函数。

优化的目标是让分类正确的概率P=1,即让Loss趋近于0,

Softmax 和 SVM对比

在多分类SVM中,例如对样本中的一个“车”的图片做预测,只要在车这个分类下的得分值比其他不正确的分类分值要高就满足要求,即使正确分类的得分值有所变化也不会对结果有根本影响,因为对于SVM的loss来说,它唯一关心的就是正确的分值要比不正确的分值高出一个安全边界(上例中这个安全边界是1)。

但是Softmax的目标不同,它要使softmax loss尽可能小,也就是正确分类的概率尽可能大,即正确分类的得分经可能高,不正确类的得分尽可能低,将正确的分值推向无穷大,将不正确的分值推向无穷小。

SVM得到一个数据点高于阙值放弃继续优化了,而Softmax会追求完美!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?