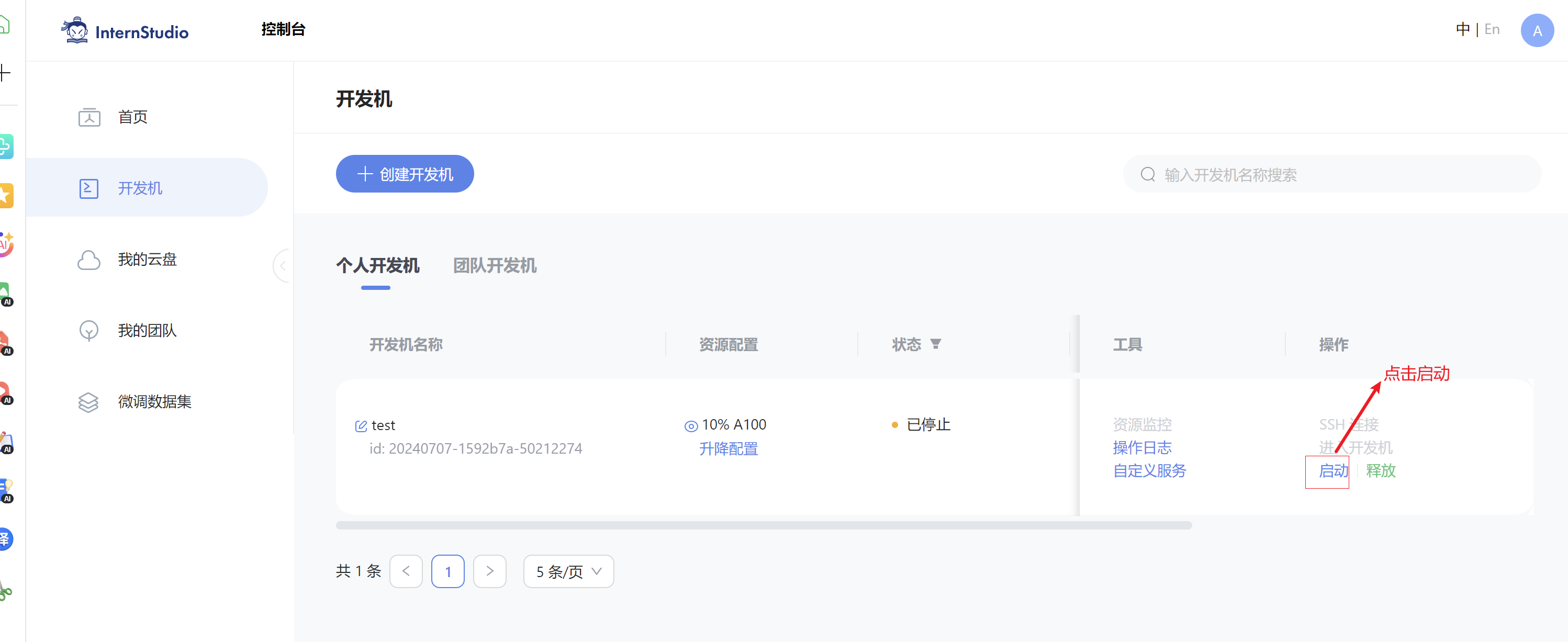

1.开机

点击开机按钮启动服务

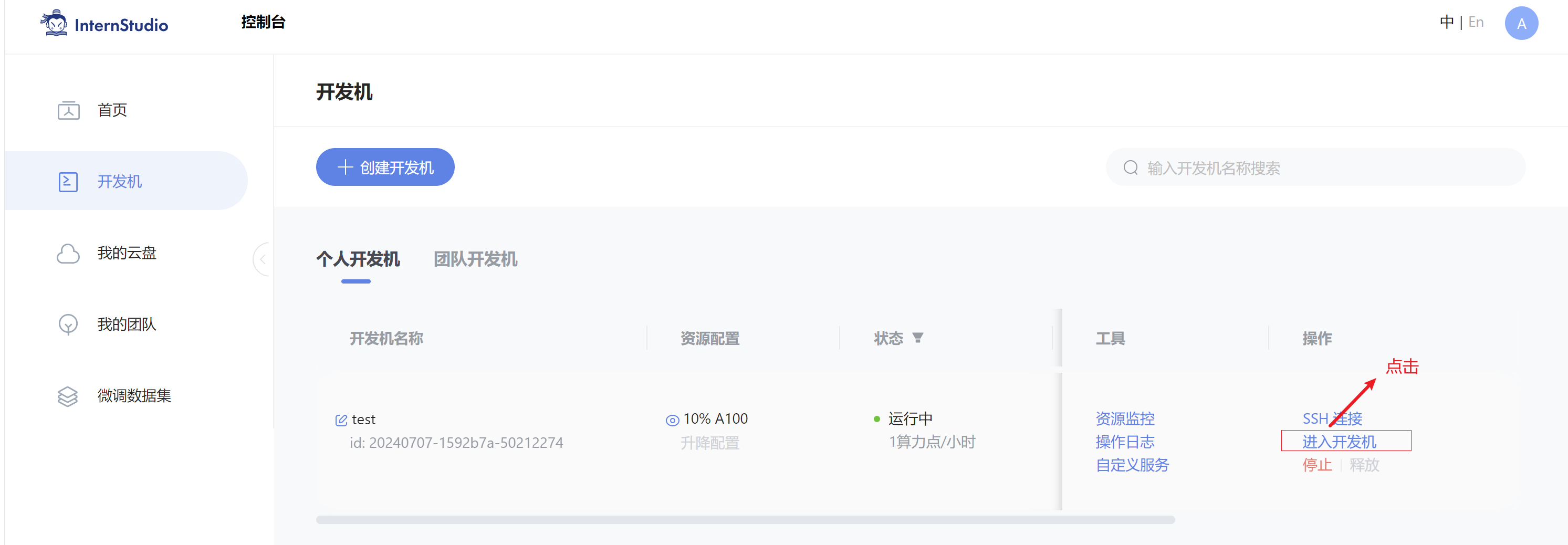

2.进入internStudio

等待服务器分配资源,资源分配后,点击“进入开发机”

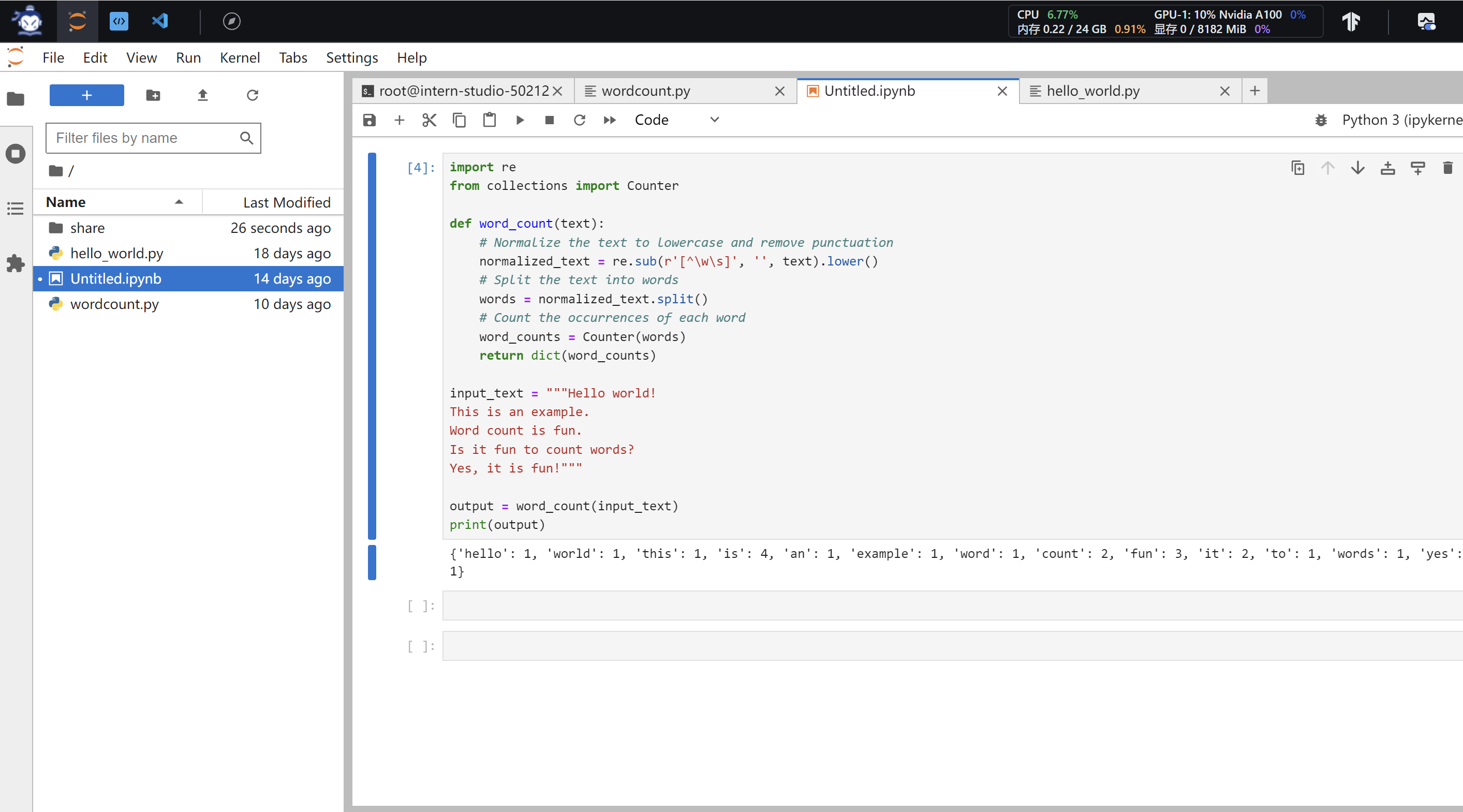

进入调试界面

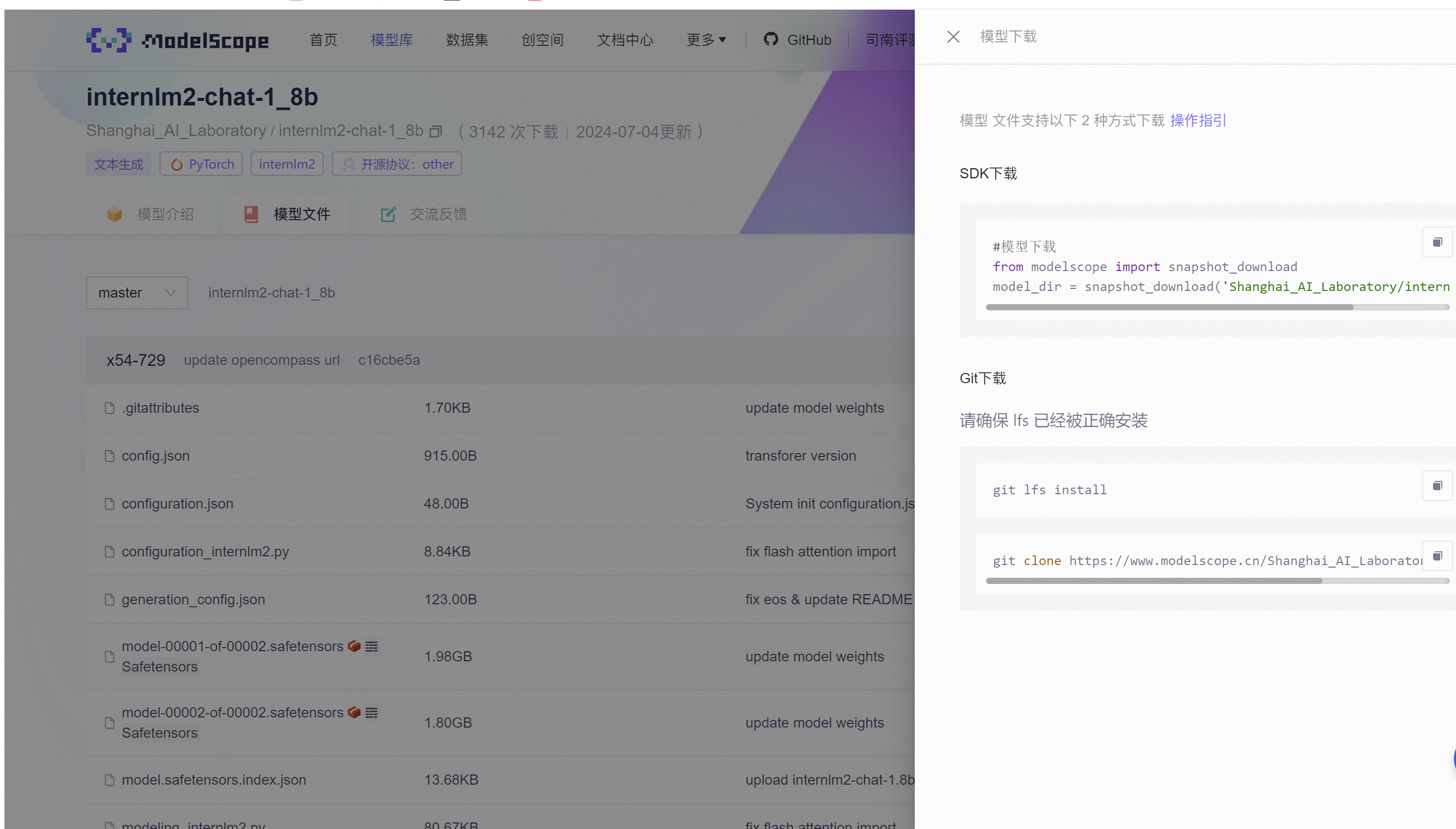

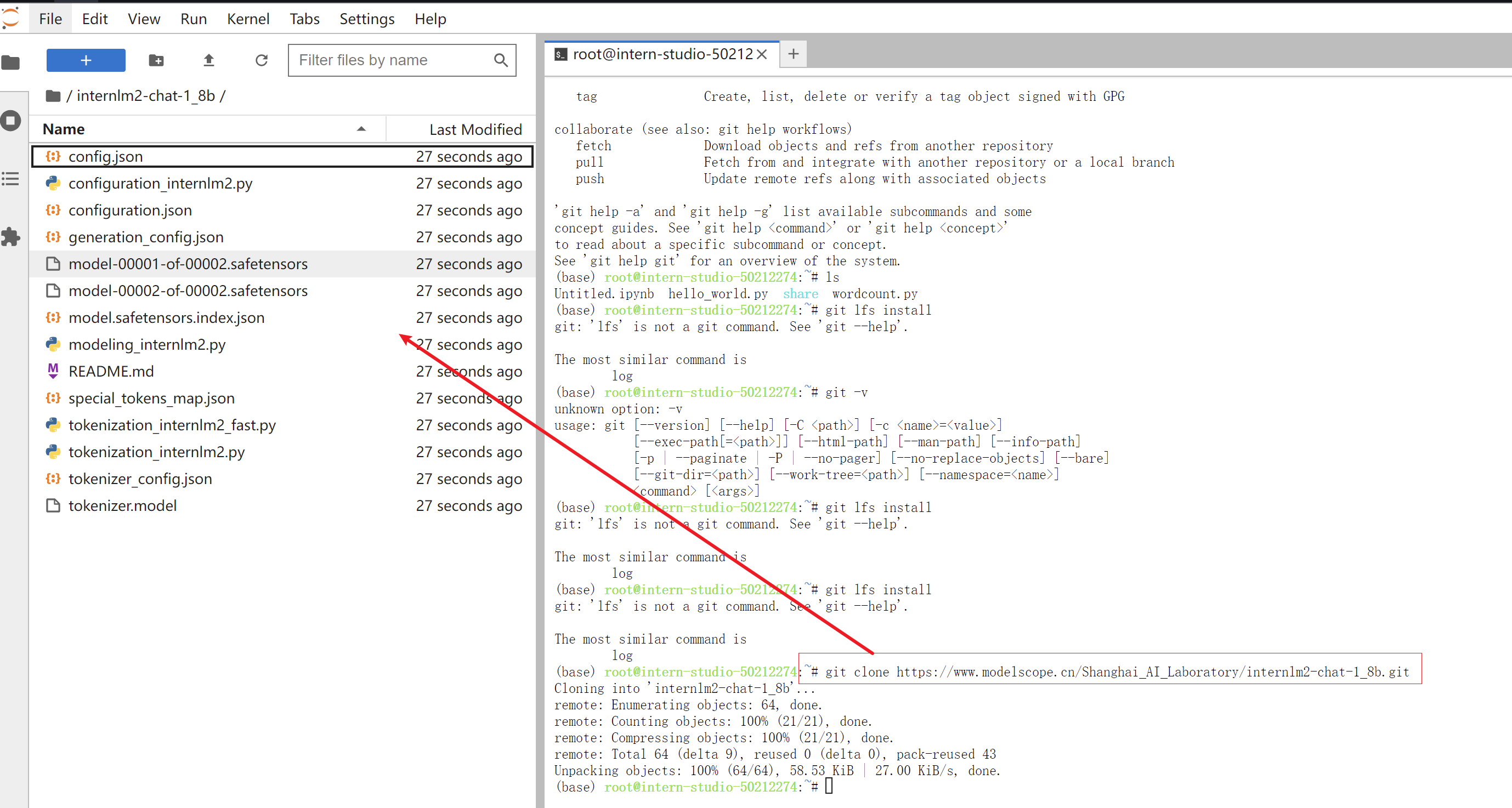

3.模型下载

我们选择魔塔社区提供的internlm2-chat-1_8b小模型

模型访问地址https://www.modelscope.cn/models/Shanghai_AI_Laboratory/internlm2-chat-1_8b/summary

下载模型

在开发机命令行输入 下载模型

# 安装 git-lfs

apt-get install git-lfs

git lfs install

git clone https://www.modelscope.cn/Shanghai_AI_Laboratory/internlm2-chat-1_8b.git

通过以上步骤完成模型下载

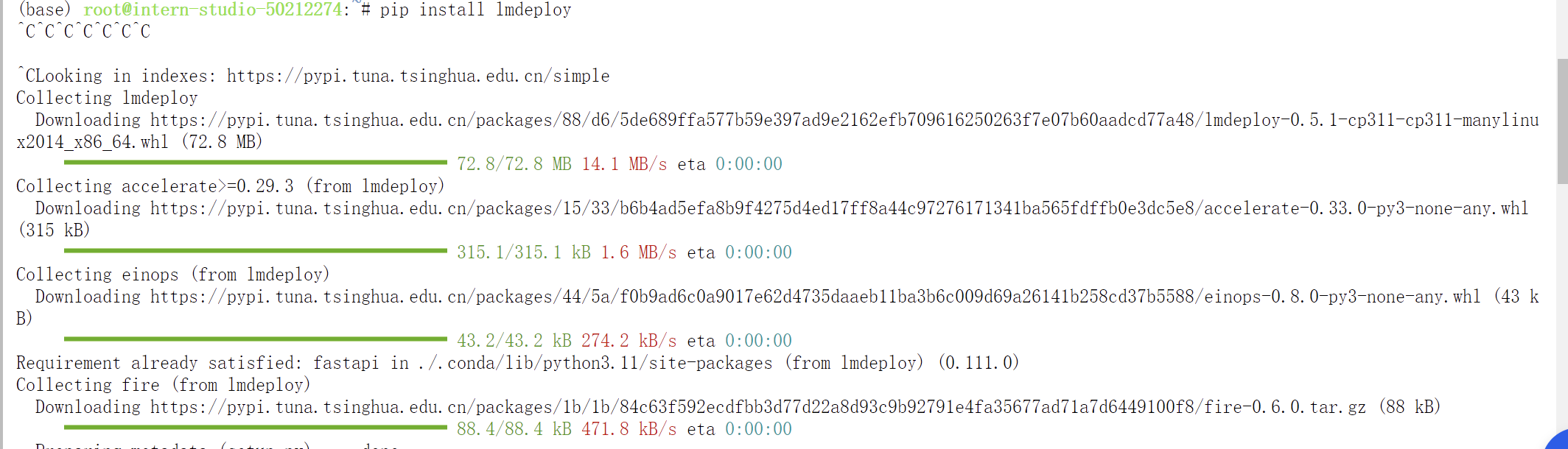

4 .推理框架安装

我们使用lmdeploy 框架来实现推理,这个框架推理起来比较简单

安装lmdeploy

pip install lmdeploy

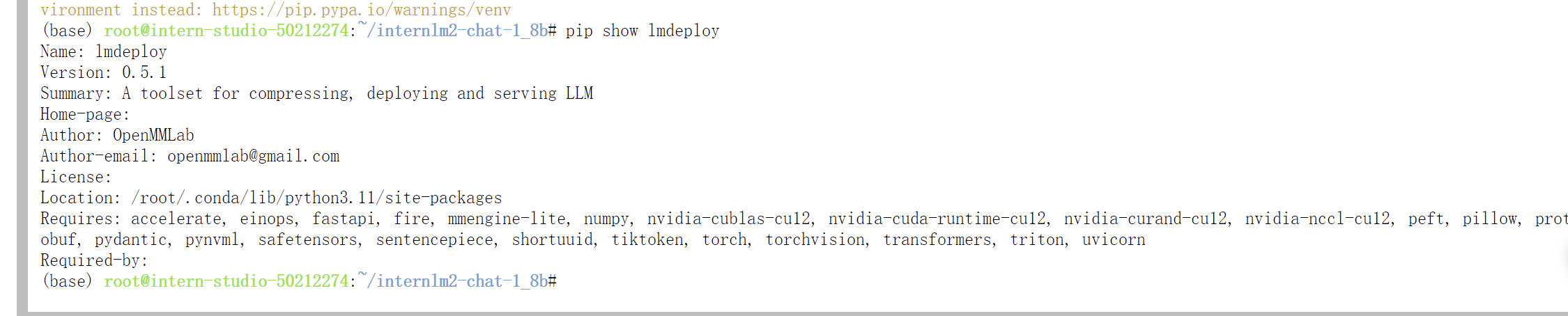

我们使用pip show lmdeploy 检查安装情况

pip show lmdeploy

安装完成后,我们编写推理代码

编写代码2-2. py

import lmdeploy

pipe = lmdeploy.pipeline("/root/internlm2-chat-1_8b")

response = pipe(["你是一个熟读各类小说的专家,请你根据要求写一段300字左右的小故事。"])

print(response)

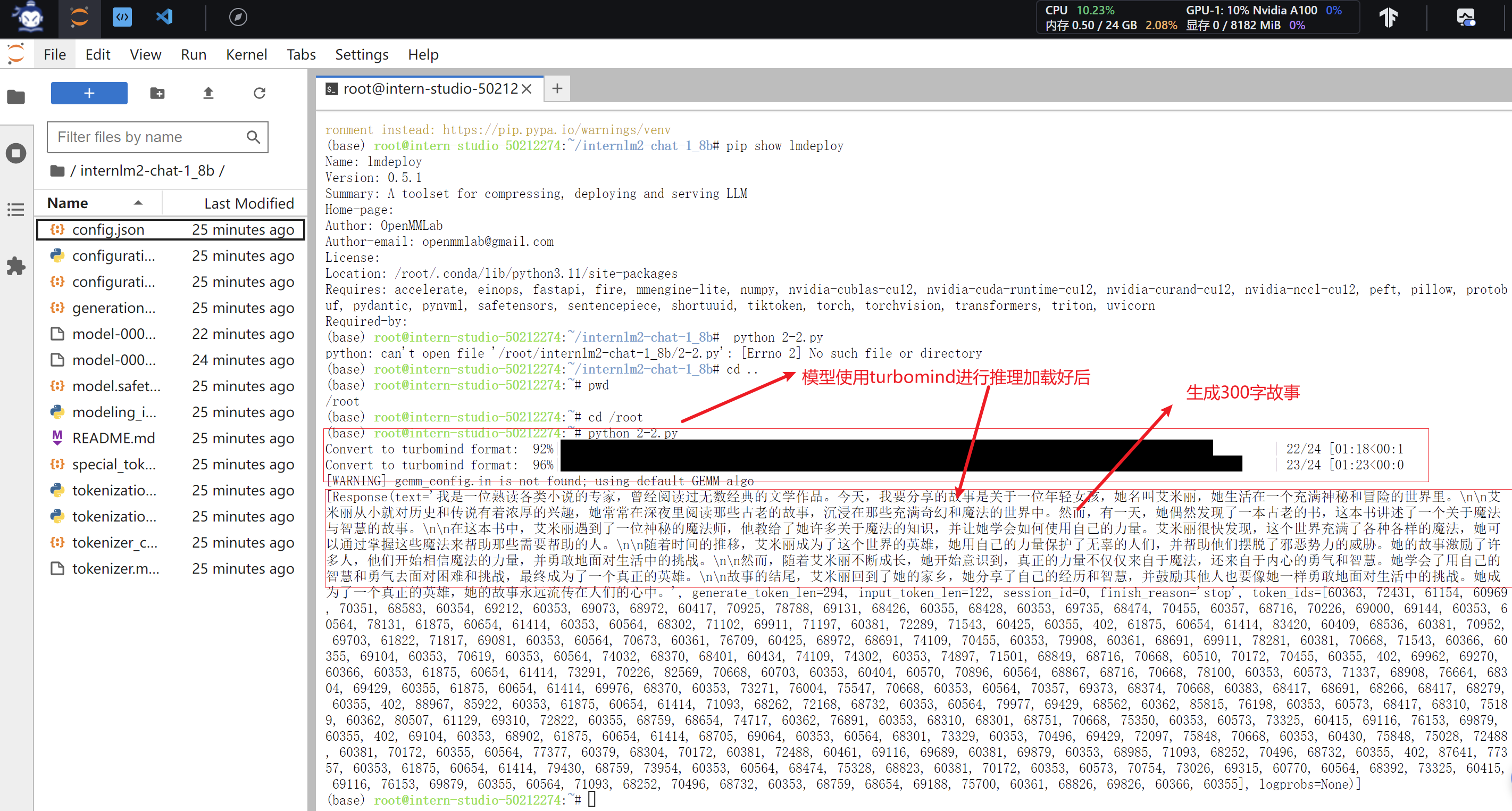

5 .运行

我们在shell命令行窗口中执行

cd /root

python 2-2.py

我们将生成的文章的复制到wps中,简单阅读一下确实是一个简短的故事。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?