zookeeper3.8.3集群安装

server.1= 172.29.1.4:2888:3888

server.2= 172.29.1.12:2888:3888

server.3= 172.29.1.15:2888:3888

sudo su

#创建目录

mkdir -p /data460/server/zookeeper

#解压缩

tar -xzvf /data460/uploadinstalls/zookeeper/apache-zookeeper-3.8.3-bin.tar.gz -C /data460/server/zookeeper/

重命名

mv /data460/server/zookeeper/apache-zookeeper-3.8.3-bin/ /data460/server/zookeeper/zookeeper3.8.3/

cd /data460/server/zookeeper/zookeeper3.8.3/

cp conf/zoo_sample.cfg conf/zoo.cfg

#把zookeeper加入到环境变量

echo -e "# append zk_env\nexport PATH=$PATH:/data460/server/zookeeper/zookeeper3.8.3/bin" >> /etc/profile

三、Zookeeper集群配置

注意:搭建zookeeper集群时,一定要先停止已经启动的zookeeper节点。

3.1、Zookeeper配置文件修改

#修改过后的配置文件zoo.cfg,如下:

egrep -v "^#|^$" zoo.cfg

tickTime=2000

initLimit=10

syncLimit=5

dataLogDir=/data460/server/zookeeper/zookeeper3.8.3/logs

dataDir=/data460/server/zookeeper/zookeeper3.8.3/data

clientPort=2181

autopurge.snapRetainCount=500

autopurge.purgeInterval=24

server.1= 172.29.1.4:2888:3888

server.2= 172.29.1.12:2888:3888

server.3= 172.29.1.15:2888:3888

#创建相关目录,三台节点都需要

mkdir -p /data460/server/zookeeper/zookeeper3.8.3/{logs,data}

#其余zookeeper节点安装完成之后,同步配置文件zoo.cfg。

3.2、配置参数说明

tickTime这个时间是作为zookeeper服务器之间或客户端与服务器之间维持心跳的时间间隔,也就是说每个tickTime时间就会发送一个心跳。

initLimit这个配置项是用来配置zookeeper接受客户端(这里所说的客户端不是用户连接zookeeper服务器的客户端,而是zookeeper服务器集群中连接到leader的follower 服务器)初始化连接时最长能忍受多少个心跳时间间隔数。

当已经超过10个心跳的时间(也就是tickTime)长度后 zookeeper 服务器还没有收到客户端的返回信息,那么表明这个客户端连接失败。总的时间长度就是 10*2000=20秒。

syncLimit这个配置项标识leader与follower之间发送消息,请求和应答时间长度,最长不能超过多少个tickTime的时间长度,总的时间长度就是5*2000=10秒。

dataDir顾名思义就是zookeeper保存数据的目录,默认情况下zookeeper将写数据的日志文件也保存在这个目录里;

clientPort这个端口就是客户端连接Zookeeper服务器的端口,Zookeeper会监听这个端口接受客户端的访问请求;

server.A=B:C:D中的A是一个数字,表示这个是第几号服务器,B是这个服务器的IP地址,C第一个端口用来集群成员的信息交换,表示这个服务器与集群中的leader服务器交换信息的端口,D是在leader挂掉时专门用来进行选举leader所用的端口。

3.3、创建ServerID标识

除了修改zoo.cfg配置文件外,zookeeper集群模式下还要配置一个myid文件,这个文件需要放在dataDir目录下。

这个文件里面有一个数据就是A的值(该A就是zoo.cfg文件中server.A=B:C:D中的A),在zoo.cfg文件中配置的dataDir路径中创建myid文件。

#在172.29.1.4服务器上面创建myid文件,并设置值为1,同时与zoo.cfg文件里面的server.1保持一致,如下

echo "1" > /data460/server/zookeeper/zookeeper3.8.3/data/myid

#在172.29.1.12服务器上面创建myid文件,并设置值为2,同时与zoo.cfg文件里面的server.2保持一致,如下

echo "2" > /data460/server/zookeeper/zookeeper3.8.3/data/myid

#在172.29.1.15服务器上面创建myid文件,并设置值为3,同时与zoo.cfg文件里面的server.3保持一致,如下

echo "3" > /data460/server/zookeeper/zookeeper3.8.3/data/myid

到此,相关配置已完成

四、Zookeeper集群查看

1、启动每个服务器上面的zookeeper节点:

/data460/server/zookeeper/zookeeper3.8.3/bin/zkServer.sh start

注意:报错排查

Zookeeper节点启动不了可能原因:zoo.cfg配置文件有误、iptables没关。

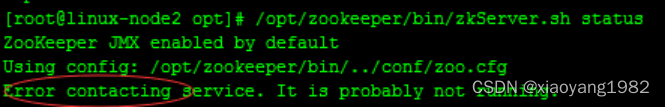

- 启动完成之后查看每个节点的状态

/data460/server/zookeeper/zookeeper3.8.3/bin/zkServer.sh status

linux-node1,linux-node3两台服务器zookeeper的状态是follow模式,linux-node2这台服务器zookeeper的状态是leader模式。

五、Zookeeper集群连接

Zookeeper集群搭建完毕之后,可以通过客户端脚本连接到zookeeper集群上面,对客户端来说,zookeeper集群是一个整体,连接到zookeeper集群实际上感觉在独享整个集群的服务。

#在linux-node1测试

通过 zkCli.sh -server 172.29.1.4 进行测试

zookeeper设置开机自启,指定java_home

开机自启:

(1)编辑zookeeper.service文件

vim /usr/lib/systemd/system/zookeeper.service

加入如下内容

复制代码

[Unit]

Description=zookeeper

After=network.target remote-fs.target nss-lookup.target

[Service]

Type=forking

Environment=JAVA_HOME=/data460/server/java/jdk8u392-b08

ExecStart=/data460/server/zookeeper/zookeeper3.8.3/bin/zkServer.sh start

ExecReload=/data460/server/zookeeper/zookeeper3.8.3/bin/zkServer.sh restart

ExecStop=/data460/server/zookeeper/zookeeper3.8.3/bin/zkServer.sh stop

[Install]

WantedBy=multi-user.target

复制代码

(2)改变文件权限

chmod 777 /usr/lib/systemd/system/zookeeper.service

(3)生效

systemctl daemon-reload

(4)systemctl开机启动zookeeper

systemctl enable /usr/lib/systemd/system/zookeeper.service

或

systemctl enable /usr/lib/systemd/system/zookeeper

(5)查看是否开机启动

systemctl is-enabled zookeeper.service

(6)systemctl取消开机启动redis

systemctl disable zookeeper.service

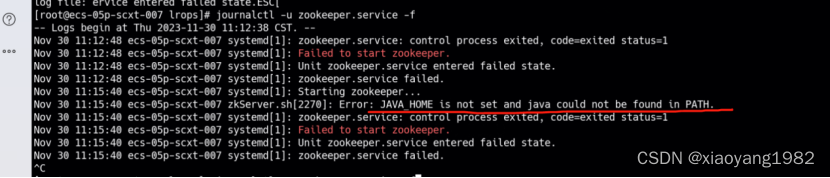

启动失败,查看失败原因

journalctl -u zookeeper.service -f 指定java_home目录

即需要在启动脚本里面增加java环境变量

![]()

1610

1610

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?