ChatGlm3-6B的部署及微调流程

前言

随着人工智能的不断发展,机器学习这门技术也越来越重要,人工智能大模型的应用化也被广泛使用,本文介绍了如何进行ChatGlm3-6B的部署及微调流程。

提示:以下是本篇文章正文内容,下面案例可供参考

一、软硬件标准需求

软件:

- pytorch 2.1.2

- TensorFlow2.14.0

- python3.10

硬件:

- 内存32G以上(最低)

- GPU 1*NVIDIA V100

- 显存16G以上(最低)

二、模型部署及运行

1.创建LLM实例

在阿里云平台上创建实例LLM并配置镜像版本:

在云平台上运行实例:

2.下载模型

mkdir models

cd models

apt update

apt install git-lfs

# 克隆chatGLM3-6b大模型

git clone https://www.modelscope.cn/ZhipuAI/chatglm3-6b.git

(下载大模型的时间较长,耐心等待)

3.下载项目

mkdir webcodes

cd webcodes

# 下载chatglm3-6b web_demo项目

git clone https://github.com/THUDM/ChatGLM3.git

# 安装依赖

pip install -r requirements.txt

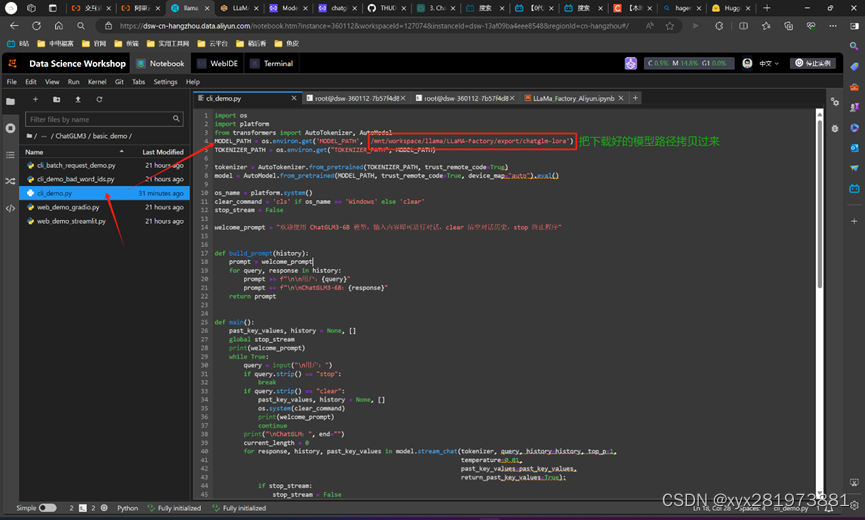

4.修改模型路径

在模型启动之前需要修改下载的大模型路径,以小黑窗启动为例,在/mnt/workspace/webcodes/ChatGLM3/basic_demo目录下的cli_demo.py文件中修改刚才下载的模型路径

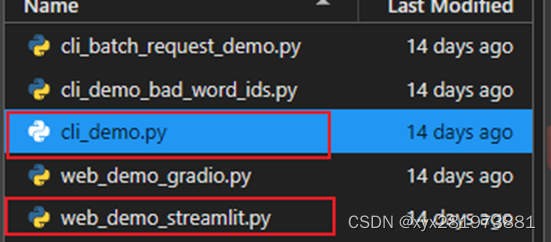

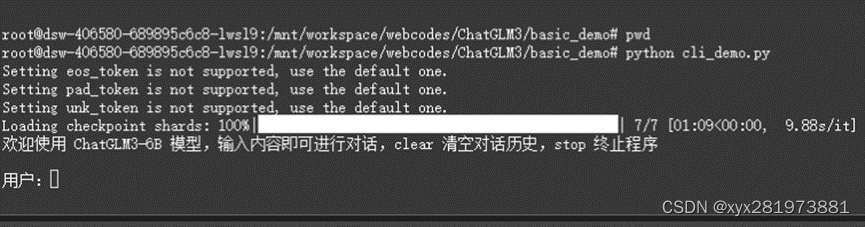

5.启动

# 小黑窗启动命令

python cli_demo.py

# 网页端启动

streamlit run web_demo_streamlit.py

启动成功,在输入框中输入内容即可进行对话

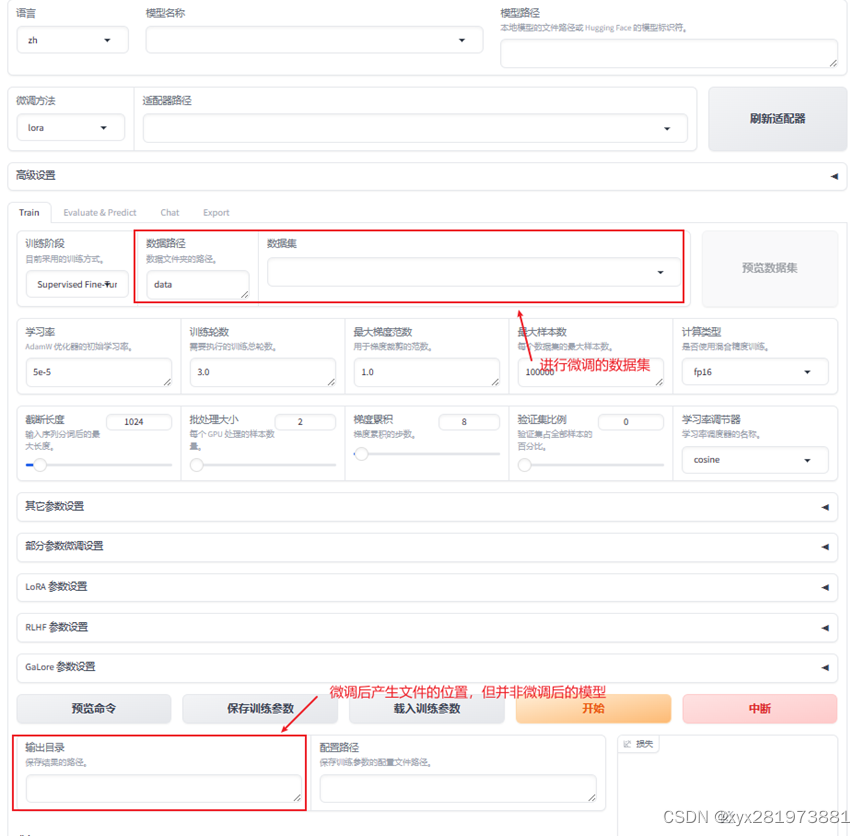

三、模型微调(LLaMA-Factory工具)

1.安装LLaMA-Factory

#克隆项目

git clone https://github.com/hiyouga/LLaMA-Factory.git

# 安装项目依赖

cd LLaMA-Factory

pip install -r requirements.txt

pip install transformers stream generator bitsandbytes tiktoken auto-gptg optimum

pip install --upgrade tensorflow

pip uninstall flash-attn -y

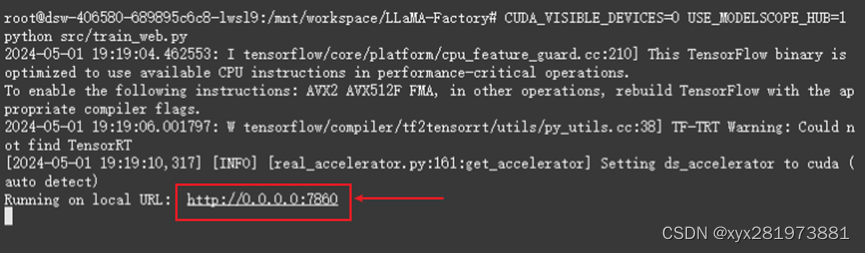

# 运行

CUDA VISIBLE DEVICES=0 USE MODELSCOPE HUB=1 python src/train web.py

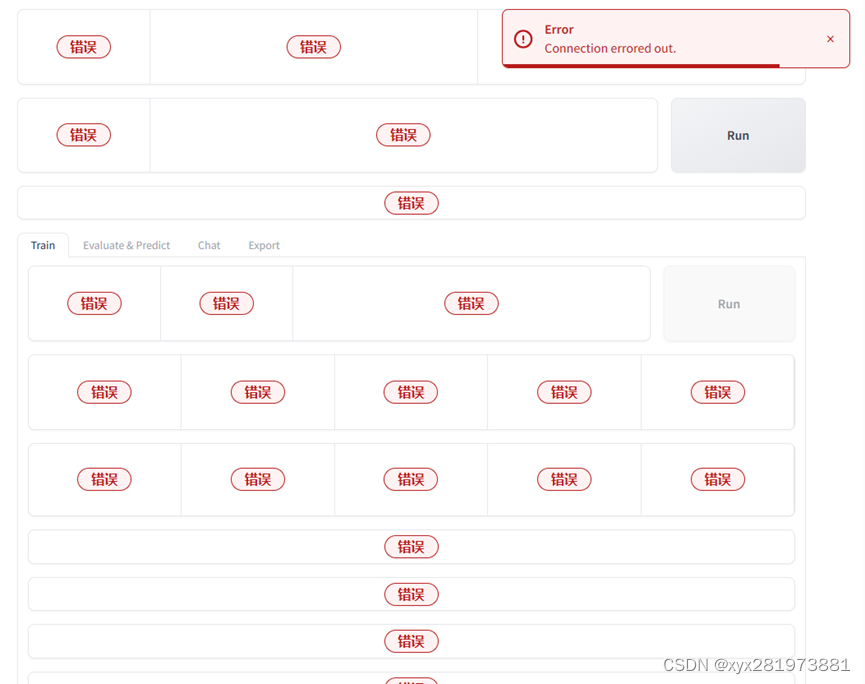

进入给出的网址:

发现出现了链接错误(似乎是阿里云的问题)

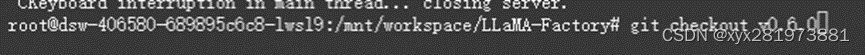

将其改为旧版本后网站可以正常显示

本文详细介绍了如何在阿里云上部署和微调ChatGlm3-6B模型,包括软硬件需求、模型下载、项目配置、模型路径修改以及使用LLaMA-Factory工具进行微调的过程。

本文详细介绍了如何在阿里云上部署和微调ChatGlm3-6B模型,包括软硬件需求、模型下载、项目配置、模型路径修改以及使用LLaMA-Factory工具进行微调的过程。

753

753

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?