MySQL索引优化实战二

Explain工具介绍

MySQL调优之Explain工具最佳实践(二)

分页查询优化

测试表:

CREATE TABLE `employees` (

`id` int(11) NOT NULL AUTO_INCREMENT,

`name` varchar(24) NOT NULL DEFAULT '' COMMENT '姓名',

`age` int(11) NOT NULL DEFAULT '0' COMMENT '年龄',

`position` varchar(20) NOT NULL DEFAULT '' COMMENT '职位',

`hire_time` timestamp NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '入职时间',

PRIMARY KEY (`id`),

KEY `idx_name_age_position` (`name`,`age`,`position`) USING BTREE

) ENGINE=InnoDB AUTO_INCREMENT=1 DEFAULT CHARSET=utf8 COMMENT='员工记录表';

limit分页查询

很多时候我们业务系统实现分页功能可能会用如下sql实现

select * from employees limit 10000,10;

表示从表empployees取出10001行开始的10行记录;

看似只查询了10条记录。实际这条SQL是先读取了10010条数据,然后前10000条数据,然后读到后面10条数据。因此如果要查询一张几百万条数据的表,执行效率非常慢。

分页场景优化技巧

场景1:自增且主键排序

- 根据自增且连续的主键排序的分页查询

select * from employees limit 90000,5;

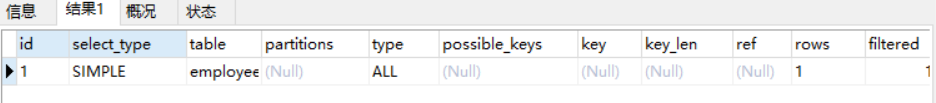

- 查看执行计划:

过程全表扫描,其实就是将主键聚簇索引的底层结点连接指针遍历一次,然后根据limit条件将数据取出来。最终拿出了90005条数据。

该SQL语句会通过全表扫描的方式查询90005条数据,然后将前90000条数据抛弃,没有添加order by ,表示通过主键排序。因为主键自增且连续的,所以可以改写成按照主键去查询从第90001条开始的5条数据;

- 优化

select * from employees where id>90000 limit 5

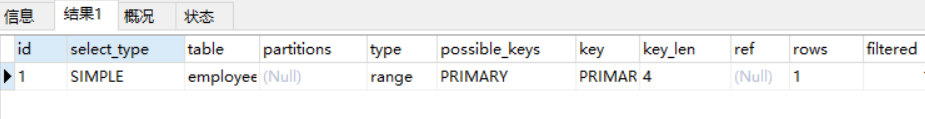

- 查看执行计划:使用了主键索引作为查询条件

过程:这里使用where作为查询条件,而不是扫描条件,根据主键的值,在主键聚簇索引B+树里进行遍历,直至找到ID值为90000的结点,然后再使用连接指针将下一个指向的结点取出来,取出5个。

结果:

显然改写后的SQL语句走了索引,而且扫描的行数大大减少,执行效率更高。

缺点

但是这条改写的SQL语句在很多场景下不能使用。因为表中的某些数据被删除后,主键空缺,导致结果不一致。**

如下图试验所示:(先删除一条前面的记录,然后再测试原 SQL 和优化后的 SQL):

select * from employees limit 10000,10;

select * from employees where id>90000 limit 5

两条 SQL 的结果并不一样,因此,如果主键不连续,不能使用上面描述的优化方法。

另外如果原 SQL 是 order by 非主键的字段,按照上面说的方法改写会导致两条 SQL 的结果不一致。所以这种改写得满足以下两个条件:

- 主键自增且连续

- 结果是按照主键排序的

根据非主键字段排序的分页查询

再看一个根据非主键字段排序的分页查询。

- SQL 如下:

select * from employees ORDER BY name limit 90000,5;

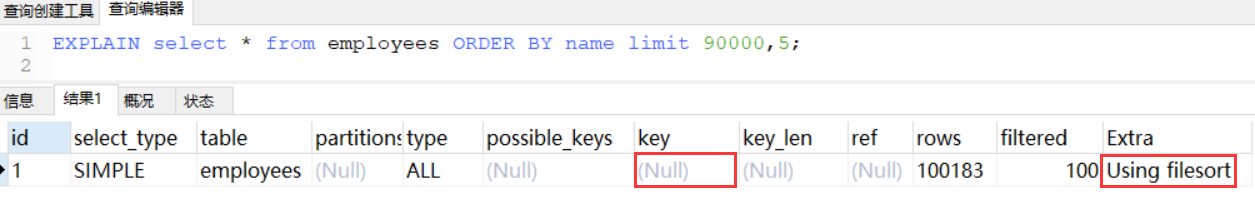

- 查询计划

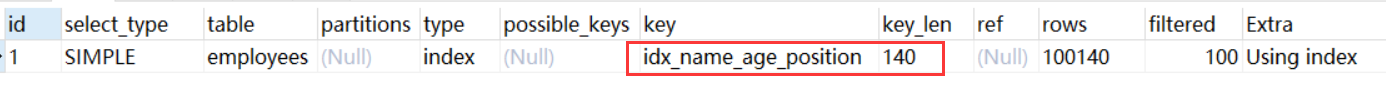

EXPLAIN select * from employees ORDER BY name limit 90000,5;

使用的全表扫描,且出现了using filesort文件排序。

原因:可能要扫描二级索引name进行排序,排完序后,还要根据二级索引的每个值进行回表扫描,这个过程可能速度没有全表扫描快,所以MySQL优化器放弃了使用索引进行排序,改用全表扫描。

- 优化

mysql> select * from employees e inner join (select id from employees order by name limit 90000,5) ed on e.id = ed.id;

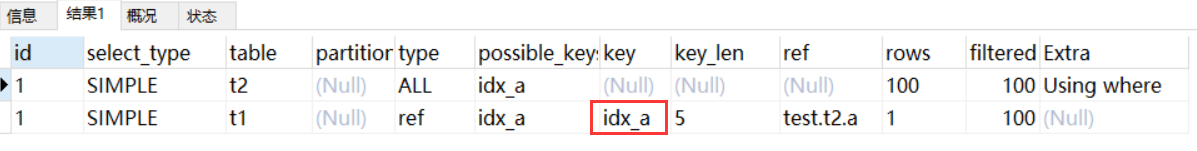

- 查看执行计划

我们再对比优化前后sql的执行计划,

需要的结果与原 SQL 一致,执行时间减少了一半以上。

原 SQL 使用的是 filesort 排序,而优化后的 SQL 使用的是索引排序。

JOIN关联查询优化

示例表:

-- 示例表:

CREATE TABLE `t1` (

`id` int(11) NOT NULL AUTO_INCREMENT,

`a` int(11) DEFAULT NULL,

`b` int(11) DEFAULT NULL,

PRIMARY KEY (`id`),

KEY `idx_a` (`a`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8;

create table t2 like t1;

-- 插入一些示例数据

-- 往t1表插入1万行记录

drop procedure if exists insert_t1;

delimiter ;;

create procedure insert_t1()

begin

declare i int;

set i=1;

while(i<=10000)do

insert into t1(a,b) values(i,i);

set i=i+1;

end while;

end;;

delimiter ;

call insert_t1();

-- 往t2表插入100行记录

drop procedure if exists insert_t2;

delimiter ;;

create procedure insert_t2()

begin

declare i int;

set i=1;

while(i<=100)do

insert into t2(a,b) values(i,i);

set i=i+1;

end while;

end;;

delimiter ;

call insert_t2();

mysql的表关联常见有两种算法

- Nested-Loop Join算法

- Block Nested-Loop Join算法

嵌套循环连接(Nested-Loop Join算法)算法

一次一行循环的从驱动表里读取行,在这行数据中获取到关联字段,根据关联字段在被驱动表里取出所有满足条件的行,然后取出两张表的结果合集。

EXPLAIN select * from t1 inner join t2 on t1.a= t2.a;

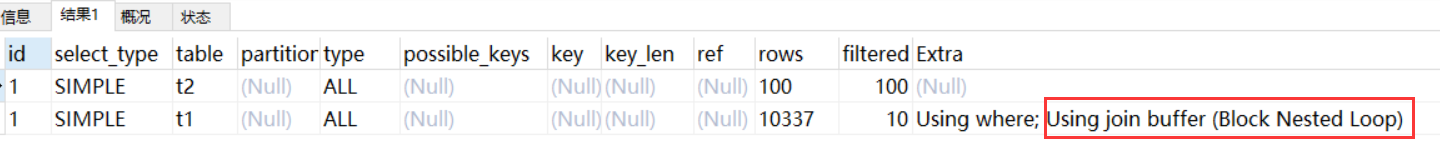

从执行计划中可以看到这些信息:

- 驱动表是t2,被驱动表是t1.先执行的是驱动表(执行计划结果的id列相同则按照从上到下执行SQL语句);优化器一般会优先选择校表作为驱动表,用where条件过滤完驱动表,然后在跟被驱动表做关联查询。所以inner join时,排在前面的表不一定就是驱动表。

- 当使用left join,坐表时驱动表,右表是被驱动表

- 当使用right join时,左表时被驱动表,右表是驱动表。

- 当使用inner join 或者 join,mysql会选择数据量小的作为驱动表,大表作为被驱动表。

- 使用了NLJ算法,一般join语句中,如果执行计划中未出现using join buffer,则使用的算法是join算法是NLJ;

sql的大致流程

- 从t2表中读取一行数据(如果t2表有查询过滤条件的,先用过滤条件过滤完,再从过滤结果里取出一行数据);

- 从第1步的数据中,取出关联字段a,到表t1中查找;

- 取出t1中满足条件的行,跟t2中的结果进行合并,作为结果返回给客户端。

- 重复上面3步。

整个过程会读取 t2 表的所有数据(扫描100行),然后遍历这每行数据中字段 a 的值,根据 t2 表中 a 的值索引扫描 t1 表中的对应行(扫描100次 t1 表的索引,1次扫描可以认为最终只扫描 t1 表一行完整数据,也就是总共 t1 表也扫描了100行)。因此整个过程扫描了 200 行。

如果被驱动表的关联字段没索引,使用NLJ算法性能会比较低(下面有详细解释),mysql会选择Block Nested-Loop Join算法。

基于块的嵌套循环连接算法(Block Nested-Loop Join)

把驱动表的数据读入到join-buffer中,然后扫描被驱动表,把被驱动表每一行取出来跟join-buffer中的数据进行对比;

EXPLAIN select * from t1 inner join t2 on t1.b= t2.b;

Extra 中 的Using join buffer (Block Nested Loop)说明该关联查询使用的是 BNL 算法。

sql的大致流程

- 把t2的所有数据放入到join-buffer中;

- 把表t1中每一行取出来,跟join-buffer的数据作对比;

- 返回满足join条件的数据。

整个过程对表 t1 和 t2 都做了一次全表扫描,因此扫描的总行数为10000(表 t1 的数据总量) + 100(表 t2 的数据总量) = 10100。

并且join-buffer里的数据是无序的。因此对表t1中的每一行,都要做100次判断,所以内存中的判断次数是100* 10000=100万次。

join_buffer 的大小是由参数 join_buffer_size 设定的,默认值是 256k。

如果放不下表 t2 的所有数据话,策略很简单,就是分段放。

比如 t2 表有1000行记录, join_buffer 一次只能放800行数据,那么执行过程就是先往 join_buffer 里放800行记录,然后从 t1 表里取数据跟 join_buffer 中数据对比得到部分结果,然后清空 join_buffer ,再放入 t2 表剩余200行记录,再次从 t1 表里取数据跟 join_buffer 中数据对比。所以就多扫了一次 t1 表。

两种算法比较

被驱动表的关联字段没索引为什么要选择使用 BNL 算法而不使用 Nested-Loop Join 呢?

如果上面第二条sql使用 Nested-Loop Join,那么t2表每取出一条记录,则使用全表扫描扫描符合条件的所有记录。每一张表有10000条数据,t2表有100条数据,笛卡尔积就是100万次,这个还是磁盘扫描。

很显然,用BNL磁盘扫描次数少很多,相比于磁盘扫描,BNL的内存计算会快得多。

因此MySQL对于被驱动表的关联字段没索引的关联查询,一般都会使用 BNL 算法。如果有索引一般选择 NLJ 算法,有索引的情况下 NLJ 算法比 BNL算法性能更高

对于关联sql的优化

- 关联字段加索引

让mysql做join操作时尽量选择NLJ算法,驱动表因为需要全部查询出来,所以过滤的条件尽量要走索引,避免全表扫描。总之,能走索引的过滤条件尽量都走索引 - 小表驱动大表

写多表连接sql时如果明确知道哪张表是小表可以用straight_join写法固定连接驱动方式,省去mysql优化器自己判断的时间

比如:select * from t2 straight_join t1 on t2.a = t1.a; 代表指定mysql选着 t2 表作为驱动表。

- straight_join只适用于inner join,并不适用于left join,right join。(因为left join,right join已经代表指定了表的执行顺序)

- 尽可能让优化器去判断,因为大部分情况下mysql优化器是比人要聪明的。使用straight_join一定要慎重,因为部分情况下人为指定的执行顺序并不一定会比优化引擎要靠谱。

对于小表的定义

在决定哪个表做驱动表的时候,应该是两个表按照各自的条件过滤,过滤完成之后,计算参与 join 的各个字段的总数据量,数据量小的那个表,就是“小表”,应该作为驱动表。

in和exsits优化

原则:小表驱动大表,即小的数据集驱动大的数据集

- in:当B表的数据集小于A表的数据集时,in优于exists

select * from A where id in (select id from B)

#等价于:

for(select id from B){

select * from A where A.id = B.id

}

- 当A表的数据集小于B表的数据集时,exists优于in

将主查询A的数据,放到子查询B中做条件验证,根据验证结果(true或false)来决定主查询的数据是否保留

select * from A where exists (select 1 from B where B.id = A.id)

#等价于:

for(select * from A){

select * from B where B.id = A.id

}

#A表与B表的ID字段应建立索引

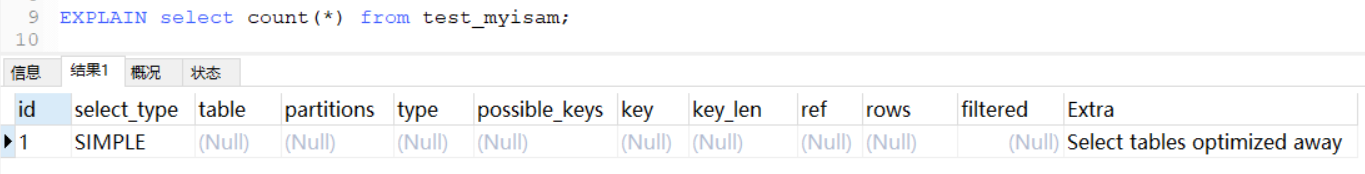

count(*)查询优化

-- 临时关闭mysql查询缓存,为了查看sql多次执行的真实时间

mysql> set global query_cache_size=0;

mysql> set global query_cache_type=0;

mysql> EXPLAIN select count(1) from employees;

mysql> EXPLAIN select count(id) from employees;

mysql> EXPLAIN select count(name) from employees;

mysql> EXPLAIN select count(*) from employees;

注意:以上4条sql只有根据某个字段count不会统计字段为null值的数据行

四个sql的执行计划一样,说明这四个sql执行效率应该差不多

字段有索引:count(*) ≈ count(1)>count(字段) >count(id)

字段有索引count(字段)统计走二级索引,二级索引存储数据比主键索引少,所以count(字段)>count(主键 id)

字段无索引:count(*)≈count(1) >count(id)>count(字段)

字段没有索引count(字段)统计走不了索引,count(主键 id)还可以走主键索引,所以count(主键 id)>count(字段)

-

count(1)跟count(字段)执行过程类似,不过count(1)不需要取出字段统计,就用常量1做统计,count(字段)还需要取出字段,所以理论上count(1)比count(字段)会快一点。

-

count() 是例外,mysql并不会把全部字段取出来,而是专门做了优化,不取值,按行累加,效率很高,所以不需要用count(列名)或count(常量)来替代 count()。

-

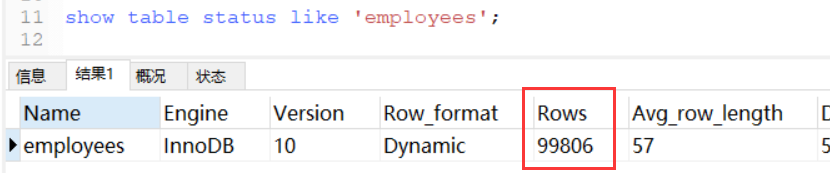

为什么对于count(id),mysql最终选择辅助索引而不是主键聚集索引?

因为二级索引相对主键索引存储数据更少,二级索引B+树每个结点可以存储的索引结点数量更多,一次IO操作可以读取更多的索引结点,这就检索性能应该更高,mysql内部做了优化。

常见优化方法

-

查询mysql自己维护的总行数

对于myisam存储引擎的表做不带where条件的count查询性能是很高的,因为myisam存储引擎的表的总行数会被mysql存储在磁盘上,查询不需要计算

对于innodb存储引擎的表mysql不会存储表的总记录行数,查询count需要实时计算 -

show table status

如果只需要知道表总行数的估计值可以用如下sql查询,性能很高

-

将总数维护到Redis里

插入或删除表数据行的时候同时维护redis里的表总行数key的计数值(用incr或decr命令),但是这种方式可能不准,很难保证表操作和redis操作的事务一致性 -

增加数据库计数表

插入或删除表数据行的时候同时维护计数表,让他们在同一个事务里操作

阿里巴巴Mysql规范解读

MySQL数据类型选择

(1)确定合适的大类型:数字、字符串、时间、二进制;

(2)确定具体的类型:有无符号、取值范围、变长定长等。

在MySQL数据类型设置方面,尽量用更小的数据类型,因为它们通常有更好的性能,花费更少的硬件资源。并且,尽量把字段定义为NOT NULL,避免使用NULL。

数值类型

优化建议

- DECIMAL最适合保存准确度要求高,而且用于计算的数据,比如价格。但是在使用DECIMAL类型的时候,注意 长度设置。

- 整数通常是最佳的数据类型,因为它速度快,并且能使用AUTO_INCREMENT。

日期和时间

优化建议

- MySQL能存储的最小时间粒度为秒。

- 建议用DATE数据类型来保存日期。MySQL中默认的日期格式是yyyy-mm-dd。

- 用MySQL的内建类型DATE、TIME、DATETIME来存储时间,而不是使用字符串。

- 当数据格式为TIMESTAMP和DATETIME时,可以用CURRENT_TIMESTAMP作为默认(MySQL5.6以后), MySQL会自动返回记录插入的确切时间。

字符串

优化建议

- 字符串的长度相差较大用VARCHAR;字符串短,且所有值都接近一个长度用CHAR。

- CHAR和VARCHAR适用于包括人名、邮政编码、电话号码和不超过255个字符长度的任意字母数字组合。那些 要用来计算的数字不要用VARCHAR类型保存,因为可能会导致一些与计算相关的问题。换句话说,可能影响到计 算的准确性和完整性。

886

886

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?