- 先配置好一个节点,剩下节点借助VMware中的克隆来进行复制就可以了。在安装ubuntu成功后,在terminal中执行:

sudo apt-get update

sudo apt-get install ssh

更新源,安装ssh.不然会遇到版本不一致,ssh localhost不成工等问题。 - 安装JDK,设置好环境变量JAVA_HOME ,Ubuntu环境变量有三种方式:

/etc/environment,/etc/profile,这两个文件相当于系统环境变量,但是系统先读取profile文件,再读取environment, 如果同一个变量在用户环境(/etc/profile)和系统环境(/etc/environment)有不同的值那应该是以用户环境为准了。第三种方式是~/.bashrc.这相当于用户环境变量。我的环境变量配置如下:

//我是在/etc/environment配置的

PATH="/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/home/hadoopmaster/Documents/jdk1.8.0_40/bin"

//设置后,在控制台执行source environment使其生效,然后执行java -version看看是否显示java版本信息。3.配置hadoop(在官网上下载hadoop解压到/home/hadoopmaster/Docments下)

修改配置文件:

//etc/hadoop/hadoop-env.sh

# set to the root of your Java installation

export JAVA_HOME=/home/hadoopmaster/Documents/jdk1.8.0_40/bin

# Assuming your installation directory is /usr/local/hadoop

export HADOOP_PREFIX=/home/hadoopmaster/Documents/hadoop-2.6.0//etc/hadoop/core-site.xml:

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoopmaster:9000</value>

</property>

</configuration>

//我的master的主机名是hadoopmaster//etc/hadoop/hdfs-site.xml:

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

</configuration>环境变量/etc/profile:

export HADOOP_HOME=/home/hadoopmaster/Documents/hadoop-2.6.0

export HADOOP_COMMON_HOME=$HADOOP_HOME

export HADOOP_HDFS_HOME=$HADOOP_HOME

export HADOOP_MAPRED_HOME=$HADOOP_HOME

export HADOOP_YARN_HOME=$HADOOP_HOME

export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib"

PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

export PATH4.这个时候就可以将虚拟机克隆了,我克隆了两份。

主机名****************IP************** 用户名

hadoopmaster 192.168.224.130 hadoopmaster

hadoopslave1 192.168.224.131 hadoopmaster

hadoopslave2 192.168.224.132 hadoopmaster

修改每个节点的主机名,在每个节点上的控制台执行:

$ sudo vim /etc/hostname

//修改自己想要的主机名

$ hostname

//可以查看是否修改成功然后修改每个节点的hosts文件

加入:

hadoopmaster 192.168.224.130

hadoopslave1 192.168.224.131

hadoopslave2 192.168.224.132

5.配置SSH。在每个节点执行

$ ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa

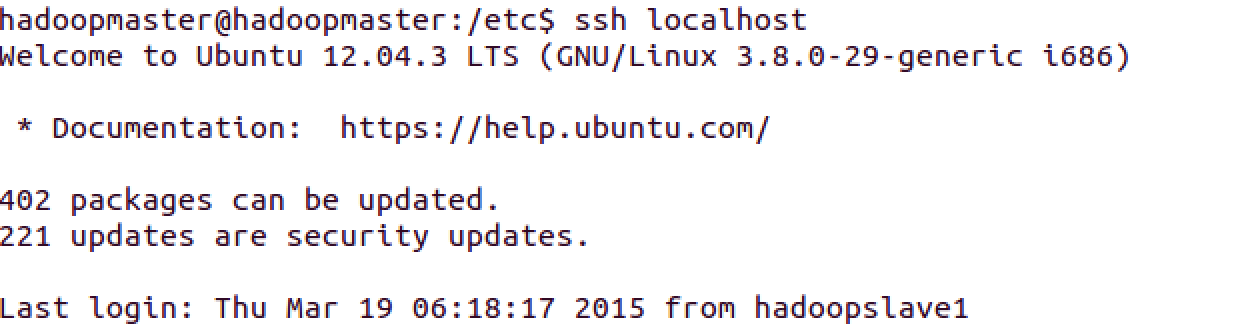

$ cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys在控制台输入ssh localhost不用输入密码则配置成功。

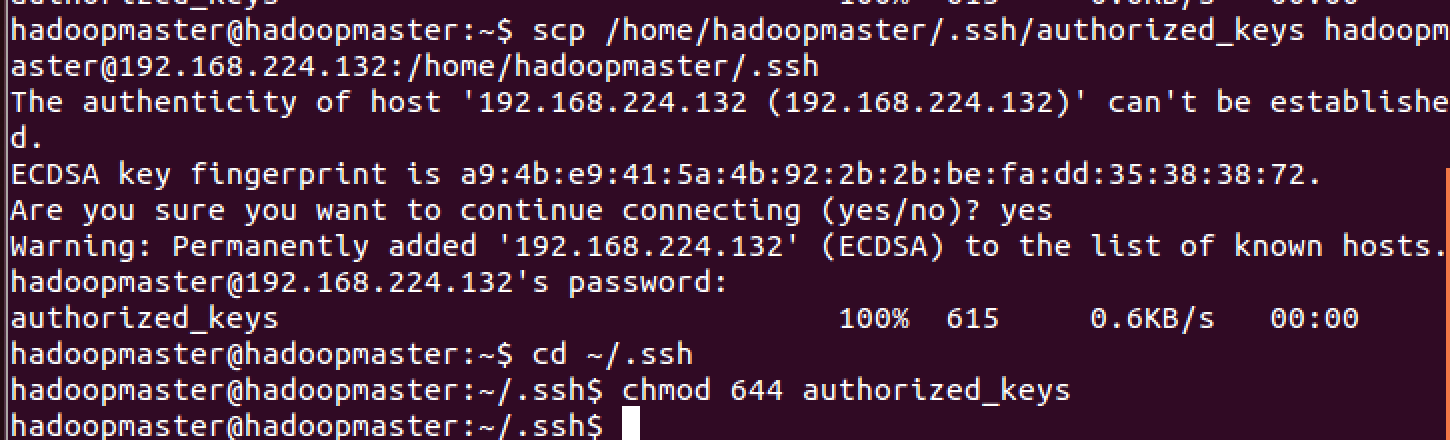

在hadoopmaster,也就是你想作为master的节点上把公钥追加到其他两个节点,然后修改~/.ssh文件夹的权限:

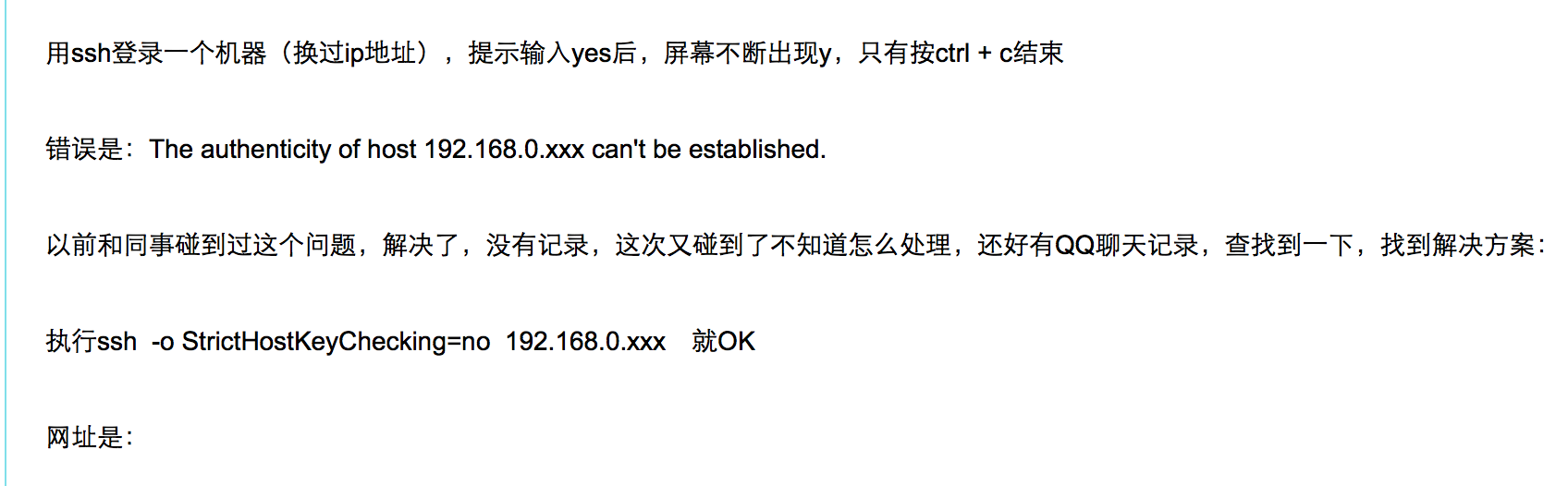

如果出现:The authenticity of host ‘192.168.+++,+++’ can`t be estabblished.解决方式如下:

6.修改hadoopmaster中$HADOOP_HOME/etc/hadoop/slaves文件,加入作为datenode节点的主机名:

hadoopmaster

hadoopslave1

hadoopslave2 7.然后在hadoopmaster的控制台执行:

Format the filesystem:

$ hdfs namenode -format

$ start-all.sh

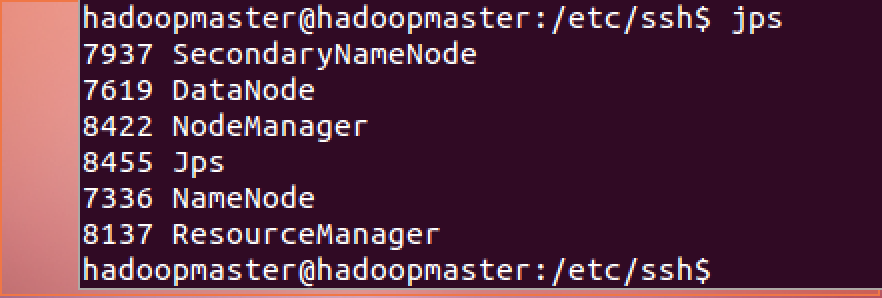

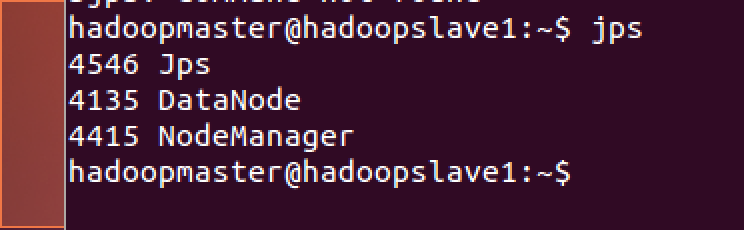

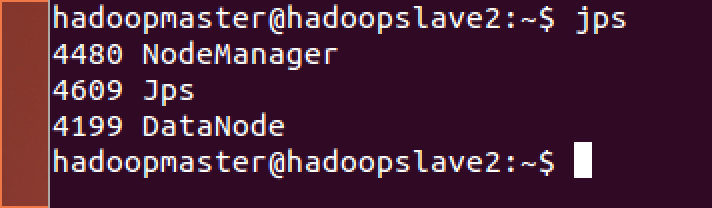

$ jps//查看进程结果如下:

563

563

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?