URL:http://kafka.apache.org/downloads

Version:kafka_2.10-0.8.2.1.tgz

Step 1:

到上面的URL,下载指定的Kafka版本

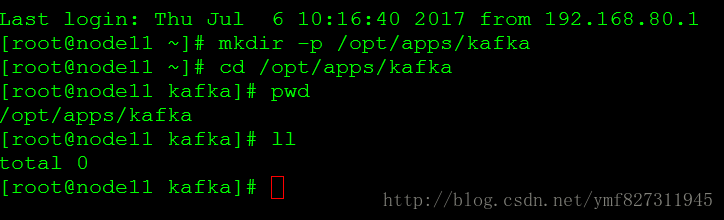

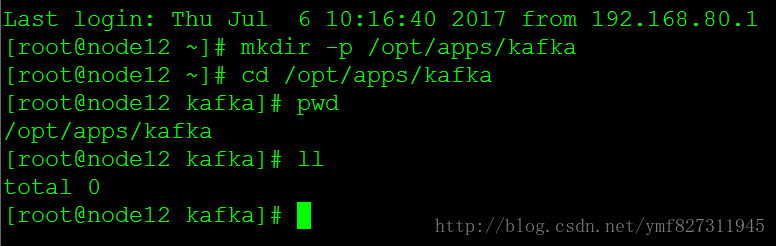

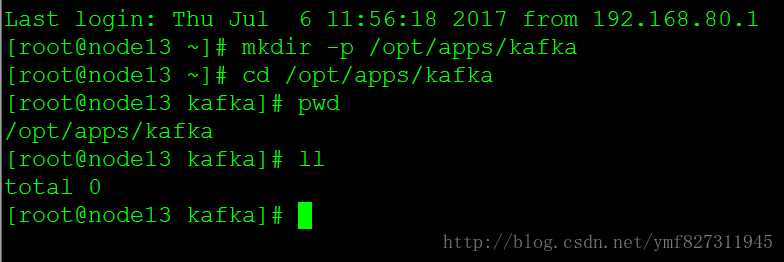

Step2:

在三个节点执行命令,建立特定的安装路径

mkdir -p /opt/apps/kafka

cd /opt/apps/kafka

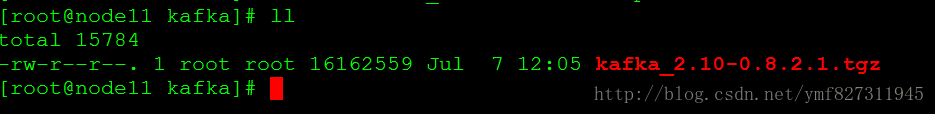

Step 3:

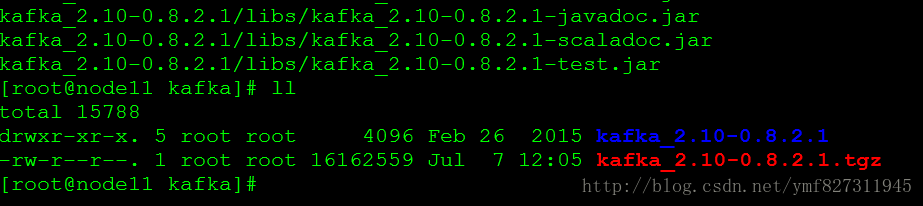

在node11中,使用xftp将下载的软件包上传到上面的路径中

Step 4:

在node11节点上执行命令,对安装包进行解压

tar -xvf /opt/apps/kafka/kafka_2.10-0.8.2.1.tgzStep 5:

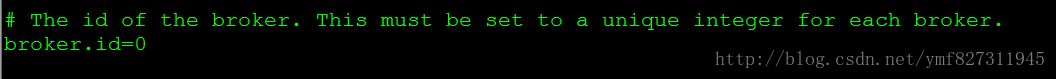

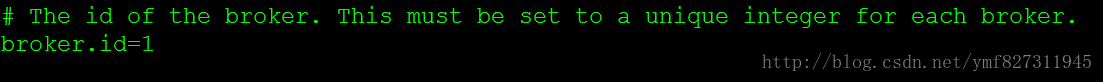

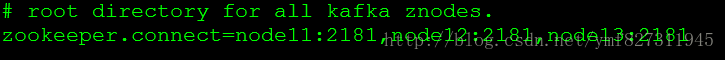

在node11节点上执行命令,对配置文件进行更改

vi /opt/apps/kafka/kafka_2.10-0.8.2.1/config/server.properties找到如下属性,进行配置

broker.id=0

zookeeper.connect=node11:2181,node12:2181,node13:2181

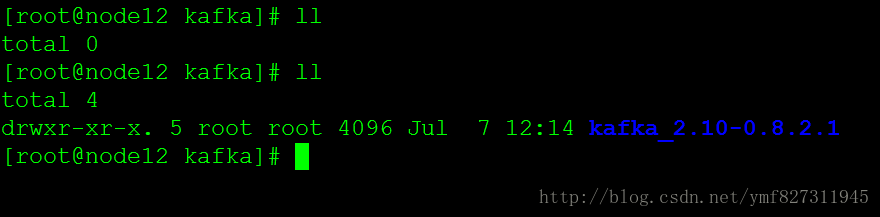

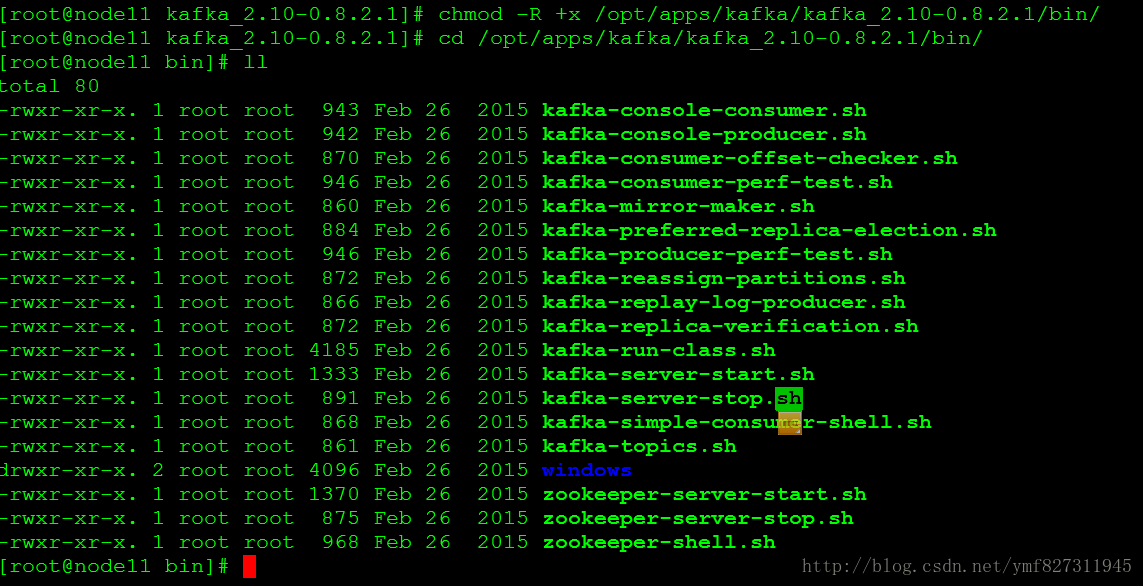

Step 6:

在node11节点上执行命令,对bin目录下的文件添加执行权限

chmod -R +x /opt/apps/kafka/kafka_2.10-0.8.2.1/bin/Step 7:

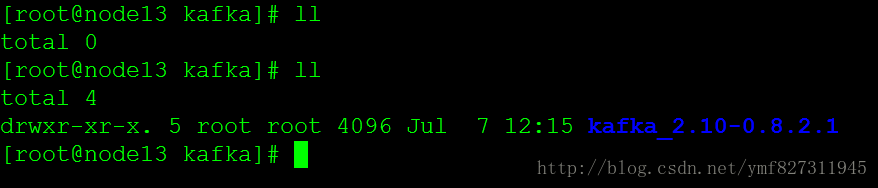

在node11节点上执行命令,将配置好的文件分发到node12和node13节点上

scp -r /opt/apps/kafka/kafka_2.10-0.8.2.1 node12:/opt/apps/kafka/

scp -r /opt/apps/kafka/kafka_2.10-0.8.2.1 node13:/opt/apps/kafka/

Step 8:

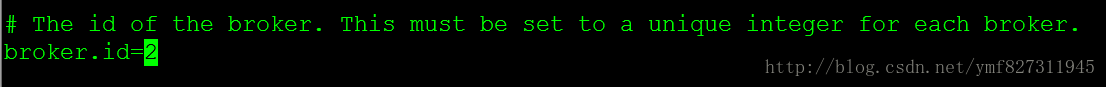

在node12和node13节点上分别执行命令,修改配置文件

vi /opt/apps/kafka/kafka_2.10-0.8.2.1/config/server.propertiesnode12 节点修改broker.id=1

node13 节点修改broker.id=2

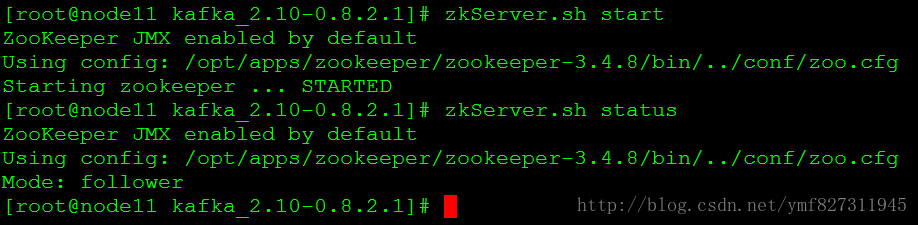

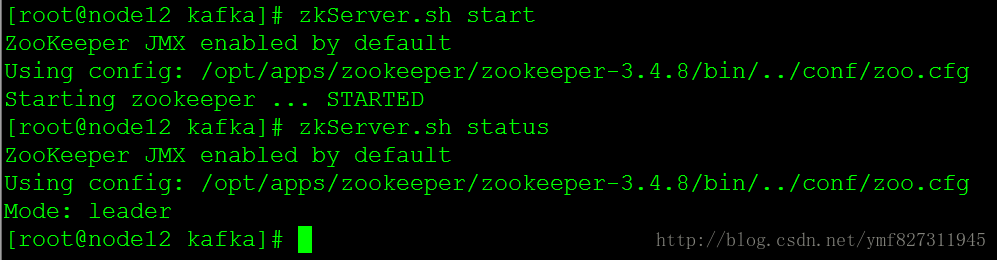

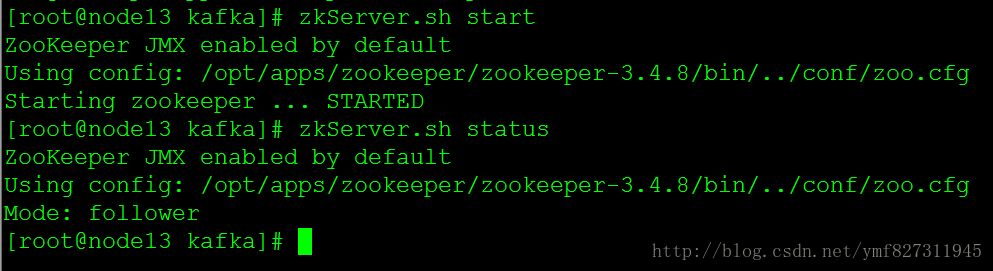

Step 9:

分别在三个节点上执行命令,启动zookeeper

zkServer.sh start

zkServer.sh status

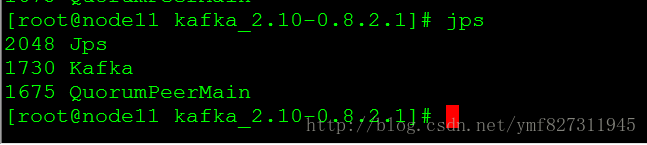

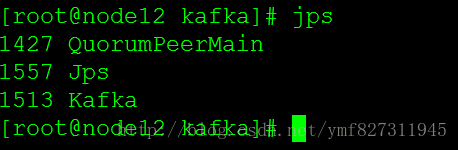

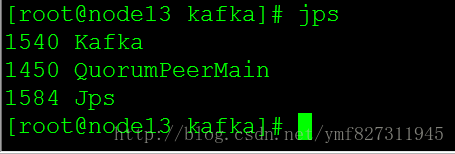

Step 10:

分别在三个节点上执行命令,启动Kafka集群

nohup /opt/apps/kafka/kafka_2.10-0.8.2.1/bin/kafka-server-start.sh /opt/apps/kafka/kafka_2.10-0.8.2.1/config/server.properties > kafka.log 2>&1 &

nohup /opt/apps/kafka/kafka_2.10-0.8.2.1/bin/kafka-server-start.sh /opt/apps/kafka/kafka_2.10-0.8.2.1/config/server.properties > kafka.log 2>&1 &

nohup /opt/apps/kafka/kafka_2.10-0.8.2.1/bin/kafka-server-start.sh /opt/apps/kafka/kafka_2.10-0.8.2.1/config/server.properties > kafka.log 2>&1 &

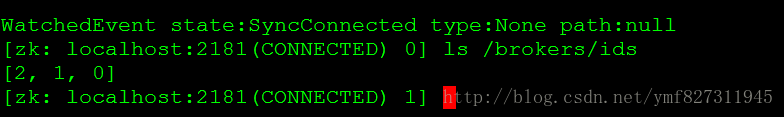

Step 11:

在node11节点执行命令,进入zookeeper客户端进行查看

zkCli.sh

ls /brokers/ids

quitStep 12:

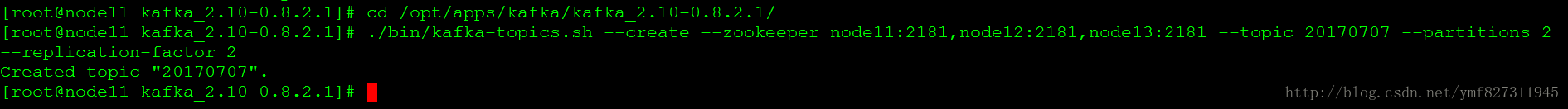

在node11节点上执行命令,建立Topic

cd /opt/apps/kafka/kafka_2.10-0.8.2.1/

./bin/kafka-topics.sh --create --zookeeper node11:2181,node12:2181,node13:2181 --topic 20170707 --partitions 2 --replication-factor 2Step 13:

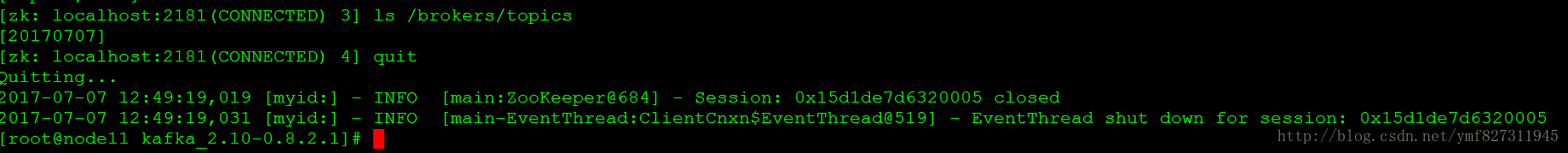

在node11节点上执行命令,进入zookeeper查看topic是否创建成功

zkCli.sh

ls /brokers/topics

quitStep 14:

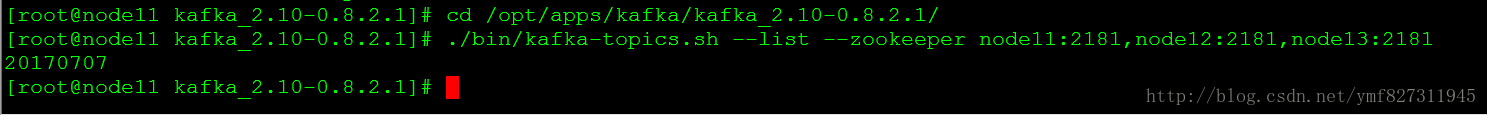

在node11节点上执行命令,列出Topic

cd /opt/apps/kafka/kafka_2.10-0.8.2.1/

./bin/kafka-topics.sh --list --zookeeper node11:2181,node12:2181,node13:2181Step 15:

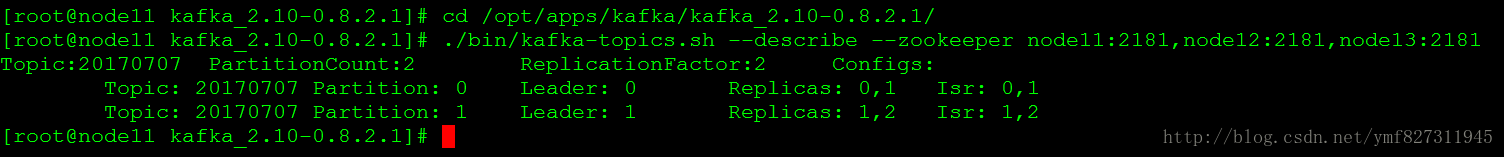

在node11节点上执行命令,查看topic的描述

cd /opt/apps/kafka/kafka_2.10-0.8.2.1/

./bin/kafka-topics.sh --describe --zookeeper node11:2181,node12:2181,node13:2181Step 16:

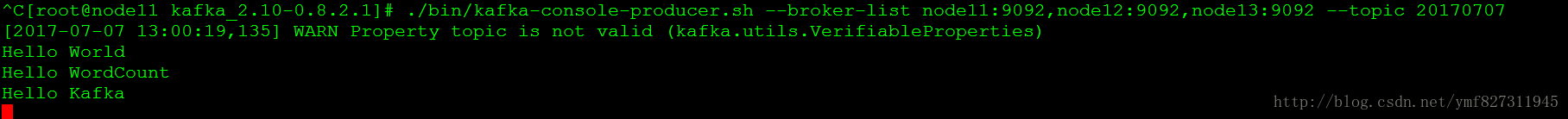

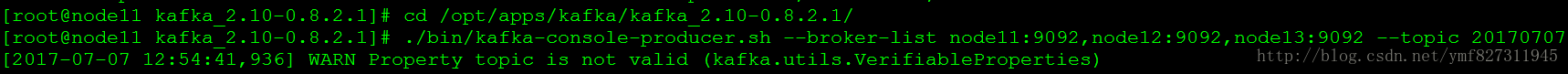

在node11节点上执行命令,对topic进行生产数据

cd /opt/apps/kafka/kafka_2.10-0.8.2.1/

./bin/kafka-console-producer.sh --broker-list node11:9092,node12:9092,node13:9092 --topic 20170707Step 17:

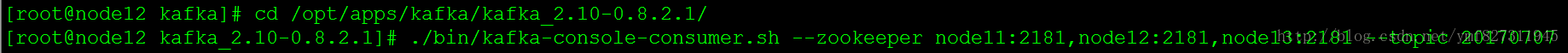

在node12节点执行命令,进行消费数据

cd /opt/apps/kafka/kafka_2.10-0.8.2.1/

./bin/kafka-console-consumer.sh --zookeeper node11:2181,node12:2181,node13:2181 --topic 20170707Step 18:

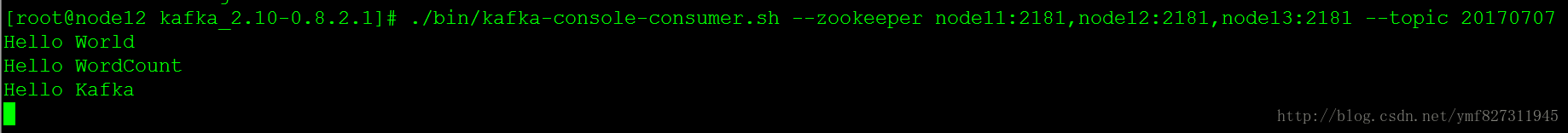

使用node11的生产者进行生产数据,使用node12的消费者进行消费数据,在node11节点上打开的窗口,输入数据

Hello World

Hello WordCount

Hello Kafkanode11生产者:

node12消费者:

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?