0. 论文简介

2024年5月,暨南大学深圳眼科医院 Xinyu Zhao, Zhenquan Wu、中山大学中山眼科中心 Shaobin Chen, Yue Sun 等在 Nature 子刊 scientific data 发表论文 “早产儿视网膜病变的眼底图像数据集(A fundus image dataset for intelligent retinopathy of prematurity system)”,公开了一个早产儿智能视网膜病变(ROP)数据集。

该数据集来自 483名婴儿,包括正常眼和病变眼的 1,099 张早产儿眼底图像。

论文下载: nature s41597-024-03362-5

引用格式:

Zhao, X., Chen, S., Zhang, S. et al. A fundus image dataset for intelligent retinopathy of prematurity system. Sci Data 11, 543 (2024). https://doi.org/10.1038/s41597-024-03362-5

数据集下载: figshare 25514449

1. 摘要

基于图像的人工智能系统是评估眼科疾病的主要方式。然而,目前可用的大多数人工智能系统都是依赖来源单一的单中心数据集,处于实验研究阶段,大多数都没有在现实世界的临床环境中得到应用。

在本项研究中,我们收集了1,099 张早产儿眼底图像数据集,用于早产儿智能视网膜病变(retinopathy of prematurity, ROP)系统的开发和验证。数据集来自483名婴儿,包括正常眼和病变眼,这是ROP上最大的眼底数据集之一。

通过空间散点图可视化,确保数据集的多样性。图像分类由3名专业人员独立就行分类标注。

2. 背景和结论

早产儿视网膜病变(ROP)是早产儿的一种视网膜血管疾病,是儿科人群失明的主要原因之一(1)。其严重程度分为五个阶段,从第1阶段(分界线)到第5阶段(完全视网膜脱离)。大多数ROP病例都是轻度的,可以自发消退,因此需要治疗的实际病例很少。然而,一旦确定需要治疗,应及时适当地进行干预,以防止视网膜脱离导致失明(2,3)。

眼底成像系统有可能准确有效地识别需要及时治疗的病例,因为眼底图像可用于客观、高灵敏度和特异性地记录疾病的严重程度和进展。因此,眼底成像系统最广泛地用于ROP筛查和深入分析(3)。

最近的研究强调了视网膜图像在评估疾病严重程度方面的重要性和适用性(4-8),这些研究实现了能够自动诊断和治疗ROP的人工智能系统。然而,这些研究大多难以达到现实应用标准,这表明仍需进一步研究。此外,如果使用多种族和多中心的眼底图像进行开发,人工智能模型的性能可以大大提高。因此,建立和发布 ROP 数据集对于开发和验证人工智能模型非常重要。

目前,有许多针对成年人的眼底图像公共数据集(9-15),但针对婴儿的数据集很少,这意味着适合开发和验证 ROP 人工智能模型的可用资源仍然很少。因此,一个婴儿眼底图像数据集有利于缩小临床场景中的差距。我们提供的数据集在新生儿医学图像分类任务方面具有相对较大的样本量。我们团队自 2003 年以来一直从事ROP诊断和治疗的临床工作,积累了丰富的临床数据。相关研究已发表在眼科杂志 (16~23)。自2018年以来,我们一直专注于视网膜疾病的人工智能系统,并取得了一些初步研究成果(7,24-26)。我们正致力于提高模型的鲁棒性,以实现临床应用。此外,我们希望ROP数据集的发布将对全球研究人员有用,以促进计算机辅助ROP诊断和治疗系统。

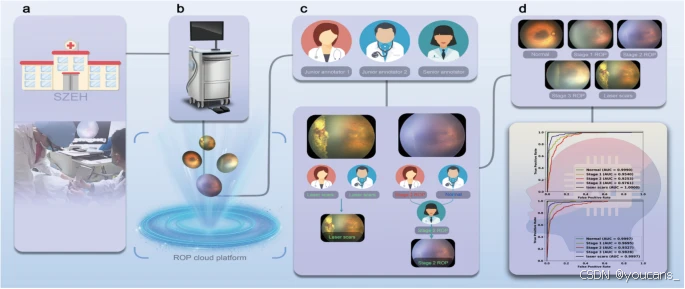

在本项研究中,我们提供了从第1阶段到第3阶段的大量眼底图像、正常图像和激光疤痕图像。本研究的简要说明如图1所示。我们希望这个数据集能够为开发具有临床应用能力的人工智能模型提供帮助。

人工智能有可能彻底改变未来早产儿的医疗行业。因此,我们将继续收集和发布相关的临床数据。

图1:建立ROP数据集的工作流程。(a) 医院和数据收集场景。(b) 使用成像工具共收集了1099张眼底图像,并上传到ROP云平台。(c) 三名完成了基于指南的训练和图像注释测试的注释者被纳入图像分类任务。注释过程包括两名初级注释者的初始注释和一名高级注释者的进一步验证。(d) 最终的分类结果用于开发用于自动ROP分期的AI模型。AI模型在AUC>0.9的情况下取得了出色的性能。

3. 方法

3.1 数据收集

2004年至2023年, 深圳眼科医院(SZEH)共收集了1099张眼底图像。在婴儿检查之前,婴儿的父母签署了数据使用同意书,以协助科学研究,所有相关图像都已匿名化,以保护隐私。本研究遵循了《赫尔辛基宣言》的原则,并获得了SZEH医学伦理委员会的批准(ID:2023KYPJ091)。

本研究中的图像使用 3 种宽视野接触眼底成像工具拍摄,包括 RetCam (RetCam, Clarity Medical Systems, USA)、ROP筛查系统 (SW-8000, China) 和 Nautilus 眼底成像系统 (RS-B002, China)。

拍摄图像的过程如下:在检查前约30分钟,用托吡卡胺(tropicamide )扩张婴儿的瞳孔。眼底摄影由受过训练的技术人员或眼科医生在几名助手的帮助下进行(3)。

标准的六向图像主要包括:视盘中央(optic disc central)、黄斑中央(macula central)、颞(temporal)、鼻(nasal)、上(superior)、下(inferior)。

我们主要排除了会导致病变描述不清的冗余和质量差的图像,导致病变描述不清。最后,我们纳入了视网膜、血管和病变清晰成像的图像。图像质量是我们图像选择过程中至关重要的评估标准。图像中结构和病变的清晰度是纳入的先决条件,包括视网膜、血管、激光疤痕、ROP病变等。对于正常图像,焦点在视网膜上;对于有病变的图像,病变部位的焦点更清晰。我们选择的图像的亮度在中等范围内,不包括太亮或太暗的图像,这些图像会使某些区域无法观察到。本研究中包含的所有图像的完整性通常被认为是临床可接受和可用的。

由于 ROP 的状况是渐进发展的,因此可能会对同一婴儿进行多次随访。此外,一些严重的ROP婴儿接受了激光治疗。因此,婴儿的同一只眼睛可能包含多张眼底图像。由于不同设备捕获的图像尺寸存在差异,我们采用了预处理技术。这涉及将图像均匀裁剪到512×512的分辨率,同时保持视网膜区域的纵横比。

3.1 数据分类

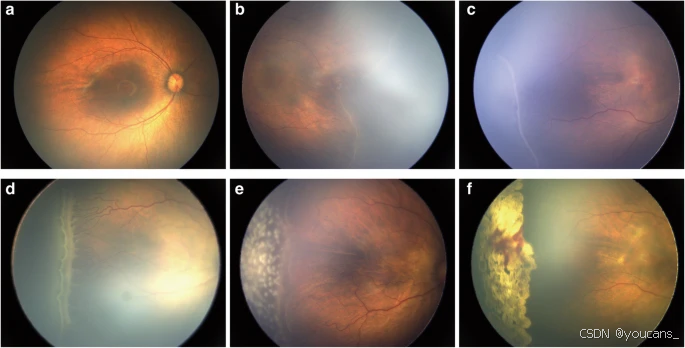

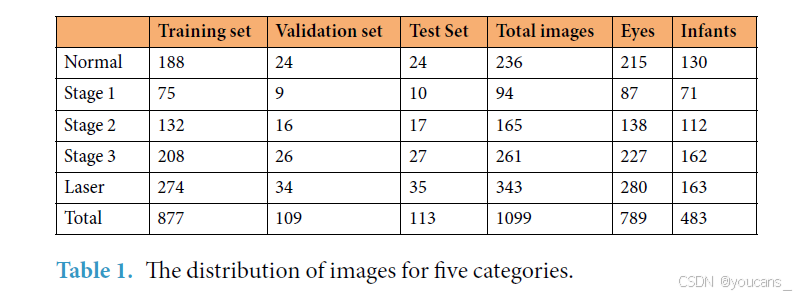

根据《国际早产儿视网膜病变分类 第三版(ICROP)》(27),所有 ROP 眼底图像分为5个阶段。其中,1期和 2期ROP代表轻度ROP病例,3期 ROP表示需要治疗的病例,4期和 5期 ROP则代表晚期ROP。临床上,医生应确定 ROP的严重程度,以采取不同的治疗策略。4期和5期 ROP在临床环境中很少见;因此,本研究仅纳入了 1 至 3期 ROP婴儿的图像(图2)。每个类别的图像分布如表1所示。

图2:各种眼底图像实例。(a)正常图像;(b)1 期 ROP;(c)2 期 ROP;(d)3 期 ROP;(e)带有新鲜激光疤痕的图像;以及(f)具有稳定激光疤痕的图像。

表1:5 类图像的分布。

来自 深圳眼科医院(SZEH) 的 3 位经验丰富的注释者将所有图像分为上述类别。具体来说,2 名初级注释者独立地对所有眼底图像进行了分类,在 2 名初级标注者存在差异的情况下,第 3 名资深的注释者对分类结果不一致的图像进行了重新分类。

我们对内部注释器和内部注释器之间的一致性评估进行了详细分析。同一数据集上两个初级注释者之间的 Cohen‘s Kappa 系数为0.856,表明两个注释者的分类结果之间存在高度共识。此外,我们还评估了同一数据集上不同时间点的两个注释器之间的一致性。同一数据集上不同时间点的两个注释器之间的 Cohen‘s Kappa 系数分别为 0.929和0.919,表明注释者在不同的时间点有很高的共识。因此,我们通过 Cohen‘s Kappa 系数评估了注释者之间和注释者之间的一致性,结果显示了高度的共识,这有助于我们进一步验证和提高数据的质量和准确性。值得注意的是,即使经过上述步骤,每张图像的分类结果也可能与世界各地不同眼科医生的分类结果不完全一致。即使所有眼科医生都使用相同的 ICROP 标准对眼底图像进行分类(27),不同的眼科医生也可能给出不同的分类结果。在对第 1 阶段和第 2 阶段 ROP 进行分类时,注释者的不一致性最为明显。

4. 数据记录

本数据集以压缩文件的形式存放在 Figshare 在线平台(28) 上。压缩文件夹主要包含:婴儿的眼底图像。

图像被命名为 “Normal, Stage 1 ROP, Stage 2 ROP, Stage 3 ROP, and Laser scars” ,其中 “Normal” 表示没有任何ROP疾病的图像,“Stage 1 to 3” 表示 1 至 3期 ROP 的图像,而 “Laser scars” 表示由于 ROP 而进行激光治疗后的激光疤痕图像。

我们的大部分数据由时间图像组成,其中一些包括视盘,而其他周围有病变的图像则不包括视盘。对于某些时间图像质量不足的婴儿,我们选择了具有后极或其他方向的图像。图像方向的最终选择取决于病变的位置和状况。

该数据集可用于不同的研究目的,例如自动识别ROP、定位和分割ROP中的无血管视网膜,以及验证几位研究人员开发的 ROP相关AI模型。目前的数据分类策略是由我们的团队使用 ICROP 标准进行的;因此,研究人员可以根据不同的研究目的使用和更改它。

ROP 数据集的详细描述如 表1 所示。

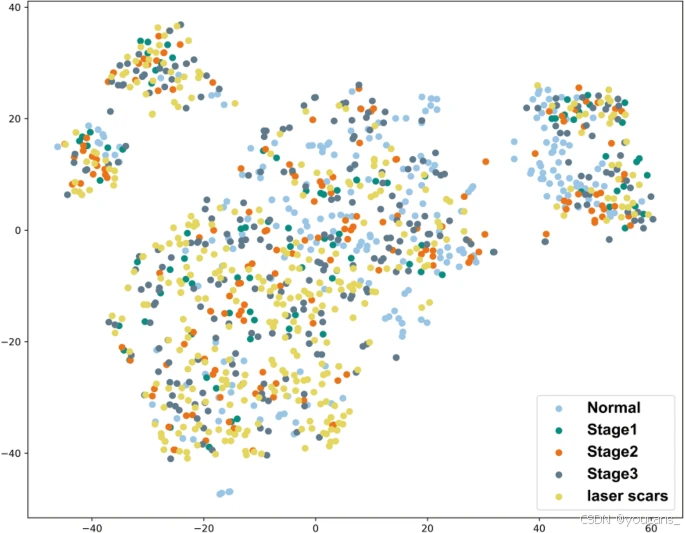

为了直观地观察数据集 5 个不同类别的分布特征,我们使用 t分布随机邻域嵌入(t-SNE)方法(29),该方法通过将高维图像特征中的每个数据点映射到二维空间中的一个位置,来可视化不同类别数据集的分布特征。降维的目的是在低维地图中尽可能多地保留高维数据的重要结构。作为可视化高维数据的工具,t-SNE 将图像特征数据点之间的相似性转换为联合概率,旨在最小化低维嵌入和高维数据联合概率之间的 Kullback-Leibler 散度,这可以将高维数据集转换为可以在散点图中显示的二维数据(29)。

我们首先使用 OpenCV读取每个图像数据,然后将每个图像的特征展平到一维向量空间中。将展平的图像特征输入到 t-SNE 中进行降维。T-SNE 可以捕获高维数据的大部分局部结构,也可以揭示全局结构。最后,每个图像特征将被转换为二维地图中的一个点。属于同一类别的图像所表示的点用相同的颜色表示,以获得 ROP 数据集的散点图,如图3所示。可视化图形中有 5 种符号,代表 5 个子集。

图3:ROP数据集的空间散点图。当呈现数据集中不同类别的分布时,使用t-SNE降维技术将高维图像数据映射到二维空间。这保留了原始数据的局部结构,确保相似样本在降维空间中保持接近。最后,通过散点图将映射的二维数据可视化。

5. 技术验证

本数据集中包含的 1099 张眼底图像来自 483名婴儿,其中 36.44%是女性。婴儿的出生体重为1247±432克,出生时的胎龄为29.10±2.62周。本研究中的所有婴儿都是亚洲人。数据集中包括每个眼底图像的相应标签。

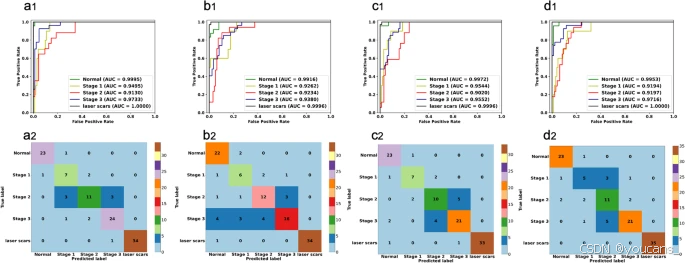

我们开发了 4 种自动 ROP 分期模型来自动识别这些眼底图像。

我们按照8:1:1的比例将数据集分为训练集、验证集和测试集。此外,我们采用了一些常见的数据增强策略,包括随机裁剪、随机水平和垂直翻转等。我们使用随机梯度下降来优化参数,学习率为1e-3,动量为0.9,权重衰减为1e-4。批量大小设置为64。

所有AI模型都在NVIDIA V100 GPU上实现。

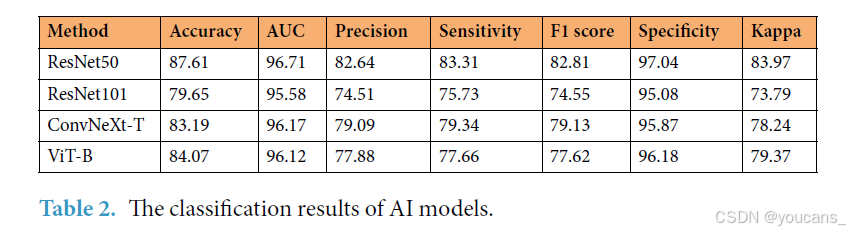

分类结果如表2所示。使用 ResNet50、ResNet101、ConvNeXt-T 和 ViT-B 作为 AI 模型训练的算法。如图4、表2 所示,使用测试数据集的测试结果表明,4种 AI模型在分类任务中都能取得优异的性能。其中,ResNet50 模型表现最佳。

这些结果表明 ROP 数据集的技术质量是有效的。

图4:不同 AI 模型的眼底图像分类结果。(a)-(d) 分别为 ResNet 50模型、ResNet101模型、ConvNeXt-T模型和ViT-B模型的性能。

表2:不同 AI 模型的分类结果

6. 使用说明

我们鼓励数据用户在任何相关报告中引用 figshare 记录和本文。

代码

在构建ROP数据集时没有使用新的代码。

收到日期:2023年12月13日

接受日期:2024年5月10日

出版日期:

7. 参考文献

- Stahl, A. et al. Effect of intravitreal aflibercept vs laser photocoagulation on treatment success of retinopathy of prematurity: The FIREFLEYE randomized clinical trial. Jama 328, 348–359, https://doi.org/10.1001/jama.2022.10564 (2022).

- Blencowe, H., Lawn, J. E., Vazquez, T., Fielder, A. & Gilbert, C. Preterm-associated visual impairment and estimates of retinopathy of prematurity at regional and global levels for 2010. Pediatr Res 74(Supp1), 35–49, https://doi.org/10.1038/pr.2013.205 (2013).

- Lin, J. Y. et al. Comparison of RetCam and smartphone-based photography for retinopathy of prematurity screening. Diagnostics (Basel) 12, https://doi.org/10.3390/diagnostics12040945 (2022).

- Campbell, J. P. et al. Evaluation of a deep learning-derived quantitative retinopathy of prematurity severity scale. Ophthalmology 128, 1070–1076, https://doi.org/10.1016/j.ophtha.2020.10.025 (2021).

- Campbell, J. P. et al. Artificial intelligence for retinopathy of prematurity: validation of a vascular severity scale against international expert diagnosis. Ophthalmology 129, e69–e76, https://doi.org/10.1016/j.ophtha.2022.02.008 (2022).

- Coyner, A. S. et al. Automated fundus image quality assessment in retinopathy of prematurity using deep convolutional neural networks. Ophthalmol Retina 3, 444–450, https://doi.org/10.1016/j.oret.2019.01.015 (2019).

- Xie, H. et al. Adversarial learning-based multi-level dense-transmission knowledge distillation for AP-ROP detection. Med Image Anal 84, 102725, https://doi.org/10.1016/j.media.2022.102725 (2023).

- McCourt, E. A. et al. Validation of the colorado retinopathy of prematurity screening model. JAMA Ophthalmol 136, 409–416, https://doi.org/10.1001/jamaophthalmol.2018.0376 (2018).

- Huang, X. et al. GRAPE: A multi-modal dataset of longitudinal follow-up visual field and fundus images for glaucoma management. Sci. Data. 10, 520, https://doi.org/10.1038/s41597-023-02424-4 (2023).

- Jin, K. et al. MSHF: A multi-source heterogeneous fundus (MSHF) dataset for image quality assessment. Sci. Data. 10, 286, https://doi.org/10.1038/s41597-023-02188-x (2023).

- Jin, K. et al. FIVES: A fundus image dataset for artificial intelligence based vessel segmentation. Sci. Data. 9, 475, https://doi.org/10.1038/s41597-022-01564-3 (2022).

- Kovalyk, O. et al. PAPILA: Dataset with fundus images and clinical data of both eyes of the same patient for glaucoma assessment. Sci. Data. 9, 291, https://doi.org/10.1038/s41597-022-01388-1 (2022).

- Kumar, J. R. H. et al. Chákṣu: A glaucoma specific fundus image database. Sci. Data. 10, 70, https://doi.org/10.1038/s41597-023-01943-4 (2023).

- Kumar, J. R. H. et al. Author aorrection: Chákṣu: A glaucoma specific fundus image database. Sci. Data. 10, 190, https://doi.org/10.1038/s41597-023-02084-4 (2023).

- Lin, L. et al. The SUSTech-SYSU dataset for automated exudate detection and diabetic retinopathy grading. Sci. Data. 7, 409, https://doi.org/10.1038/s41597-020-00755-0 (2020).

- Hu, X. et al. Glim-net: chronic glaucoma forecast transformer for irregularly sampled sequential fundus images. IEEE Transactions on Medical Imaging, 1875-1884 (2023).

- Wu, Z. et al. Comparison of clinical outcomes of conbercept versus ranibizumab treatment for retinopathy of prematurity: a multicentral prospective randomised controlled trial. Br J Ophthalmol 106, 975–979, https://doi.org/10.1136/bjophthalmol-2020-318026 (2022).

- Zhao, J. et al. Comparison of OCT angiography in children with a history of intravitreal injection of ranibizumab versus laser photocoagulation for retinopathy of prematurity. Br J Ophthalmol 104, 1556–1560, https://doi.org/10.1136/bjophthalmol-2019-315520 (2020).

- Hu, Y. et al. Refractive status and biometric characteristics of children with familial exudative vitreoretinopathy. Invest Ophthalmol Vis Sci 64, 27, https://doi.org/10.1167/iovs.64.13.27 (2023).

- Fan, Z. et al. Awareness, prevalence, and knowledge of dry eye among Internet professionals: a cross-sectional study in China. Eye Contact Lens 49, 92–97, https://doi.org/10.1097/icl.0000000000000968 (2023).

- Lu, X. et al. Refractive and biometrical characteristics of children with retinopathy of prematurity who received laser photocoagulation or intravitreal ranibizumab injection. Graefes Arch Clin Exp Ophthalmol 260, 3213–3219, https://doi.org/10.1007/s00417-022-05663-0 (2022).

- Yang, Y. et al. Targeted blood metabolomic study on retinopathy of prematurity. Invest Ophthalmol Vis Sci 61, 12, https://doi.org/10.1167/iovs.61.2.12 (2020).

- Yang, Y. et al. Comparative analysis reveals novel changes in plasma metabolites and metabolomic networks of infants with retinopathy of prematurity. Invest Ophthalmol Vis Sci 63, 28, https://doi.org/10.1167/iovs.63.1.28 (2022).

- Zhang, Y. et al. Development of an automated screening system for retinopathy of prematurity using a deep neural network for wide-angle retinal images. IEEE Access (2018).

- R Zhang et al. Automatic diagnosis for aggressive posterior petinopathy of prematurity via deep attentive convolutional neural network. Expert Systems with Applications (2021).

- Zhao J, Lei, B., Wu, Z., Zhang, Y. & Zhang, G. A deep learning framework for identifying Zone I in RetCam images. IEEE Access PP, 1-1 (2019).

- Chiang, M. F. et al. International classification of retinopathy of prematurity, third edition. Ophthalmology 128, e51–e68, https://doi.org/10.1016/j.ophtha.2021.05.031 (2021).

- Zhao, X. C. et al. A fundus image dataset for intelligent retinopathy of prematurity system. figshare https://doi.org/10.6084/m9.figshare.25514449 (2024).

- Van der Maaten, L. & Hinton, G. Visualizing data using t-SNE. Journal of machine learning research 9, 2579–2605 (2008).

- He, K. M., Zhang, X. Y., Ren, S. Q., Sun, J. & Ieee. in 2016 IEEE CONFERENCE ON COMPUTER VISION AND PATTERN RECOGNITION (CVPR). 770-778 (IEEE Comp Soc, 2016).

- He, K., Zhang, X., Ren, S. & Sun, J. in Proceedings of the IEEE conference on computer vision and pattern recognition. 770-778.

- Liu, Z. et al. in 2022 IEEE/CVF CONFERENCE ON COMPUTER VISION AND PATTERN RECOGNITION (CVPR). 11966-11976 (IEEE COMPUTER SOC, 2022).

- Dosovitskiy, A. et al. An image is worth 16x16 words: Transformers for image recognition at scale. arXiv preprint arXiv:2010.11929 (2020).

版权说明:

本文由 youcans@xidian 对论文 A fundus image dataset for intelligent retinopathy of prematurity system 进行摘编和翻译。该论文版权属于原文期刊和作者,本译文只供研究学习使用。

youcans@xidian 作品,转载必须标注原文链接:

【医学影像 AI】早产儿视网膜病变的眼底图像数据集 (https://youcans.blog.csdn.net/article/details/145620591)

Crated:2025-02

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?