ChatGLM3 是智谱AI和清华大学 KEG 实验室联合发布的对话预训练模型。ChatGLM3-6B 是 ChatGLM3 系列中的第三代开源模型,对话流畅、部署门槛低,测评显示其基础模型ChatGLM3-6B-Base 具有在 10B 以下的基础模型中最强的性能,同时支持工具调用(Function Call)、代码执行(Code Interpreter)和Agent任务等复杂场景。

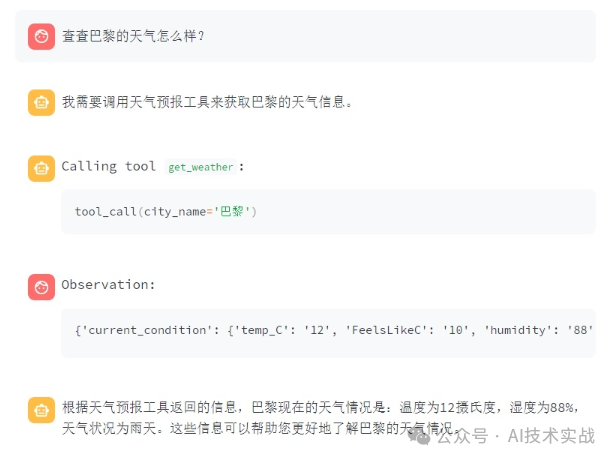

function call效果:

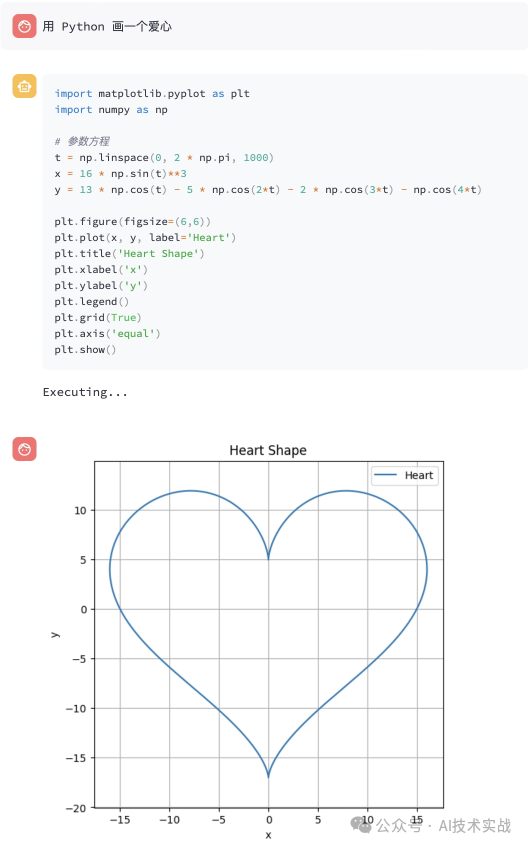

code interpreter效果:

github地址在文末,推理需要大约14G显存,本文基于ubuntu系统部署,windows系统类似。

1. 下载模型

下载模型需要用到git的LFS扩展,windows系统在https://git-lfs.com下载LFS,下面是ubuntu系统安装LFS的方式,其他linux系统可以参考文档https://github.com/git-lfs/git-lfs/blob/main/INSTALLING.md

curl -s https://packagecloud.io/install/repositories/github/git-lfs/script.deb.sh | sudo bashapt-get install git-lfsgit lfs install

安装好LFS后就可以下载了,huggingface比较慢,可以在魔搭社区下载

https://modelscope.cn/models/ZhipuAI/chatglm3-6b/summary

执行以下命令,等待下载完成,总共24G。

git clone https://www.modelscope.cn/ZhipuAI/chatglm3-6b.git

2.安装部署

本文介绍两种部署方式,一种是使用上一篇介绍的[25.7k star! 用langchain-chatchat部署私有化RAG知识库],另一种是使用ChatGLM官方项目部署。

2.1 在langchain-chatchat中使用

在上一篇文章中,我们使用docker部署了langchain-chatchat,但是默认模型是chatglm2-6b,现在只需要将模型修改为chatglm3-6b就可以了,将下载好的chatglm3-6b拷贝到docker容器的根目录下:

docker cp chatglm3-6b 你的容器名称:/

chatchat在容器的/langchain-chatchat目录,进入容器,再进入configs目录:

docker exec -it 你的容器名称 /bin/bash``cd /langchain-chatchat/configs

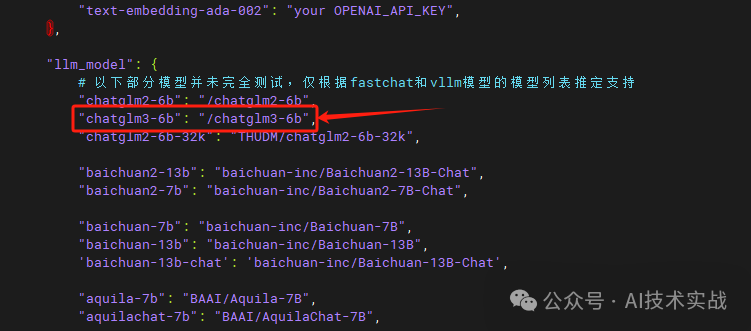

编辑model_config.py文件,在llm_model中增加chatglm3-6b,如图所示:

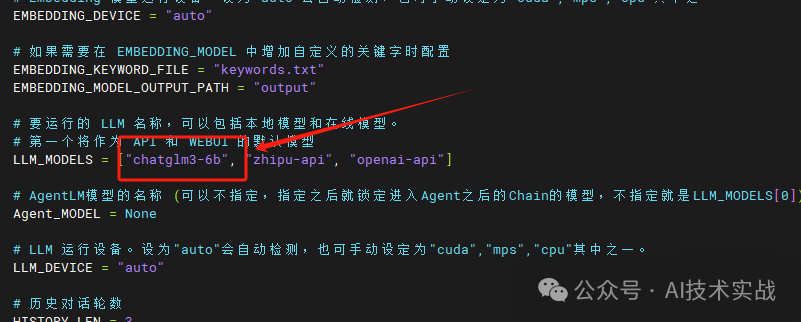

将LLM_MODELS中的chatglm2-6b修改为chatglm3-6b,如图所示:

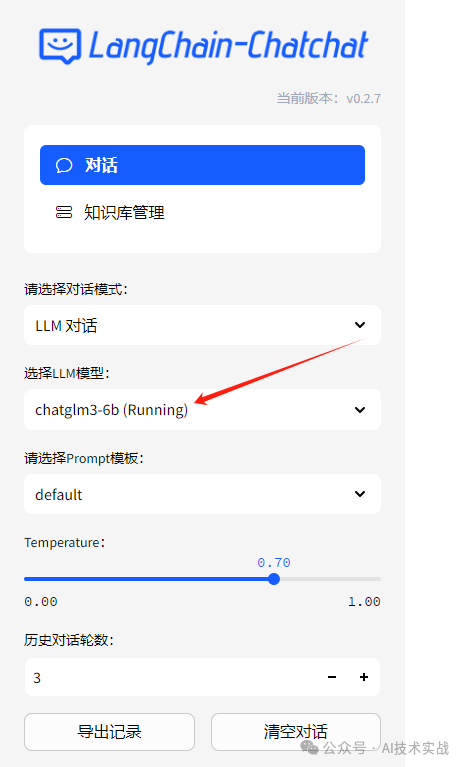

修改后重启容器,再打开,这里就变成chatglm3-6b了。

2.2 使用ChatGLM官方项目部署

如果没有部署chatchat,也可以使用ChatGLM官方项目部署。

使用git下载ChatGLM源码

git clone git@github.com:THUDM/ChatGLM3.git

进入ChatGLM3源码目录,使用清华镜像安装依赖:

cd ChatGLM3-main``pip install -i https://pypi.tuna.tsinghua.edu.cn/simple -r requirements.txt

3. 运行

如果使用chatchat项目部署,直接在页面上选择chatglm3-6b就可以聊天了。下面是使用ChatGLM3项目部署的用法。

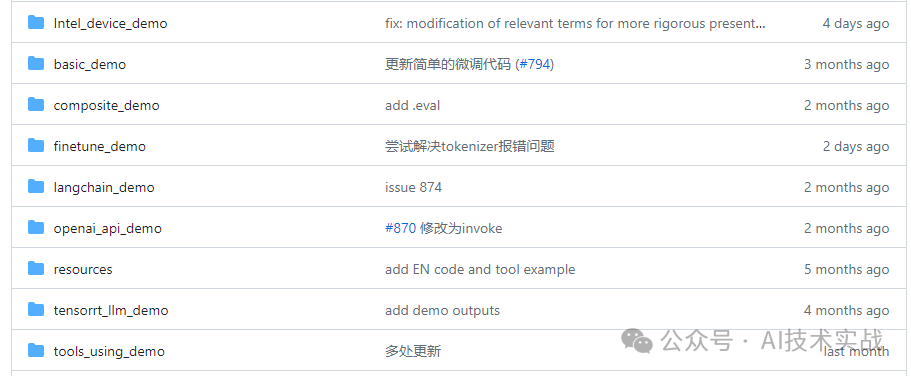

ChatGLM3项目提供了多个demo,进入相应demo目录下,修改模型路径运行就可以,下面以gradio网页demo举例说明,其他同理。

进入basic_demo目录

cd basic_demo

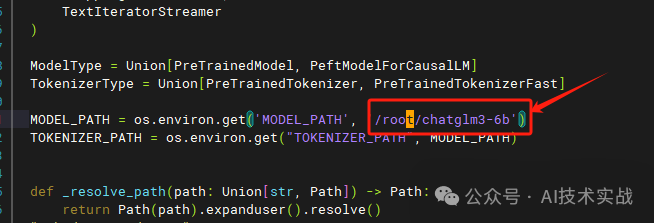

修改web_demo_gradio.py,将MODEL_PATH的值改为第一步下载好的模型路径:

运行

python3 web_demo_gradio.py

在浏览器打开http://localhost:7870就可以聊天了

4. 无缝替换openAI

ChatGLM提供了openai标准的API,通过这个API我们可以将任何接入openai的应用无缝切换为私有化部署的ChatGLM3。

cd openai_api_demo

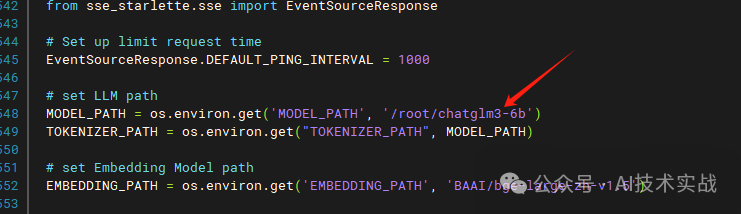

修改api_server.py,将MODEL_PATH的值改为第一步下载好的模型路径:

后台运行:

nohup python3 api_server.py &

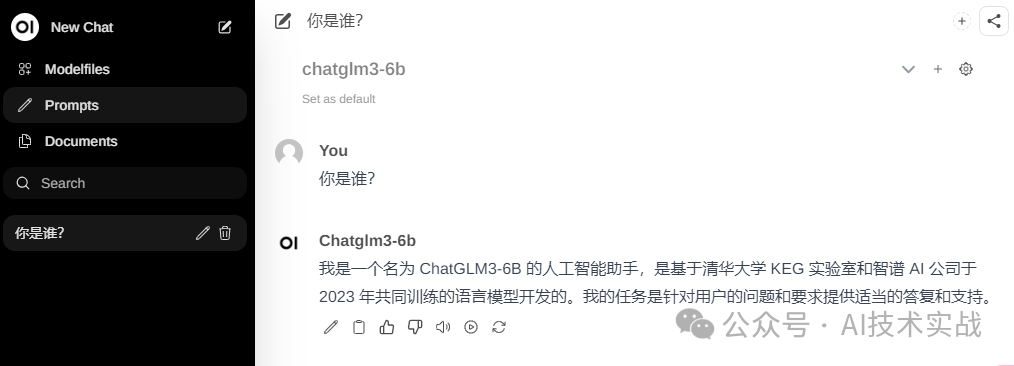

这样就启动了openai接口的服务,可以把私有化部署的ChatGLM3当openai用了,比如之前文章中247.2k star! 超强大的私有化ChatGPT,支持图像识别/文生图/语音输入/文本朗读,个人电脑可运行!有接入openai的功能,现在我们可以把配置的openai的地址改为本地,从而将open-webui接入ChatGLM3:

其他像各种基于openai的插件、应用等,只要可以配置url,都可以无缝切换为ChatGLM3。

那么,如何系统的去学习大模型LLM?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

所有资料 ⚡️ ,朋友们如果有需要全套 《LLM大模型入门+进阶学习资源包》,扫码获取~

篇幅有限,部分资料如下:

👉LLM大模型学习指南+路线汇总👈

💥大模型入门要点,扫盲必看!

💥既然要系统的学习大模型,那么学习路线是必不可少的,这份路线能帮助你快速梳理知识,形成自己的体系。

👉大模型入门实战训练👈

💥光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉国内企业大模型落地应用案例👈

💥《中国大模型落地应用案例集》 收录了52个优秀的大模型落地应用案例,这些案例覆盖了金融、医疗、教育、交通、制造等众多领域,无论是对于大模型技术的研究者,还是对于希望了解大模型技术在实际业务中如何应用的业内人士,都具有很高的参考价值。 (文末领取)

💥《2024大模型行业应用十大典范案例集》 汇集了文化、医药、IT、钢铁、航空、企业服务等行业在大模型应用领域的典范案例。

👉LLM大模型学习视频👈

💥观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。 (文末领取)

👉640份大模型行业报告👈

💥包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

👉获取方式:

这份完整版的大模型 LLM 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

😝有需要的小伙伴,可以Vx扫描下方二维码免费领取🆓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?