【背景说明】

我hive能正常启动,建表没问题,我建了一个student表,没问题,但执行了下面一条insert语句后报如下错误:

hive (default)> insert into table student values(1,'abc');

Query ID = atguigu_20240417184003_f9d459d7-1993-487f-8d5f-eafdb48d94c1

Total jobs = 1

Launching Job 1 out of 1

In order to change the average load for a reducer (in bytes):

set hive.exec.reducers.bytes.per.reducer=<number>

In order to limit the maximum number of reducers:

set hive.exec.reducers.max=<number>

In order to set a constant number of reducers:

set mapreduce.job.reduces=<number>

Failed to monitor Job[-1] with exception 'java.lang.IllegalStateException(Connection to remote Spark driver was lost)' Last known state = SENT

Failed to execute spark task, with exception 'java.lang.IllegalStateException(RPC channel is closed.)'

FAILED: Execution Error, return code 1 from org.apache.hadoop.hive.ql.exec.spark.SparkTask. RPC channel is closed.

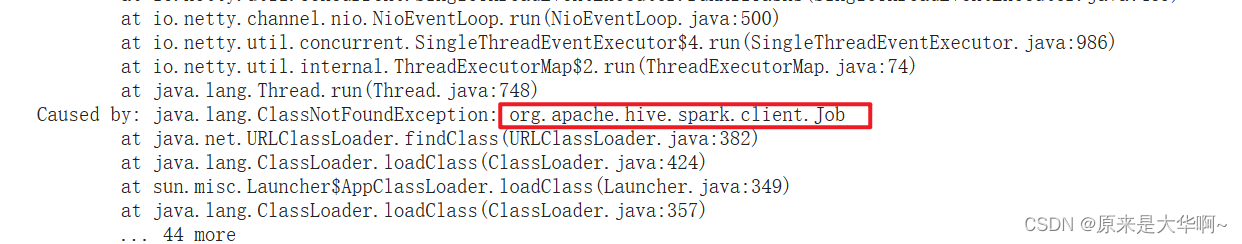

因为我是yarn跑的,所以去yarn看报错日志。

yarn报错日志如下:

它说是这个类找不到?!

它说是这个类找不到?!

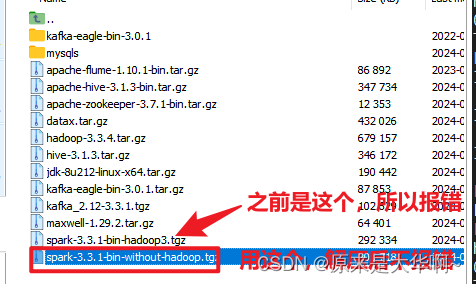

【原因及解决】:其实就是我spark的包弄错了,应该是用纯净版的spark包。重新解压到module目录下,其他操作和spark原来的都一样。

6399

6399

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?