爬虫是一种自动获取网站信息的技术,它可以帮助我们快速地抓取海量网站数据,进行统计分析、挖掘和展示。本文旨在为初学者详细介绍爬虫的基础知识,包括:爬虫原理、爬虫分类、网页结构分析、爬虫工具和技能、爬虫实践示范,以及如何绕过反爬虫机制等内容,让你轻松入门、快速提升。

一、爬虫原理

爬虫的实现原理其实很简单,就是模拟浏览器发送请求、获取响应、解析HTML代码、保存数据的过程。具体来说,可以分为以下几个步骤:

1.发送请求

我们在浏览器里输入网址访问网页时,其实就是在向服务器发送一条请求。在爬虫中,我们也需要发送类似的请求,只不过不是手动输入网址,而是通过编写代码实现。请求可以包含各种参数,比如GET请求和POST请求的区别就在于参数的传递方式不同。

import requests

response = requests.get('http://www.example.com')

print(response.status_code) # 打印响应状态码

2.获取响应

发送完请求之后,服务器会返回一个HTML文档,里面包含了很多数据。在爬虫中,我们需要获取这个响应,并对其进行解析。

import requests

response = requests.get('http://www.example.com')

html = response.text # 获取响应内容

print(html)

3.解析HTML

HTML文档中包含了很多标签和属性,我们需要用代码把它们提取出来,才能得到我们需要的数据。常用的HTML解析库有BeautifulSoup、lxml等。

from bs4 import BeautifulSoup

html = '''

Hello

'''

soup = BeautifulSoup(html, 'lxml')

print(soup.h1.string) # 获取h1标签中的文本

4.保存数据

解析好HTML之后,我们就可以提取出所需要的数据了。一般情况下,可以把数据保存到文件或数据库中,以备后续使用。

import csv

data = [['name', 'age'], ['Tom', '18'], ['Jerry', '19']]

with open('data.csv', 'w', encoding='utf-8', newline='') as f:

writer = csv.writer(f)

for row in data:

writer.writerow(row)

以上就是一个最基本的爬虫流程,当然还有很多细节需要注意,下面我们会详细讨论。

二、爬虫分类

按照数据获取的目的,爬虫可以分为三种类型:通用型爬虫、聚焦型爬虫和增量型爬虫。

1.通用型爬虫

通用型爬虫是一种无差别抓取所有信息的爬虫,它可以从互联网上抓取尽可能多的信息,并将其存储到互联网的大型数据库中,以供其他人使用。例如,百度、Google等搜索引擎就是使用通用型爬虫实现的。

2.聚焦型爬虫

聚焦型爬虫是一种针对某个特定主题的爬虫,它只抓取与该主题相关的信息,并进行整理和归类。例如,时事新闻类网站就是使用聚焦型爬虫实现的。

3.增量型爬虫

增量型爬虫是一种具有记忆能力的爬虫,它可以对已经抓取过的网页进行更新检查,只抓取新的或更新的信息,减少重复抓取和数据处理的时间和资源消耗。例如,新闻类网站中的“今日头条”栏目就是使用增量型爬虫实现的。

除此之外,爬虫还可以按照结构、数据源、爬取频率等进行分类。例如,结构上可以分为静态爬虫和动态爬虫,数据源上可以分为单站点爬虫和分布式爬虫,爬取频率上可以分为一次性爬虫和定期更新爬虫等。

三、网页结构分析

在进行爬虫前,我们需要对要爬取的网页进行结构分析,以确定数据的位置和提取方法。一般来说,网页结构可以通过浏览器的开发者工具进行查看。

1.网页基础结构

一个网页的基础结构由HTML、CSS和JavaScript三部分组成,其中HTML负责网页内容的架构,CSS负责网页样式的设计,JavaScript则可以用来实现网页上的动态交互和事件响应。

2.网页元素定位

在爬虫中,我们需要对网页上的某个元素进行定位,以抽取其中的内容。常用的网页元素包括标签、属性、class、id等,可以通过浏览器的开发者工具进行查看和定位。

XPath和CSS Selector

XPath和CSS Selector是两种常用的网页元素查找语言,它们可以指定网页元素的路径或规则,以便进行定位和抽取。例如,XPath可以通过“//标签名[@属性名=’属性值’]”的方式来定位元素,CSS Selector则可以通过“标签名.类名#id名”等方式来定位元素。

JavaScript渲染问题

有些网站使用JavaScript进行局部刷新和动态渲染,此时需要注意爬虫要能够执行JavaScript才能抓取到完整的页面内容。可以使用Selenium等工具来模拟浏览器行为,或者对网页进行网络捕捉和分析以获取完整的响应数据。

四、爬虫工具和技能

在开发爬虫时,我们需要掌握一些常用的工具和技能来提高效率和质量。

1.Python编程语言

Python是爬虫开发中常用的编程语言之一,它具有简洁易读、高效快速、丰富的第三方库等优点,非常适合进行数据处理和科学计算。

2.Beautiful Soup库

Beautiful Soup是Python中的一个HTML解析库,它可以方便地处理HTML标签和属性,支持XPath和CSS Selector等常用的查找方式,提供了灵活易用的API。

3.Scrapy框架

Scrapy是Python中的一个爬虫框架,它提供了完整的爬虫流程和分布式架构,并支持编写爬虫中间件和管道,方便数据的处理和保存。

4.防火墙代理

有些网站可能会对爬虫进行限制或封禁,此时可以使用防火墙代理来隐藏真实IP地址,以免被封禁。

5.数据库操作

爬虫获取到的数据可以保存到各种关系型或非关系型数据库中,常用的有MySQL、MongoDB等,需要掌握相应的数据库操作技能。

6.Requests库

Requests是Python中的一个HTTP库,它非常方便地实现HTTP请求和响应的处理,可以进行GET、POST、Cookie、Session等操作。

五、爬虫实践示范

下面是一个简单的爬虫示例,用于抓取中国地震台网上的近期地震信息,并存储到CSV文件中。

import requests

import csv

from bs4 import BeautifulSoup

url = 'http://www.ceic.ac.cn/ajax/search?page=1'

data = {

'start': '2018-01-01 00:00:00',

'end': '2021-1 1-01 23:59:59',

'location': '',

'minmag': '',

'maxmag': '',

'mindepth': '',

'maxdepth': '',

'eventType': '地震',

'searchType': 'advanced',

'pageSize': '10000',

}

response = requests.post(url, data=data)

html = response.text

soup = BeautifulSoup(html, 'lxml')

table = soup.find('table', class_='newlist')

rows = table.find_all('tr')

data = [['time', 'latitude', 'longitude', 'depth', 'magnitude', 'location']]

for row in rows[1:]:

cols = row.find_all('td')

time = cols[1].text

latitude = cols[4].text

longitude = cols[5].text

depth = cols[6].text

magnitude = cols[7].text

location = cols[10].text

data.append([time, latitude, longitude, depth, magnitude, location])

with open('earthquakes.csv', 'w', encoding='utf-8', newline='') as f:

writer = csv.writer(f)

for row in data:

writer.writerow(row)

运行这段代码后,即可得到一个earthquakes.csv文件,里面包含了中国地震台网上从2018年到2021年11月的所有地震信息。

六、绕过反爬虫机制

有些网站为了防止爬虫的访问,可能会设置反爬虫机制,例如限制访问频率、验证码认证、Cookie认证等。在爬虫开发中,我们需要采取一些措施来绕过这些限制。

- 伪装请求头

有些网站会根据请求头中的参数来判断访问者是否为爬虫,此时我们可以通过设置伪装请求头来隐藏自己的身份。例如,可以修改User-Agent参数、Referer参数、Cookie参数等。

import requests

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3',

}

response = requests.get('http://www.example.com', headers=headers)

print(response.text)

- 使用代理IP

有些网站会根据IP地址来判断访问者是否为爬虫,此时我们可以使用代理IP来隐藏真实IP地址。例如,可以使用网上购买的代理IP、TOR网络、Shadowsocks等。

import requests

proxies = {

'http': 'http://username:password@ip:port',

'https': 'https://username:password@ip:port',

}

response = requests.get('http://www.example.com', proxies=proxies)

print(response.text)

- 解析验证码

有些网站会设置验证码来防止爬虫的访问,此时我们可以编写脚本来解析验证码,并进行自动化识别和提交。

- 分布式爬虫

在一些大的爬虫任务中,单机爬虫往往会面临访问频率限制和性能瓶颈等问题。此时,可以考虑使用分布式爬虫来解决这些问题。

分布式爬虫是一种将爬虫任务分配给多个节点(通常是多台机器)进行并行处理的方式。不同节点之间可以通过网络连接进行通信和数据传输,从而实现爬虫任务的加速和效率提升。

常用的分布式爬虫框架包括Scrapy-Redis、Distributed Spider等,可以配置多个爬虫节点、任务调度器、队列管理器等组件,实现高效的爬虫任务处理。此外,还需要注意分布式环境下的数据一致性、节点故障处理等问题。

七、爬虫伦理问题

在进行爬虫开发时,需要考虑一些伦理和法律问题。爬虫的滥用可能会对网站造成损害,甚至可能触犯法律。以下是一些爬虫应遵守的基本规范。

- 遵守网站协议和规定

在爬取一个网站时,爬虫应遵守该网站的协议和规定,如不得以过度频繁的方式访问网站,不得大量下载网站内容等。

- 尊重个人隐私和版权

爬虫应尊重个人隐私和版权,如不得爬取含有个人隐私信息的网页和非公开的版权内容。

- 维护数据准确性和安全性

爬虫应维护数据的准确性和安全性,如不得篡改网页内容、盗取用户数据等。

- 不损害网站正常运行

爬虫应不损害网站的正常运行,如不得进行DDOS攻击、爬取网站资源过多等。

总之,爬虫开发需要遵守伦理规范和法律法规,尊重网站的权利和用户的隐私,以合法、合理、负责的方式进行数据抓取和处理。

关于Python的技术储备

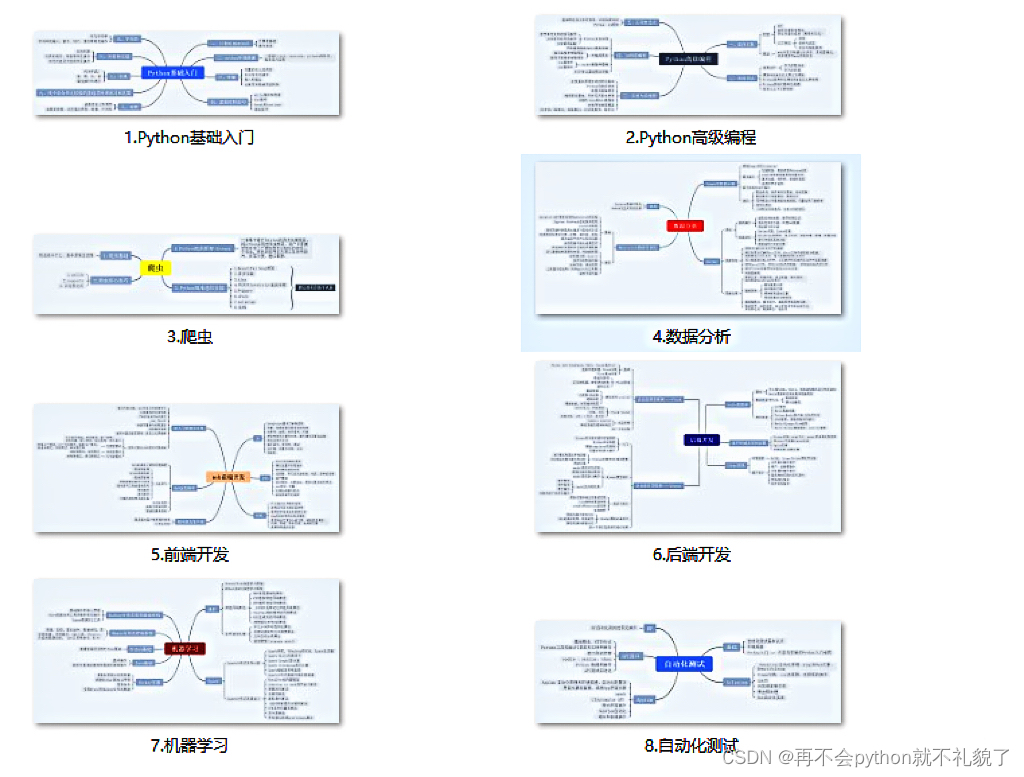

在这里给大家分享一些免费的课程供大家学习,下面是课程里面的截图,扫描最下方的二维码就能全部领取。

1.Python所有方向的学习路线

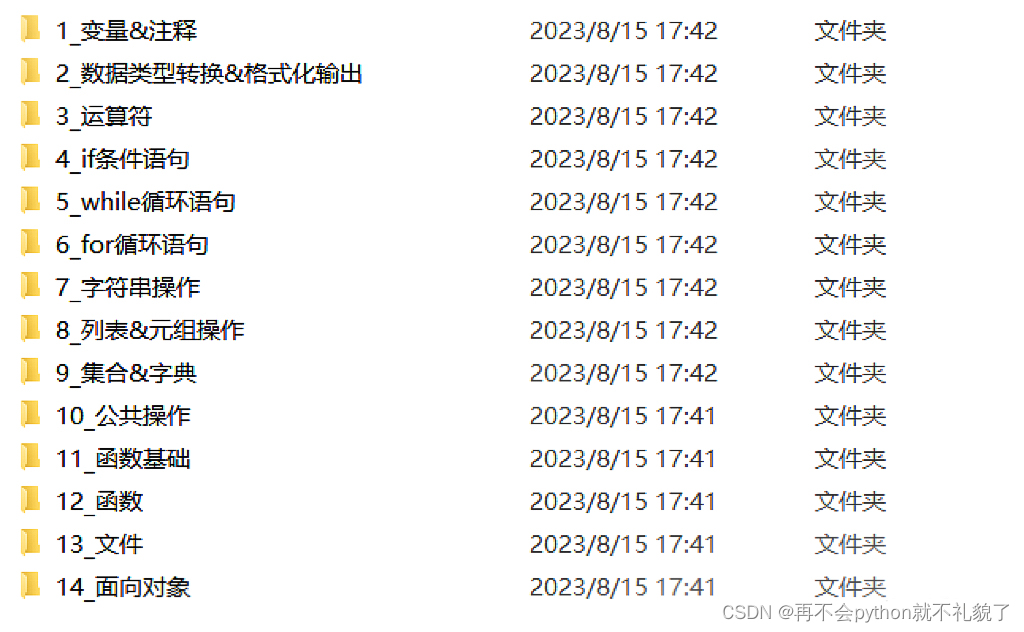

2.学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

3.学习资料

4.实战资料

实践是检验真理的唯一标准。这里的压缩包可以让你再闲暇之余帮你提升你的个人能力。

5.视频课程

好啦今天的分享就到这里结束了,快乐的时光总是短暂呢,想学习更多课程的小伙伴不要着急,有更多惊喜哦~

最新全套【Python入门到进阶资料 & 实战源码 &安装工具】(安全链接,放心点击)

949

949

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?