Ranger01 - User zuser01 does not have permission to submit application...

解决方法:在Ranger中给相应的组件配置策略

Ranger02 - 部署失败问题

解决方法:ranger部署时,需确保数据库名字不重复且要求Password should be minimum 8 characters with minimum one alphabet and one numeric.

Yarn01- 提交任务后报错

Error: java.io.IOException: Couldn't create proxy provider class org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider

Caused by: java.lang.IllegalArgumentException: java.net.UnknownHostException: hadoop-1208

解决方法:需要重置主机,更新配置脚本,hosts-config.yaml文件

Flink01 - Flink on Yarn 提交任务报错

org.apache.flink.client.program.ProgramInvocationException: The main method caused an error: Could not deploy Yarn job cluster.

解决方法:额外的配置参数 flink-conf.yaml 中,在执行任务时,有多余参数设置

Flink02 - 执行flink-Standalone任务报错

解决方法:需加入临时配置文件export JVM_ARGS="-Djava.security.auth.login.config=conf/jaas-keytab.conf -Dzookeeper.sasl.client.canonicalize.hostname=false"

Flink03 - 错误未指定Hadoop_classpath

解决方法:指定hadoop路径

HDFS01- 部署错误-时区问题certificate has expired or is not yet valid: current time

解决方法:目标机器的时间不对,调整目标机器时间

HDFS02- 删除hdfs文件,无法删除

Name node is in safe mode.安全模式开启

解决方法:退出安全模式即可hadoop dfsadmin -safemode leave

HDFS03 - 添加时,报错,显示未授权请求失败,unauthorized

解决方法:ranger未成功启动导致

HDFS04 - Failed to start JournalNode

解决方法:无法访问到kerberos,重新部署组件

HDFS05 - 执行命令,指向节点有误

解决方法:节点指向active节点,即可执行命令

Kafka01 - 端口被占用,导致无法执行命令 Address already in use

kafka02 - 未配置Kafka not find kafkaClient entry in the JAAS

解决方法:修改指定jaas.conf文件

Spark01 - 未找到SIMPLE authentication is not enabled. Available:[TOKEN, KERBEROS]

解决方法:未进行kinit账号登录,登录账号即可

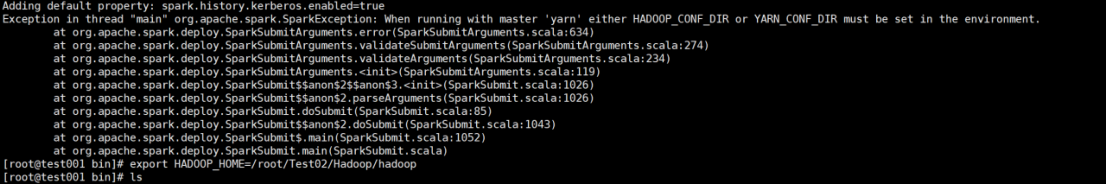

Spark02 - Spark on yarn 执行报错

解决方法:配置HAOOP_CONF_DIR和YARN_CONF_DIR文件

别人挠不挠头我不知道,我只知道,我遇到时,挺挠头!!!

后续还会继续更新~~,自我成长,共同成长,才是真的成长~~

2137

2137

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?