吴恩达【深度学习工程师】专项课程包含以下五门课程:

1、神经网络和深度学习;

2、改善深层神经网络:超参数调试、正则化以及优化;

3、结构化机器学习项目;

4、卷积神经网络;

5、序列模型。

今天介绍《神经网络与深度学习》系列第三讲:神经网络基础(下)。

主要内容:1、向量化;

2、python/numpy的一些特性;

3、逻辑回归代价函数(cost function)的解释。

1、向量化

向量化(Vectorization)就是利用矩阵运算(代替for循环),提高运算速度。

如下所示:向量化计算的速度是for循环计算速度的134倍(吴恩达的课上是300倍)。

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

输出结果:

- 1

- 2

- 3

- 4

在逻辑回归中,整个训练样本构成的输入矩阵X的维度是( nx ,m),权重矩阵w的维度是( nx ,1),b是一个常数值,而整个训练样本构成的输出矩阵Y的维度为(1,m)。利用向量化的思想,所有m个样本的线性输出Z可以用矩阵表示:

在 numpy 中可以表示为:

- 1

- 2

其中,w.T表示w的转置。

在梯度下降过程中,dZ的维度是(1,m),可表示为:

db可表示为:

在 numpy 中可以表示为:

- 1

dw可表示为:

在 numpy 中可以表示为:

- 1

对于单次迭代,梯度下降算法流程如下所示:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

其中,alpha是学习率,决定w和b的更新速度。

2、Python中的小技巧

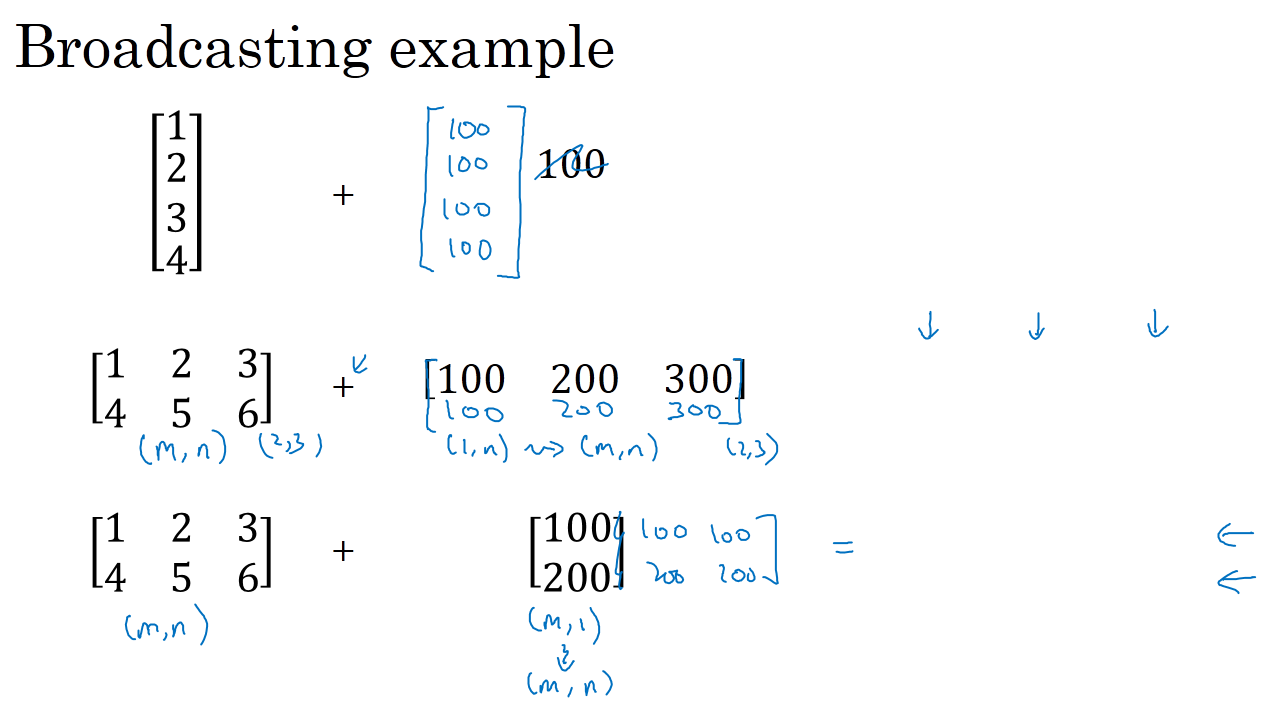

广播(Broadcasting)是python使用中的一种技巧,在python中可以对不同维度的矩阵进行四则混合运算,前提条件是至少有一个维度是相同的。

在python程序中为了保证矩阵运算不会出错,通常在运算前先使用 reshape() 函数来重新设定矩阵的维度。

在python/numpy中,如果我们用下列语句来定义一个向量:

- 1

变量 a 的维度是 (5,)。它既不是行向量也不是列向量,我们把 a 叫做秩为 1 的数组。这种定义会带来一些问题。例如我们对a转置后,得到的变量还是 a 本身。

因此,如果我们要定义(5,1)的列向量或者(1,5)的行向量,要避免使用秩为 1 的数组,使用下面的语句代替:

- 1

- 2

如果已经定义成秩为 1 的数组, 也可以使用 reshape 函数重新设定 a 的维度:

- 1

3、逻辑回归代价函数解释

首先,预测输出 y^ 的表达式可以写成:

其中, σ(z)=11+exp(−z) 。 y^ 可以看成是预测输出为正类(+1)的概率:

那么,当y=1时:

当y=0时:

我们把上面两个式子整合到一个式子中,得到:

由于log函数的单调性,可以对上式P(y|x)进行log处理:

我们希望上述概率P(y|x)越大越好,对上式加上负号,则转化成了单个样本的Loss function,越小越好,也就得到了我们之前介绍的逻辑回归的Loss function形式。

如果对于所有m个训练样本,假设样本之间是独立同分布的(iid),我们希望总的概率越大越好:

同样引入log函数,加上负号,将上式转化为Cost function,就这样我们得到了逻辑回归代价函数cost function(注意:式中, 1m 表示对所有m个样本的Cost function求平均。):

394

394

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?