用spark sql 运行出现的问题,一位粉丝的问题

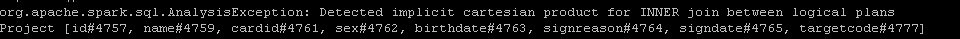

报错图

Detected implicit cartesian product for INNER join between logical plan

报错原因

其他人都说是Spark 2.x版本中默认不支持笛卡尔积操作,需要改配置,但是公司所有人用的数据库怎么可能随随便便就该配置,有可能你也没这个修改权限,改配置的方法如下(我没试过),有自己的数据库或者自己独自管理一个项目的大佬可以试试,方便的话告诉我有没有用哈哈哈

SparkSession.builder.appName("TestApp").master("local").config("spark.sql.crossJoin.enabled","true").getOrCreate()

所以我看了看他的原sql,下面就是

sql示例

oracle 原sql

select (select max(tionno)

from B

where btype='71' and inss = '0') as TionNo

from

A a

一般都是把子查询改成关联查询,

改成关联查询

select

b.maxtar as TionNo

from

A a,

(select max(tionno) as maxtar

from B

where btype='71' and inss = '0'

) b;

这改法在oracle和hive 里面都可以执行的,我试过了,他说他也是看我前几期的sql改写博客悟出来的

不改配置的方法的一个案例

报这个错还有就是得看看是不是你的sql写错了

他这个就是没必要改,他这个子查询里面没有关联条件,没有和A表关联的条件,spark是支持没有关联条件的子查询的,hive是就不支持子查询

spark sql改写

select (select max(tionno)

from B

where btype='71' and inss = '0') as TionNo

from

A a

或者用cross join

听同事说还可以用cross join来关联,

select

b.maxtar as TionNo

from

A a

cross join

(select max(tionno) as maxtar

from B

where btype='71' and inss = '0'

) b

如果产生笛卡尔集就加一个rownum,

2679

2679

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?