------- <a href="http://www.itheima.com" target="blank">android培训</a>、<a href="http://www.itheima.com" target="blank">java培训</a>、期待与您交流! ----------

一、进制

只讨论二进制、八进制、十进制、十六进制

二进制:它由两个基本数字0,1组成,二进制数运算规律是逢二进一。

八进制:由数字0-7组成,运算规律是逢八进一。

十进制:由数字0-10组成,运算规律是逢十进一。

十六进制:由数字0-10字母A,B,C,D,E,F十六个字符组成,,运算规律是逢十六进一。

二、进制的转换

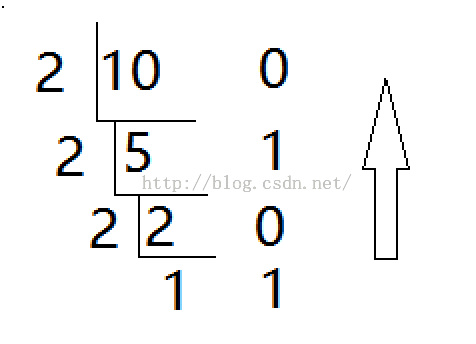

1.十进制转二进制

原理:对十进制数进行除2运算。

练习:求十进制数10的二进制数。

10(十进制) = 1010(二进制)

2. 二进制转十进制

原理:二进制乘以2的过程。

练习:求二进制数1111的十进制数。

1111 = 1*2(0)+1*2(1)+1*2(2)+1*2(3) = 15

附:括号中的数值代表次方。

练习:求二进制数1111-1111的十进制数。

1 1 1 1 1 1 1 1

128 64 32 16 8 4 2 1

---------------------------------------

128+64+32+16+8+4+2+1 = 255

3. 十进制转八进制

原理:八进制,其实就是3个二进制位转成一个八进制位。

练习:求十进制数20的八进制数。

十进制 20

二进制 00010100

三位分割 010-100

八进制 48

20(十进制) = 00010100(二进制) =24(八进制)

4. 十进制转十六进制

原理:十六进制,其实就是4个二进制位转成1个十六进制位。

练习:求十进制数20的十六进制数。

十进制 20

二进制 00010100

四位分割 0001-0100

十六进制 14

因此,20(十进制) = 00010100(二进制) = 0x14(十六进制)

5 负数的进制

原理:负数的二进制表现形式就是对应的正数二进制取反加1。

练习:求-20的二进制表现形式

0001-0100 20

1110-1011 取反

+0000-0001 加1

-------------------

1110-1100

注意:负数的二进制最高位永远是1。

1959

1959

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?