前言

Hadoop作为一个大型的分布式系统,当他的规模不断的扩大,扩增到一定程度的时候,所使用的业务方自热而然的也会变多,不同的业务方会提交各种各样类型的任务,有人提交hive的查询任务,有人会写MapReduce解析程序的job.于是这就慢慢产生了一个叫"多租户"的概念.多租户最简单直接的理解就是一个大的公共自行车场,被一波人共同使用,自行车被人借光了,你就不能使用了,你就得等.但是,当这个用户越来越多的时候,一个很棘手的问题就会发生,某些不良"用户"独占大部分资源,导致其他的用户根本无法正常使用工作.今天本文所讨论的问题就是这个主题.对于此类问题,一般有2种解决方案,一个是分析管理,人工分析,然后手动操作管理,手动更改配置限定一下个别用户的资源使用上限,第二种则是用户的资源隔离,每位用户都固定分配好多少多少资源,只能用这么多.论难度而言,后者比前者更有技术难度,因为要改核心代码,今天就分析前面1种,就是分析找出这些"大户".

Hadoop现有监控的不足

把上面这个问题对应到Hadoop系统中,就是找出哪个user用的container,memory,cpu-vcores最多.单纯从Hadoop自身提供的一些工具来看,这些其实对于我们的帮助不大,不管说是ResourceManager的后台页还是JobHistory的历史job信息展示页来看,这些信息详细程序还是有的,就是太散,缺乏一个汇总这些数据信息的地方.例如1个finished job,我想要知道他是不是异常的job,那么我当然得需要知道里面的task异常的多不多,于是我就得在页面上继续往里点.这个数量小一点尚可接受,但是对于集群规模1天可达数万个job的集群时,根本难以想象.所以我们的初步目标就是2点,1个是汇总一些数据.2分析汇总后的数据,并做一些处理并展示到页面上,达到最直观的效果.

JobHistory的Task分析

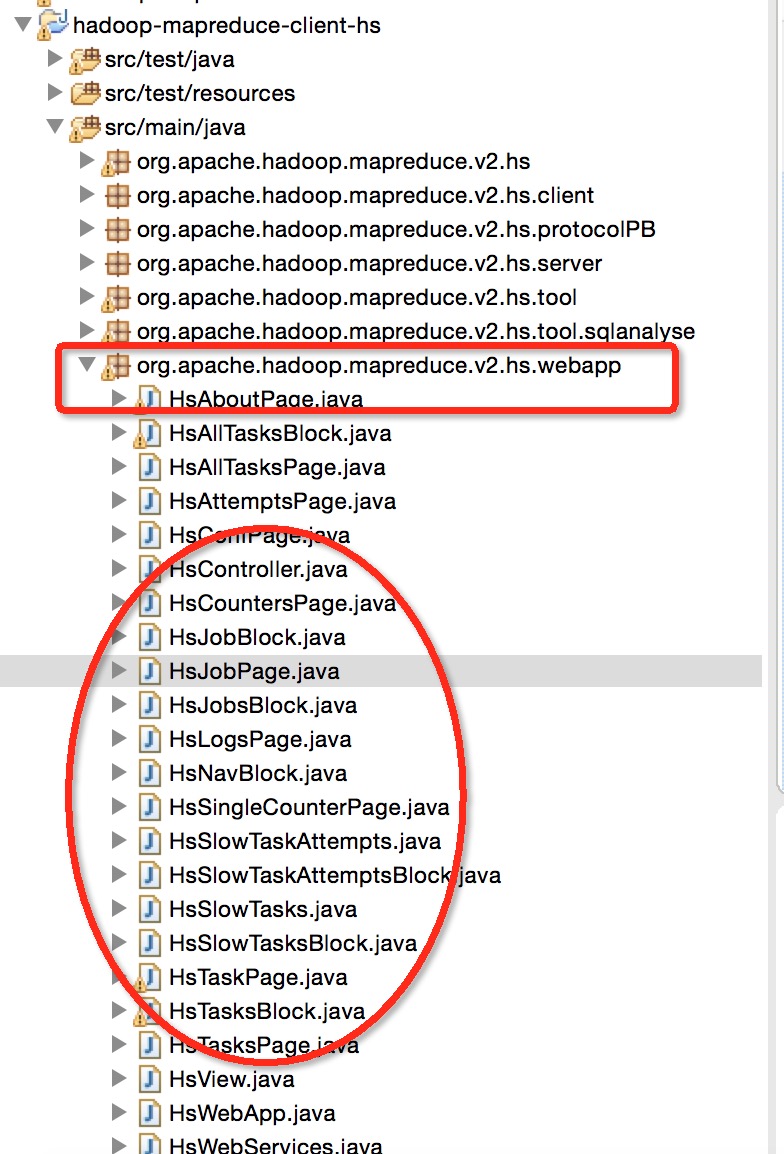

在Hadoop层面,要想做到细粒度层面的分析,task级别的分析是一个不错的切入点.而Task的数据都是存在与JobHistory的.jhist文件中.于是我们可以在JobHistory的job解析的层面做一些加工.首先要知道JobHistory的页面是怎么生成的,首先他是在hadoop-mapredce-client-hs工程下的webapp包下.如下图所示的位置:

然后下面的Hs打头的类就是负责显示页面数据的逻辑代码.这部分的代码逻辑大致相同,读者可自行研究学习.然后我们找到一个与Job信息显示相关的一个类,HsJobBlock,分析一下里面的代码:

...

/*

* (non-Javadoc)

* @see org.apache.hadoop.yarn.webapp.view.HtmlBlock#render(org.apache.hadoop.yarn.webapp.view.HtmlBlock.Block)

*/

@Override protected void render(Block html) {

String jid = $(JOB_ID);

if (jid.isEmpty()) {

html.

p()._("Sorry, can't do anything without a JobID.")._();

return;

}

JobId jobID = MRApps.toJobID(jid);

Job j = appContext.getJob(jobID);

if (j == null) {

html.

p()._("Sorry, ", jid, " not found.")._();

return;

}

List<AMInfo> amInfos = j.getAMInfos();

JobInfo job = new JobInfo(j);

ResponseInfo infoBlock = info("Job Overview").

_("Job Name:", job.getName()).

_("User Name:", jo

本文探讨了Hadoop在大规模使用下遇到的资源管理问题,特别是如何通过分析JobHistory来识别异常和慢任务。现有的Hadoop监控工具在汇总和展示数据方面存在不足,因此提出在JobHistory的Task分析层面进行改进,包括自定义慢任务和错误TaskAttempt的筛选。通过这些改进,可以更有效地监控和管理Hadoop集群中的任务,提升资源利用率。

本文探讨了Hadoop在大规模使用下遇到的资源管理问题,特别是如何通过分析JobHistory来识别异常和慢任务。现有的Hadoop监控工具在汇总和展示数据方面存在不足,因此提出在JobHistory的Task分析层面进行改进,包括自定义慢任务和错误TaskAttempt的筛选。通过这些改进,可以更有效地监控和管理Hadoop集群中的任务,提升资源利用率。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

224

224

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?