主要内容:

1.反向传播算法

2.神经网络介绍

1.反向传播算法

第二节和第三节中已经介绍了分类器的评分函数,两种常用的损失函数,以及通过梯度下降进行优化的方法,计算梯度,然后沿着梯度相反的方向进行优化,一般用解析梯度来计算,用数值梯度进行检查。但是,对于复杂的模型来说,求取每个参数的解析梯度也是非常复杂的,所以要通过另外一个角度来解决这个问题,即梯度的反向传播(Backpropagation)算法。

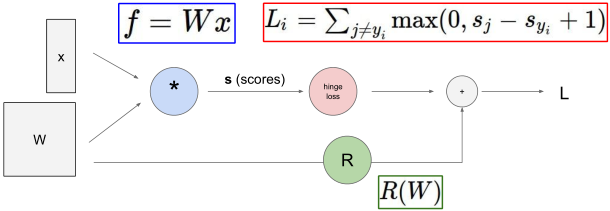

首先用计算图的方式来描述模型,对于线性分类器可以表示为

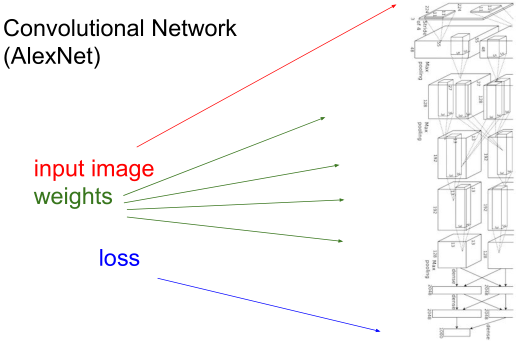

对于卷积神经网络(Convolutional Network),以AlexNet为例,可以表示为

另外还有更加复杂的神经图灵机(Neural Turing Machine)。

对于这种复杂的模型来说,前向(损失函数值)和反向(梯度值)的计算用表达式来描述是不现实的。

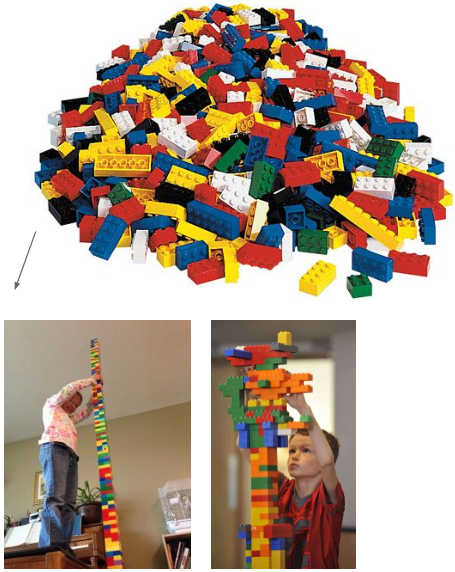

一般以计算图的方式对模型进行描述,将模型中的模块抽象成层(layer)的概念,层内实现了初始化、前向传播和反向传播,然后将不同功能的层组合,成为一个复杂的模型。这一过程即如搭积木一般

梯度在层之间从后向前计算,某参数的梯度包含两个部分,局部梯度和整体梯度,其中整体梯度即损失函数对于该参数后面所有层中相关变量的偏导数。

总结

● 神经网络模型一般都非常复杂,对每个参数写出其梯度表达式是不现实的

● 反向传播就是沿着计算图的结构递归地应用链式法则来求取输入、参数、中间件的梯度

● 用计算图结构实现模型,其中的结点/层实现了各自的前向和反向

● 前向:计算一个操作的结果,保存用于计算梯度所需的中间变量

● 反向:计算损失函数相对于输入的梯度值

2. 神经网络介绍

线性分类器评分函数: f=Wx

两层神经网络评分函数: f=W2max(0,W1x)

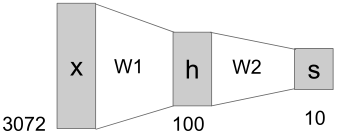

其中 max() 是一种激活函数(Activation),后面会介绍多种常用激活函数。神经网络的计算过程可以表示如下

以CIFAR-10数据集为训练样本,输入层为

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1817

1817

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?