数据的标准化(normalization)是将数据按比例缩放,使之落入一个小的特定区间。在一些数据比较和评价中常用到。典型的有归一化法,还有比如极值法、标准差法。

归一化方法的主要有两种形式:一种是把数变为(0,1)之间的小数,一种是把有量纲表达式变为无量纲表达式。在数字信号处理中是简化计算的有效方式。

归一化处理的好处:

1 加快梯度下降的求解速度,即提升模型的收敛速度

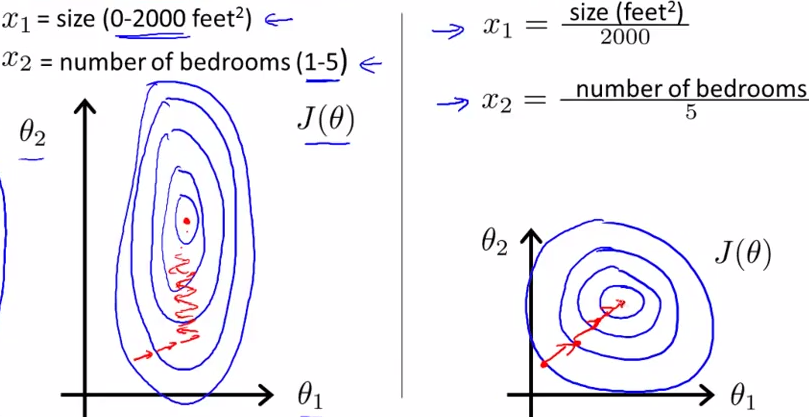

两个特征区间相差非常大时,如左图中的x1[0-2000]和x2[1-5],形成的等高线偏椭圆,迭代时很有可能走“之字型”路线(垂直长轴),从而导致需要迭代很多次才能收敛。

而右图对两个特征进行了归一化,对应的等高线就会变圆,在梯度下降进行求解时能较快的收敛。

因此在机器学习中使用梯度下降法求最优解时,归一化也很有必要,否则模型很难收敛甚至有时不能收敛。

2 有可能提高模型的精度

一些分类器需要计算样本之间的距离,如果一个特征的值域范围非常大,那么距离计算就会主要取决于这个特征,有

数据标准化是将数据按比例缩放,常用于加速梯度下降的收敛速度和提高模型精度。常见的方法有线性归一化(min-max normalization)和标准差标准化(z-score standardization)。非线性归一化如log、指数和反正切函数则适用于数据分化较大的场景。归一化处理能够帮助优化模型性能,特别是在计算样本间距离和使用梯度下降法时显得尤为重要。

数据标准化是将数据按比例缩放,常用于加速梯度下降的收敛速度和提高模型精度。常见的方法有线性归一化(min-max normalization)和标准差标准化(z-score standardization)。非线性归一化如log、指数和反正切函数则适用于数据分化较大的场景。归一化处理能够帮助优化模型性能,特别是在计算样本间距离和使用梯度下降法时显得尤为重要。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5778

5778

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?