[CVPR 17]RefineNet: Multi-Path Refinement Networks for High-Resolution Semantic Segmentation

Guosheng Lin, Anton Milan, Chunhua Shen, Ian Reid

from The University of Adelaide & Australian Centre for Robotic Vision

Inuition:

这篇文章提出了一套网络架构以实现高精度的语义分割任务。目前在PASCAL VOC 2012数据集上取得了最好的效果。从网络结构来看,本工作是U-Net的一个变种。文章的主要贡献和创新在于U-Net折返向上的通路之中。

Struture:

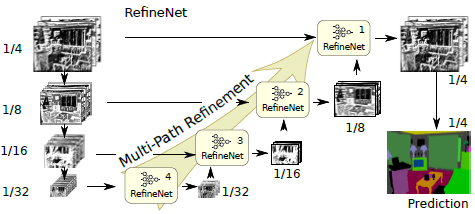

本文提出的网络模型可以分为两段对应于U-Net中向下(特征逐步降采样同时提取语义特征)和向上(逐步上采样特征恢复细节信息)两段通路。其中向下的通路以ResNet为基础。向上的通路使用了新提出的RefineNet作为基础,并作为本通路特征与ResNet中低层特征的融合器。一个基本的框架如下图所示:

其中左边的四组特征是从ResNet的四个对应的block取出的。此框架与U-Net没有太大区别。不过如作者所说,RefineNet是一个灵活的模块,其输入的尺度个数可以变化,因此整个网络的拓扑结构可以有很多改变。这点在文章的4.3章节有详细介绍,此处不再赘述。

RefineNet:

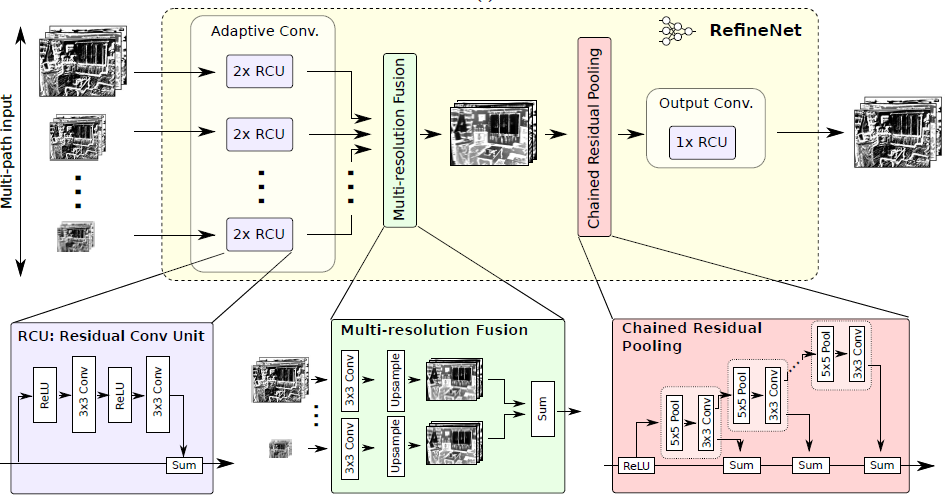

具体来看RefineNet的细节结构,如下图所示:

RefineNet可以分为三个主要部分:

1. 不同尺度(也可能只有一个输入尺度)的特征输入首先经过两个Residual模块的处理;

2. 之后是不同尺寸的特征进行融合。当然如果只有一个输入尺度,该模块则可以省去。所有特征上采样至最大的输入尺寸,然后进行加和。上采样之前的卷积模块是为了调整不同特征的数值尺度;

3. 最后是一个链式的pooling模块。其设计本意是使用侧支上一系列的pooling来获取背景信息(通常尺寸较大)。直连通路上的ReLU可以在不显著影响梯度流通的情况下提高后续pooling的性能,同时不让网络的训练对学习率很敏感。

最后再经过一个Residual模块即得RefineNet的输出。

Long-range Residual Connection

RefineNet的一个特点是使用了较多的residual connection。这样的好处不仅在于在RefineNet内部形成了short-range的连接,对训练有益。此外还与ResNet形成了long-range的连接,让梯度能够有效传送到整个网络中。作者认为这一点对于网络是很有好处的。

Experiments:

作者在NYUDv2, PASCAL VOC 2012, SUN-RGBD, PASCAL-Context, Cityscapes, ADE20K MIT等数据库上进行了实验,都取得了很好的效果。需要注意的一点是,作者在VOC的实验中使用了dense CRF进行后处理,发现其对性能的提升仅有0.1%,于是没有在其他实验中使用CRF。

8674

8674

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?