本文介绍如何手动跟新zookeeper中的偏移量。我们在使用kafka的过程中,有时候需要通过修改偏移量来进行重新消费。我们都知道offsets是记录在zookeeper中的,所以我们想修改offsets的值只要修改zookeeper中的offsets值就可以了。修改offsets值有几种方法,这里介绍最直接的一种修改方法,就是直接手动修改zookeeper中记录的offsets值。

首先进入zk客户端

zkCli.sh -server localhost:2181

Offsets值记录在zk客户端具体的路径为

/consumers/[groupId]/offsets/[topic]/[partitionId]

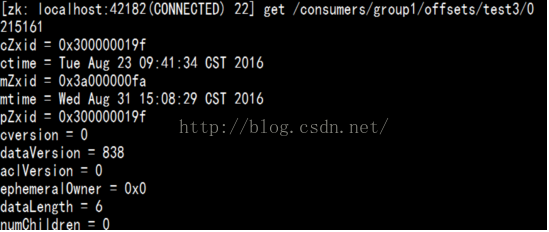

比如查看test3主题0分区下的offsets

[zk: localhost:42182(CONNECTED) 22] get /consumers/group1/offsets/test3/0

Offsets=215161

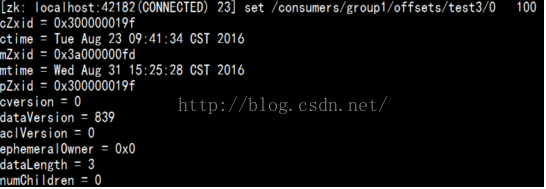

然后修改你想要修改的哪个topic下的哪个partition的offsets就可以了。

修改test3主题0分区下的offsets值为100

这样就修改了Offsets

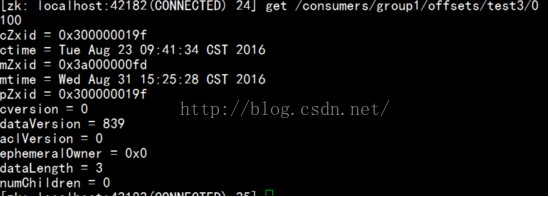

我们再用上诉命令查看一下Offsets

查看test3主题0分区下的offsets

[zk: localhost:42182(CONNECTED) 22] get /consumers/group1/offsets/test3/0

Offsets=100

修改完大家再重新消费一下就会发现已经可以消费出以前的数据了。

---

更多文章关注公众号

更多:kafka深入理解专栏

——————————————————————————————————

作者:桃花惜春风

转载请标明出处,原文地址:

https://blog.csdn.net/xiaoyu_bd/article/details/52390175

如果感觉本文对您有帮助,请留下您的赞,您的支持是我坚持写作最大的动力,谢谢!

本文介绍了一种直接的手动方法来更新Kafka中的偏移量,即通过修改Zookeeper中记录的偏移量值。具体步骤包括进入Zookeeper客户端,定位到指定的主题和分区,然后修改所需的偏移量值。

本文介绍了一种直接的手动方法来更新Kafka中的偏移量,即通过修改Zookeeper中记录的偏移量值。具体步骤包括进入Zookeeper客户端,定位到指定的主题和分区,然后修改所需的偏移量值。

2651

2651

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?