熟悉java的开发者在开发spark应用时,常常会遇到spark对java的接口文档不完善或者不提供对应的java接口的问题。这个时候,如果在java项目中能直接使用scala来开发spark应用,同时使用java来处理项目中的其它需求,将在一定程度上降低开发spark项目的难度。下面就来探索一下java、scala、spark、maven这一套开发环境要怎样来搭建。

1、下载scala sdk

http://www.scala-lang.org/download/ 直接到这里下载sdk,目前最新的稳定版为2.11.7,下载后解压就行

(后面在intellijidea中创建.scala后缀源代码时,ide会智能感知并提示你设置scala sdk,按提示指定sdk目录为解压目录即可)

也可以手动配置scala SDK:ideal =>File =>project struct.. =>library..=> +...

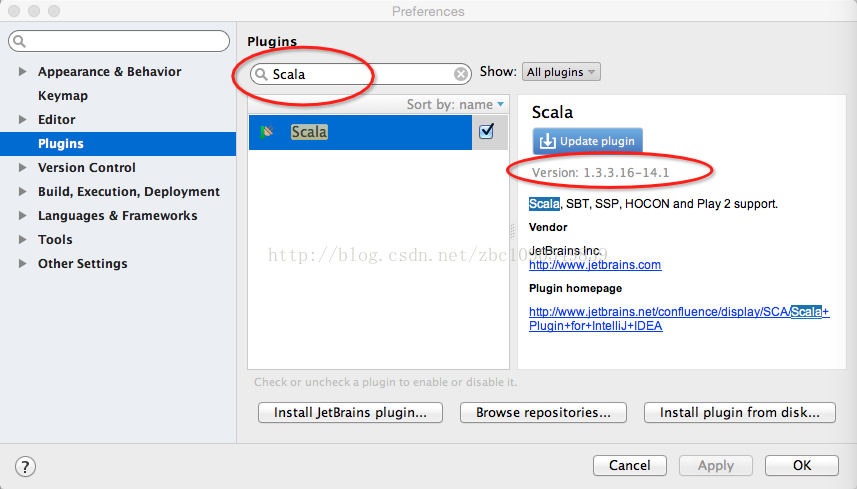

2、下载scala forintellij idea的插件

如上图,直接在plugins里搜索Scala,然后安装即可,如果不具备上网环境,或网速不给力。也可以直接到http://plugins.jetbrains.com/plugin/?idea&id=1347手动下载插件的zip包,手动下载时,要特别注意版本号,一定要跟本机的intellij idea的版本号匹配,否则下载后无法安装。下载完成后,在上图中,点击“Install plugin from disk...”,选择插件包的zip即可。

3、如何跟maven整合

使用maven对项目进行打包的话,需要在pom文件中配置scala-maven-plugin这个插件。同时,由于是spark开发,jar包需要打包为可执行java包,还需要在pom文件中配置maven-assembly-plugin和maven-shade-plugin插件并设置mainClass。经过实验摸索,下面贴出一个可用的pom文件,使用时只需要在包依赖上进行增减即可使用。

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/maven-v4_0_0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>my-project-groupid</groupId>

<artifactId>sparkTest</artifactId>

<packaging>jar</packaging>

<version>1.0-SNAPSHOT</version>

<name>sparkTest</name>

<url>http://maven.apache.org</url>

<properties>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

<hbase.version>0.98.3</hbase.version>

<!--<spark.version>1.3.1</spark.version>-->

<spark.version>1.6.0</spark.version>

<jdk.version>1.7</jdk.version>

<scala.version>2.10.5</scala.version>

<!--<scala.maven.version>2.11.1</scala.maven.version>-->

</properties>

<repositories>

<repository>

<id>repo1.maven.org</id>

<url>http://repo1.maven.org/maven2</url>

<releases>

<enabled>true</enabled>

</releases>

<snapshots>

<enabled>false</enabled>

</snapshots>

</repository>

<repository>

<id>repository.jboss.org</id>

<url>http://repository.jboss.org/nexus/content/groups/public/

</url>

<snapshots>

<enabled>false</enabled>

</snapshots&g

本文介绍了在Maven环境下,如何利用Java和Scala混合开发Spark应用程序。主要内容包括下载Scala SDK,安装IntelliJ IDEA的Scala插件,配置Scala与Maven的整合,以及解决Scala项目打包和Spark应用的jar包运行问题。

本文介绍了在Maven环境下,如何利用Java和Scala混合开发Spark应用程序。主要内容包括下载Scala SDK,安装IntelliJ IDEA的Scala插件,配置Scala与Maven的整合,以及解决Scala项目打包和Spark应用的jar包运行问题。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9248

9248

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?