一、Python所有方向的学习路线

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、Python必备开发工具

工具都帮大家整理好了,安装就可直接上手!

三、最新Python学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、Python视频合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

六、面试宝典

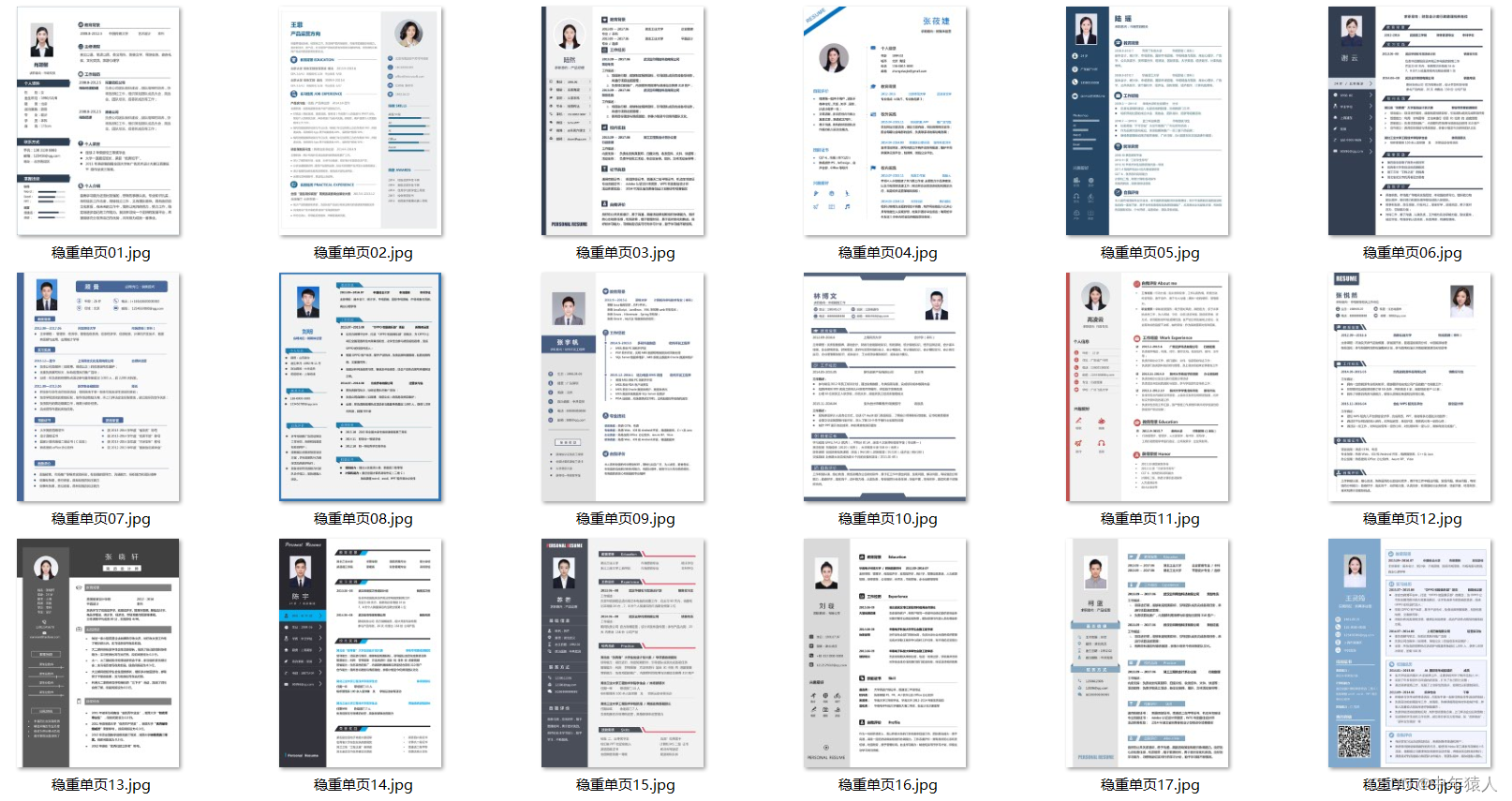

简历模板

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

那个我完全看不懂的 cookies 里好像就有一个 _csrf 啊!但是两个 _csrf 的值很明显结构不一样,试了一下把 data 里的 _csrf 换成 cookies 里的 _csrf 确实也不行。

但是我逐渐有了一个想法:这个两个 _csrf 虽然不相等,但是应该是匹配的,我刚刚的 data 来自浏览器, cookies 来自python程序,所以不匹配!

于是我又点开浏览器的DevTools,Ctrl+F搜索了一下,嘿嘿,发现了:

和

这三处。

第一处那里的下一行的 csrf_token 很明显就是 post 请求所带的 data 里的 _csrf ,另外两个是js里的函数,虽然js没好好学但也能看出来这俩是通过 post 请求获得州名和县名的,Binggo!一下子解决两个问题。

为了验证我的猜想,我打算先直接用requests获取点击 View Summary 前的页面的HTML和 cookies ,将从HTML中提取的 csrf_token 值作为点击 View Summary 时 post 请求的 data 里的 _csrf 值,同时附上 cookies ,这样两处 _csrf 就应该是匹配的了:

from lxml import etree

response1 = requests.get(url, headers=headers)

cookies = response1.cookies

html = etree.HTML(response1.text)

csrf_token = html.xpath(‘/html/head/meta[3]/@content’)[0]

data.update({‘_csrf’: csrf_token})

response2 = requests.post(url, data=data, headers=headers, cookies=cookies)

print(response2.status_code)

输出 200 ,虽然和Chrome显示的 302 不一样,但是也表示成功,那就不管了。把 response2.text 写入html文件打开看是这样:

Yeah,数据都在!说明我的猜想是对的!那一会再试试我从没用过的 requests.Session() 维持会话,自动处理 cookies 。

尝试pandas库提取网页表格

现在既然已经拿到了目标页面的HTML,那在获取所有年、地区、州名、县名之前,先测试一下 pandas.read_html 提取网页表格的功能。

pandas.read_html 这个函数时在写代码时IDE自动补全下拉列表里瞄到的,一直想试试来着,今天乘机拉出来溜溜:

import pandas as pd

df = pd.read_html(response2.text)[0]

print(df)

输出:

Yeah!拿到了,确实比自己手写提取方便,而且数值字符串自动转成数值,优秀!

准备所有参数

接下来要获取所有年、地区、州名、县名。年份和地区是写死在HTML里的,直接xpath获取:

州名、县名根据之前发现的两个js函数,要用 post 请求来获得,其中州名要根据地区名获取,县名要根据州名获取,套两层循环就行

def new():

session = requests.Session()

response = session.get(url=url, headers=headers)

html = etree.HTML(response.text)

return session, html

session, html = new()

years = html.xpath(‘//*[@id=“crmsearchform-year”]/option/text()’)

regions = html.xpath(‘//*[@id=“crmsearchform-region”]/option/text()’)

_csrf = html.xpath(‘/html/head/meta[3]/@content’)[0]

region_state = {}

state_county = {}

for region in regions:

data = {‘region’: region, ‘_csrf’: _csrf}

response = session.post(url_state, data=data)

html = etree.HTML(response.json())

region_state[region] = {x: y for x, y in

zip(html.xpath(‘//option/@value’),

html.xpath(‘//option/text()’))}

for state in region_state[region]:

data = {‘state’: state, ‘_csrf’: _csrf}

response = session.post(url_county, data=data)

html = etree.HTML(response.json())

state_county[state] = html.xpath(‘//option/@value’)

啧啧,使用 requests.Session 就完全不需要自己管理 cookies 了,方便!具体获得的州名县名就不放出来了,实在太多了。然后把所有年、地区、州名、县名的可能组合先整理成csv文件,一会直接从csv里读取并构造 post 请求的 data 字典:

remain = [[str(year), str(region), str(state), str(county)]

for year in years for region in regions

for state in region_state[region] for county in state_county[state]]

remain = pd.DataFrame(remain, columns=[‘CRMSearchForm[year]’,

‘CRMSearchForm[region]’,

‘CRMSearchForm[state]’,

‘CRMSearchForm[county]’])

remain.to_csv(‘remain.csv’, index=False)

由于州名有缩写和全称,也本地保存一份

import json

with open(‘region_state.json’, ‘w’) as json_file:

json.dump(region_state, json_file, indent=4)

我看了一下,一共49473行——也就是说至少要发送49473个 post 请求才能爬完全部数据,纯手工获取的话大概要点击十倍这个数字的次数……

正式开始

那么开始爬咯

import pyodbc

with open(“region_state.json”) as json_file:

region_state = json.load(json_file)

data = pd.read_csv(‘remain.csv’)

读取已经爬取的

cnxn = pyodbc.connect(‘DRIVER={Microsoft Access Driver (*.mdb, *.accdb)};’

‘DBQ=./ctic_crm.accdb’)

crsr = cnxn.cursor()

crsr.execute(‘select Year_, Region, State, County from ctic_crm’)

done = crsr.fetchall()

done = [list(x) for x in done]

done = pd.DataFrame([list(x) for x in done], columns=[‘CRMSearchForm[year]’,

‘CRMSearchForm[region]’,

‘CRMSearchForm[state]’,

‘CRMSearchForm[county]’])

done[‘CRMSearchForm[year]’] = done[‘CRMSearchForm[year]’].astype(‘int64’)

state2st = {y: x for z in region_state.values() for x, y in z.items()}

done[‘CRMSearchForm[state]’] = [state2st[x]

for x in done[‘CRMSearchForm[state]’]]

排除已经爬取的

remain = data.append(done)

remain = remain.drop_duplicates(keep=False)

total = len(remain)

print(f’{total} left.n’)

del data

%%

remain[‘CRMSearchForm[year]’] = remain[‘CRMSearchForm[year]’].astype(‘str’)

columns = [‘Crop’,

‘Total_Planted_Acres’,

‘Conservation_Tillage_No_Till’,

‘Conservation_Tillage_Ridge_Till’,

‘Conservation_Tillage_Mulch_Till’,

‘Conservation_Tillage_Total’,

‘Other_Tillage_Practices_Reduced_Till15_30_Residue’,

‘Other_Tillage_Practices_Conventional_Till0_15_Residue’]

fields = [‘Year_’, ‘Units’, ‘Area’, ‘Region’, ‘State’, ‘County’] + columns

data = {‘CRMSearchForm[format]’: ‘Acres’,

‘CRMSearchForm[area]’: ‘County’,

‘CRMSearchForm[crop_type]’: ‘All’,

‘summary’: ‘county’}

headers = {‘user-agent’: 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) ’

'AppleWebKit/537.36 (KHTML, like Gecko) ’

‘Chrome/74.0.3729.131 Safari/537.36’,

‘Host’: ‘www.ctic.org’,

‘Upgrade-Insecure-Requests’: ‘1’,

‘DNT’: ‘1’,

‘Connection’: ‘keep-alive’}

url = ‘https://www.ctic.org/crm?tdsourcetag=s_pctim_aiomsg’

headers2 = headers.copy()

headers2 = headers2.update({‘Referer’: url,

‘Origin’: ‘https://www.ctic.org’})

def new():

session = requests.Session()

response = session.get(url=url, headers=headers)

html = etree.HTML(response.text)

_csrf = html.xpath(‘/html/head/meta[3]/@content’)[0]

return session, _csrf

session, _csrf = new()

for _, row in remain.iterrows():

temp = dict(row)

data.update(temp)

data.update({‘_csrf’: _csrf})

while True:

try:

response = session.post(url, data=data, headers=headers2, timeout=15)

break

except Exception as e:

session.close()

print(e)

print(‘nSleep 30s.n’)

time.sleep(30)

session, _csrf = new()

data.update({‘_csrf’: _csrf})

df = pd.read_html(response.text)[0].dropna(how=‘all’)

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

三、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1129

1129

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?