vi filebeat-configmap.yaml

apiVersion: v1

kind: ConfigMap

metadata:

name: filebeat-config

namespace: elk

data:

filebeat.yml: |

filebeat.autodiscover: #使用filebeat自动发现模块

providers:

- type: kubernetes #配置为k8s类型

templates:

- condition: #通过标签、命名空间筛选需要的pod日志,这里是匹配后端服务的日志

and:

- or:

- equals:

kubernetes.labels:

app: foundation

- equals:

kubernetes.labels:

app: api-gateway

- equals:

kubernetes.labels:

app: field

- equals:

kubernetes.labels:

app: report

- equals:

kubernetes.namespace: java-service

config: #配置收集的pod日志路径,这里配置日志路径时要使用变量的方式定义日志路径,至于为什么使用这些变量,可以自行去看一下该日志目录下的路径名称

- type: container #配置为container模式

symlinks: true #使用了软链接的话需要加上该配置

paths:

- /var/log/containers/${data.kubernetes.pod.name}_${data.kubernetes.namespace}_${data.kubernetes.container.name}-*.log

multiline.pattern: '^\d{4}-\d{2}-\d{2} \d{2}:\d{2}:\d{2}' #使用multiline匹配以时间开头的行

multiline.negate: true #反转匹配的内容,即匹配不是以时间开头的行

multiline.match: after #将匹配到不是以时间开头的行就合并到上一个事件中

- condition: #通过标签、命名空间筛选需要的pod日志,这里是匹配前端服务的日志,这里是因为前端的日志格式和后端的日志格式不一样,所以分开收集

and:

- or:

- equals:

kubernetes.labels:

app: nodejs

- equals:

kubernetes.namespace: nodejs

config:

- type: container

symlinks: true

paths:

- /var/log/containers/${data.kubernetes.pod.name}_${data.kubernetes.namespace}_${data.kubernetes.container.name}-*.log

processors: #配置filebeat识别收集的日志格式为json,这里前端的日志已经配置为了json格式,所以在filebeat收集的时候需要将日志识别为json格式的日志,不配置的话收集出来的是一整串日志,和普通日志一样

- decode_json_fields:

fields: ["message"]

target: ""

overwrite_keys: true

add_error_key: true

output.logstash: #将收集的日志输出到logstash

hosts: ['logstash.elk:5044']

logstash配置

vi logstash-configmap.yaml

apiVersion: v1

kind: ConfigMap

metadata:

name: logstash-configmap

namespace: elk

labels:

app: logstash

data:

logstash.conf: |

input {

beats {

port => 5044

# codec => "json"

}

}

filter {

grok { #这里使用grok将java日志分割为json格式

match => {

"message" => "%{TIMESTAMP_ISO8601:timestamp}\s+%{LOGLEVEL:level}\s+%{NUMBER:thread}\s+---\s+\[%{DATA:thread_name}\]\s+%{JAVACLASS:java_class}\s+:\s+%{GREEDYDATA:log_message}"

}

}

}

output {

# stdout{ #该项为测试模式,将收集的日志内容输出到logstash的日志中

# codec => rubydebug

# }

elasticsearch {

hosts => "elasticsearch:9200" #这里的索引名称使用日志中包含的变量自动命名

index => "%{[kubernetes][container][name]}-%{+YYYY.MM.dd}"

}

}

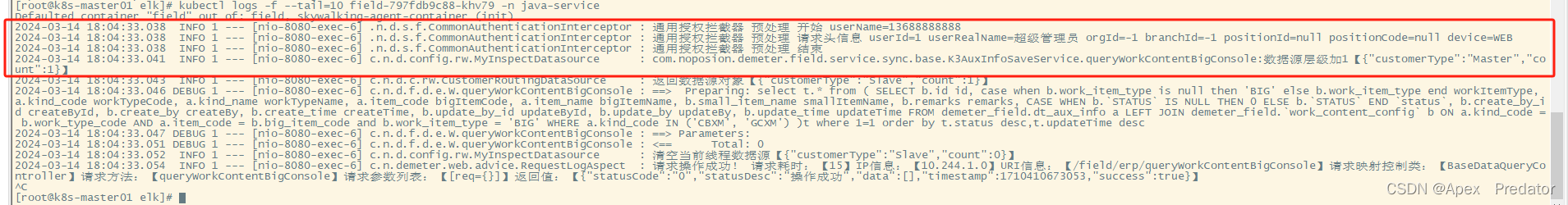

这里对java日志进行一下说明,java日志都是特定的日期格式开头,基本上都是单行的,除了报错日志,报错日志会换行,因为报错栈非常多,filebeat收集日志是一行一行收集的,在收集java报错日志的时候就会出现问题,错误日志的报错栈也被分开很多行去收集了,这是有问题的,所以会在filebeat收集java日志的时候加入multiline,进行事务的一个合并,下面来看一下java的日志

正常日志

可以看到都是以特定的时间格式开头

错误日志

其实错误日志的结构和正常日志是一样的,只是后面的报错栈被分行了,所以在filebeat使用multiline将这些不是以时间开头的行合并到上一个事件中即可

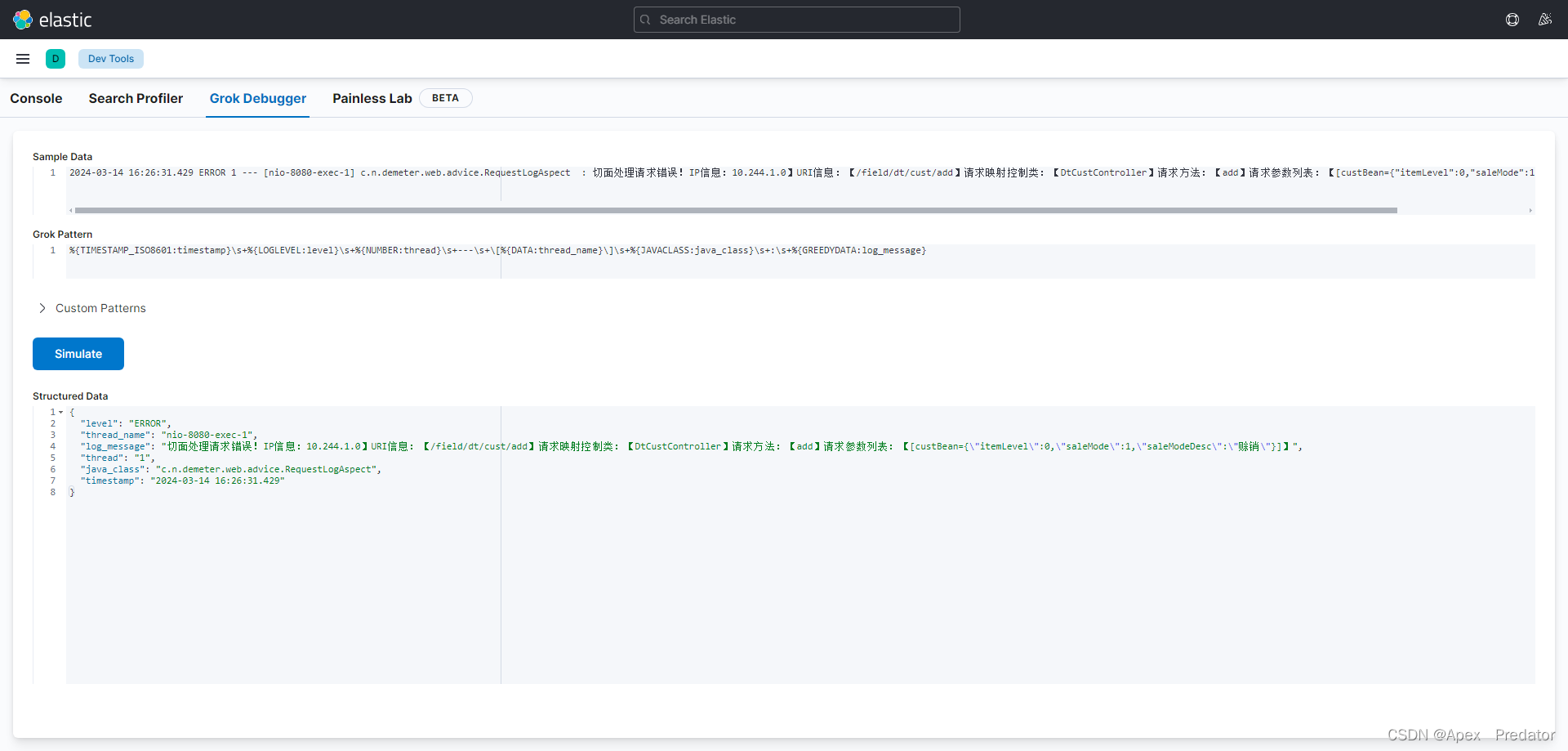

可以使用kibana试验一下对java日志的分割是否能生效

%{TIMESTAMP_ISO8601:timestamp}\s+%{LOGLEVEL:level}\s+%{NUMBER:thread}\s+---\s+\[%{DATA:thread_name}\]\s+%{JAVACLASS:java_class}\s+:\s+%{GREEDYDATA:log_message}

前端日志对于nginx的配置也做一下说明,需要在nginx配置文件中提前定义nginx的日志格式

vi nginx-public.yaml

apiVersion: v1

kind: ConfigMap

metadata:

name: public-config

namespace: nodejs

data:

nginx.conf: |

user nginx;

worker_processes auto;

error_log /var/log/nginx/error.log notice;

pid /var/run/nginx.pid;

events {

**自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。**

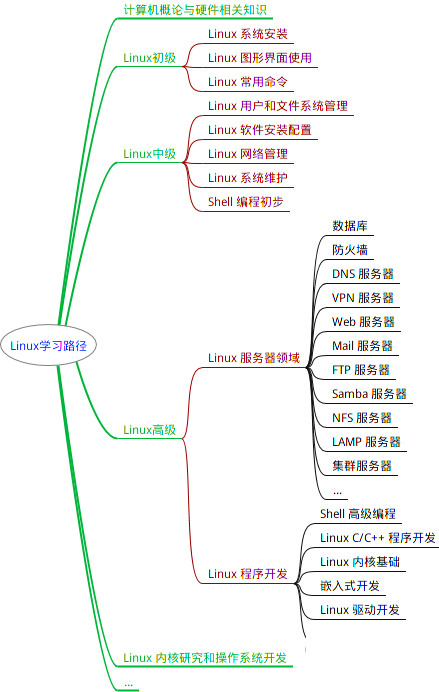

**深知大多数Linux运维工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!**

**因此收集整理了一份《2024年Linux运维全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。**

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Linux运维知识点,真正体系化!**

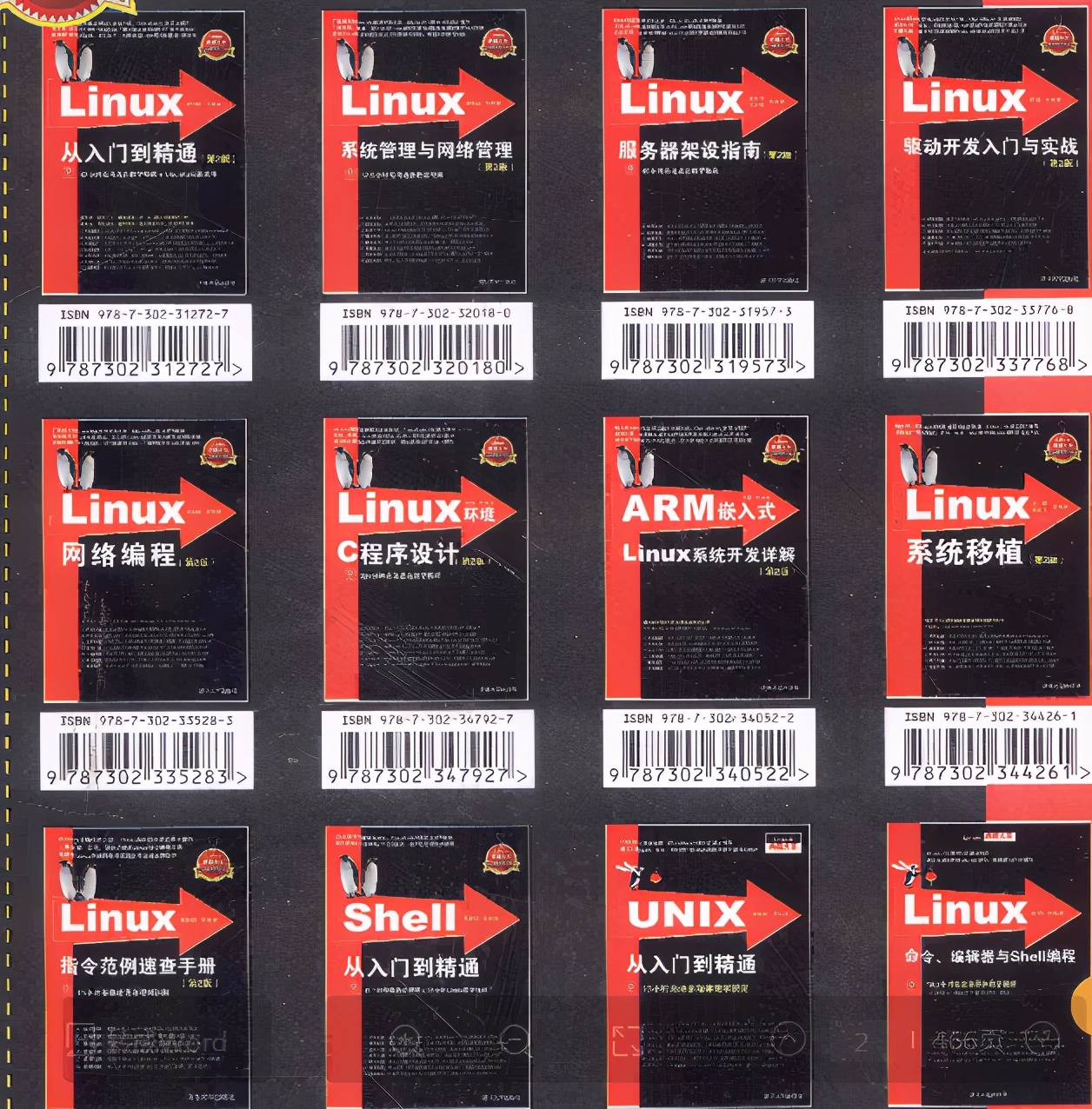

**由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新**

**如果你觉得这些内容对你有帮助,可以添加VX:vip1024b (备注Linux运维获取)**

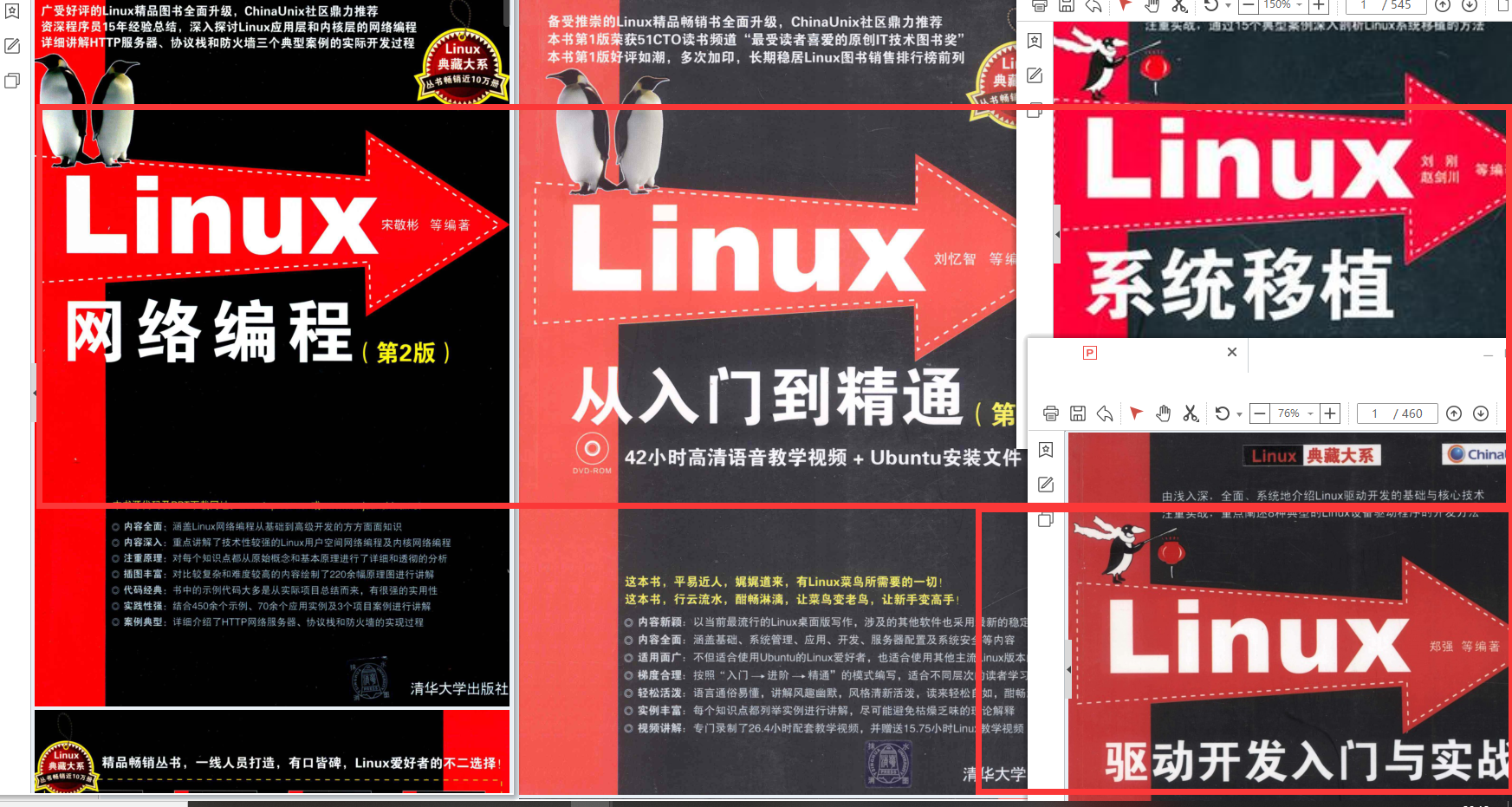

最全的Linux教程,Linux从入门到精通

======================

1. **linux从入门到精通(第2版)**

2. **Linux系统移植**

3. **Linux驱动开发入门与实战**

4. **LINUX 系统移植 第2版**

5. **Linux开源网络全栈详解 从DPDK到OpenFlow**

第一份《Linux从入门到精通》466页

====================

内容简介

====

本书是获得了很多读者好评的Linux经典畅销书**《Linux从入门到精通》的第2版**。本书第1版出版后曾经多次印刷,并被51CTO读书频道评为“最受读者喜爱的原创IT技术图书奖”。本书第﹖版以最新的Ubuntu 12.04为版本,循序渐进地向读者介绍了Linux 的基础应用、系统管理、网络应用、娱乐和办公、程序开发、服务器配置、系统安全等。本书附带1张光盘,内容为本书配套多媒体教学视频。另外,本书还为读者提供了大量的Linux学习资料和Ubuntu安装镜像文件,供读者免费下载。

**本书适合广大Linux初中级用户、开源软件爱好者和大专院校的学生阅读,同时也非常适合准备从事Linux平台开发的各类人员。**

> 需要《Linux入门到精通》、《linux系统移植》、《Linux驱动开发入门实战》、《Linux开源网络全栈》电子书籍及教程的工程师朋友们劳烦您转发+评论

**一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

Linux入门到精通》、《linux系统移植》、《Linux驱动开发入门实战》、《Linux开源网络全栈》电子书籍及教程的工程师朋友们劳烦您转发+评论

**一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

[外链图片转存中...(img-uijGPpMC-1712831868936)]

1396

1396

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?