文章目录

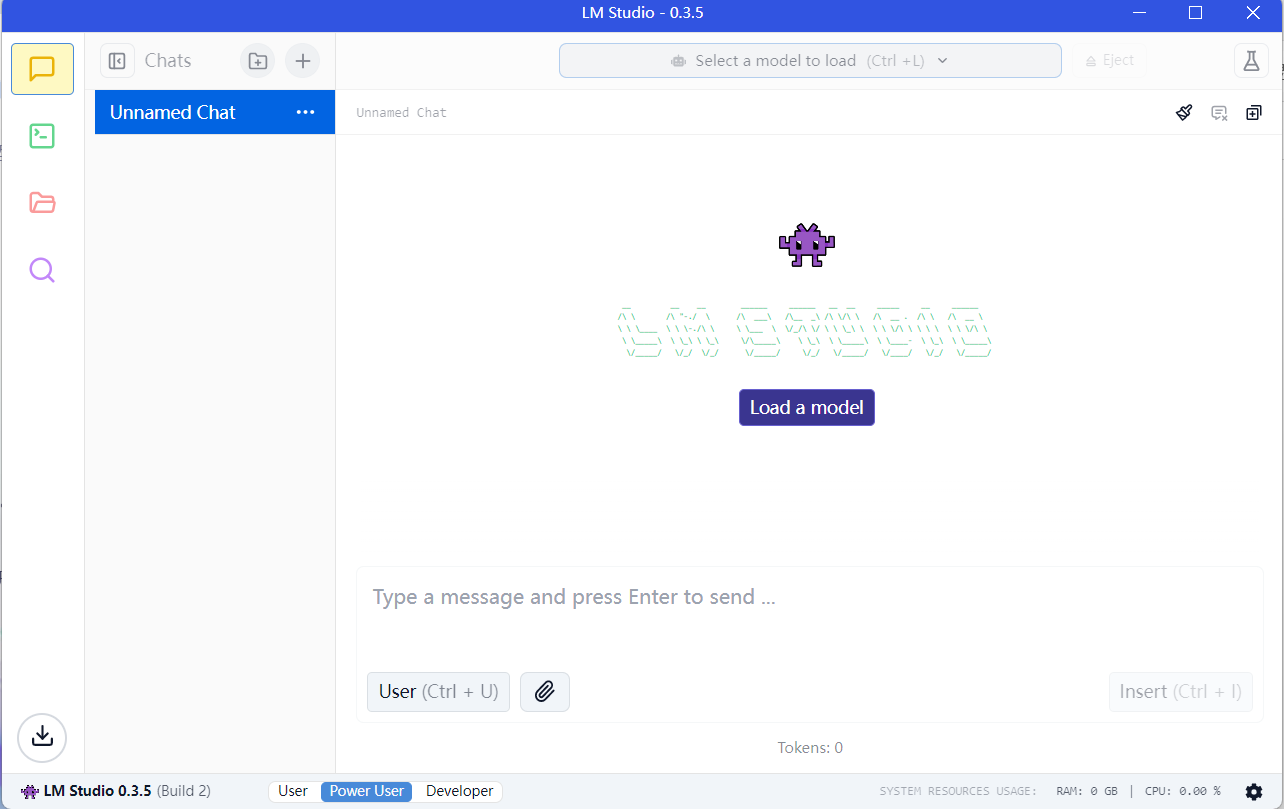

有时候需要使用离线大语言模型,然后看到了一个非常好用的客户端LM Studio,所以来分享一下。它可以提供图形化界面来运行本地大语言模型,非常方便。接下来,我将分享如何通过LM Studio来快速搭建自己的离线大语言模型。

一、下载LM Studio

LM Studio下载:https://lmstudio.ai/?utm_source=ai-bot.cn

下载完后,直接安装即可。

安装完后,打开的界面:

二、下载大语言模型

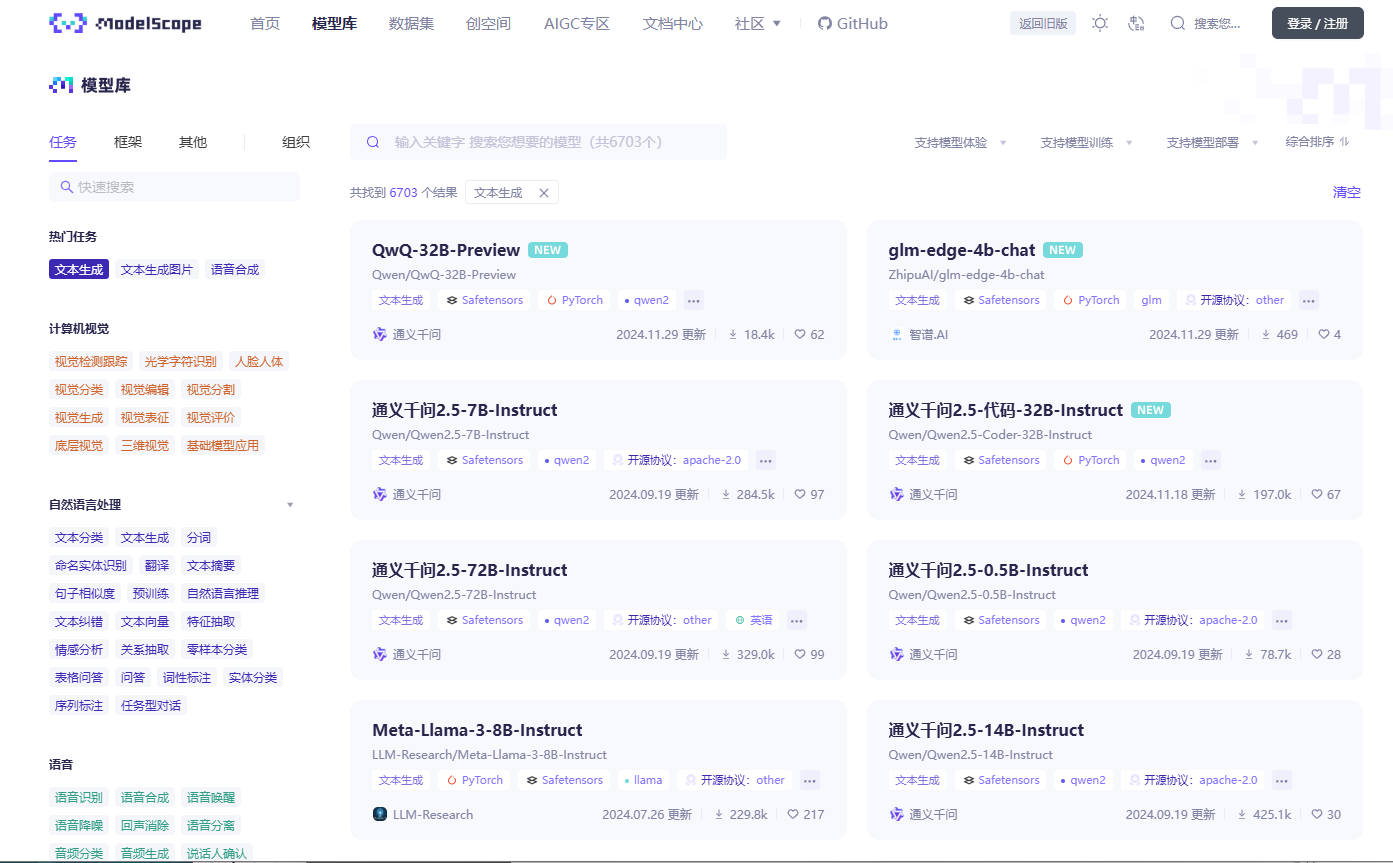

虽然LM Studio里面可直接下载模型,但是在国内往往正常下载速度非常慢,所以,推荐去国内的魔搭社区下载模型。

魔搭社区官网:https://www.modelscope.cn/models

可以看到这里有非常多的LLMs(大语言模型),可以选择适合你的电脑配置的模型,下载下来。

我的电脑处理器为12th Gen Intel® Core™ i5-12500H 3.10 GHz,试了一下,7B(70亿参数)模型如果是5G多的模型文件,可以跑起来,速度还可以,再大点的就加载不起来,配置不够;然后下载了一个3B的模型,选择.gguf文件如果是2到3G的,输出非常快,选择5G以上的话,输出的时候,就可以明显感觉到慢了,不过还能接受。

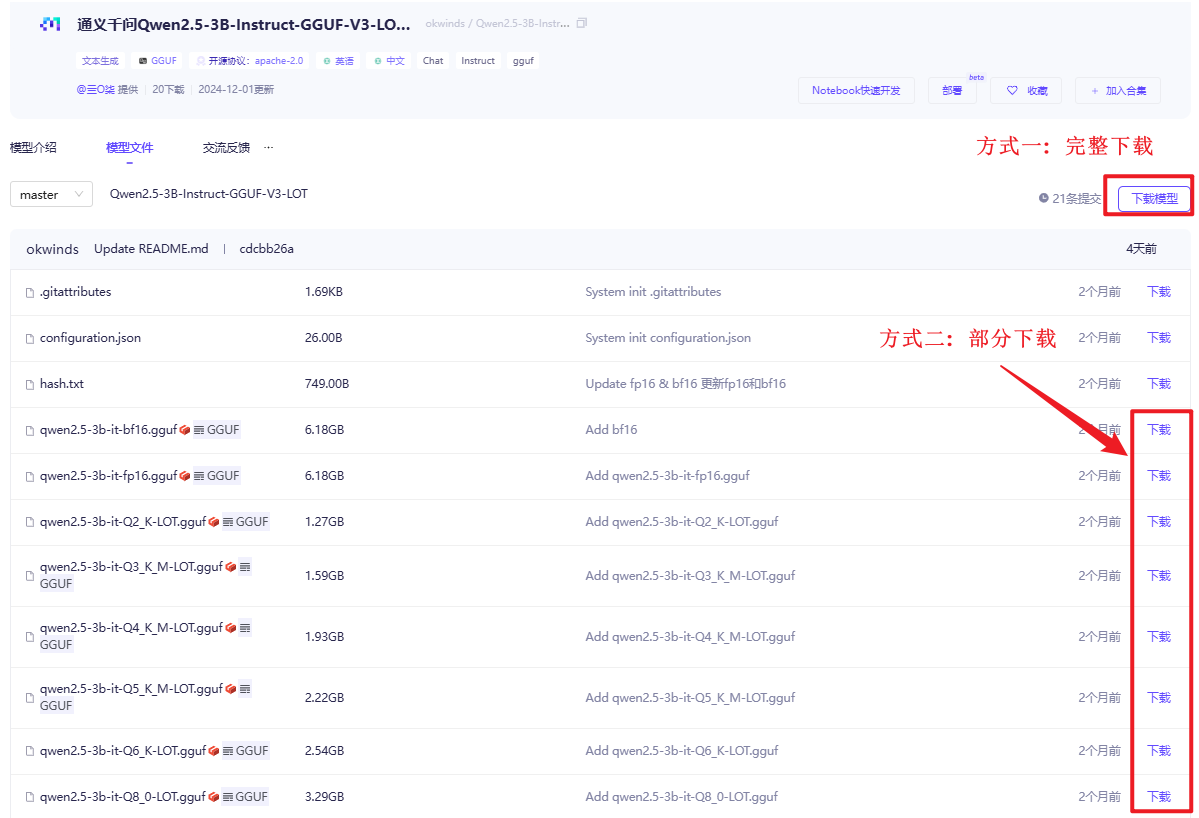

拿这个3B的模型举例:

测试的7B的模型:

1. 查看模型介绍

有的模型会在模型介绍中,详细写明适合的配置以及如何安装的多种方法和注意事项,所以先查看模型介绍。

2. 点击模型文件进行下载

大多数模型提供了多个不同大小的模型存储文件(比如GGUF文件),可以选择性的下载模型存储文件。也可以全部下载。下载后,在自定义位置新建一个路径为models\Publisher\Repository,然后把下载的模型文件放在Repository文件夹下(也可以在Repository文件夹下新建文件夹,然后存放下载的模型文件)。

2.1 完整下载

想全部下载的话,可以点击最右边的下载模型按钮,打开后会有多种下载方式,选择一种下载方式即可。

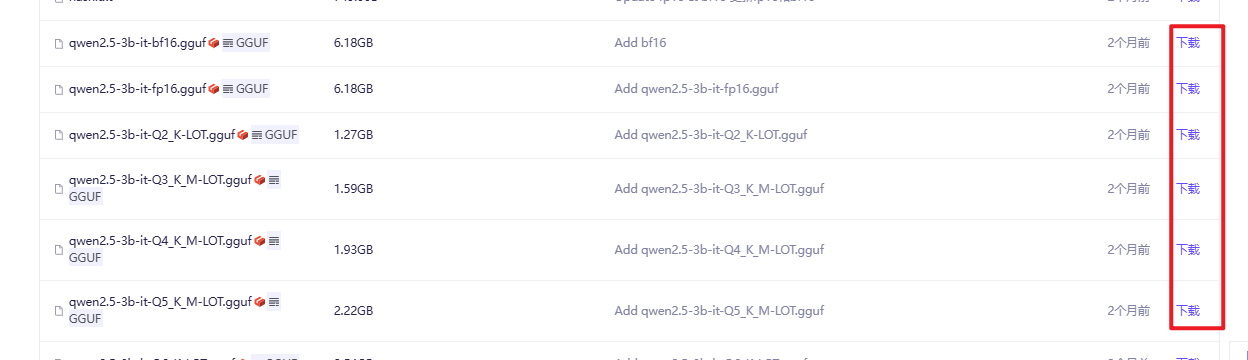

2.2 部分下载

部分下载可以点击每个文件最右边的下载按钮,下载想要的大语言模型文件,放到自定义位置新建路径models\Publisher\Repository的Repository文件夹下。

三、加载模型

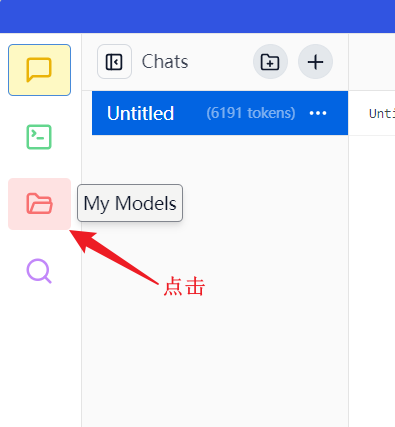

1. 打开LM Studio图形化界面,点击My Models

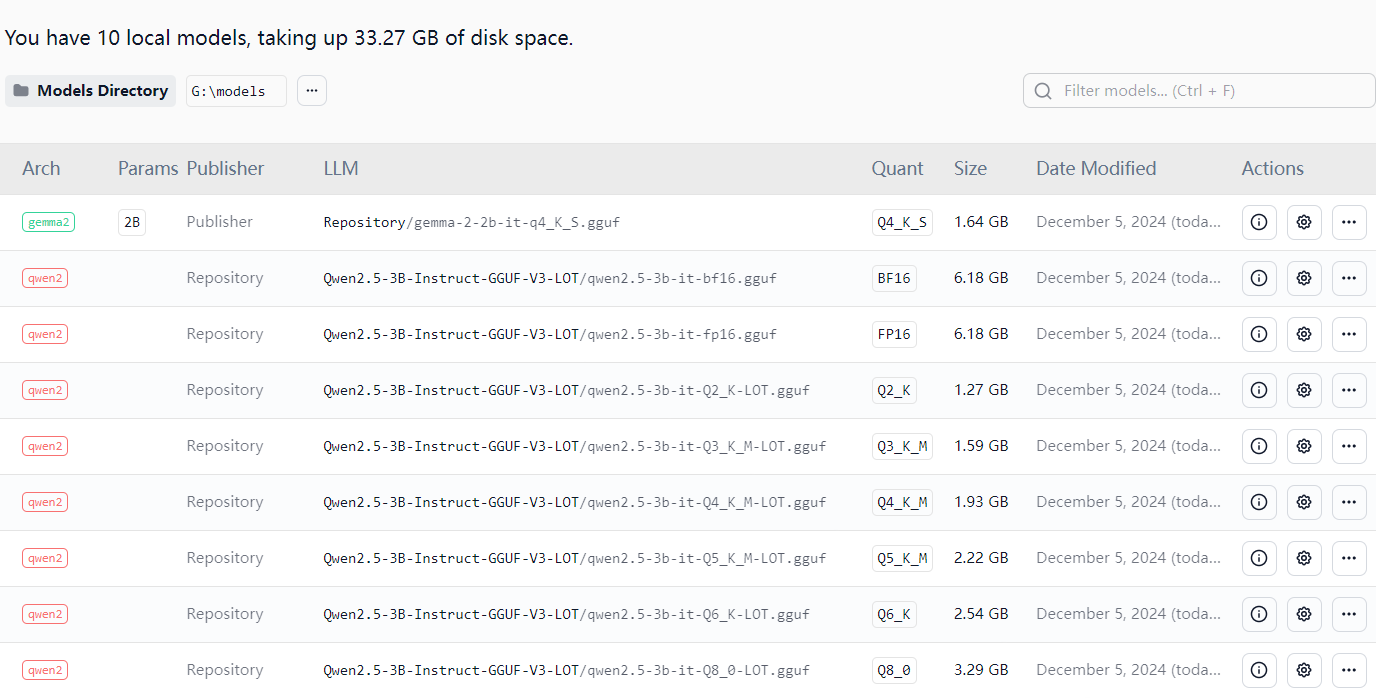

2. 然后,点击“…”,选择“change”,选择刚下载好的存储模型的models文件夹

选择之后,顺利的话,会自动识别出语言模型,显示在下面。

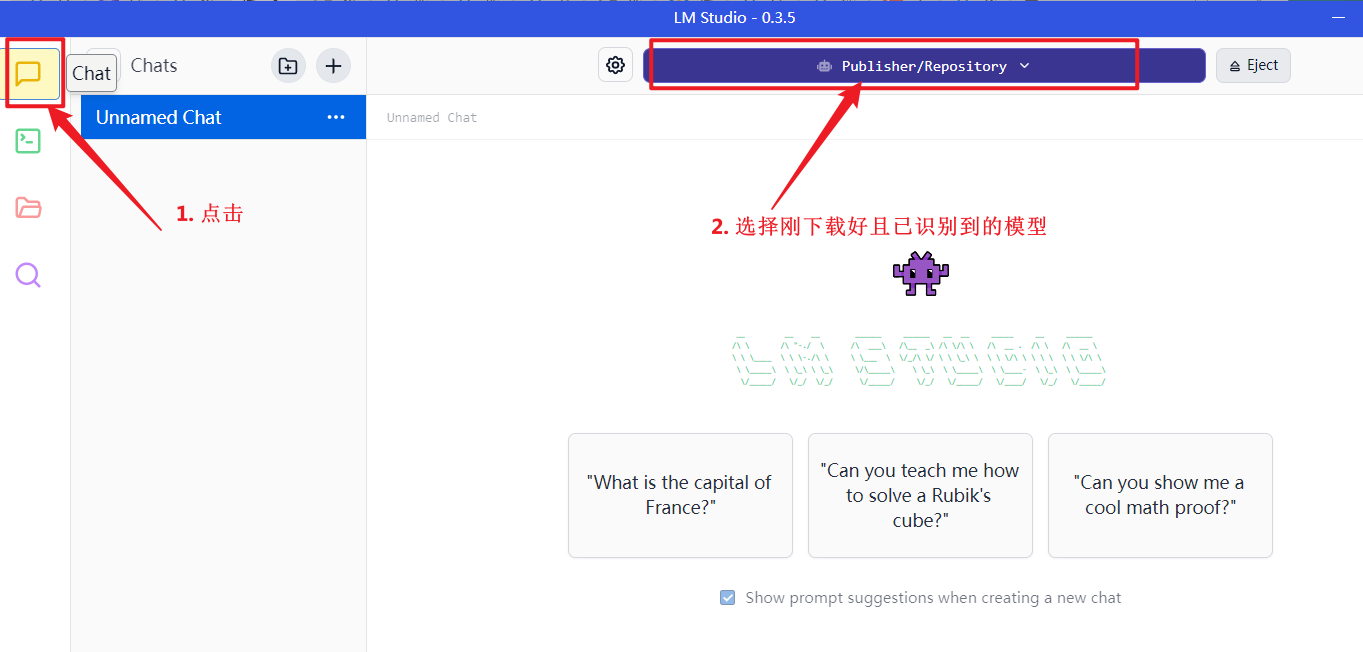

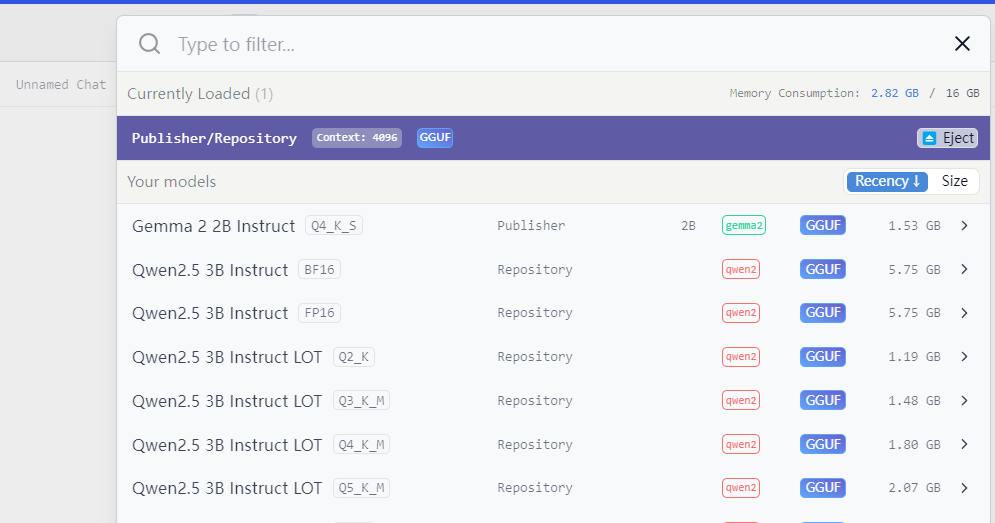

3. 选择要使用的模型

点击“chat”,然后在上面选择一个你想使用的模型。

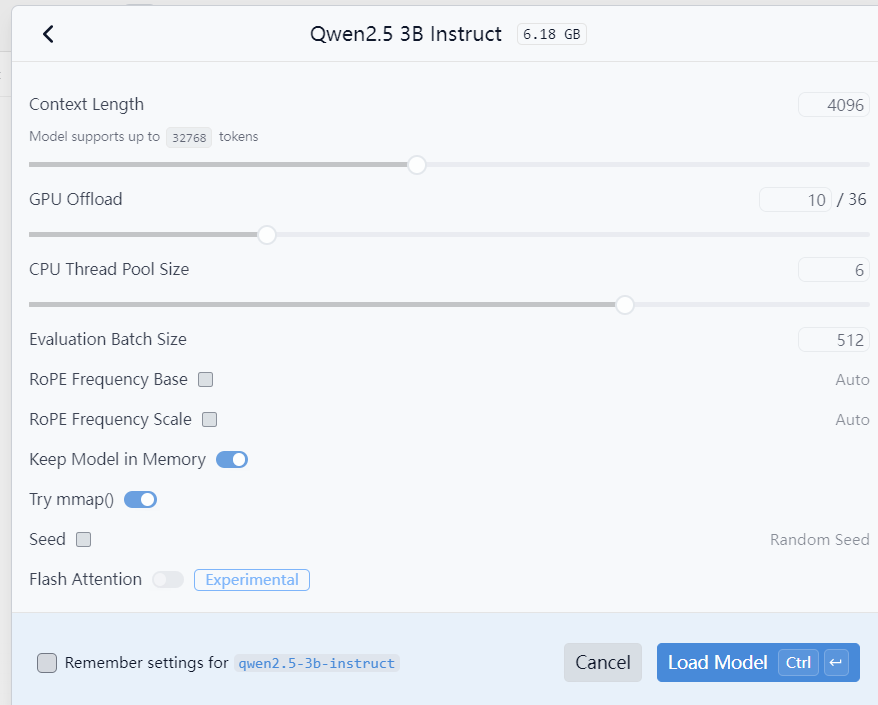

然后回出现一些自定义参数配置,通常默认即可,你也可以自己调参数。然后点击右下角的“Load Model”。

四、开启学习之旅

现在,离线的语言模型就部署好啦,可以开启学习之旅啦。

如果本文对你有一点点帮助,可以为我点个免费的赞,支持一下嘛,也期待你的评论和关注哦。^_^

6159

6159

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?