import java.util.Properties;

import java.util.concurrent.Future;

import org.apache.kafka.clients.producer.Callback;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.clients.producer.RecordMetadata;

import org.apache.kafka.common.serialization.StringSerializer;

public class Producer {

public static void main(String[] args) {

Properties properties = new Properties();

// bootstrap.servers kafka集群地址 host1:port1,host2:port2 …

properties.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, “127.0.0.1:9092”);

// key.deserializer 消息key序列化方式

properties.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

// value.deserializer 消息体序列化方式

properties.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

KafkaProducer<String, String> producer = new KafkaProducer<>(properties);

// 0 异步发送消息

for (int i = 0; i < 10; i++) {

String data = “async :” + i;

// 发送消息

producer.send(new ProducerRecord<>(“demo-topic”, data));

}

// 1 同步发送消息 调用get()阻塞返回结果

for (int i = 0; i < 10; i++) {

String data = "sync : " + i;

try {

// 发送消息

Future send = producer.send(new ProducerRecord<>(“demo-topic”, data));

RecordMetadata recordMetadata = send.get();

System.out.println(recordMetadata);

} catch (Exception e) {

e.printStackTrace();

}

}

// 2 异步发送消息 回调callback()

for (int i = 0; i < 10; i++) {

String data = "callback : " + i;

// 发送消息

producer.send(new ProducerRecord<>(“demo-topic”, data), new Callback() {

@Override

public void onCompletion(RecordMetadata metadata, Exception exception) {

// 发送消息的回调

if (exception != null) {

exception.printStackTrace();

} else {

System.out.println(metadata);

}

}

});

}

producer.close();

}

}

Consumer端demo代码:

package kafka;

import org.apache.kafka.clients.consumer.ConsumerConfig;

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.ConsumerRecords;

import org.apache.kafka.clients.consumer.KafkaConsumer;

import org.apache.kafka.common.serialization.StringDeserializer;

import java.time.Duration;

import java.util.Arrays;

import java.util.Properties;

public class Consumer {

public static void main(String[] args) {

Properties properties = new Properties();

//bootstrap.servers kafka集群地址 host1:port1,host2:port2 …

properties.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG, “127.0.0.1:9092”);

// key.deserializer 消息key序列化方式

properties.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

// value.deserializer 消息体序列化方式

properties.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

// group.id 消费组id

properties.put(ConsumerConfig.GROUP_ID_CONFIG, “demo-group”);

// enable.auto.commit 设置自动提交offset

properties.put(ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG, true);

// auto.offset.reset

properties.put(ConsumerConfig.AUTO_OFFSET_RESET_CONFIG, “earliest”);

KafkaConsumer<String, String> consumer = new KafkaConsumer<>(properties);

String[] topics = new String[]{“demo-topic”};

consumer.subscribe(Arrays.asList(topics));

while (true) {

ConsumerRecords<String, String> records = consumer.poll(Duration.ofMillis(100));

for (ConsumerRecord<String, String> record : records) {

System.out.println(record);

}

}

}

}

Libkafka examples:

https://github.com/edenhill/librdkafka/tree/master/examples

可能会用到Python的kafka客户端:

https://github.com/Parsely/pykafka

安装pykafka客户端模块

$ pip install pykafka

初始化客户端对象

from pykafka import KafkaClient

client = KafkaClient(hosts=“127.0.0.1:9092,127.0.0.1:9093,…”)

TLS(https连接)

from pykafka import KafkaClient, SslConfig

config = SslConfig(cafile=‘/your/ca.cert’,

… certfile=‘/your/client.cert’, # optional

… keyfile=‘/your/client.key’, # optional

… password=‘unlock my client key please’) # optional

client = KafkaClient(hosts=“127.0.0.1:,…”,

… ssl_config=config)

监听topic

client.topics

topic = client.topics[‘my.test’]

往topic发送消息,这里是同步发送的,需要等待消息确认才能发送下一条

with topic.get_sync_producer() as producer:

… for i in range(4):

… producer.produce('test message ’ + str(i ** 2))

为了提高吞吐量, 推荐Producer采用异步发送消息模式 ,produce()函数被调用后会立即返回

with topic.get_producer(delivery_reports=True) as producer:

… count = 0

… while True:

… count += 1

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

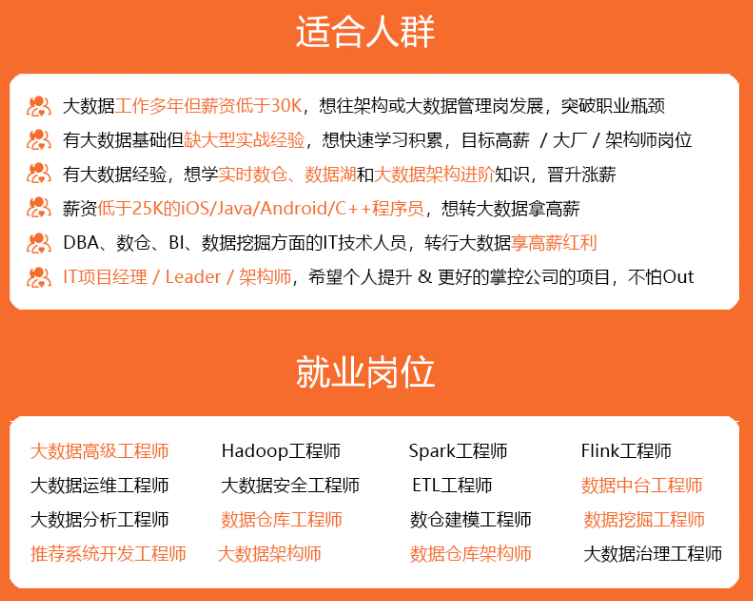

深知大多数大数据工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

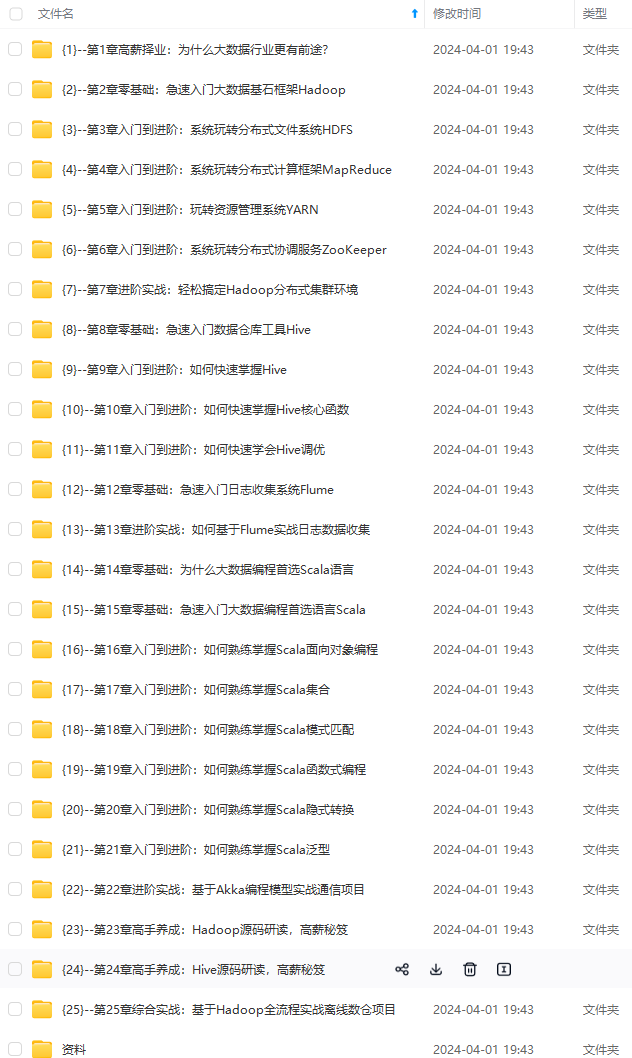

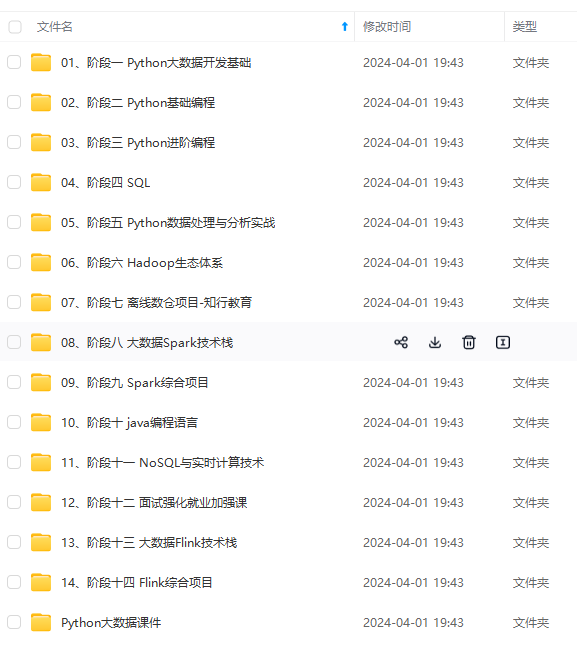

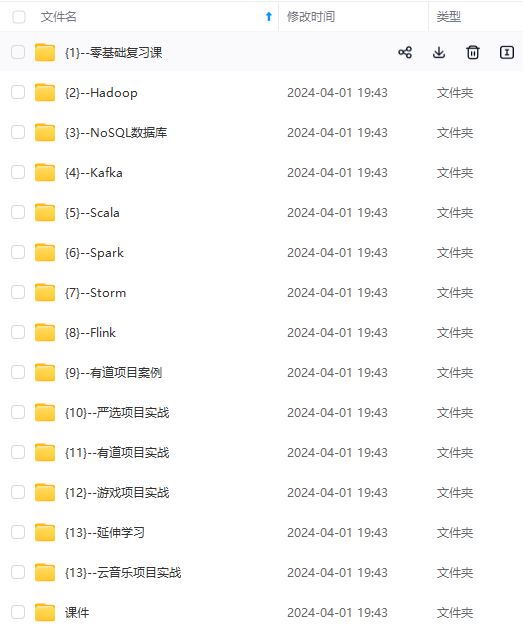

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!

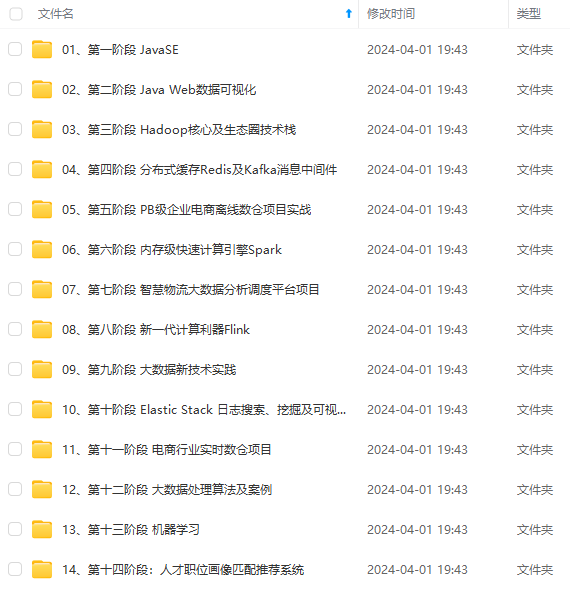

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

g-VYmB0Rcg-1713020319156)]

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)

[外链图片转存中…(img-7Fj91VQE-1713020319157)]

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

769

769

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?