-

编写爬虫文件(pictures.py)

-

修改配置文件settings.py

-

修改管道文件pipelines.py用于下载图片

-

编写爬虫启动文件begin.py

-

最终目录树

-

项目运行

-

爬取结果

-

后记

Scrapy是一个适用爬取网站数据、提取结构性数据的应用程序框架,它可以通过定制化的修改来满足不同的爬虫需求。本项目利用Scrapy 框架下载精美壁纸图片,爬取网站为“美桌壁纸”。

项目创建

首先在终端创建项目

win4000为项目名

$ scrapy startproject win4000

该命令将创建下述项目目录。

项目预览

查看项目目录

-

win4000

-

win4000

-

spiders

-

__init__.py

-

__init__.py

-

items.py

-

middlewares.py

-

pipelines.py

-

settings.py

-

scrapy.cfg

创建爬虫文件

进入spiders文件夹,根据模板文件创建爬虫文件

$ cd win4000/win4000/spiders

pictures 为 爬虫名

$ scrapy genspider pictures “win4000.com”

项目组件介绍

-

引擎(Scrapy):核心组件,处理系统的数据流处理,触发事务。

-

调度器(Scheduler):用来接受引擎发出的请求, 压入队列中, 并在引擎再次请求的时候返回。由URL组成的优先队列, 由它来决定下一个要抓取的网址是什么,同时去除重复的网址。

-

下载器(Downloader):用于下载网页内容, 并将网页内容返回给Spiders。

-

爬虫(Spiders):用于从特定的网页中提取自己需要的信息, 并用于构建实体(Item),也可以从中提取出链接,让Scrapy继续抓取下一个页面

-

管道(Pipeline):负责处理Spiders从网页中抽取的实体,主要的功能是持久化实体、验证实体的有效性、清除不需要的信息。当页面被Spiders解析后,将被发送到项目管道。

-

下载器中间件(Downloader Middlewares):位于Scrapy引擎和下载器之间的框架,主要是处理Scrapy引擎与下载器之间的请求及响应。

-

爬虫中间件(Spider Middlewares):介于Scrapy引擎和爬虫之间的框架,主要工作是处理Spiders的响应输入和请求输出。

-

调度中间件(Scheduler Middewares):介于Scrapy引擎和调度之间的中间件,从Scrapy引擎发送到调度的请求和响应。

Scrapy爬虫流程介绍

Scrapy基本爬取流程可以描述为UR2IM(URL-Request-Response-Item-More URL):

-

引擎从调度器中取出一个链接(URL)用于接下来的抓取;

-

引擎把URL封装成一个请求(Request)传给下载器;

-

下载器把资源下载下来,并封装成应答包(Response);

-

爬虫解析Response;

-

解析出实体(Item),则交给实体管道进行进一步的处理;

-

解析出的是链接(URL),则把URL交给调度器等待抓取。

页面结构分析

- 首先查看目标页面,可以看到包含多个主题,选取感兴趣主题,本项目以“风景”为例(作为练习,也可以通过简单修改,来爬取所有模块内图片)。

- 在“风景”分类页面,可以看到每页包含多个专题,利用开发者工具,可以查看每个专题的URL,拷贝相应XPath,利用Xpath的规律性,构建循环,用于爬取每个专题内容。

查看不同专题的XPath

/html/body/div[3]/div/div[3]/div[1]/div[1]/div[2]/div/div/ul/li[1]/a

/html/body/div[3]/div/div[3]/div[1]/div[1]/div[2]/div/div/ul/li[2]/a

利用上述结果,可以看到li[index]中index为专题序列。因此可以构建Xpath列表如下:

item_selector = response.xpath(‘/html/body/div[3]/div/div[3]/div[1]/div[1]/div[2]/div/div/ul/li/a/@href’)

- 利用开发者工具,可以查看下一页的URL,拷贝相应XPath用于爬取下一页内容。

查看“下一页”的XPath

/html/body/div[3]/div/div[3]/div[1]/div[2]/div/a[5]

因此可以构建如下XPath:

next_selector = response.xpath(‘//a[@class=“next”]’)

- 点击进入专题,可以看到具体图片,通过查看图片XPath,用于获取图片地址。

构建图片XPath

response.xpath(‘/html/body/div[3]/div/div[2]/div/div[2]/div[1]/div/a/img/@src’).extract_first()

- 可以通过标题和图片序列构建图片名。

利用序号XPath构建图片在列表中的序号

index = response.xpath(‘/html/body/div[3]/div/div[2]/div/div[1]/div[1]/span/text()’).extract_first()

利用标题XPath构建图片标题

title = response.xpath(‘/html/body/div[3]/div/div[2]/div/div[1]/div[1]/h1/text()’).extract_first()

利用图片标题title和序号index构建图片名

name = title + ‘_’ + index + ‘.jpg’

- 同时可以看到,在专题页面下,包含了多张图片,可以通过点击“下一张”按钮来获取下一页面URL,此处为了简化爬取过程,可以通过观察URL规律来构建每一图片详情页的URL,来下载图片。

第一张图片详情页地址

http://www.win4000.com/wallpaper_detail_45401.html

第二张图片详情页地址

http://www.win4000.com/wallpaper_detail_45401_2.html

因此可以通过首页地址和图片序号来构建每一张图片详情页地址。

第一张图片详情页地址

first_url = response.url

图片总数

num = response.xpath(‘/html/body/div[3]/div/div[2]/div/div[1]/div[1]/em/text()’).extract_first()

num = int(num)

for i in range(2,num+1):

next_url = ‘.’.join(first_url.split(‘.’)[:-1]) + ‘_’ + str(i) + ‘.html’

定义Item字段(Items.py)

本项目用于下载图片,因此可以仅构建图片名和图片地址字段。

win4000/win4000/items.py

import scrapy

class Win4000Item(scrapy.Item):

define the fields for your item here like:

name = scrapy.Field()

url = scrapy.Field()

name = scrapy.Field()

编写爬虫文件(pictures.py)

代码详解见代码注释。

win4000/win4000/spiders/pictures.py

import scrapy

from win4000.items import Win4000Item

from urllib import parse

import time

class PicturesSpider(scrapy.Spider):

name = ‘pictures’

allowed_domains = [‘win4000.com’]

start_urls = [‘http://www.win4000.com/zt/fengjing.html’]

start_urls = [‘http://www.win4000.com/zt/fengjing.html’]

cookie用于模仿浏览器行为

cookie={

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

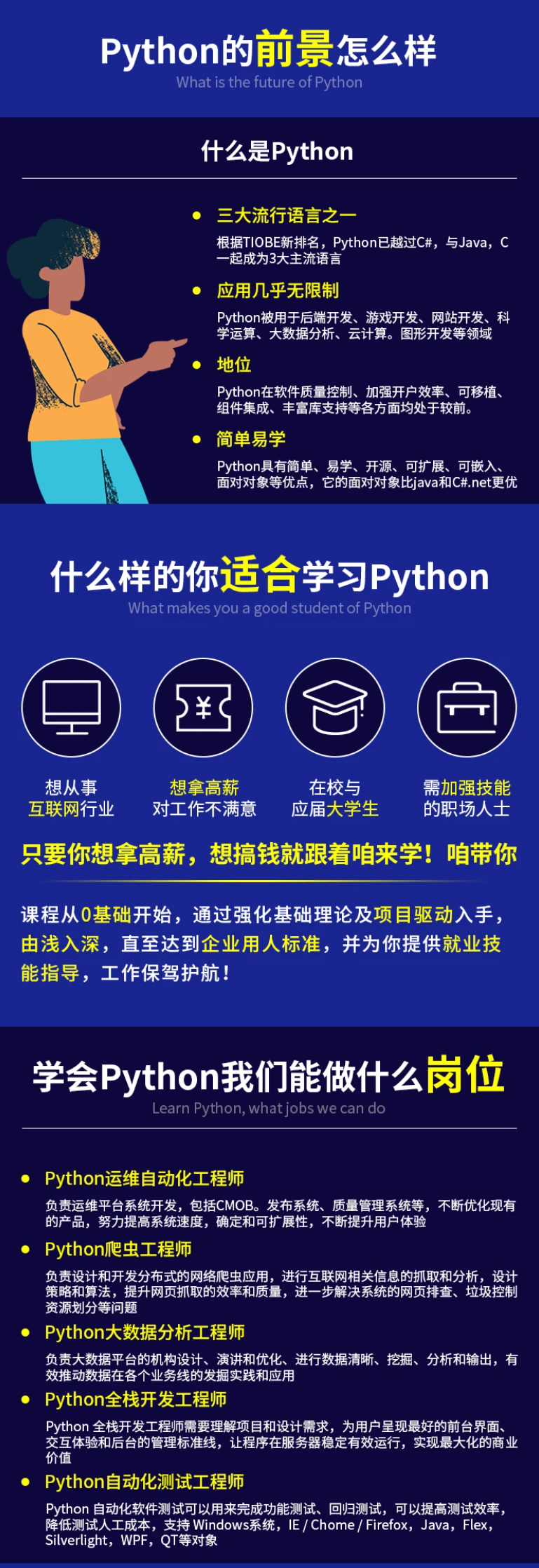

深知大多数Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Python开发知识点,真正体系化!

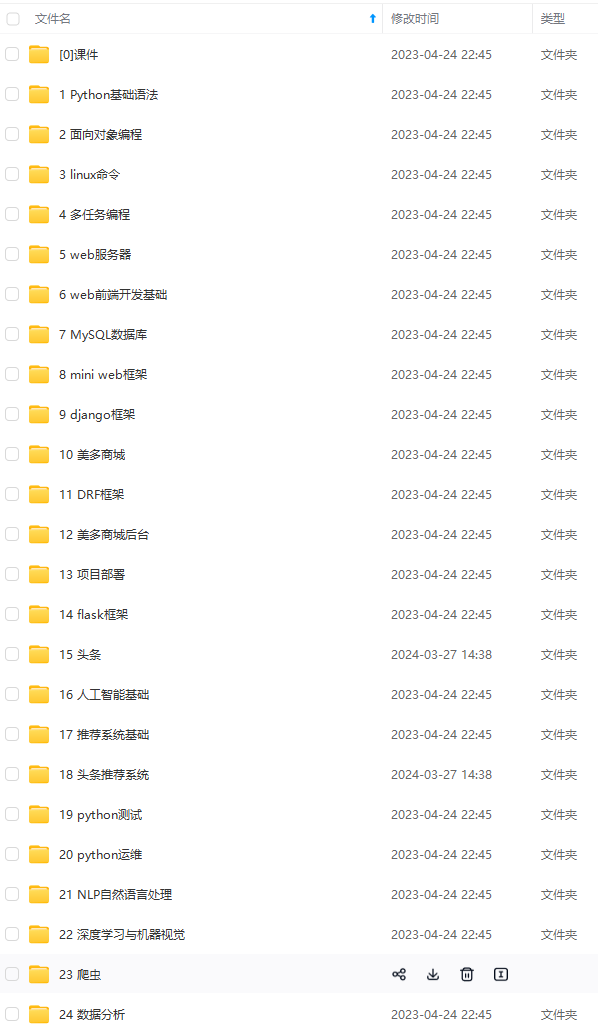

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加V获取:vip1024c (备注Python)

ng)

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Python开发知识点,真正体系化!

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加V获取:vip1024c (备注Python)

[外链图片转存中…(img-BoQjVc7k-1711797977539)]

569

569

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?