功能介绍

全天候监控:捡漏能够24小时不间断监控闲鱼平台,确保用户能第一时间发现低价商品。

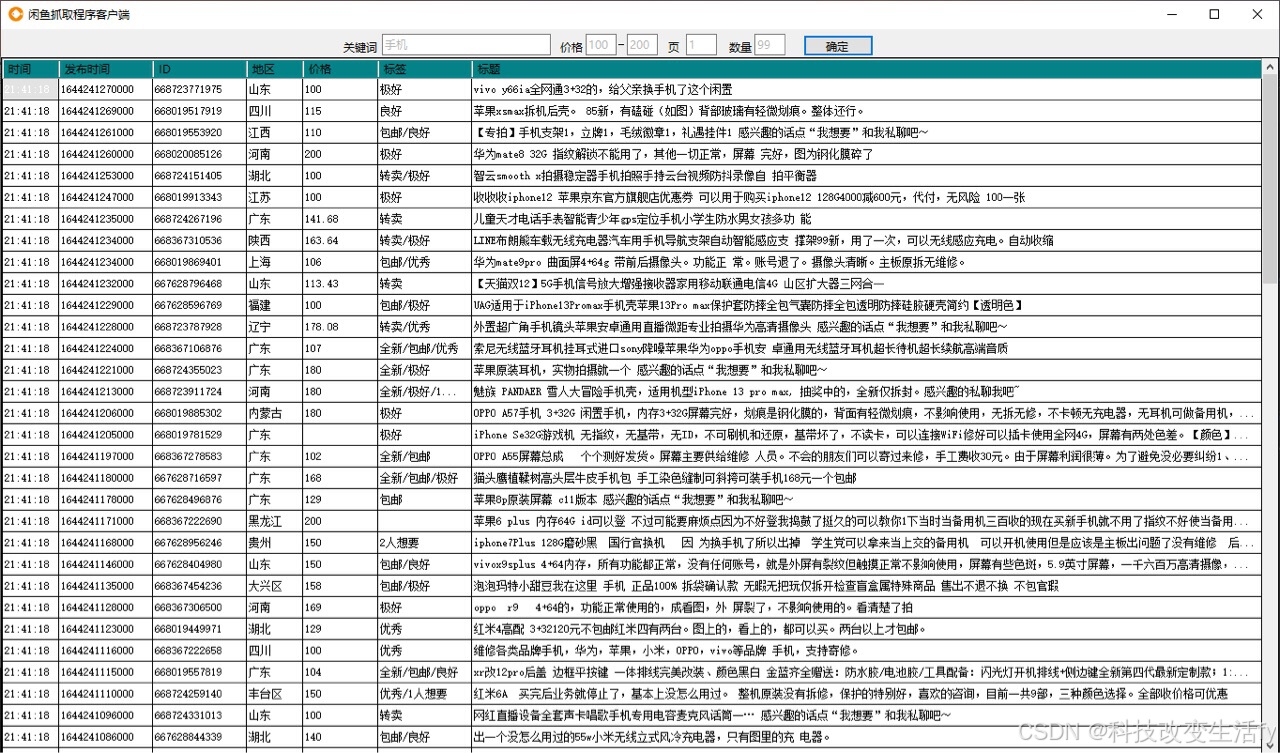

关键词自动捡漏:用户可以设置关键词,应用将自动筛选出含有这些关键词的低价商品。

尽情霸占发布者:一旦发现合适的商品,捡漏王能帮助用户迅速与发布者取得联系,提高交易成功率。

智能筛选商品:应用内置智能筛选机制,能过滤掉非目标商品,仅展示最符合用户需求的选项。

查看商品详细信息:用户可以快速查看商品的详细信息,帮助决策是否购买。

下单声音:捡漏王提供下单声音功能,在下单的时候有提醒。

钉钉推送:可以把目标商品推送到指定的钉钉上。

强聊:捡漏王重点强调其独特的服务功能,可以帮你和卖家无缝链接。

支持老板定制化需求:对于有特殊需求的商家,可提供定制化服务,满足不同用户的个性求。

2293

2293

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?