1.Hadoop

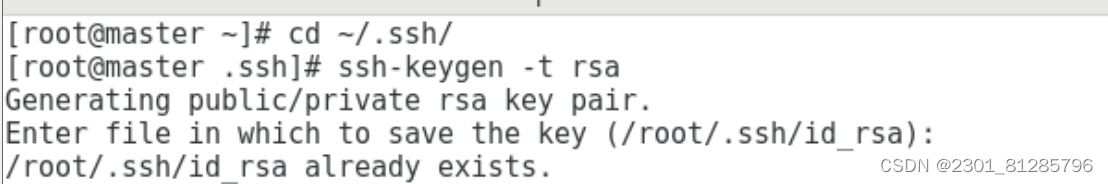

进入到ssh目录下输入ssh-keygen -t ras

将密钥加入到授权中

![]()

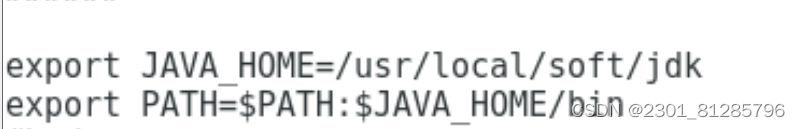

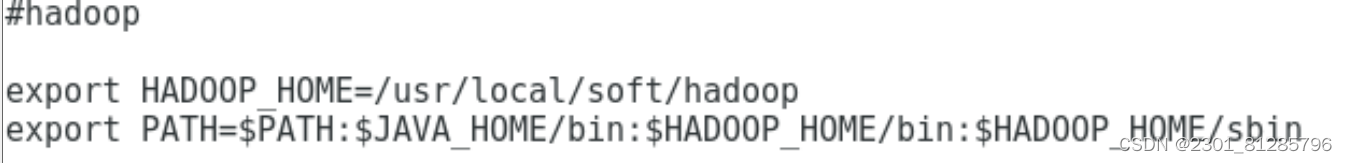

编写配置文件/etc/profile

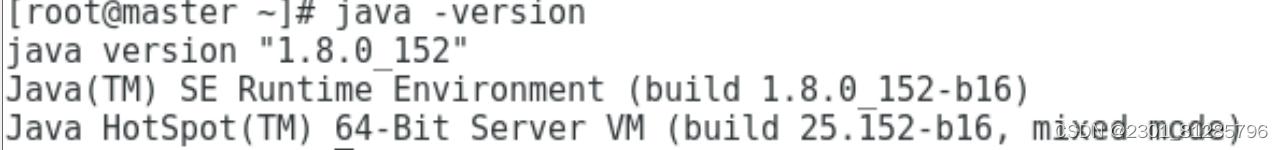

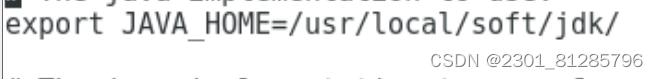

查看java环境

配置Java的环境文件

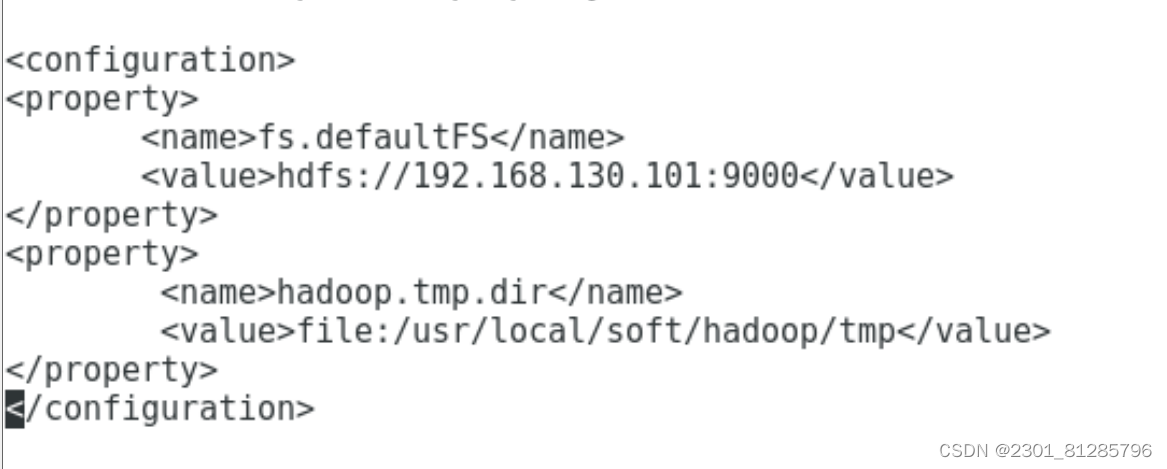

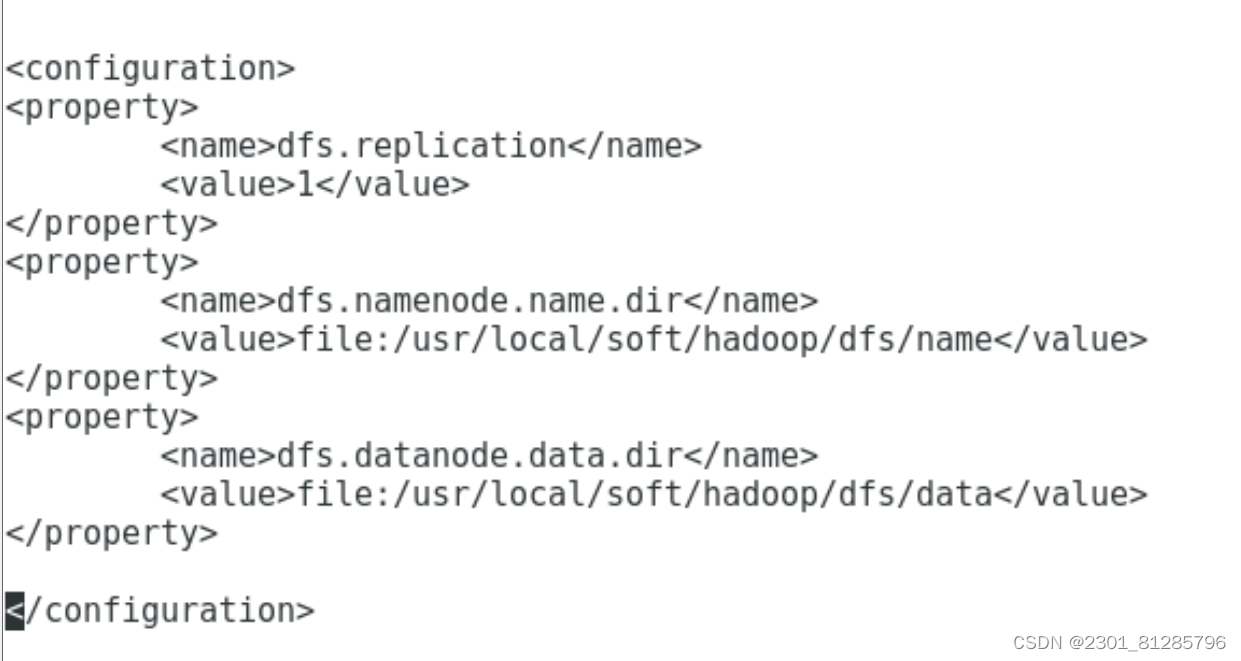

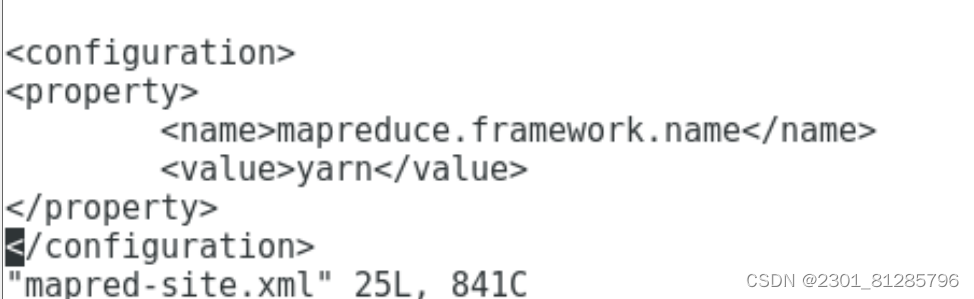

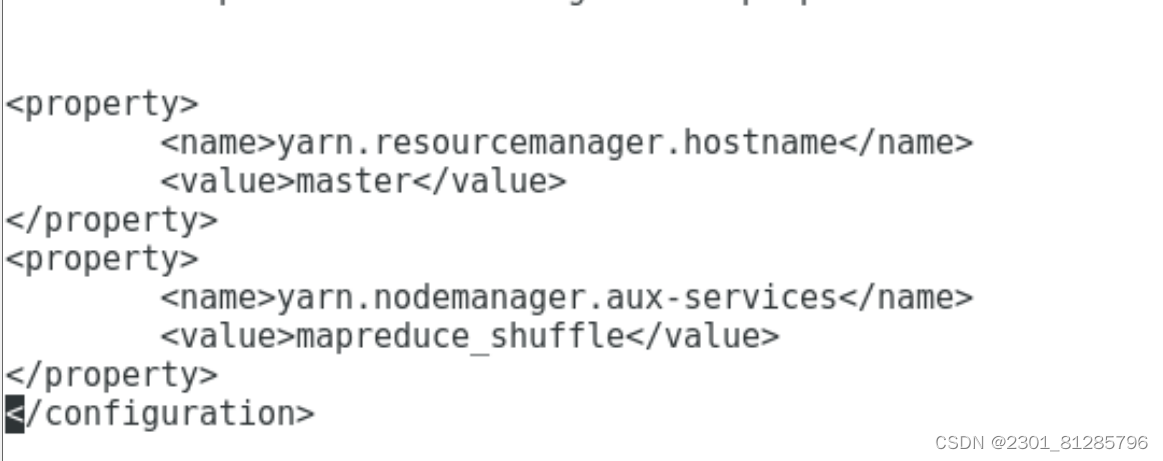

分别修改配置文件core-site.xml和hdfs-site.xml 以及mapred和yarn

修改/etc/profile的环境配置

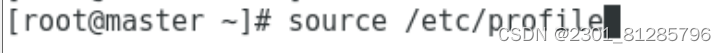

输入命令使环境变量生效

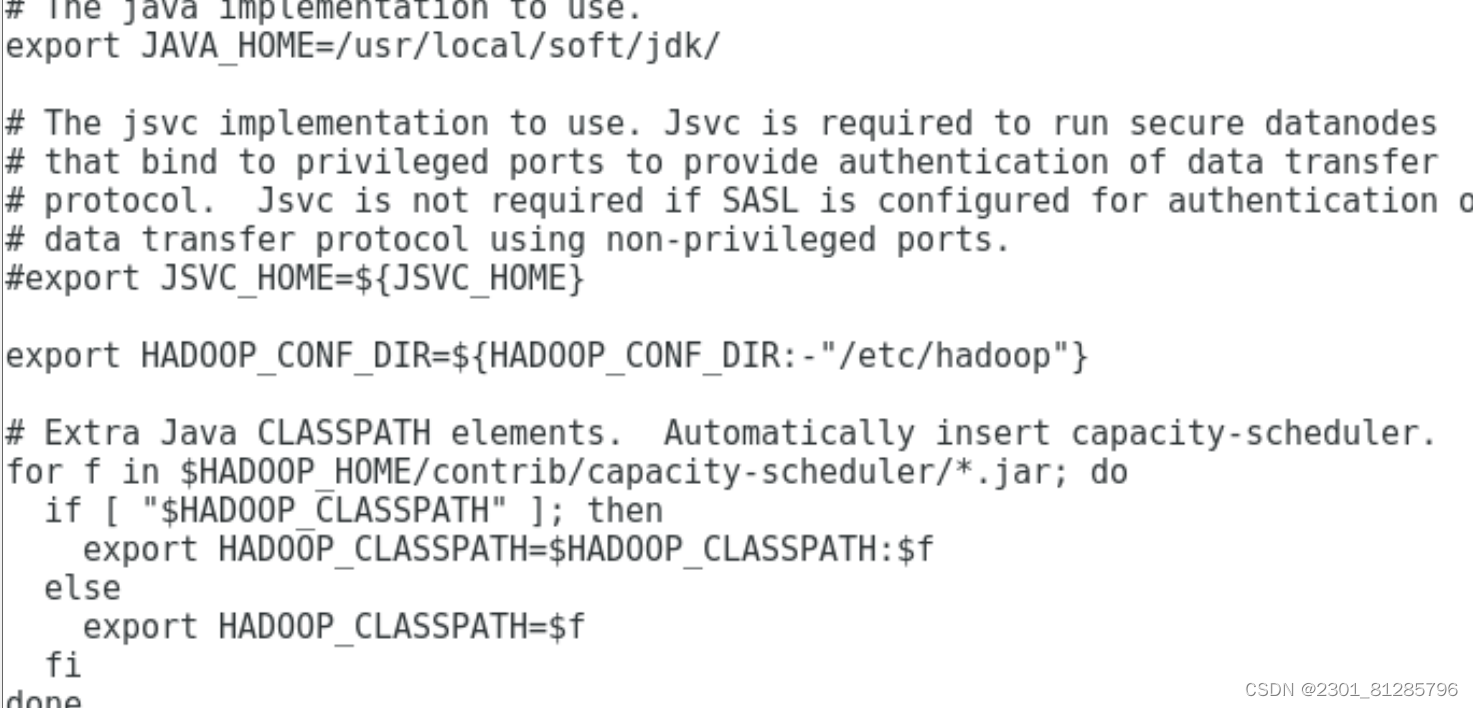

修改hadoop-env.sh的配置文件

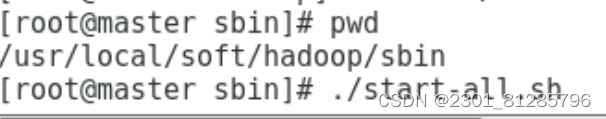

到Hadoop的sbin目录启动Hadoop

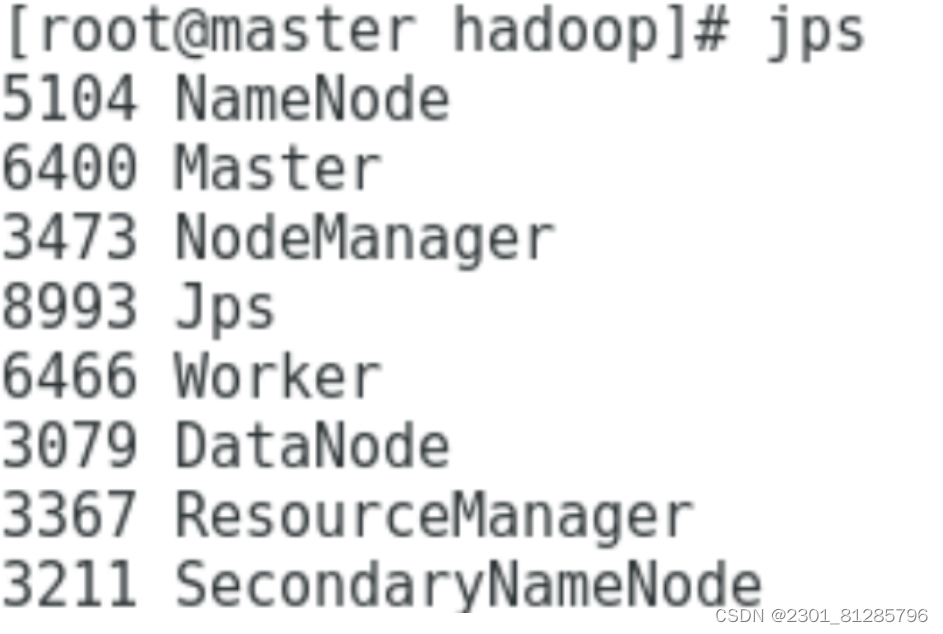

验证jps进程

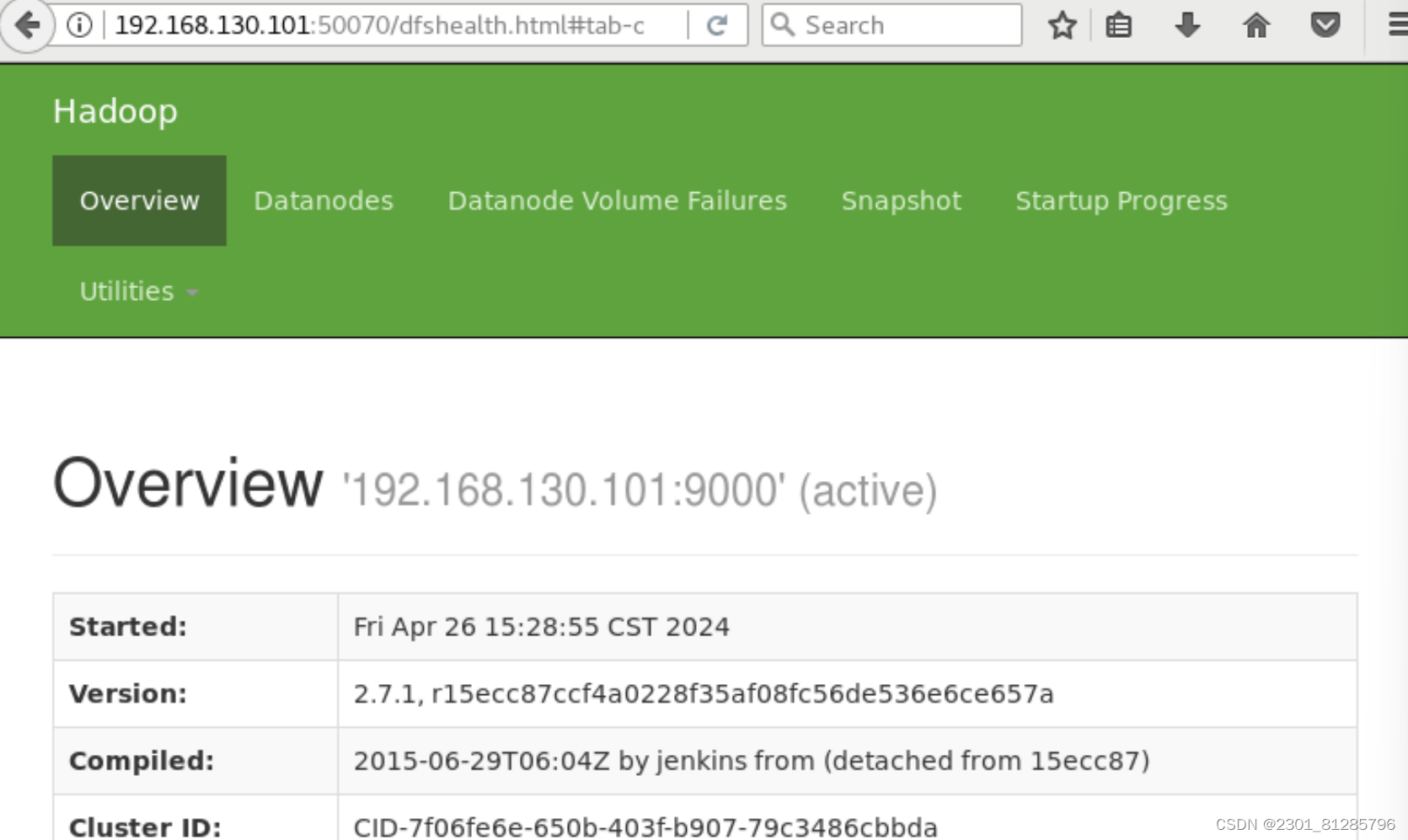

验证hdfs进入到网页查看

2.spark

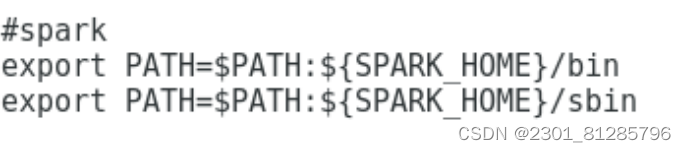

编写/etc/profile的配置文件

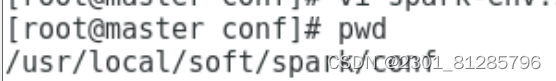

进入到相应目录下

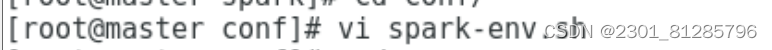

进入到spark-env.sh配置文件中编写目录

进入到slaves写入名字

vi /etc/slaves

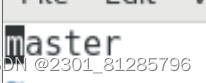

输入jps查看进程

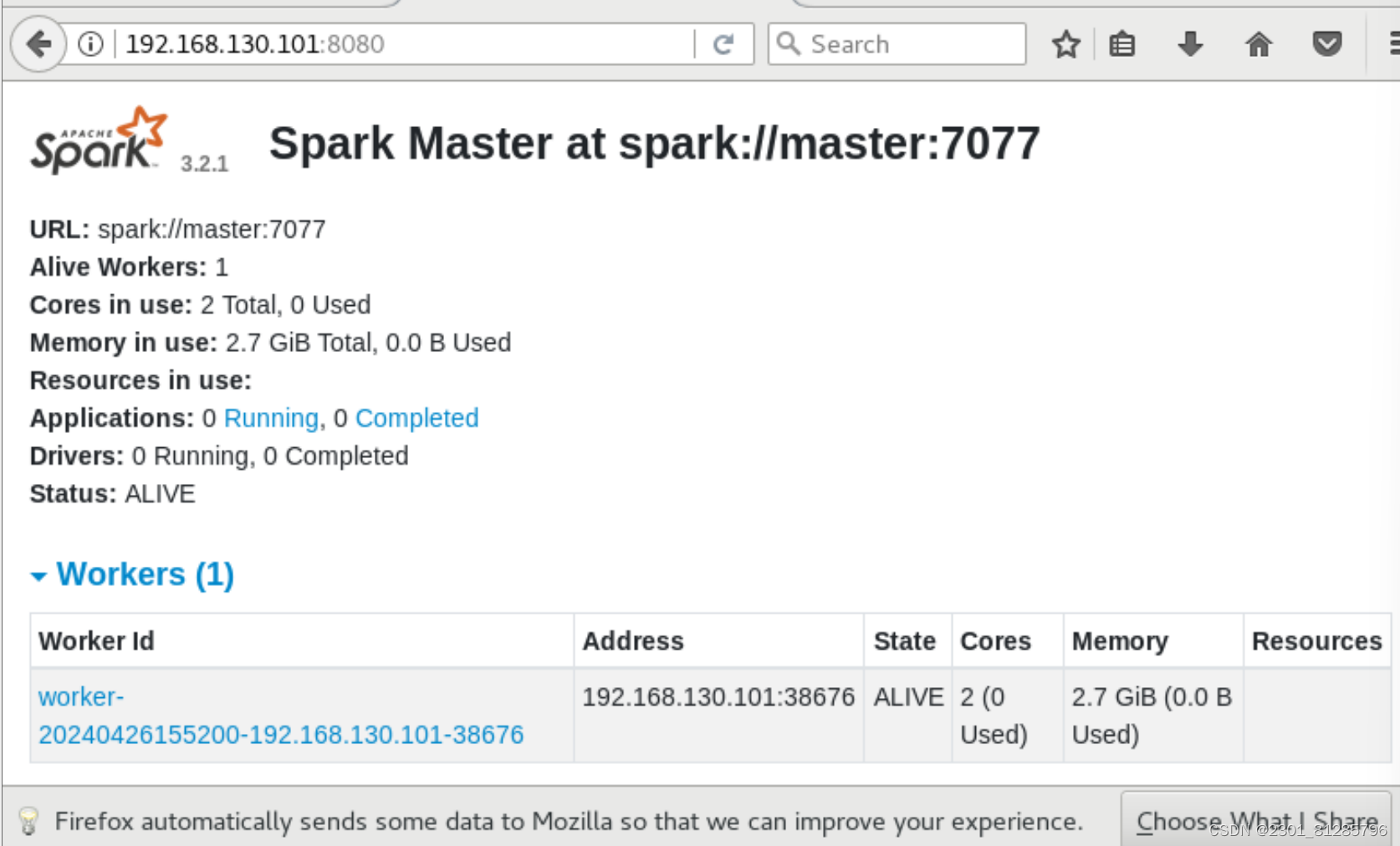

进入网页查看

3.spark-shell

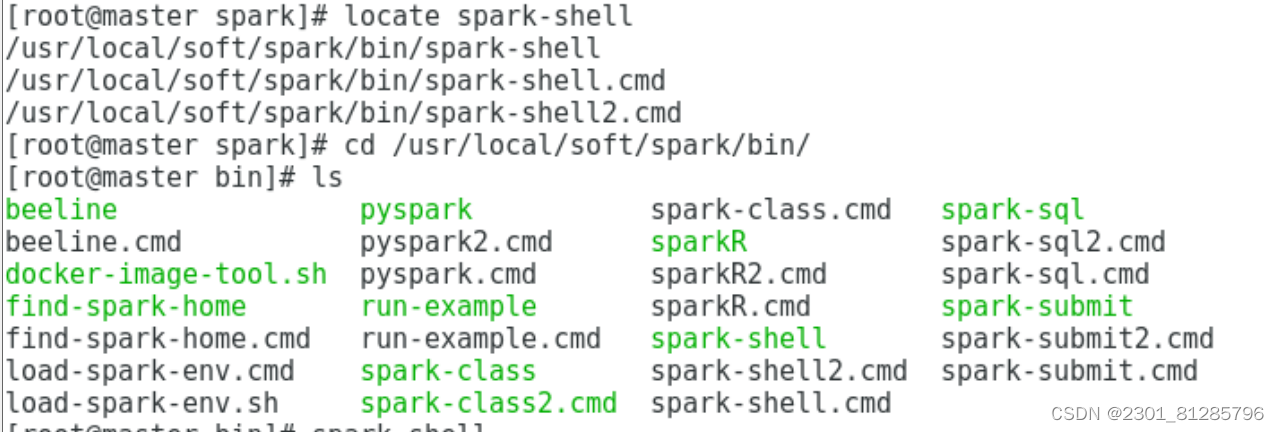

到指定目录下打开spark

输入命令(无语输了半天spark-shell要输./spark-shell)

4.scala

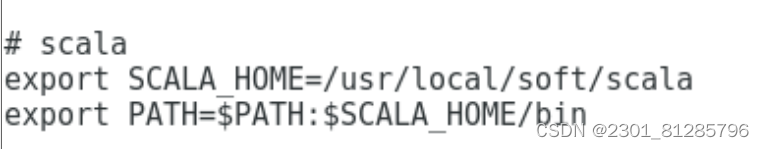

进入到/etc/profile编写配置文件

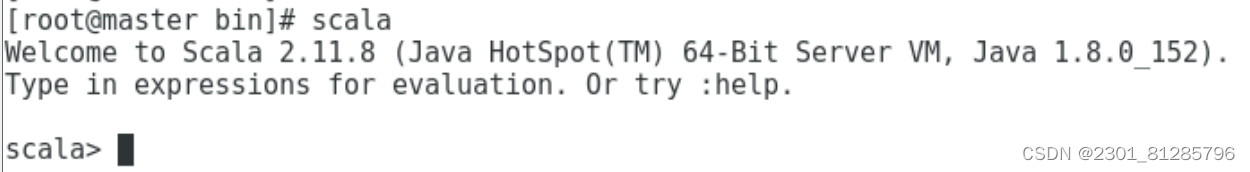

输入命令scala即可进入

886

886

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?