3.1 代码

3.2 结果

4 案例2

4.1 案例——数据

4.2 代码

4.3 结果

4.4 拓展&&改进

5 参考

1 概述

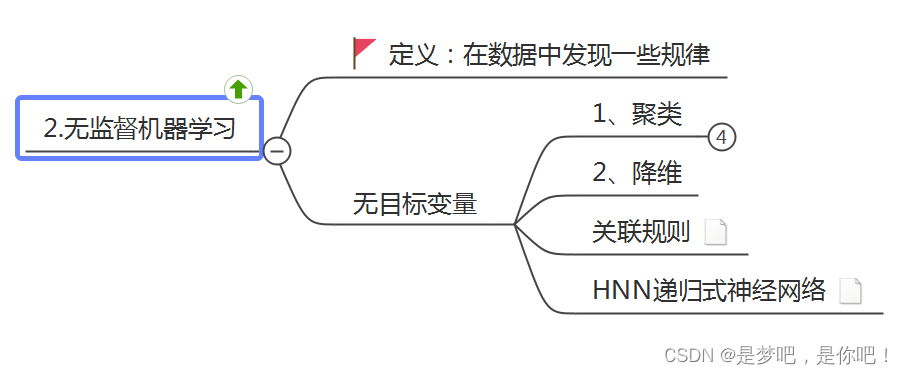

(1)无监督学习

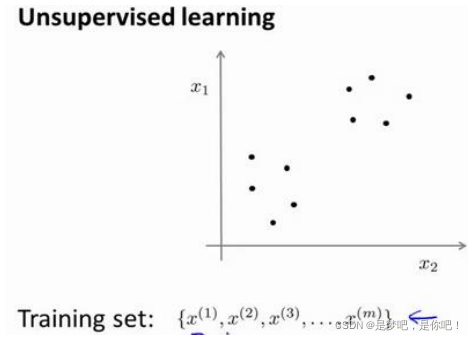

在一个典型的监督学习中,我们有一个有标签的训练集,我们的目标是找到能够区分正

样本和负样本的决策边界,在这里的监督学习中,我们有一系列标签,我们需要据此拟合一

个假设函数。与此不同的是,在非监督学习中,我们的数据没有附带任何标签,我们拿到的

数据就是这样的:

在这里我们有一系列点,却没有标签。因此,我们的训练集可以写成只有

我们没有任何标签?。因此,图上画的这些点没有标签信息。也就是说,在非监 督学习中,我们需要将一系列无标签的训练数据,输入到一个算法中,然后我们告诉这个算法,快去为我们找找这个数据的内在结构给定数据。我们可能需要某种算法帮助我们寻找一 种结构。图上的数据看起来可以分成两个分开的点集(称为簇), 一个能够找到我圈出的这 些点集的算法,就被称为聚类算法 。

这将是我们介绍的第一个非监督学习算法。当然,此后我们还将提到其他类型的非监督

学习算法,它们可以为我们找到其他类型的结构或者其他的一些模式,而不只是簇。

我们将先介绍聚类算法。此后,我们将陆续介绍其他算法。那么聚类算法一般用来做什

么呢?

比如市场分割。也许你在数据库中存储了许多客户的信息,而你希望将他们分成不同的客户群,这样你可以对不同类型的客户分别销售产品或者分别提供更适合的服务。社交网络分析:事实上有许多研究人员正在研究这样一些内容,他们关注一群人,关注社交网络,例如 Facebook , Google+,或者是其他的一些信息,比如说:你经常跟哪些人联系,而这些人又经常给哪些人发邮件,由此找到关系密切的人群。因此,这可能需要另一个聚类算法,你希望用它发现社交网络中关系密切的朋友。 研究这个问题,希望使用聚类算法来更好的组织计算机集群,或者更好的管理数据中心。因为如果你知道数据中心中,那些计算机经常协作工作。那么,你可以重新分配资源,重新布局网络。由此优化数据中心,优化数据通信。

最后,我实际上还在研究如何利用聚类算法了解星系的形成。然后用这个知识,了解一

些天文学上的细节问题。好的,这就是聚类算法。这将是我们介绍的第一个非监督学习算法,接下来,我们将开始介绍一个具体的聚类算法。

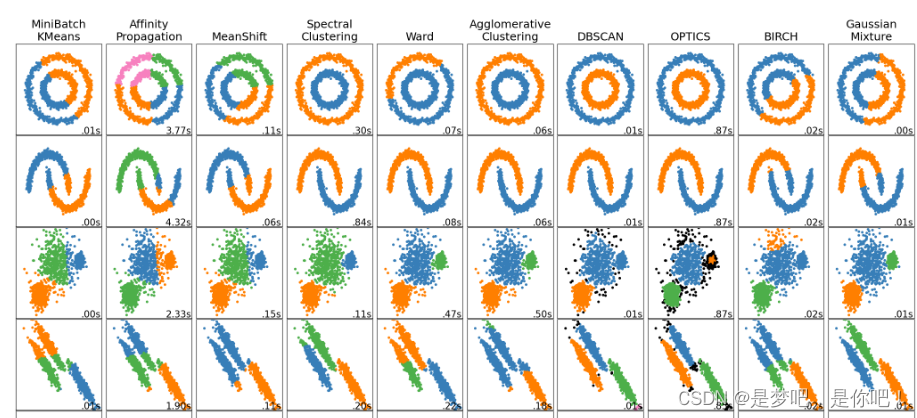

(2)聚类

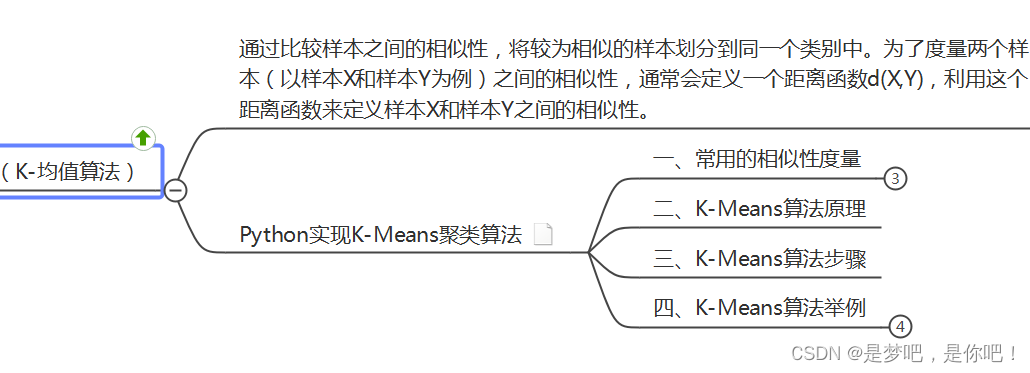

(3)K-Mean均值算法

2 K-Mean均值算法

2.1 引入

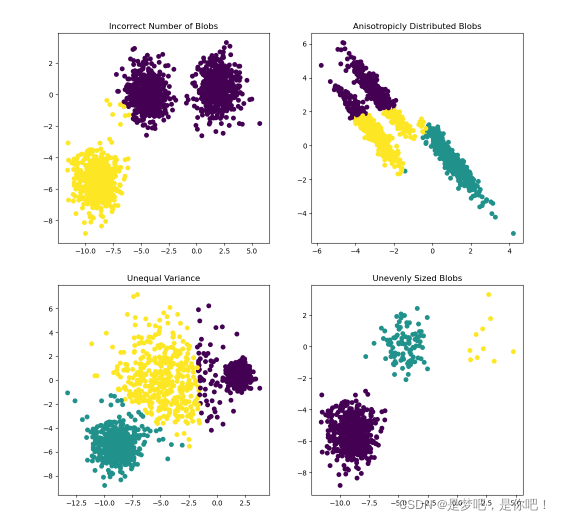

K- 均值 是最普及的聚类算法,算法接受一个未标记的数据集,然后将数据聚类成不同的

组

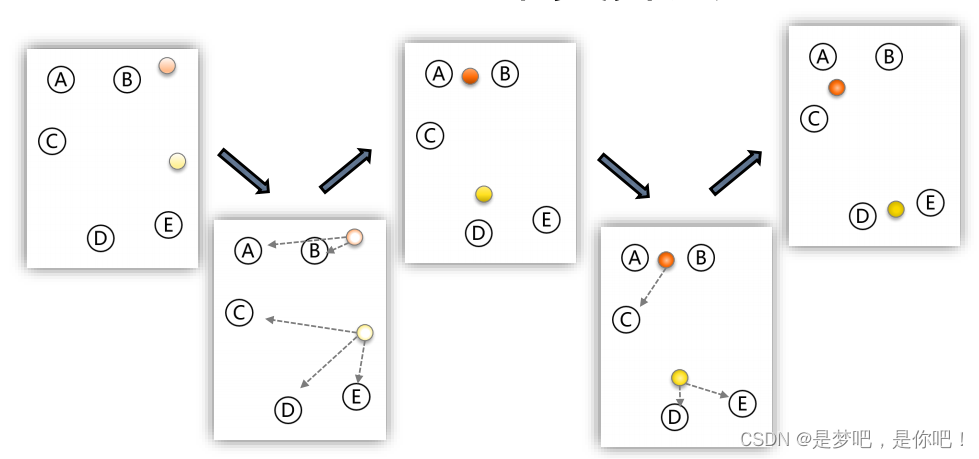

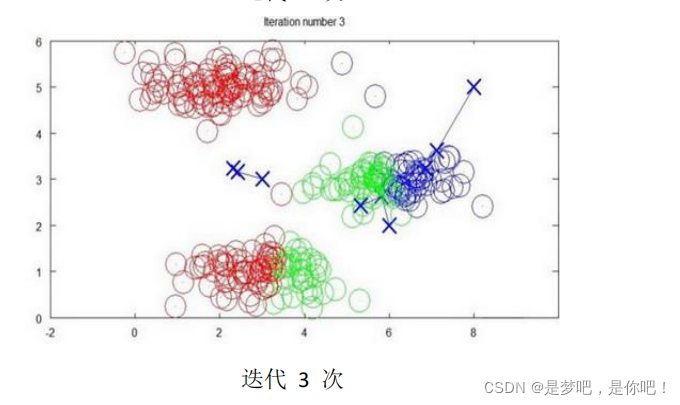

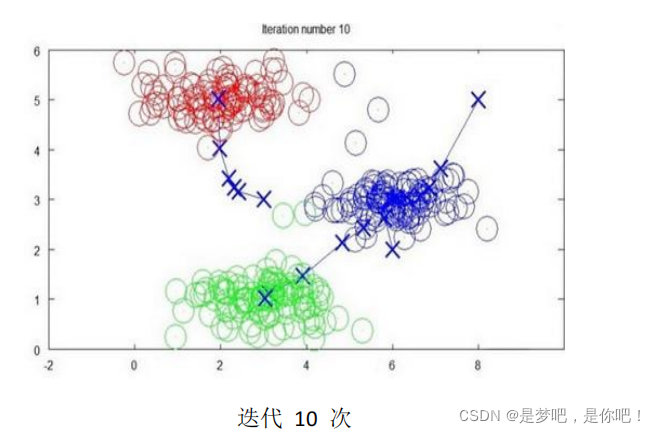

步骤:

- 设定 K 个类别的中心的初值;

- 计算每个样本到 K个中心的距离,按最近距离进行分类;

- 以每个类别中样本的均值,更新该类别的中心;

- 重复迭代以上步骤,直到达到终止条件(迭代次数、最小平方误差、簇中心点变化率)。

- 下面是一个聚类示例:

K-means聚类算法

K-****均值算法的伪代码如下:

Repeat {

for i = 1 to m

c(i) := index (form 1 to K) of cluster centroid closest to x(i)

for k = 1 to K

μk := average (mean) of points assigned to cluster k

}

算法分为两个步骤,第一个 for 循环是赋值步骤,即:对于每一个样例 i ,计算其应该属

于的类。第二个 for 循环是聚类中心的移动,即:对于每一个类K ,重新计算该类的质心。

from sklearn.cluster import KMeans # 导入 sklearn.cluster.KMeans 类

import numpy as np

X = np.array([[1,2], [1,4], [1,0], [10,2], [10,4], [10,0]])

kmCluster = KMeans(n_clusters=2).fit(X) # 建立模型并进行聚类,设定 K=2

print(“聚类中心坐标:”,kmCluster.cluster_centers_) # 返回每个聚类中心的坐标

print(“分类结果:”,kmCluster.labels_) # 返回样本集的分类结果

print(“显示预测判断:”,kmCluster.predict([[0, 0], [12, 3]])) # 根据模型聚类结果进行预测判断

聚类中心坐标: [[10. 2.]

[ 1. 2.]]

分类结果: [1 1 1 0 0 0]

显示预测判断: [1 0]

Process finished with exit code 0

2.2 针对大样本集的改进算法:Mini Batch K-Means

对于样本集巨大的问题,例如样本量大于 10万、特征变量大于100,K-Means算法耗费的速度和内存很大。SKlearn 提供了针对大样本集的改进算法 Mini Batch K-Means,并不使用全部样本数据,而是每次抽样选取小样本集进行 K-Means聚类,进行循环迭代。Mini Batch K-Means 虽然性能略有降低,但极大的提高了运行速度和内存占用。

from sklearn.cluster import MiniBatchKMeans # 导入 .MiniBatchKMeans 类

import numpy as np

X = np.array([[1,2], [1,4], [1,0], [4,2], [4,0], [4,4],

[4,5], [0,1], [2,2],[3,2], [5,5], [1,-1]])

fit on the whole data

mbkmCluster = MiniBatchKMeans(n_clusters=3,batch_size=6,max_iter=10).fit(X)

print(“聚类中心的坐标:”,mbkmCluster.cluster_centers_) # 返回每个聚类中心的坐标

print(“样本集的分类结果:”,mbkmCluster.labels_) # 返回样本集的分类结果

print(“显示判断结果:样本属于哪个类别:”,mbkmCluster.predict([[0,0], [4,5]])) # 根据模型聚类结果进行预测判断

聚类中心的坐标: [[ 2.55932203 1.76271186]

[ 0.75862069 -0.20689655]

[ 4.20588235 4.5 ]]

样本集的分类结果: [0 0 1 0 0 2 2 1 0 0 2 1]

显示判断结果:样本属于哪个类别: [1 2]

Process finished with exit code 0

2.3 图像

from sklearn.cluster import kmeans_plusplus

from sklearn.datasets import make_blobs

import matplotlib.pyplot as plt

Generate sample data

n_samples = 4000

n_components = 4

X, y_true = make_blobs(

n_samples=n_samples, centers=n_components, cluster_std=0.60, random_state=0

)

X = X[:, ::-1]

Calculate seeds from kmeans++

centers_init, indices = kmeans_plusplus(X, n_clusters=4, random_state=0)

Plot init seeds along side sample data

plt.figure(1)

colors = [“#4EACC5”, “#FF9C34”, “#4E9A06”, “m”]

for k, col in enumerate(colors):

cluster_data = y_true == k

plt.scatter(X[cluster_data, 0], X[cluster_data, 1], c=col, marker=“.”, s=10)

plt.scatter(centers_init[:, 0], centers_init[:, 1], c=“b”, s=50)

plt.title(“K-Means++ Initialization”)

plt.xticks([])

plt.yticks([])

plt.show()

3 案例1

3.1 代码

-- coding: utf-8 --

import numpy as np

import pandas as pd

from sklearn.cluster import KMeans, MiniBatchKMeans

def main():

读取数据文件

file = pd.read_excel(‘K-Means.xlsx’, header=0) # 首行为标题行

file = file.dropna() # 删除含有缺失值的数据

print(file.dtypes) # 查看 df 各列的数据类型

print(file.shape) # 查看 df 的行数和列数

print(file.head())

数据准备

z_scaler = lambda x:(x-np.mean(x))/np.std(x) # 定义数据标准化函数

dfScaler = file[[‘D1’,‘D2’,‘D3’,‘D4’,‘D5’,‘D6’,‘D7’,‘D8’,‘D9’,‘D10’]].apply(z_scaler) # 数据归一化

dfData = pd.concat([file[[‘地区’]], dfScaler], axis=1) # 列级别合并

df = dfData.loc[:,[‘D1’,‘D2’,‘D3’,‘D4’,‘D5’,‘D6’,‘D7’,‘D8’,‘D9’,‘D10’]] # 基于全部 10个特征聚类分析

df = dfData.loc[:,[‘D1’,‘D2’,‘D7’,‘D8’,‘D9’,‘D10’]] # 降维后选取 6个特征聚类分析

X = np.array(df) # 准备 sklearn.cluster.KMeans 模型数据

print(“Shape of cluster data:”, X.shape)

KMeans 聚类分析(sklearn.cluster.KMeans)

nCluster = 4

kmCluster = KMeans(n_clusters=nCluster).fit(X) # 建立模型并进行聚类,设定 K=4

print(“Cluster centers:\n”, kmCluster.cluster_centers_) # 返回每个聚类中心的坐标

print(“Cluster results:\n”, kmCluster.labels_) # 返回样本集的分类结果

整理聚类结果(太棒啦!)

listName = dfData[‘地区’].tolist() # 将 dfData 的首列 ‘地区’ 转换为 list

dictCluster = dict(zip(listName,kmCluster.labels_)) # 将 listName 与聚类结果关联,组成字典

listCluster = [[] for k in range(nCluster)]

for v in range(0, len(dictCluster)):

k = list(dictCluster.values())[v] # 第v个城市的分类是 k

listCluster[k].append(list(dictCluster.keys())[v]) # 将第v个城市添加到 第k类

print(“\n聚类分析结果(分为{}类):”.format(nCluster)) # 返回样本集的分类结果

for k in range(nCluster):

print(“第 {} 类:{}”.format(k, listCluster[k])) # 显示第 k 类的结果

return

if name == ‘main’:

main()

(1)python中apply函数python中apply函数")

(2)Pandas中DataFrame数据合并、连接(concat、merge、join)Pandas中DataFrame数据合并、连接(concat、merge、join)")

(3)Python pandas 中loc函数的意思及用法,及跟iloc的区别Python pandas 中loc函数的意思及用法,及跟iloc的区别")

(4)tolist函数 其他形式(数组或者矩阵等)转为列表形式tolist函数 其他形式(数组或者矩阵等)转为列表形式")

(5)利用zip函数将两个列表(list)组成字典(dict)利用zip函数将两个列表(list)组成字典(dict)")

3.2 结果

地区 D1 D2 D3 D4 D5 D6 D7 D8 D9 D10

0 北京 5.96 310 461 1557 931 319 44.36 2615 2.20 13631

1 上海 3.39 234 308 1035 498 161 35.02 3052 0.90 12665

2 天津 2.35 157 229 713 295 109 38.40 3031 0.86 9385

3 陕西 1.35 81 111 364 150 58 30.45 2699 1.22 7881

4 辽宁 1.50 88 128 421 144 58 34.30 2808 0.54 7733

Shape of cluster data: (30, 10)

Cluster centers:

[[-3.04626787e-01 -2.89307971e-01 -2.90845727e-01 -2.88480032e-01

-2.85445404e-01 -2.85283077e-01 -6.22770669e-02 1.12938023e-03

-2.71308432e-01 -3.03408599e-01]

[ 4.44318512e+00 3.97251590e+00 4.16079449e+00 4.20994153e+00

4.61768098e+00 4.65296699e+00 2.45321197e+00 4.02147595e-01

4.22779099e+00 2.44672575e+00]

[ 1.52987871e+00 2.10479182e+00 1.97836141e+00 1.92037518e+00

1.54974999e+00 1.50344182e+00 1.13526879e+00 1.13595799e+00

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上前端开发知识点,真正体系化!

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以扫码获取!!!(备注Python)

2638969016)]

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上前端开发知识点,真正体系化!

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以扫码获取!!!(备注Python)

264

264

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?