最后的话

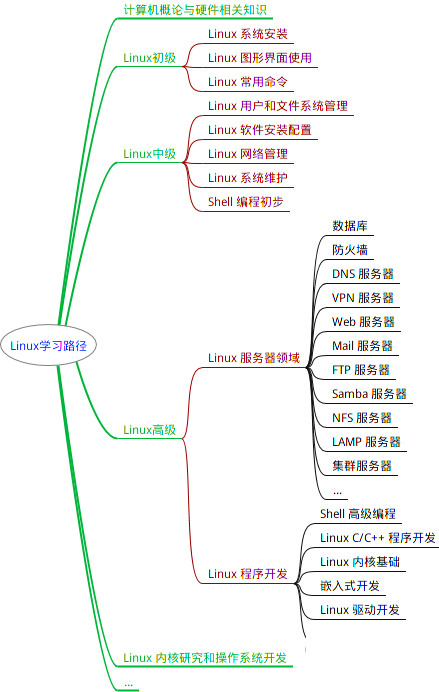

最近很多小伙伴找我要Linux学习资料,于是我翻箱倒柜,整理了一些优质资源,涵盖视频、电子书、PPT等共享给大家!

资料预览

给大家整理的视频资料:

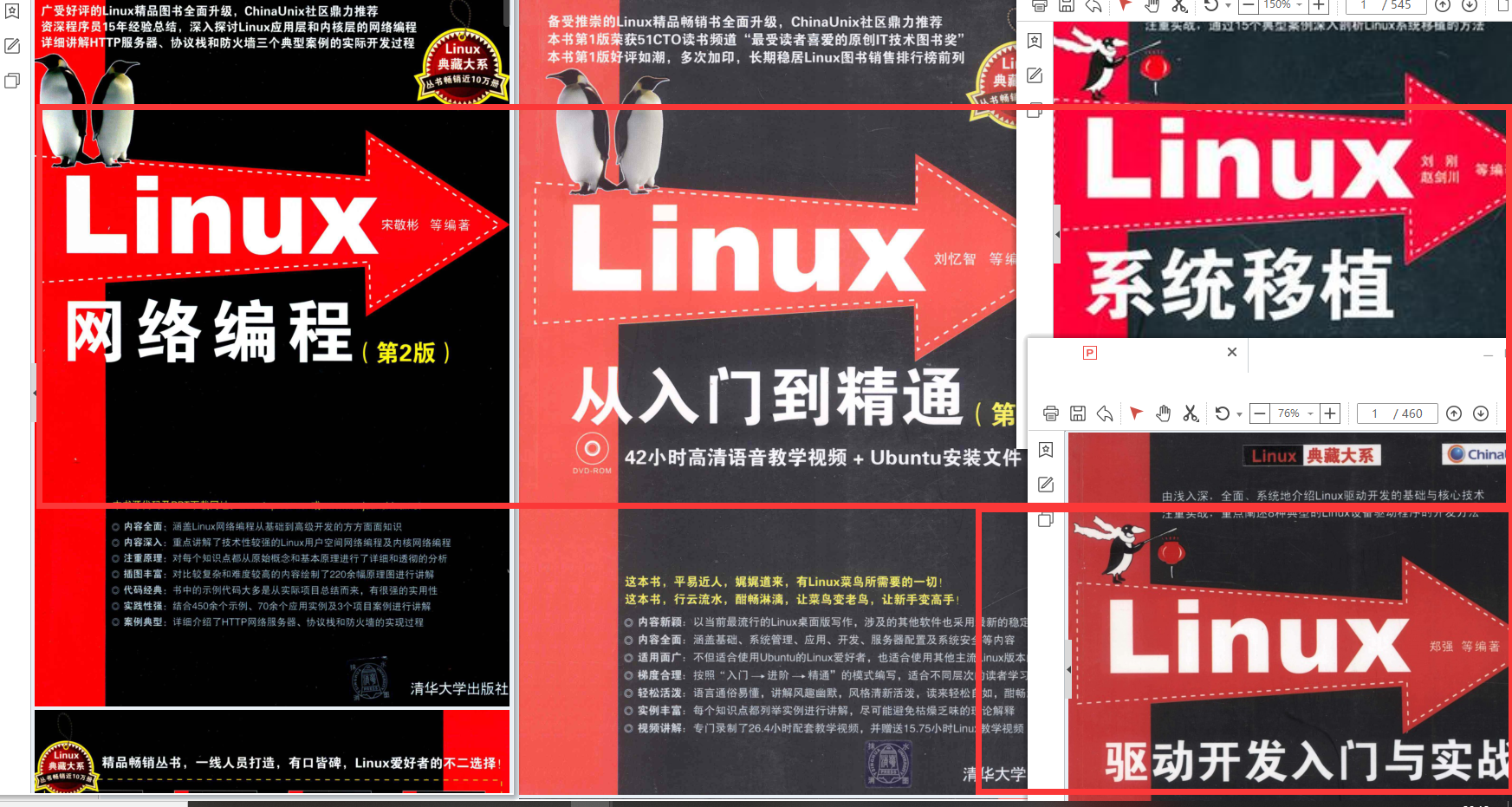

给大家整理的电子书资料:

如果本文对你有帮助,欢迎点赞、收藏、转发给朋友,让我有持续创作的动力!

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

具体来说,在使用 ChatGPT API 时,你可以设置两种 Prompt:

System Prompt,该种 Prompt 内容会在整个会话过程中持久地影响模型的回复,且相比于普通 Prompt 具有更高的重要性;User Prompt,这更偏向于咱们平时的 Prompt,即需要模型做出回复的输入。

我们一般设置 System Prompt 来对模型进行一些初始化设定,例如,我们可以在 System Prompt 中给模型设定我们希望它具备的人设如一个个人知识库助手等。System Prompt 一般在一个会话中仅有一个。在通过 System Prompt 设定好模型的人设或是初始设置后,我们可以通过 User Prompt 给出模型需要遵循的指令。例如,当我们需要一个幽默风趣的个人知识库助手,并向这个助手提问我今天有什么事时,可以如下地构造 Prompt:

{

"system prompt":"你是一个幽默风趣的个人知识库助手,可以根据给定的知识库内容回答用户的提问,注意,你的回答风格应是幽默风趣的",

"user prompt":"我今天有什么事务?"

}

通过如上 Prompt 的构造,我们可以让模型以幽默风趣的风格回答用户提出的问题。注意,如果有多个用户问题,那么我们只需要添加对应数量的 User Prompt 即可,System Prompt 仅需构造一个。

附一 基于 LangChain 自定义 LLM

LangChain 为基于 LLM 开发自定义应用提供了高效的开发框架,便于开发者迅速地激发 LLM 的强大能力,搭建 LLM 应用。

LangChain 也同样支持多种大模型,内置了 OpenAI、LLAMA 等大模型的调用接口。但是,LangChain 并没有内置所有大模型,它通过允许用户自定义 LLM 类型,来提供强大的可扩展性。

在本部分,我们以百度文心大模型为例,讲述如何基于 LangChain 自定义 LLM,让我们基于 LangChain 搭建的应用能够支持百度文心、讯飞星火等国内大模型。

本部分涉及相对更多 LangChain、大模型调用的技术细节,有精力同学可以学习部署,如无精力可以直接使用后续代码来支持调用。

要实现自定义 LLM,需要定义一个自定义类继承自 LangChain 的 LLM 基类,然后定义两个函数:

_call 方法,其接受一个字符串,并返回一个字符串,即模型的核心调用;_identifying_params 方法,用于打印 LLM 信息。

首先我们导入所需的第三方库:

import json

import time

from typing import Any, List, Mapping, Optional, Dict, Union, Tuple

import requests

from langchain.callbacks.manager import CallbackManagerForLLMRun

from langchain.llms.base import LLM

from langchain.utils import get_from_dict_or_env

from pydantic import Field, model_validator

由于百度文心使用双重秘钥进行认证,用户需要先基于 API_Key 与 Secret_Key 来获取 access_token,再使用 access_token 来实现对模型的调用(详见《3. 调用百度文心》),因此我们需要先定义一个 get_access_token 方法来获取 access_token:

def get\_access\_token(api_key : str, secret_key : str):

"""

使用 API Key,Secret Key 获取access\_token,替换下列示例中的应用API Key、应用Secret Key

"""

# 指定网址

url = f"https://aip.baidubce.com/oauth/2.0/token?grant\_type=client\_credentials&client\_id={api\_key}&client\_secret={secret\_key}"

# 设置 POST 访问

payload = json.dumps("")

headers = {

'Content-Type': 'application/json',

'Accept': 'application/json'

}

# 通过 POST 访问获取账户对应的 access\_token

response = requests.request("POST", url, headers=headers, data=payload)

return response.json().get("access\_token")

接着我们定义一个继承自 LLM 类的自定义 LLM 类:

# 继承自 langchain.llms.base.LLM

class Wenxin\_LLM(LLM):

# 原生接口地址

url = "https://aip.baidubce.com/rpc/2.0/ai\_custom/v1/wenxinworkshop/chat/eb-instant"

# 默认选用 ERNIE-Bot-turbo 模型,即目前一般所说的百度文心大模型

model_name: str = Field(default="ERNIE-Bot-turbo", alias="model")

# 访问时延上限

request_timeout: Optional[Union[float, Tuple[float, float]]] = None

# 温度系数

temperature: float = 0.1

# API\_Key

api_key: str = None

# Secret\_Key

secret_key : str = None

# access\_token

access_token: str = None

# 必备的可选参数

model_kwargs: Dict[str, Any] = Field(default_factory=dict)

上述初始化涵盖了我们平时常用的参数,也可以根据实际需求与文心的 API 加入更多的参数。

接下来我们实现一个初始化方法 init_access_token,当模型的 access_token 为空时调用:

def init\_access\_token(self):

if self.api_key != None and self.secret_key != None:

# 两个 Key 均非空才可以获取 access\_token

try:

self.access_token = get_access_token(self.api_key, self.secret_key)

except Exception as e:

print(e)

print("获取 access\_token 失败,请检查 Key")

else:

print("API\_Key 或 Secret\_Key 为空,请检查 Key")

接下来我们实现核心的方法——调用模型 API:

def \_call(self, prompt : str, stop: Optional[List[str]] = None,

run_manager: Optional[CallbackManagerForLLMRun] = None,

\*\*kwargs: Any):

# 除 prompt 参数外,其他参数并没有被用到,但当我们通过 LangChain 调用时会传入这些参数,因此必须设置

# 如果 access\_token 为空,初始化 access\_token

if self.access_token == None:

self.init_access_token()

# API 调用 url

url = "https://aip.baidubce.com/rpc/2.0/ai\_custom/v1/wenxinworkshop/chat/eb-instant?access\_token={}".format(self.access_token)

# 配置 POST 参数

payload = json.dumps({

"messages": [

{

"role": "user",# user prompt

"content": "{}".format(prompt)# 输入的 prompt

}

],

'temperature' : self.temperature

})

headers = {

'Content-Type': 'application/json'

}

# 发起请求

response = requests.request("POST", url, headers=headers, data=payload, timeout=self.request_timeout)

if response.status_code == 200:

# 返回的是一个 Json 字符串

js = json.loads(response.text)

return js["result"]

else:

return "请求失败"

然后我们还需要定义一下模型的描述方法:

# 首先定义一个返回默认参数的方法

@property

def \_default\_params(self) -> Dict[str, Any]:

"""获取调用Ennie API的默认参数。"""

normal_params = {

"temperature": self.temperature,

"request\_timeout": self.request_timeout,

}

return {\*\*normal_params}

@property

def \_identifying\_params(self) -> Mapping[str, Any]:

"""Get the identifying parameters."""

return {\*\*{"model\_name": self.model_name}, \*\*self._default_params}

通过上述步骤,我们就可以基于 LangChain 定义百度文心的调用方式了。我们将此代码封装在 wenxin_llm.py 文件中,将在讲述如何调用百度文心的 Notebook 中直接使用该 LLM。

七、总结

在本章中,我们简要介绍了四种常用大模型 API 的调用方式:ChatGPT、百度文心、讯飞星火、智谱 AI。四种模型 API 都具有不同的调用要求,我们分别进行了介绍并对其原生接口进行了封装,方便用户直接调用使用;同时,我们也简要介绍了如何将大模型 API 封装到 LangChain 的自定义 LLM 中,如何将大模型 API 封装成统一方式调用的本地 API,以及如何将大模型 Embedding API 封装到 LangChain 的自定义 LLM 中。我们分别以百度文心、讯飞星火、智谱 AI作为示例介绍了调用方式,欢迎读者们自行实践尝试将更多的模型进行统一封装。

学习完本章,你应该掌握了常用大模型的基本调用方式,那么接下来,你就可以开始着手基于大模型打造自己的应用啦!

公众号:奇想星球平台

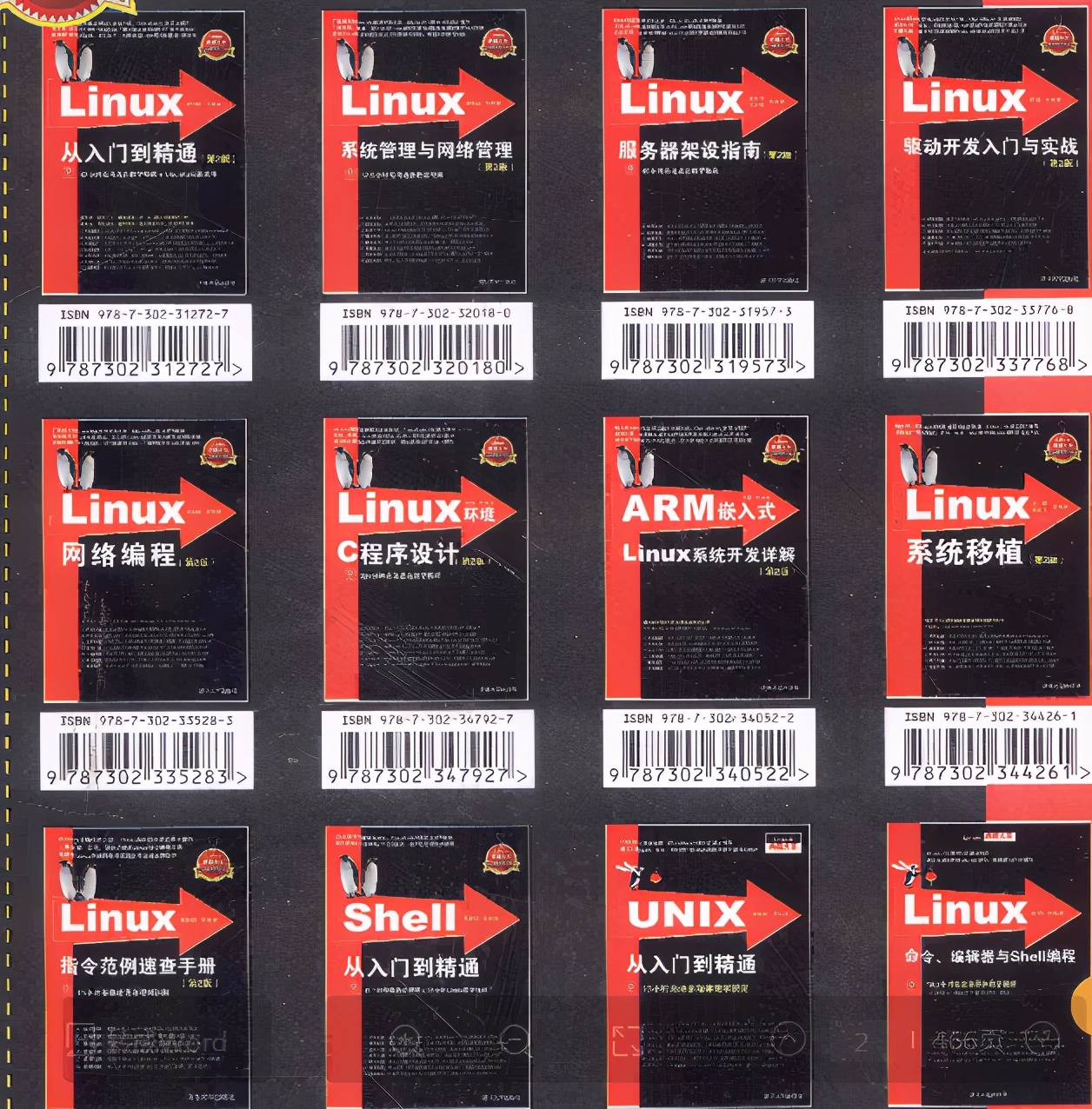

最全的Linux教程,Linux从入门到精通

======================

-

linux从入门到精通(第2版)

-

Linux系统移植

-

Linux驱动开发入门与实战

-

LINUX 系统移植 第2版

-

Linux开源网络全栈详解 从DPDK到OpenFlow

第一份《Linux从入门到精通》466页

====================

内容简介

====

本书是获得了很多读者好评的Linux经典畅销书**《Linux从入门到精通》的第2版**。本书第1版出版后曾经多次印刷,并被51CTO读书频道评为“最受读者喜爱的原创IT技术图书奖”。本书第﹖版以最新的Ubuntu 12.04为版本,循序渐进地向读者介绍了Linux 的基础应用、系统管理、网络应用、娱乐和办公、程序开发、服务器配置、系统安全等。本书附带1张光盘,内容为本书配套多媒体教学视频。另外,本书还为读者提供了大量的Linux学习资料和Ubuntu安装镜像文件,供读者免费下载。

本书适合广大Linux初中级用户、开源软件爱好者和大专院校的学生阅读,同时也非常适合准备从事Linux平台开发的各类人员。

需要《Linux入门到精通》、《linux系统移植》、《Linux驱动开发入门实战》、《Linux开源网络全栈》电子书籍及教程的工程师朋友们劳烦您转发+评论

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

教程的工程师朋友们劳烦您转发+评论

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1302

1302

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?