先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

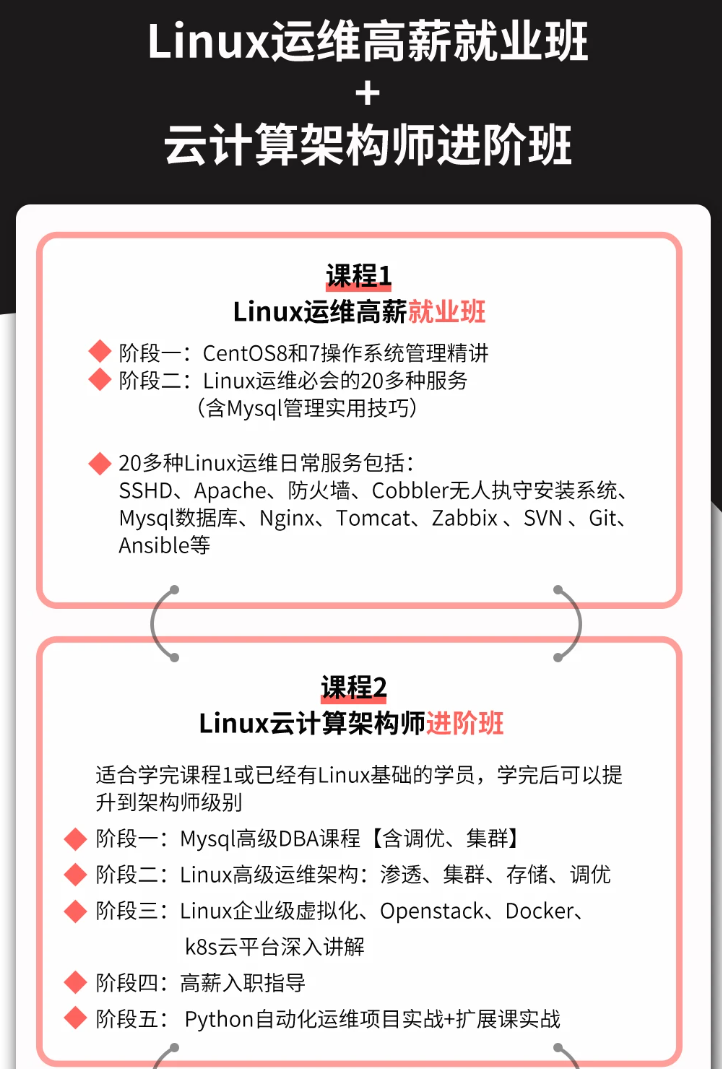

因此收集整理了一份《2024年最新Linux运维全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上运维知识点,真正体系化!

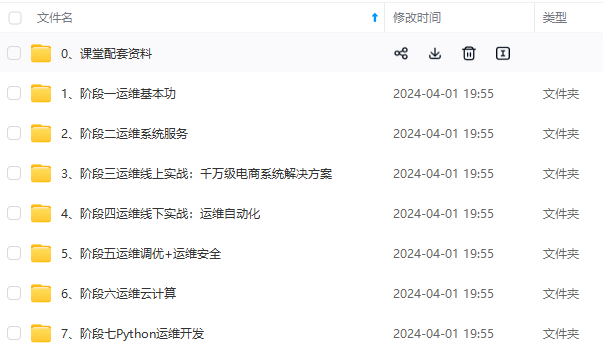

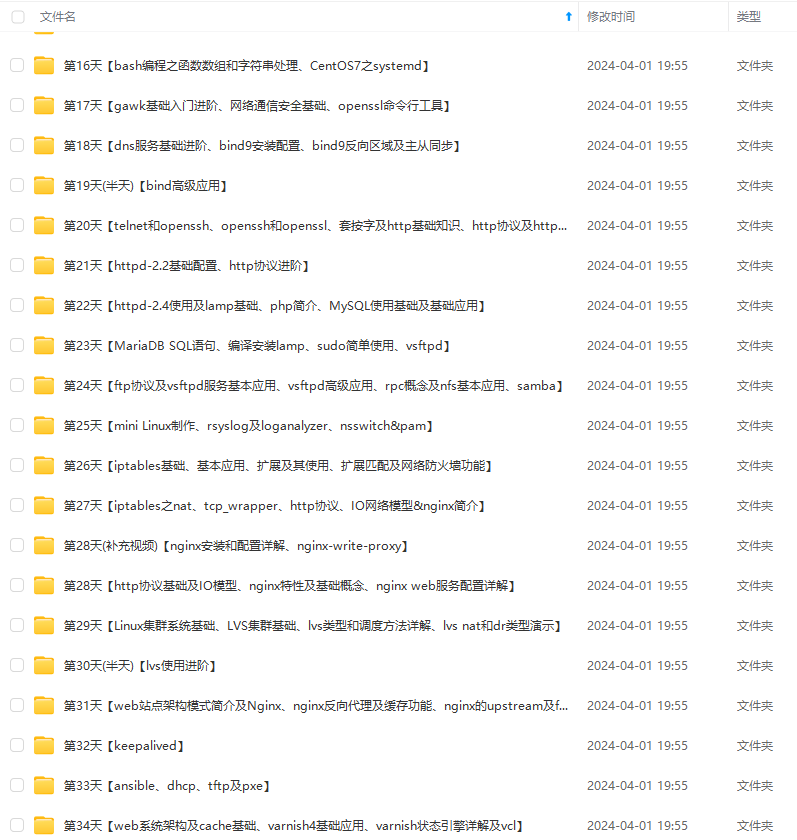

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024b (备注运维)

正文

# 后台运行服务,并把日志输出到当前文件夹下的kafka-out.file文件中

nohup bin/kafka-server-start.sh config/server.properties > kafka-out.file 2>&1 &

###

###

### **Kafka命令行操作**

>

> 接下来我们使用命令行来操作下Kafka,熟悉下Kafka的使用。

>

>

>

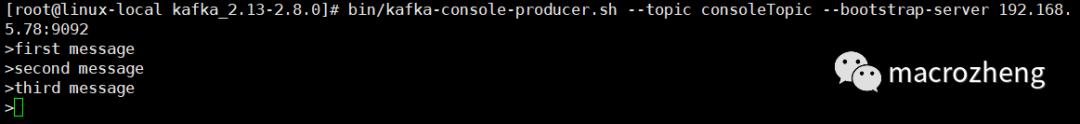

* 首先创建一个叫`consoleTopic`的Topic;

bin/kafka-topics.sh --create --topic consoleTopic --bootstrap-server 192.168.5.78:9092

* 接下来查看Topic;

bin/kafka-topics.sh --describe --topic consoleTopic --bootstrap-server 192.168.5.78:9092

* 会显示如下Topic信息;

Topic: consoleTopic TopicId: tJmxUQ8QRJGlhCSf2ojuGw PartitionCount: 1 ReplicationFactor: 1 Configs: segment.bytes=1073741824

Topic: consoleTopic Partition: 0 Leader: 0 Replicas: 0 Isr: 0

* 向Topic中发送消息:

bin/kafka-console-producer.sh --topic consoleTopic --bootstrap-server 192.168.5.78:9092

* 直接在命令行中输入信息即可发送;

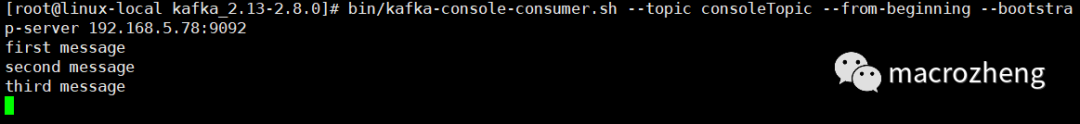

* 重新打开一个窗口,通过如下命令可以从Topic中获取消息:

bin/kafka-console-consumer.sh --topic consoleTopic --from-beginning --bootstrap-server 192.168.5.78:9092

###

###

### **Kafka可视化**

>

> 使用命令行操作Kafka确实有点麻烦,接下来我们试试可视化工具`kafka-eagle`。

>

>

>

#### 安装JDK

>

> 如果你使用的是CentOS的话,默认没有安装完整版的JDK,需要自行安装!

>

>

>

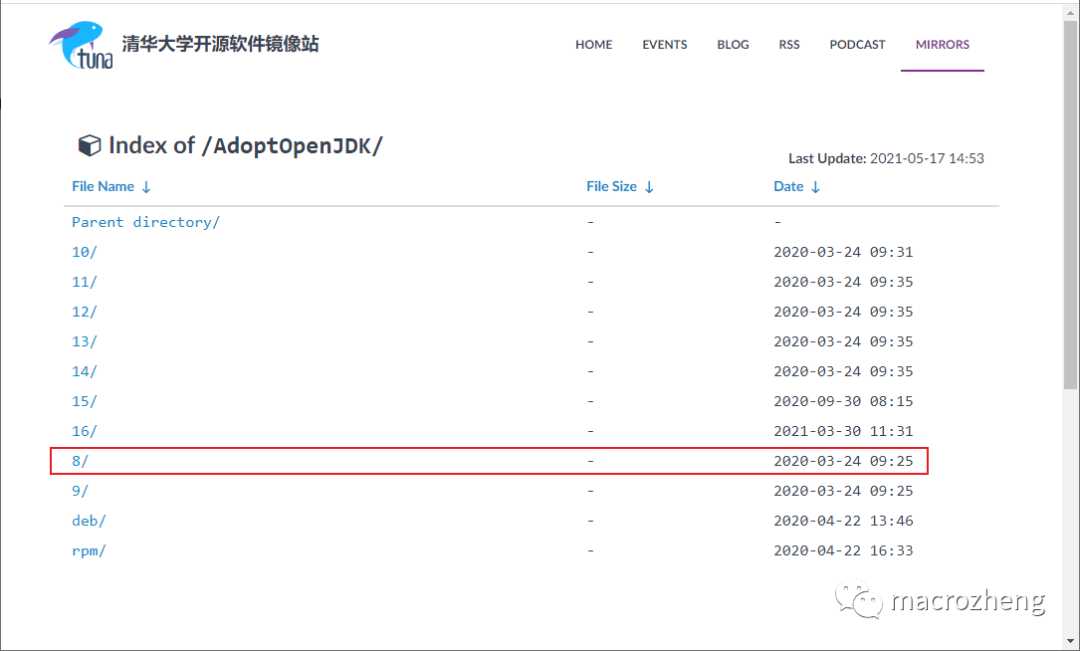

* 下载JDK 8,下载地址:https://mirrors.tuna.tsinghua.edu.cn/AdoptOpenJDK/

* 下载完成后将JDK解压到指定目录;

cd /mydata/java

tar -zxvf OpenJDK8U-jdk_x64_linux_xxx.tar.gz

mv OpenJDK8U-jdk_x64_linux_xxx.tar.gz jdk1.8

* 在`/etc/profile`文件中添加环境变量`JAVA_HOME`。

vi /etc/profile

# 在profile文件中添加

export JAVA_HOME=/mydata/java/jdk1.8

export PATH=

P

A

T

H

:

PATH:

PATH:JAVA_HOME/bin

# 使修改后的profile文件生效

. /etc/profile

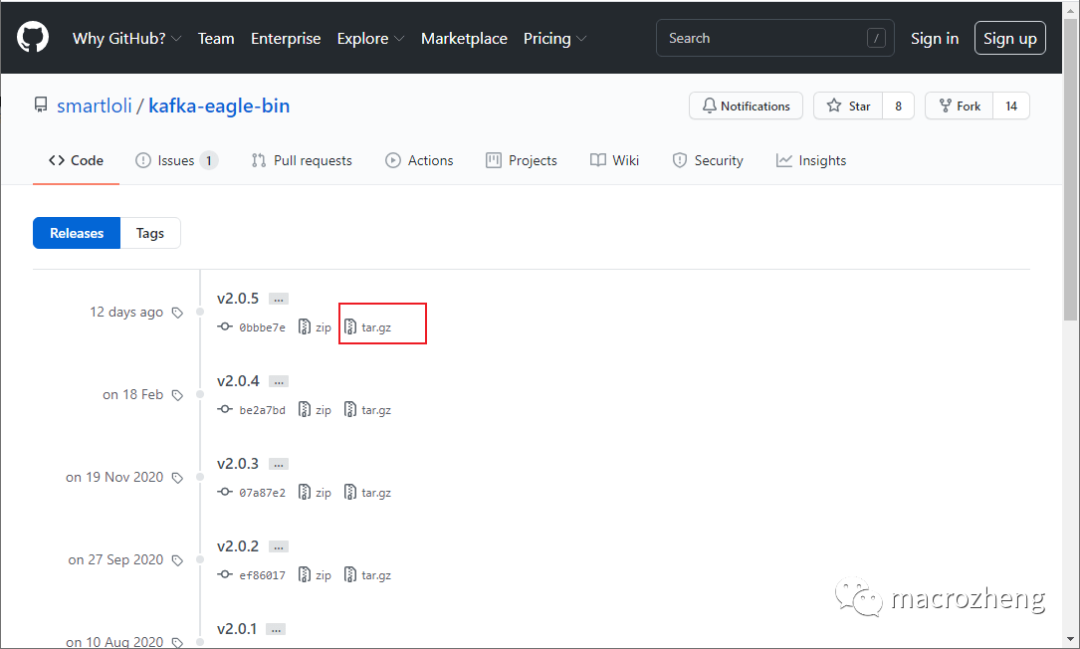

#### 安装`kafka-eagle`

* 下载`kafka-eagle`的安装包,下载地址:https://github.com/smartloli/kafka-eagle-bin/releases

* 下载完成后将`kafka-eagle`解压到指定目录;

cd /mydata/kafka/

tar -zxvf kafka-eagle-web-2.0.5-bin.tar.gz

* 在`/etc/profile`文件中添加环境变量`KE_HOME`;

vi /etc/profile

# 在profile文件中添加

export KE_HOME=/mydata/kafka/kafka-eagle-web-2.0.5

export PATH=

P

A

T

H

:

PATH:

PATH:KE_HOME/bin

# 使修改后的profile文件生效

. /etc/profile

* 安装MySQL并添加数据库`ke`,`kafka-eagle`之后会用到它;

* 修改配置文件`$KE_HOME/conf/system-config.properties`,主要是修改Zookeeper的配置和数据库配置,注释掉sqlite配置,改为使用MySQL;

######################################

multi zookeeper & kafka cluster list

######################################

kafka.eagle.zk.cluster.alias=cluster1

cluster1.zk.list=localhost:2181

######################################

kafka eagle webui port

######################################

kafka.eagle.webui.port=8048

######################################

kafka sqlite jdbc driver address

######################################

kafka.eagle.driver=org.sqlite.JDBC

kafka.eagle.url=jdbc:sqlite:/hadoop/kafka-eagle/db/ke.db

kafka.eagle.username=root

kafka.eagle.password=www.kafka-eagle.org

######################################

kafka mysql jdbc driver address

######################################

kafka.eagle.driver=com.mysql.cj.jdbc.Driver

kafka.eagle.url=jdbc:mysql://localhost:3306/ke?useUnicode=true&characterEncoding=UTF-8&zeroDateTimeBehavior=convertToNull

kafka.eagle.username=root

kafka.eagle.password=root

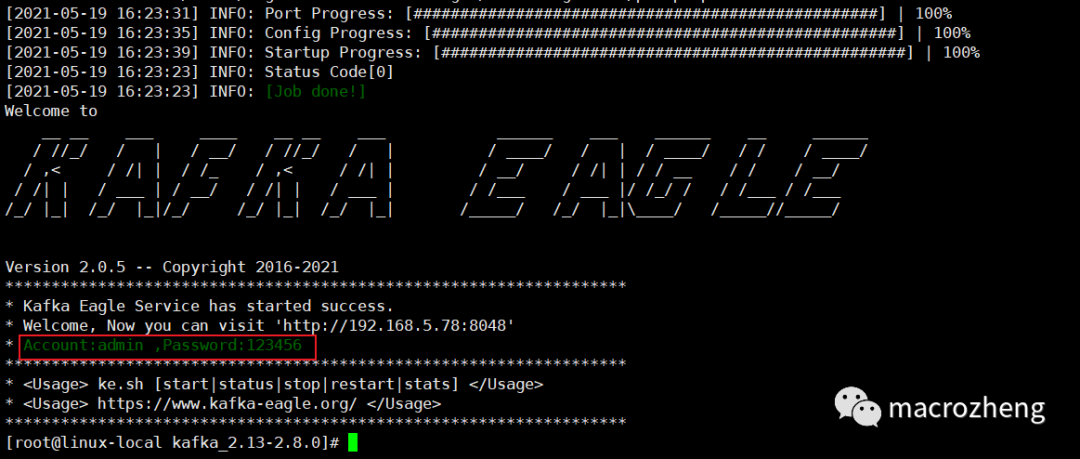

* 使用如下命令启动`kafka-eagle`;

$KE_HOME/bin/ke.sh start

* 命令执行完成后会显示如下信息,但并不代表服务已经启动成功,还需要等待一会;

* 再介绍几个有用的`kafka-eagle`命令:

# 停止服务

$KE_HOME/bin/ke.sh stop

# 重启服务

$KE_HOME/bin/ke.sh restart

# 查看服务运行状态

$KE_HOME/bin/ke.sh status

# 查看服务状态

KaTeX parse error: Expected 'EOF', got '#' at position 25: …in/ke.sh stats #̲ 动态查看服务输出日志 tai…KE_HOME/logs/ke_console.out

* 启动成功可以直接访问,输入账号密码`admin:123456`,访问地址:http://192.168.5.78:8048/

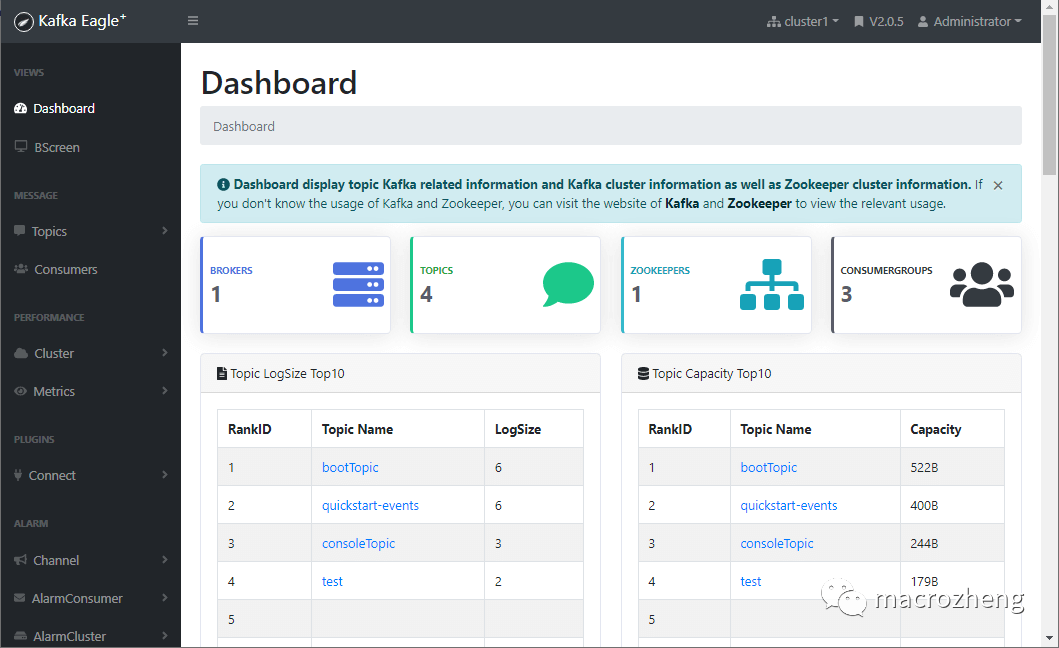

* 登录成功后可以访问到Dashboard,界面还是很棒的!

#### 可视化工具使用

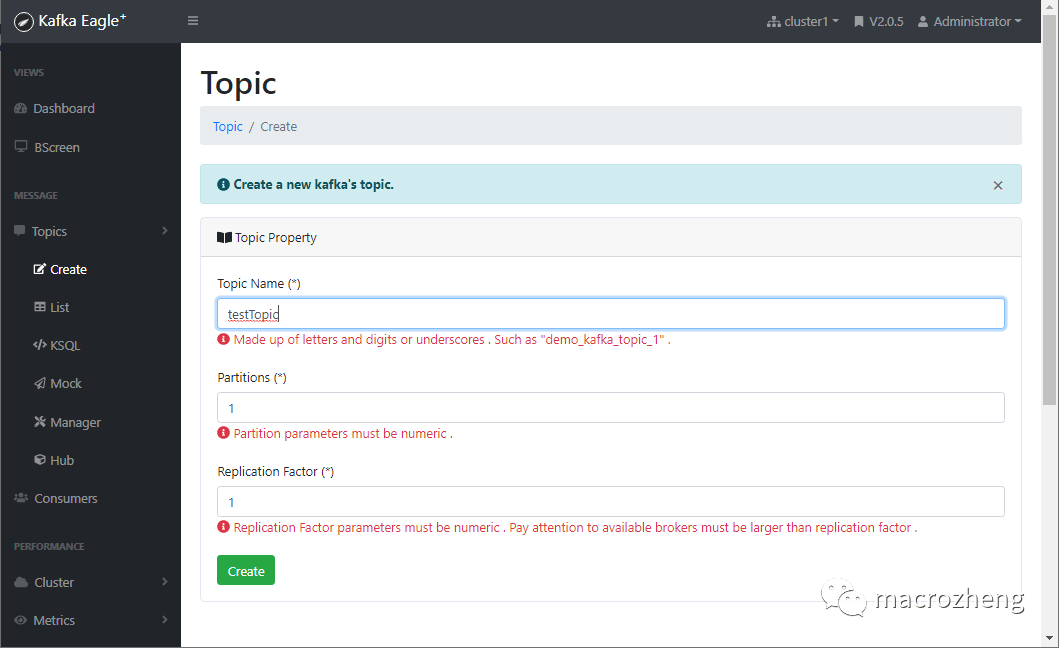

* 之前我们使用命令行创建了Topic,这里可以直接通过界面来创建;

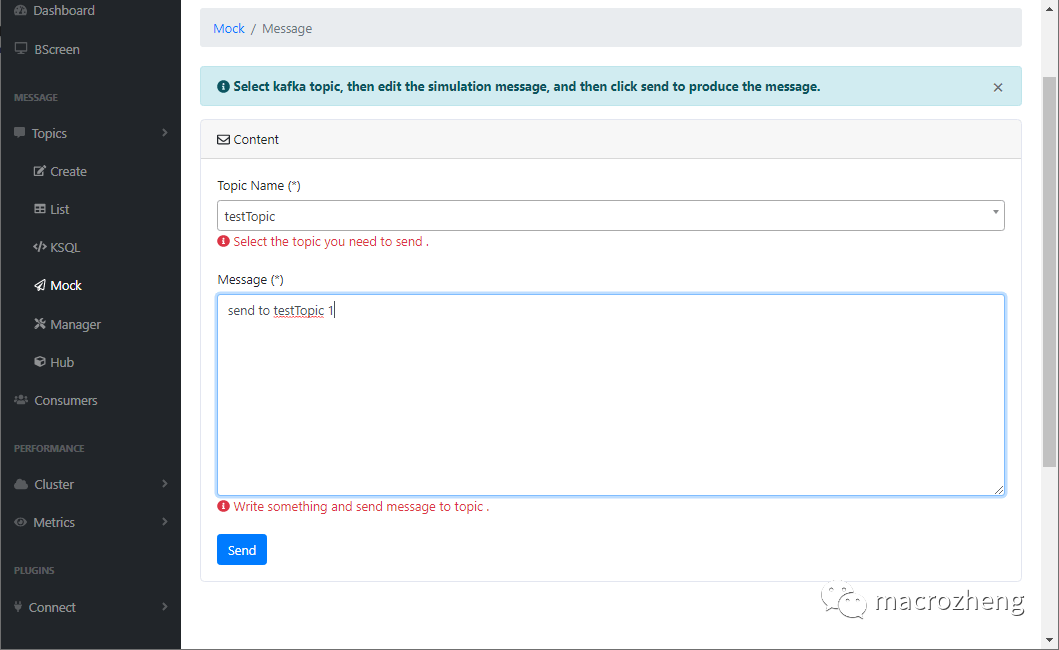

* 我们还可以直接通过`kafka-eagle`来发送消息;

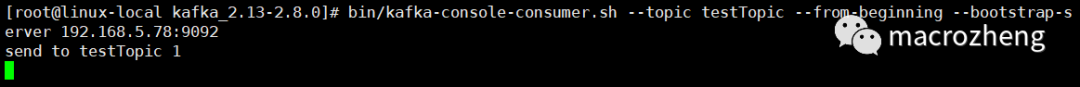

* 我们可以通过命令行来消费Topic中的消息;

bin/kafka-console-consumer.sh --topic testTopic --from-beginning --bootstrap-server 192.168.5.78:9092

* 控制台获取到信息显示如下;

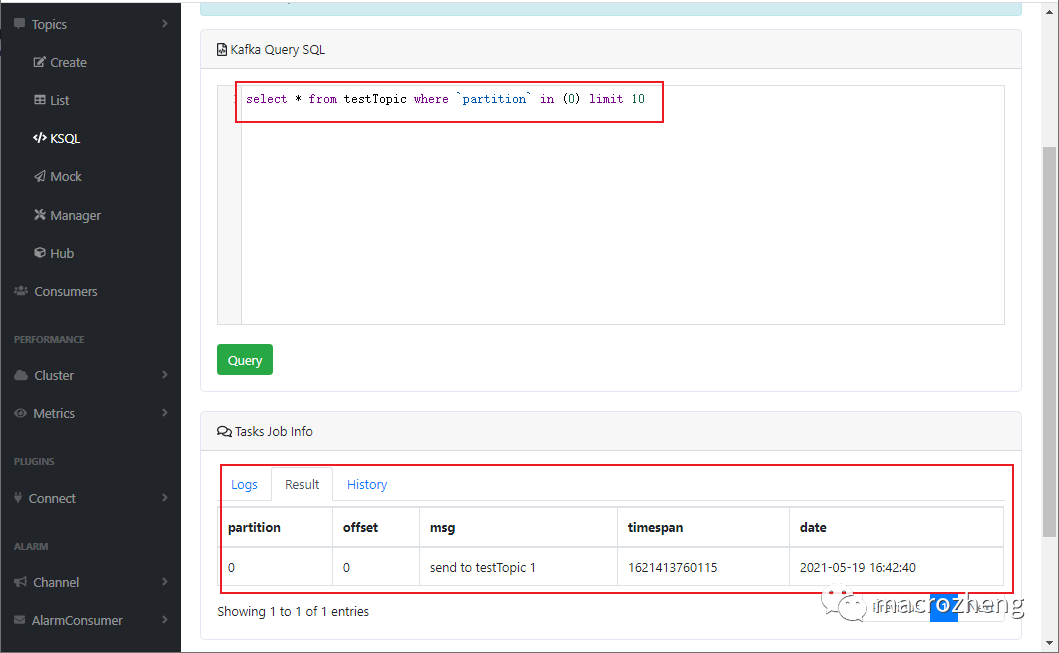

* 还有一个很有意思的功能叫`KSQL`,可以通过SQL语句来查询Topic中的消息;

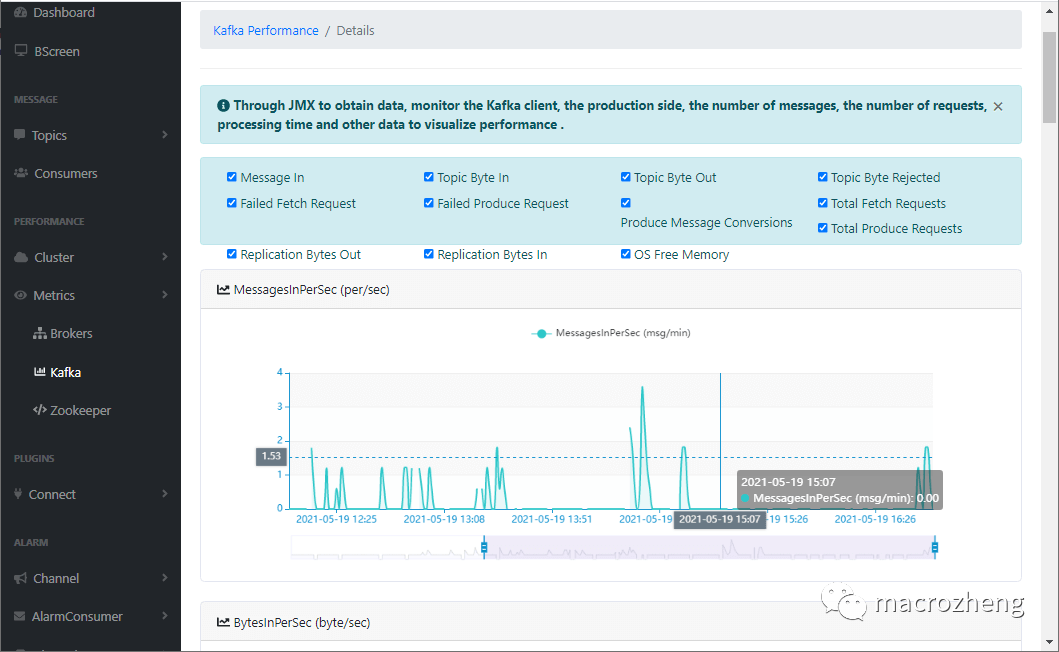

* 可视化工具自然少不了监控,如果你想开启`kafka-eagle`对Kafka的监控功能的话,需要修改Kafka的启动脚本,暴露JMX的端口;

vi kafka-server-start.sh

# 暴露JMX端口

if [ “x$KAFKA_HEAP_OPTS” = “x” ]; then

export KAFKA_HEAP_OPTS=“-server -Xms2G -Xmx2G -XX:PermSize=128m -XX:+UseG1GC -XX:MaxGCPauseMillis=200 -XX:ParallelGCThreads=8 -XX:ConcGCThreads=5 -XX:InitiatingHeapOccupancyPercent=70”

export JMX_PORT=“9999”

fi

* 来看下监控图表界面;

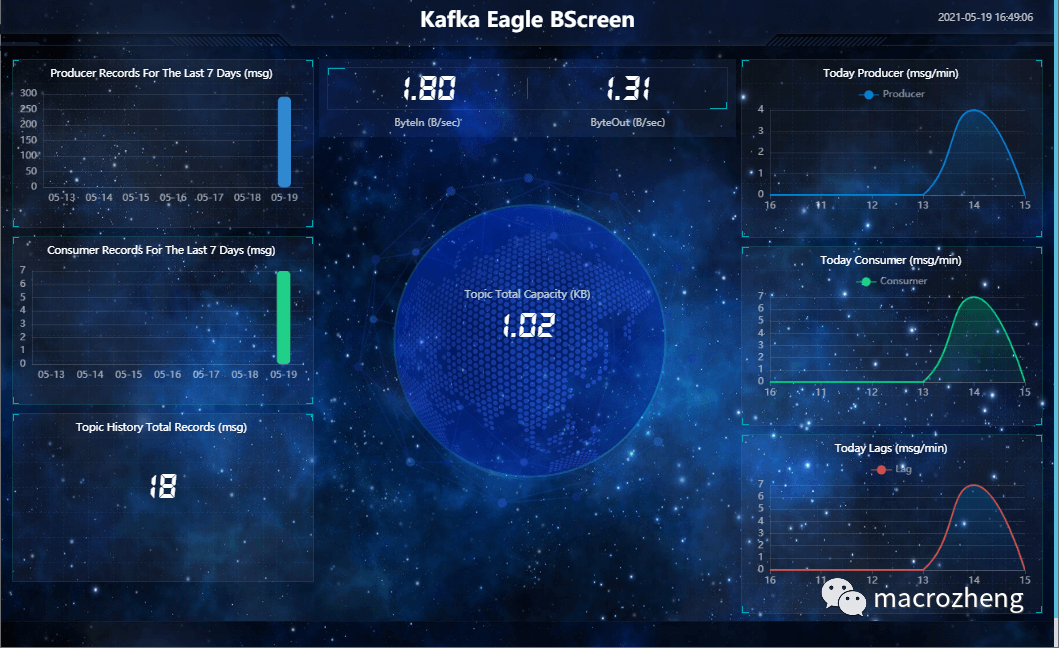

* 还有一个很骚气的监控大屏功能;

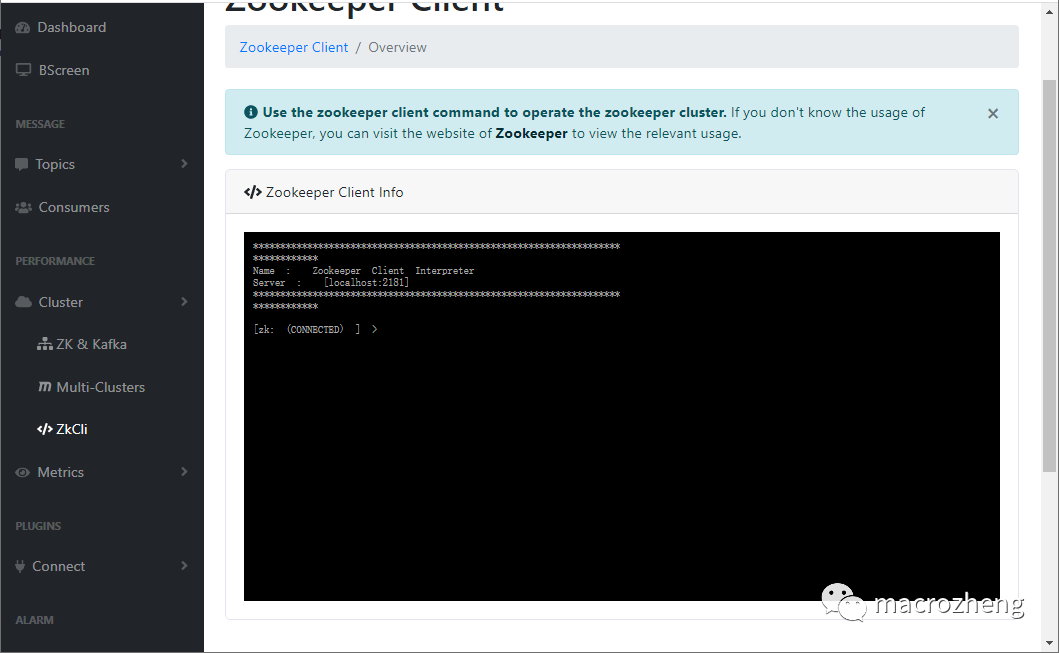

* 还有Zookeeper的命令行功能,总之功能很全,很强大!

###

###

### **SpringBoot整合Kafka**

>

> 在SpringBoot中操作Kafka也是非常简单的,比如Kafka的消息模式很简单,没有队列,只有Topic。

>

>

>

* 首先在应用的`pom.xml`中添加Spring Kafka依赖;

* 修改应用配置文件`application.yml`,配置Kafka服务地址及consumer的`group-id`;

server:

port: 8088

spring:

kafka:

bootstrap-servers: ‘192.168.5.78:9092’

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注运维)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

Kafka服务地址及consumer的group-id;

server:

port: 8088

spring:

kafka:

bootstrap-servers: '192.168.5.78:9092'

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注运维)**

[外链图片转存中...(img-ItefzxZd-1713544548836)]

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

746

746

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?