int maxMemory = (int) (Runtime.getRuntime().totalMemory()/1024);

int cacheSize = maxMemory/8;

mMemoryCache = new LruCache<String,Bitmap>(cacheSize){

@Override

protected int sizeOf(String key, Bitmap value) {

return value.getRowBytes()*value.getHeight()/1024;

}

};

- 设置LruCache缓存的大小,一般为当前进程可用容量的1/8。

- 重写sizeOf方法,计算出要缓存的每张图片的大小。

注意:缓存的总容量和每个缓存对象的大小所用单位要一致。

LruCache的实现原理

LruCache的核心思想很好理解,就是要维护一个缓存对象列表,其中对象列表的排列方式是按照访问顺序实现的,即一直没访问的对象,将放在队尾,即将被淘汰。而最近访问的对象将放在队头,最后被淘汰。如下图所示:

那么这个队列到底是由谁来维护的,前面已经介绍了是由LinkedHashMap来维护。

而LinkedHashMap是由数组+双向链表的数据结构来实现的。其中双向链表的结构可以实现访问顺序和插入顺序,使得LinkedHashMap中的:

/**

- Constructs a new {@code LinkedHashMap} instance with the specified

- capacity, load factor and a flag specifying the ordering behavior.

- @param initialCapacity

-

the initial capacity of this hash map. - @param loadFactor

-

the initial load factor. - @param accessOrder

-

{@code true} if the ordering should be done based on the last -

access (from least-recently accessed to most-recently -

accessed), and {@code false} if the ordering should be the -

order in which the entries were inserted.

*/

public LinkedHashMap(

int initialCapacity, float loadFactor, boolean accessOrder) {

super(initialCapacity, loadFactor);

init();

this.accessOrder = accessOrder;

}

其中accessOrder设置为true则为访问顺序,为false,则为插入顺序。

以具体例子解释,当设置为true时:

public static final void main(String[] args) {

LinkedHashMap<Integer, Integer> map = new LinkedHashMap<>(0, 0.75f, true);

map.put(0, 0);

map.put(1, 1);

map.put(2, 2);

map.put(3, 3);

map.put(4, 4);

map.put(5, 5);

map.put(6, 6);

map.get(1); //访问1

map.get(2); //访问2

for (Map.Entry<Integer, Integer> entry : map.entrySet()) {

System.out.println(entry.getKey() + “:” + entry.getValue());

}

}

输出结果如下:

0:0

3:3

4:4

5:5

6:6

1:1

2:2

即最近访问的对象会被放到队尾,然后最后输出,那么这就正好满足的LRU缓存算法的思想。可见LruCache巧妙实现,就是利用了LinkedHashMap的这种数据结构。

下面我们在LruCache源码中具体看看,怎么应用LinkedHashMap来实现缓存的添加,获得和删除的。

LruCache源码分析

我们先看看成员变量有哪些:

public class LruCache<K, V> {

private final LinkedHashMap<K, V> map;

/** Size of this cache in units. Not necessarily the number of elements. */

private int size; //当前cache的大小

private int maxSize; //cache最大大小

private int putCount; //put的次数

private int createCount; //create的次数

private int evictionCount; //驱逐剔除的次数

private int hitCount; //命中的次数

private int missCount; //未命中次数

//…省略…

}

构造函数如下,可以看到LruCache正是用了LinkedHashMap的accessOrder=true构造参数实现LRU访问顺序:

public LruCache(int maxSize) {

if (maxSize <= 0) {

throw new IllegalArgumentException(“maxSize <= 0”);

}

this.maxSize = maxSize;

//将LinkedHashMap的accessOrder设置为true来实现LRU顺序

this.map = new LinkedHashMap<K, V>(0, 0.75f, true);

}

put方法

public final V put(K key, V value) {

//不可为空,否则抛出异常

if (key == null || value == null) {

throw new NullPointerException(“key == null || value == null”);

}

V previous; //旧值

synchronized (this) {

putCount++; //插入次数加1

size += safeSizeOf(key, value); //更新缓存的大小

previous = map.put(key, value);

//如果已有缓存对象,则缓存大小的值需要剔除这个旧的大小

if (previous != null) {

size -= safeSizeOf(key, previous);

}

}

//entryRemoved()是个空方法,可以自行实现

if (previous != null) {

entryRemoved(false, key, previous, value);

}

//调整缓存大小(关键方法)

trimToSize(maxSize);

return previous;

}

可以看到**put()方法并没有什么难点,重要的就是在添加过缓存对象后,调用trimToSize()**方法,来判断缓存是否已满,如果满了就要删除近期最少使用的算法。

trimToSize方法

public void trimToSize(int maxSize) {

while (true) {

K key;

V value;

synchronized (this) {

//如果map为空并且缓存size不等于0或者缓存size小于0,抛出异常

if (size < 0 || (map.isEmpty() && size != 0)) {

throw new IllegalStateException(getClass().getName()

- “.sizeOf() is reporting inconsistent results!”);

}

//如果缓存大小size小于最大缓存,或者map为空,则不需要再删除缓存对象,跳出循环

if (size <= maxSize || map.isEmpty()) {

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Android工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

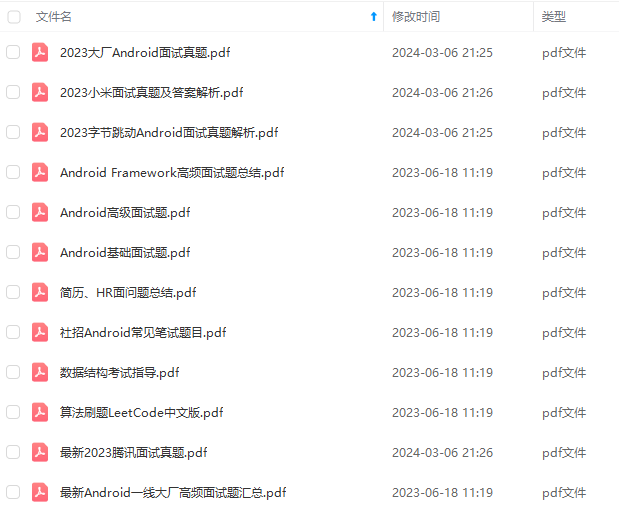

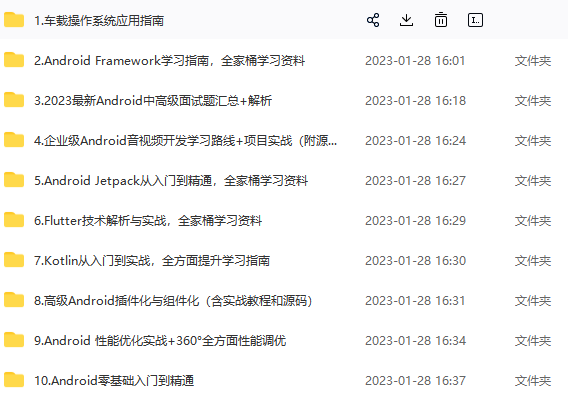

因此收集整理了一份《2024年Android移动开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Android开发知识点,真正体系化!

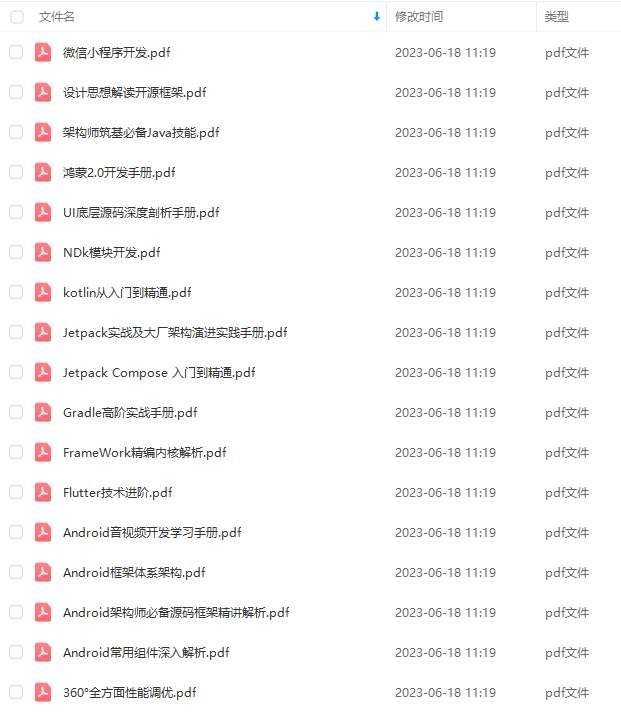

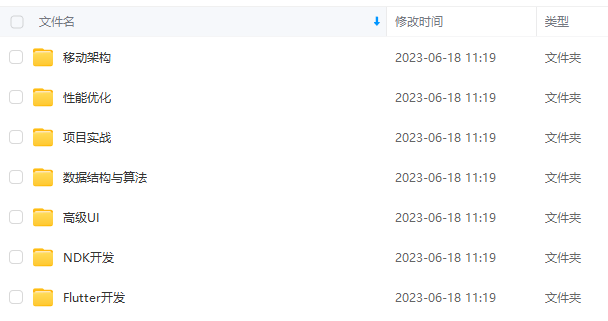

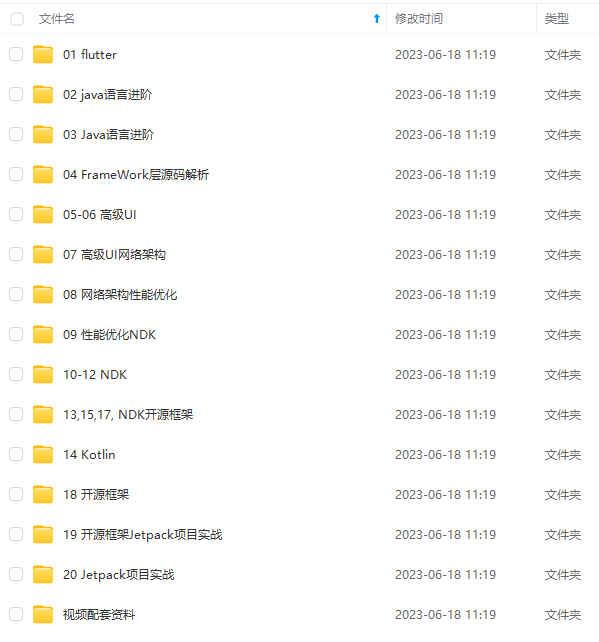

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加V获取:vip204888 (备注Android)

总结

作为一名从事Android的开发者,很多人最近都在和我吐槽Android是不是快要凉了?而在我看来这正是市场成熟的表现,所有的市场都是温水煮青蛙,永远会淘汰掉不愿意学习改变,安于现状的那批人,希望所有的人能在大浪淘沙中留下来,因为对于市场的逐渐成熟,平凡并不是我们唯一的答案!

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

873240)]

[外链图片转存中…(img-W93h3rYK-1712619873241)]

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

[外链图片转存中…(img-L2UZrSY6-1712619873241)]

317

317

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?