Spark实战教程基础之RDD

RDD 可以说是 Spark 中最基础的概念了,使用 Spark 的开发者想必对 RDD 都不陌生,甚至提起 RDD,你的耳朵可能都已经听出茧子了。不过,随着 Spark 开发 API 的演进和发展,现在上手开发基本都是 DataFrame 或 Dataset API。所以很多初学者会认为,“反正 RDD API 基本都没人用了,我也没必要弄明白 RDD 到底是什么。

RDD 为何如此重要

首先,RDD 作为 Spark 对于分布式数据模型的抽象,是构建 Spark 分布式内存计算引擎的基石。很多 Spark 核心概念与核心组件,如 DAG 和调度系统都衍生自 RDD。因此,深入理解 RDD 有利于你更全面、系统地学习 Spark 的工作原理。

其次,尽管 RDD API 使用频率越来越低,绝大多数人也都已经习惯于 DataFrame 和 Dataset API,但是,无论采用哪种 API 或是哪种开发语言,你的应用在 Spark 内部最终都会转化为 RDD 之上的分布式计算。换句话说,如果你想要在运行时判断应用的性能瓶颈,前提是你要对 RDD 足够了解。还记得吗?定位性能瓶颈是 Spark 性能调优的第一步。

不仅如此,对于 RDD 不求甚解还有可能带来潜在的性能隐患,接下来,我们就从一个反例入手,一起来分析一下。

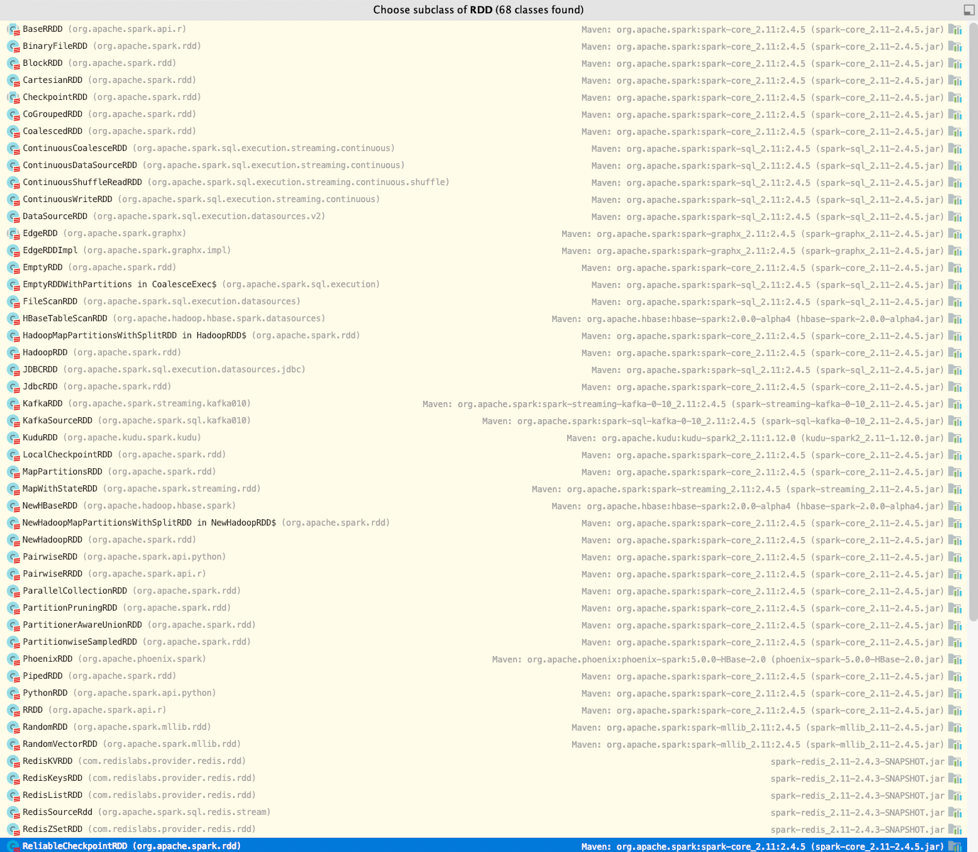

RDD

- 是弹性分布式数据集(Resilient Distributed Dataset)的简称,是分布式内存的一个抽象概念,提供了一种高度受限的共享内存模型;

- RDD 是 Spark 最核心的数据结构,RDD(Resilient Distributed Dataset)全称为弹性分布式数据集,是 Spark 对数据的核心抽象,也是最关键的抽象,它实质上是一组分布式的 JVM 不可变对象集合,不可变决定了它是只读的,所以 RDD 在经过变换产生新的 RDD 时,(如下图中 A-B),原有 RDD 不会改变。

弹性的意思是

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

280

280

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?