先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

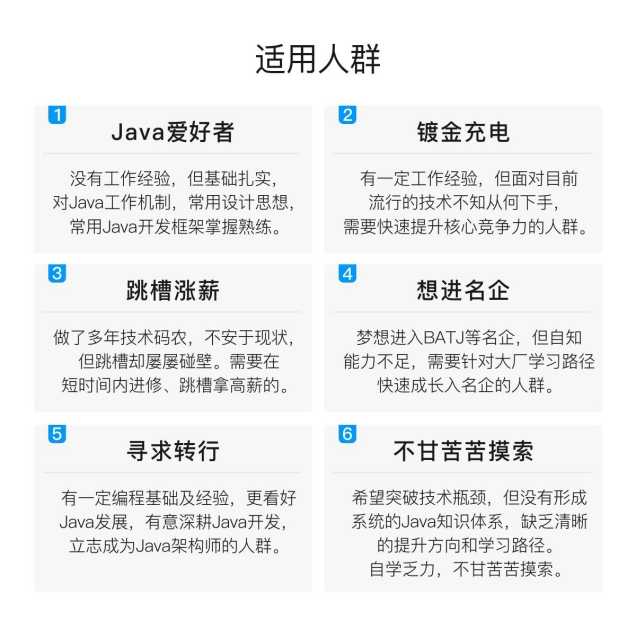

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新Java开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上Java开发知识点,真正体系化!

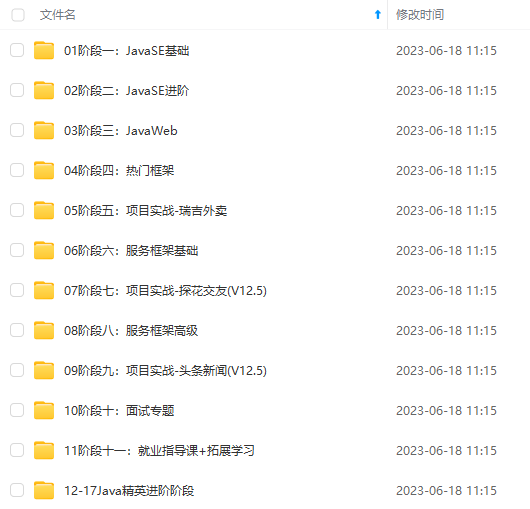

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024b (备注Java)

正文

-

依赖管理包括自动更新。

-

一个庞大且不断增长的库。

-

可扩展,能够轻松编写Java或脚本语言的插件。

-

只需很少或不需要额外配置即可即时访问新功能。

-

基于模型的构建−Maven能够将任意数量的项目构建到预定义的输出类型中,如JAR,WAR或基于项目元数据的分发,而不需要在大多数情况下执行任何脚本。

-

项目信息的一致性站点−使用与构建过程相同的元数据,Maven能够生成一个网站或PDF,包括您要添加的任何文档,并添加到关于项目开发状态的标准报告中。

-

发布管理和发布单独的输出−Maven将不需要额外的配置,就可以与源代码管理系统(如Subversion或Git)集成,并可以基于某个标签管理项目的发布。它也可以将其发布到分发位置供其他项目使用。Maven能够发布单独的输出,如JAR,包含其他依赖和文档的归档,或者作为源代码发布。

-

向后兼容性−您可以很轻松地从旧版本Maven的多个模块移植到Maven 3中。

-

子项目使用父项目依赖时,正常情况子项目应该继承父项目依赖,无需使用版本号,

-

并行构建−编译的速度能普遍提高20-50%。

-

更好的错误报告−Maven改进了错误报告,它为您提供了Maven wiki页面的链接,您可以点击链接查看错误的完整描述。

学习目录

====

-

软件工程和maven

-

maven能干什么

-

构建

-

maven核心概念

-

maven安装

-

约定目录结构

-

maven下载做了什么

-

修改本地仓库地址

-

复习

-

仓库概念仓库分类

-

pom文件分析-坐标

-

pom文件分析-依赖

-

maven生命周期

-

单元测试junit

-

maven命令-编译

-

maven命令-测试-打包-安装

-

编译插件配置

-

idea中设置maven

-

idea新建工程设置maven

-

idea创建javase项目

-

使用单元测试

-

使用idea中maven工具窗口

-

idea创建web项目

-

复习前天课程

-

复习maven核心概念

-

常用技巧

-

依赖范围

-

依赖范围provided

-

maven常用属性

-

资源插件

-

课程最后补充文档

关注、私信(666)免费获取

==================

Java高频面试专题合集解析:

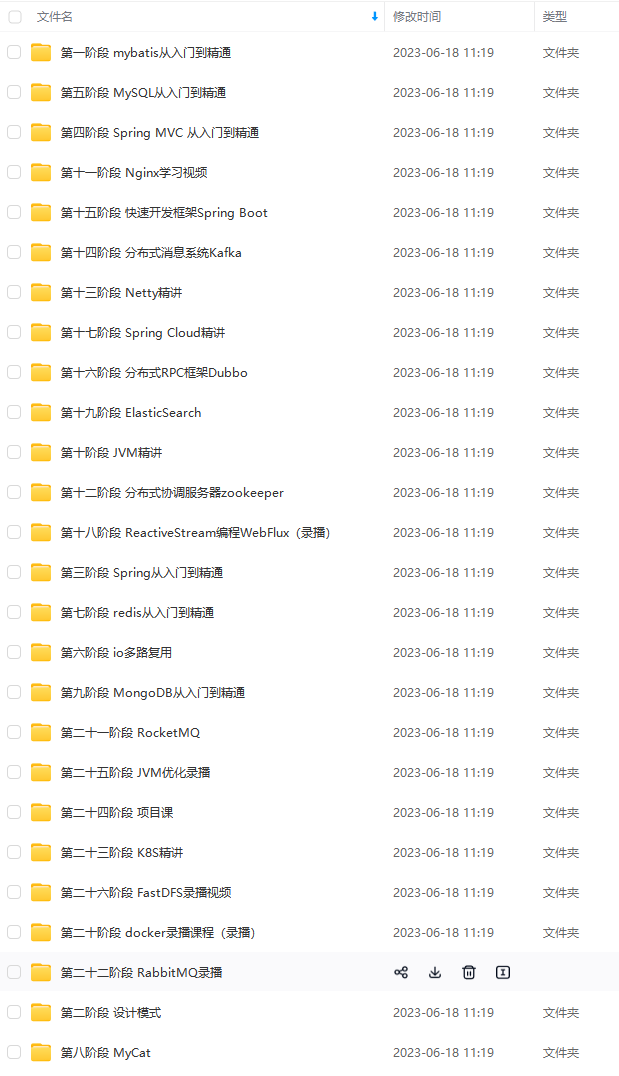

当然在这还有更多整理总结的Java进阶学习笔记和面试题未展示,其中囊括了Dubbo、Redis、Netty、zookeeper、Spring cloud、分布式、高并发等架构资料和完整的Java架构学习进阶导图!

更多Java架构进阶资料展示

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注Java)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

片转存中…(img-3yAbmEuG-1713563975417)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1535

1535

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?