最后

Python崛起并且风靡,因为优点多、应用领域广、被大牛们认可。学习 Python 门槛很低,但它的晋级路线很多,通过它你能进入机器学习、数据挖掘、大数据,CS等更加高级的领域。Python可以做网络应用,可以做科学计算,数据分析,可以做网络爬虫,可以做机器学习、自然语言处理、可以写游戏、可以做桌面应用…Python可以做的很多,你需要学好基础,再选择明确的方向。这里给大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

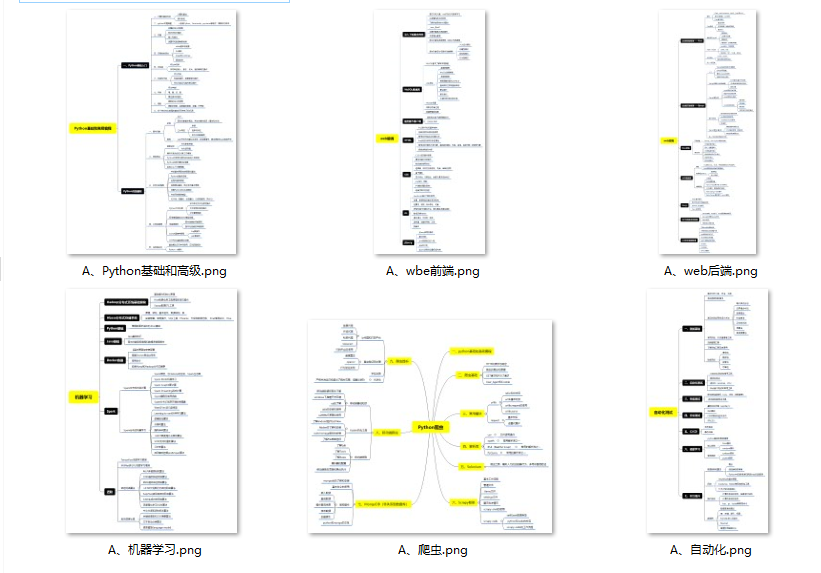

👉Python所有方向的学习路线👈

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

👉Python必备开发工具👈

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

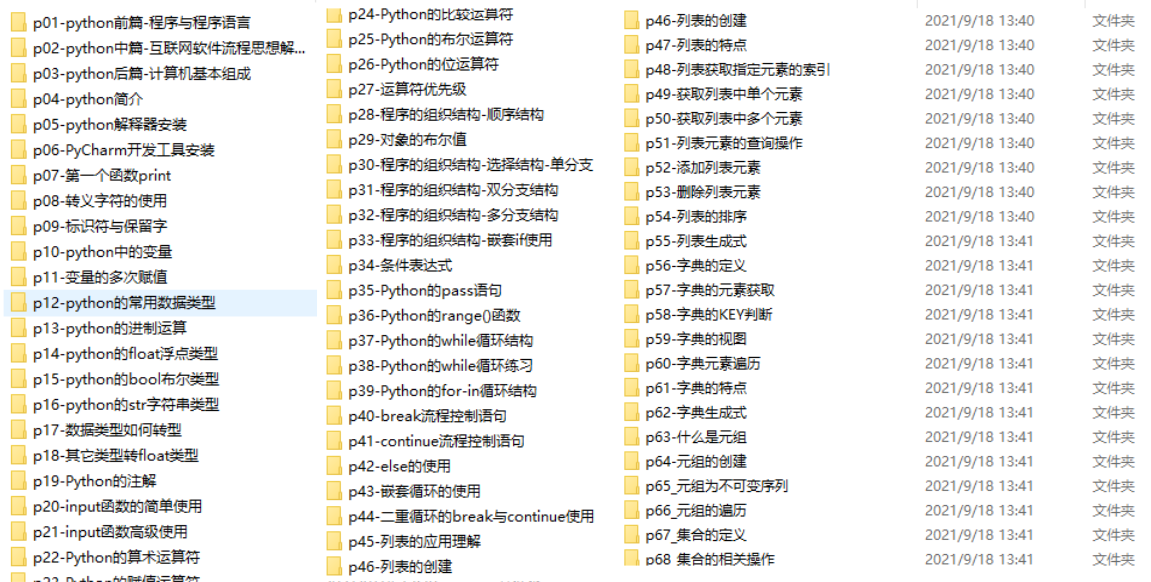

👉Python全套学习视频👈

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

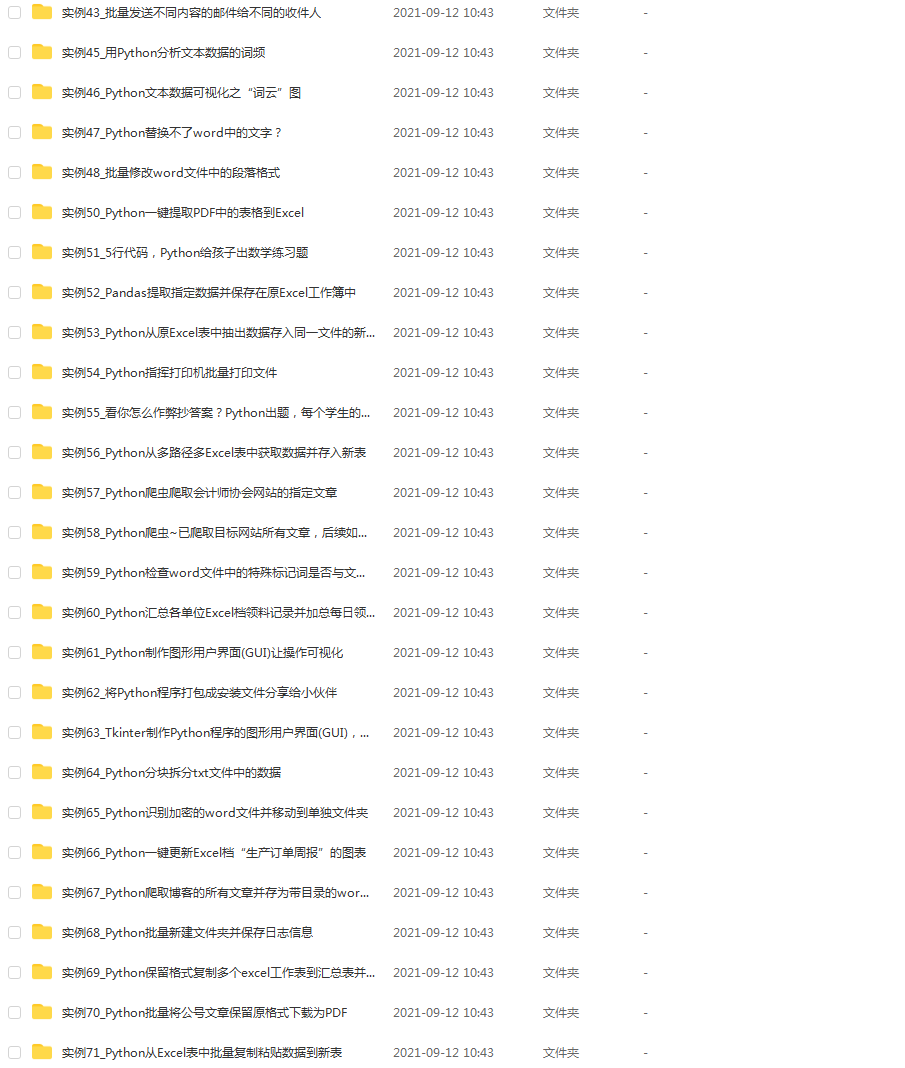

👉实战案例👈

学python就与学数学一样,是不能只看书不做题的,直接看步骤和答案会让人误以为自己全都掌握了,但是碰到生题的时候还是会一筹莫展。

因此在学习python的过程中一定要记得多动手写代码,教程只需要看一两遍即可。

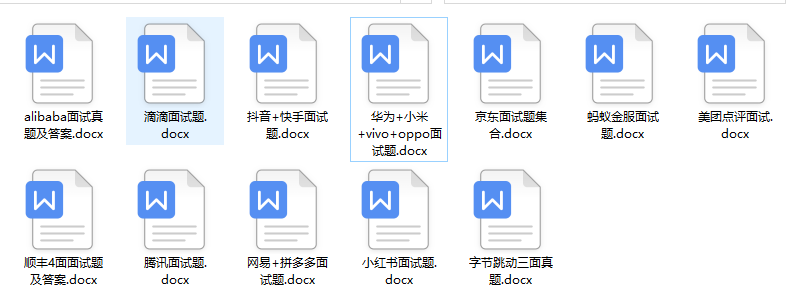

👉大厂面试真题👈

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

在编写爬虫的过程中,有些网站会设置反爬机制,对于非浏览器的访问拒绝响应;或短时间频繁爬取会触发网站的反爬机制,导致 ip 被封无法爬取网页。这就需要在爬虫程序中修改请求的 headers 伪装浏览器访问,或者使用代理发起请求。从而绕开网站的反爬机制获取正确的页面。

本文使用 python3.6,常用的请求库 requests 以及自动化测试库 selenium 使用浏览器。 关于这两个库的使用请参考官方文档或本人另一篇博客: [python 爬虫获取网页 html 内容以及下载附件的方法]。

1、requests 伪装 headers 发送请求

requests 发送的请求所带的请求头中 User-Agent 会标识为 python 程序发送的请求,如下所示:

import requests

url = 'https://httpbin.org/headers'

response = requests.get(url)

if response.status_code == 200:

print(response.text)

返回结果:

{

"headers": {

"Accept": "*/*",

"Accept-Encoding": "gzip, deflate",

"Host": "httpbin.org",

"User-Agent": "python-requests/2.20.1"

}

}

注:[https://httpbin.org]是一个开源的,用于测试网页请求的网站,比如上面的/headers的链接,将会返回所发送请求的请求头。详情请参考其官网。

User-Agent: 用户代理(英语:User Agent)指的是代表用户行为的软件代理程序所提供的对自己的一个标识符。用于标识浏览器类型及版本、操作系统及版本、浏览器内核、等信息的标识。详情见维基百科词条:[User agent]

对于有反爬的网站会识别其 headers 从而拒绝返回正确的网页。此时需要对发送的请求伪装成浏览器的 headers。

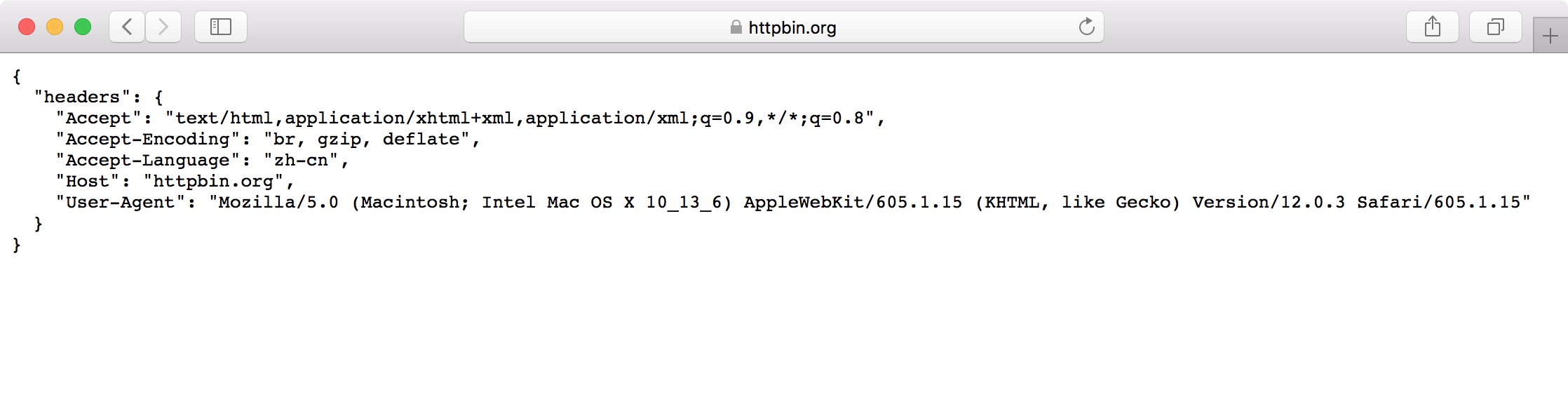

用浏览器打开 https://httpbin.org/headers 网站,将会看的下面的页面,这就是该浏览器的 headers。

将上面的请求头复制下来,传给 requests.get() 函数,即可将请求伪装成浏览器。

import requests

url = 'https://httpbin.org/headers'

myheaders = {

"Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8",

"Accept-Encoding": "br, gzip, deflate",

"Accept-Language": "zh-cn",

"Host": "httpbin.org",

"User-Agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/12.0.3 Safari/605.1.15"

}

response = requests.get(url, headers=myheaders)

if response.status_code == 200:

print(response.text)

返回的结果变成:

{

"headers": {

"Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8",

"Accept-Encoding": "br, gzip, deflate",

"Accept-Language": "zh-cn",

"Host": "httpbin.org",

"User-Agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/12.0.3 Safari/605.1.15"

}

}

在应用爬虫的时候,可以随机跟换其他 User-Agent 避免触发反爬。

2、selenium 模拟使用浏览器伪装 headers

使用自动化测试工具 selenium 可以模拟使用浏览器访问网站。本文使用 selenium 3.14.0 版本,该版本支持 Chrome 和 Firefox 浏览器。要使用浏览器需下载对应版本的 driver。

Driver 下载地址:

Browser Links ——— —————————————————————- Chrome https://sites.google.com/a/chromium.org/chromedriver/downloads Firefox https://github.com/mozilla/geckodriver/releases

使用 webdriver 访问本身自带浏览器的 headers。

from selenium import webdriver

url = 'https://httpbin.org/headers'

driver_path = '/path/to/chromedriver'

browser = webdriver.Chrome(executable_path=driver_path)

browser.get(url)

print(browser.page_source)

browser.close()

打印出返回的网页代码:

<html xmlns="http://www.w3.org/1999/xhtml"><head></head><body><pre style="word-wrap: break-word; white-space: pre-wrap;">{

"headers": {

"Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,image/apng,*/*;q=0.8",

"Accept-Encoding": "gzip, deflate, br",

"Accept-Language": "zh-CN,zh;q=0.9",

"Host": "httpbin.org",

"Upgrade-Insecure-Requests": "1",

"User-Agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/72.0.3626.121 Safari/537.36"

}

}

</pre></body></html>

浏览器 driver 也能伪装 User-Agent,只需在创建 webdriver 浏览器对象的时候传入设置即可:

from selenium import webdriver

url = 'https://httpbin.org/headers'

user_agent = "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/12.0.3 Safari/605.1.15"

driver_path = '/path/to/chromedriver'

opt = webdriver.ChromeOptions()

opt.add_argument('--user-agent=%s' % user_agent)

browser = webdriver.Chrome(executable_path=driver_path, options=opt)

browser.get(url)

print(browser.page_source)

browser.close()

此时返回的 User-Agent 就变成传入的设置了。

<html xmlns="http://www.w3.org/1999/xhtml"><head></head><body><pre style="word-wrap: break-word; white-space: pre-wrap;">{

"headers": {

"Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,image/apng,*/*;q=0.8",

"Accept-Encoding": "gzip, deflate, br",

"Accept-Language": "zh-CN,zh;q=0.9",

"Host": "httpbin.org",

"Upgrade-Insecure-Requests": "1",

"User-Agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/12.0.3 Safari/605.1.15"

}

}

</pre></body></html>

Firefox 浏览器 driver 的设置有所不同:

from selenium import webdriver

url = 'https://httpbin.org/headers'

user_agent = "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/12.0.3 Safari/605.1.15"

driver_path = '/path/to/geckodriver'

profile = webdriver.FirefoxProfile()

profile.set_preference("general.useragent.override", user_agent)

browser = webdriver.Firefox(executable_path=driver_path, firefox_profile=profile)

browser.get(url)

print(browser.page_source)

browser.close()

3、requests 使用 ip 代理发送请求

当一个 ip 短时间访问太过频繁时,网站的反爬机制会被触发,将会要求输入验证码甚至封锁 ip 禁止访问。此时需要使用代理 ip 发起请求才可获取正确的网页。

访问 https://httpbin.org/ip 网址可以查看自己的 ip。

import requests

url = 'https://httpbin.org/ip'

response = requests.get(url)

print(response.text)

返回本机网络的ip:

{

"origin": "202.121.167.254, 202.121.167.254"

}

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化学习资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4304bb5a486d4c3ab8389e65ecb71ac0)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

852

852

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?