最后

不知道你们用的什么环境,我一般都是用的Python3.6环境和pycharm解释器,没有软件,或者没有资料,没人解答问题,都可以免费领取(包括今天的代码),过几天我还会做个视频教程出来,有需要也可以领取~

给大家准备的学习资料包括但不限于:

Python 环境、pycharm编辑器/永久激活/翻译插件

python 零基础视频教程

Python 界面开发实战教程

Python 爬虫实战教程

Python 数据分析实战教程

python 游戏开发实战教程

Python 电子书100本

Python 学习路线规划

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

path = r’D:\test\picture_1\ ’

目标url

url = “http://pic.netbian.com/4kmeinv/index.html”

伪装请求头 防止被反爬

headers = {

“User-Agent”: “Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.1 (KHTML, like Gecko) Chrome/21.0.1180.89 Safari/537.1”,

“Referer”: “http://pic.netbian.com/4kmeinv/index.html”

}

发送请求 获取响应

response = requests.get(url, headers=headers)

打印网页源代码来看 乱码 重新设置编码解决编码问题

内容正常显示 便于之后提取数据

response.encoding = ‘GBK’

正则匹配提取想要的数据 得到图片链接和名称

img_info = re.findall(‘img src=“(.?)" alt="(.?)” /’, response.text)

for src, name in img_info:

img_url = ‘http://pic.netbian.com’ + src # 加上 'http://pic.netbian.com’才是真正的图片url

img_content = requests.get(img_url, headers=headers).content

img_name = name + ‘.jpg’

with open(path + img_name, ‘wb’) as f: # 图片保存到本地

print(f"正在为您下载图片:{img_name}")

f.write(img_content)

复制代码

Xpath定位提取图片数据

代码实现:

import requests

from lxml import etree

设置保存路径

path = r’D:\test\picture_1\ ’

目标url

url = “http://pic.netbian.com/4kmeinv/index.html”

伪装请求头 防止被反爬

headers = {

“User-Agent”: “Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.1 (KHTML, like Gecko) Chrome/21.0.1180.89 Safari/537.1”,

“Referer”: “http://pic.netbian.com/4kmeinv/index.html”

}

发送请求 获取响应

response = requests.get(url, headers=headers)

打印网页源代码来看 乱码 重新设置编码解决编码问题

内容正常显示 便于之后提取数据

response.encoding = ‘GBK’

html = etree.HTML(response.text)

xpath定位提取想要的数据 得到图片链接和名称

img_src = html.xpath(‘//ul[@class=“clearfix”]/li/a/img/@src’)

列表推导式 得到真正的图片url

img_src = [‘http://pic.netbian.com’ + x for x in img_src]

img_alt = html.xpath(‘//ul[@class=“clearfix”]/li/a/img/@alt’)

for src, name in zip(img_src, img_alt):

img_content = requests.get(src, headers=headers).content

img_name = name + ‘.jpg’

with open(path + img_name, ‘wb’) as f: # 图片保存到本地

print(f"正在为您下载图片:{img_name}")

f.write(img_content)

复制代码

2.翻页爬取,实现批量下载

单线程版

import requests

from lxml import etree

import datetime

import time

设置保存路径

path = r’D:\test\picture_1\ ’

headers = {

“User-Agent”: “Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.1 (KHTML, like Gecko) Chrome/21.0.1180.89 Safari/537.1”,

“Referer”: “http://pic.netbian.com/4kmeinv/index.html”

}

start = datetime.datetime.now()

def get_img(urls):

for url in urls:

发送请求 获取响应

response = requests.get(url, headers=headers)

打印网页源代码来看 乱码 重新设置编码解决编码问题

内容正常显示 便于之后提取数据

response.encoding = ‘GBK’

html = etree.HTML(response.text)

xpath定位提取想要的数据 得到图片链接和名称

img_src = html.xpath(‘//ul[@class=“clearfix”]/li/a/img/@src’)

列表推导式 得到真正的图片url

img_src = [‘http://pic.netbian.com’ + x for x in img_src]

img_alt = html.xpath(‘//ul[@class=“clearfix”]/li/a/img/@alt’)

for src, name in zip(img_src, img_alt):

img_content = requests.get(src, headers=headers).content

img_name = name + ‘.jpg’

with open(path + img_name, ‘wb’) as f: # 图片保存到本地

print(f"正在为您下载图片:{img_name}")

f.write(img_content)

time.sleep(1)

def main():

要请求的url列表

url_list = [‘http://pic.netbian.com/4kmeinv/index.html’] + [f’http://pic.netbian.com/4kmeinv/index_{i}.html’ for i in range(2, 11)]

get_img(url_list)

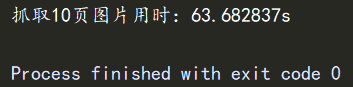

delta = (datetime.datetime.now() - start).total_seconds()

print(f"抓取10页图片用时:{delta}s")

if name == ‘main’:

main()

复制代码

程序运行成功,抓取了10页的图片,共210张,用时63.682837s。

多线程版

import requests

from lxml import etree

import datetime

import time

import random

from concurrent.futures import ThreadPoolExecutor

设置保存路径

path = r’D:\test\picture_1\ ’

user_agent = [

“Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.1 (KHTML, like Gecko) Chrome/22.0.1207.1 Safari/537.1”,

“Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/536.6 (KHTML, like Gecko) Chrome/20.0.1092.0 Safari/536.6”,

“Mozilla/5.0 (Windows NT 6.2) AppleWebKit/536.6 (KHTML, like Gecko) Chrome/20.0.1090.0 Safari/536.6”,

“Mozilla/5.0 (Windows NT 6.2; WOW64) AppleWebKit/537.1 (KHTML, like Gecko) Chrome/19.77.34.5 Safari/537.1”,

“Mozilla/5.0 (Windows NT 6.0) AppleWebKit/536.5 (KHTML, like Gecko) Chrome/19.0.1084.36 Safari/536.5”,

最后

不知道你们用的什么环境,我一般都是用的Python3.6环境和pycharm解释器,没有软件,或者没有资料,没人解答问题,都可以免费领取(包括今天的代码),过几天我还会做个视频教程出来,有需要也可以领取~

给大家准备的学习资料包括但不限于:

Python 环境、pycharm编辑器/永久激活/翻译插件

python 零基础视频教程

Python 界面开发实战教程

Python 爬虫实战教程

Python 数据分析实战教程

python 游戏开发实战教程

Python 电子书100本

Python 学习路线规划

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

523

523

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?