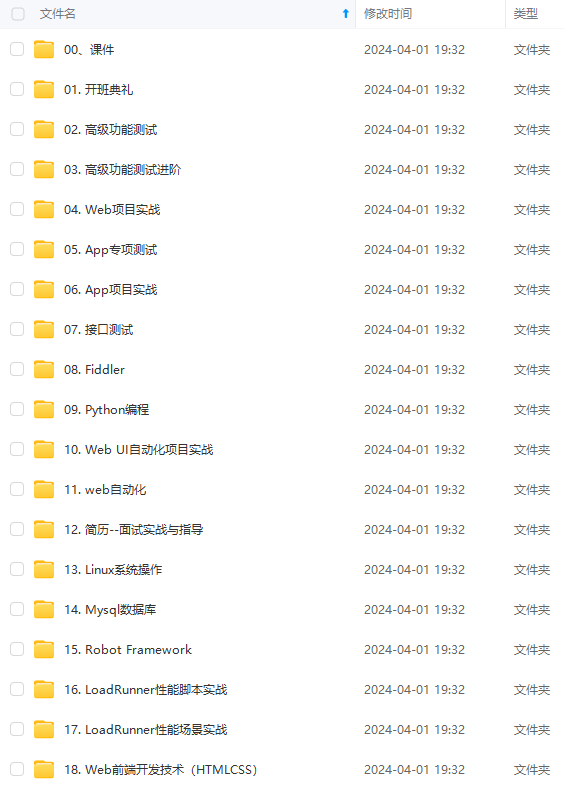

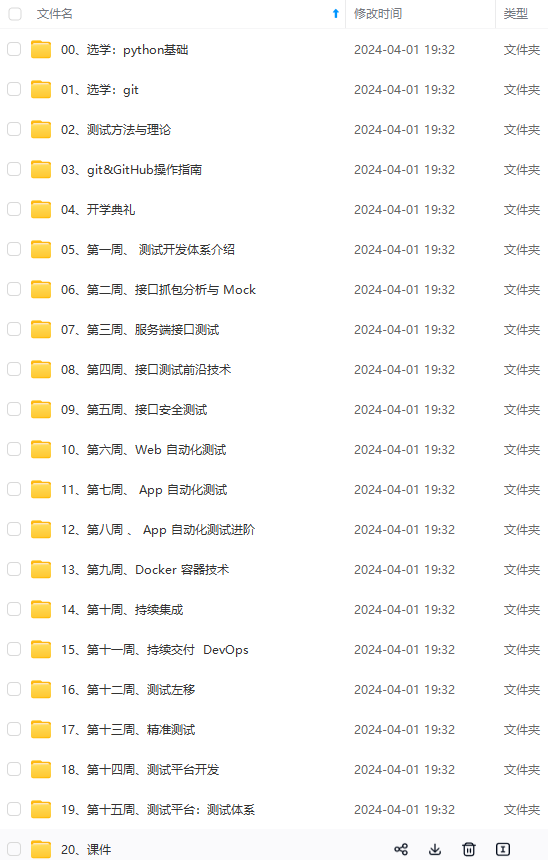

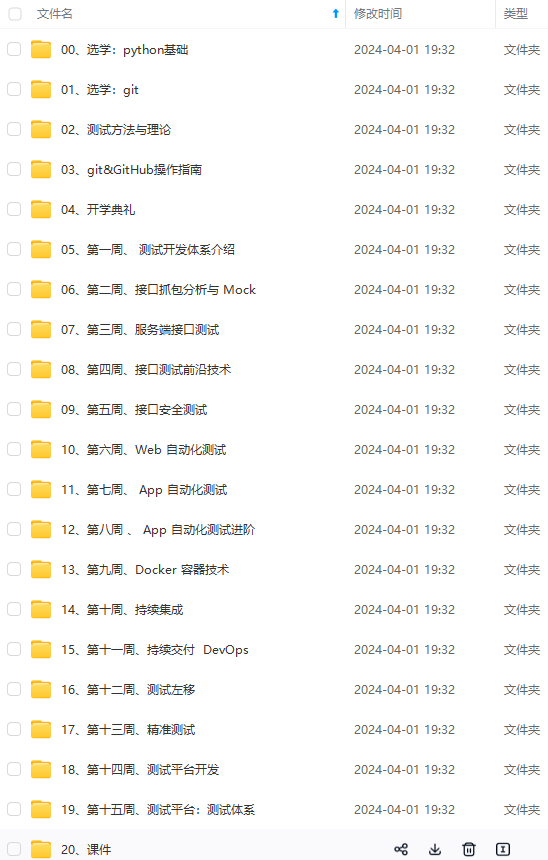

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上软件测试知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

测试目的

为验证及优化agent采集能力、ES集群处理能力及资源占用情况,进行此次性能测试。

环境信息

| 应用服务器 | 地址 | CPU | RAM | 日志文件数 | 日志文件行数 |

| Linux | 10.2.25.82 | 2 | 4G | 2776 | 31745296 |

| Linux | 10.2.25.83 | 2 | 4G | 2747 | 35109522 |

| Linux | 10.2.25.78 | 2 | 4G | 695 | 45553768 |

| Linux | 10.2.25.79 | 2 | 4G | 3036 | 35525706 |

| AIX | 10.2.251.111 | 12 | 8G | 9932 | 77669711 |

| AIX | 10.2.251.112 | 12 | 8G | 1402 | 71758203 |

| ELK服务器 | 地址 | CPU | RAM | 备注 |

| Redis-Linux | 10.2.245.74 | 8 | 24G | 运行logstash |

| ES-Linux | 10.2.245.71 | 4 | 16G | |

| ES-Linux | 10.2.245.72 | 4 | 16G | |

| ES-Linux | 10.2.245.73 | 4 | 16G | 后期改为Logstash |

| ES-Linux | 10.2.245.68 | 4 | 16G | 后期扩展 |

| ES-Linux | 10.2.245.69 | 4 | 16G | 后期扩展 |

| ES-Linux | 190.2.245.70 | 4 | 16G | 后期扩展 |

软件版本

| 软件 | 版本 | 备注 |

| Elasticsearch | 2.4.1 | 安装插件head,bigdesk |

| Logstash | 2.4.0 | AIX上使用java7 32bit,Linux上使用java8 64bit |

| Filebeat | 5.2 |

其他软件如Redis,pv等不一一列出。

采集端性能

由于各应用服务器操作系统的差异,在Linux环境中使用filebeat采集,在AIX环境中暂时使用logstash采集。

Linux-Filebeat性能

默认配置

单个filebeat实例可采集15000条/秒,折合390GB/天,性能可以满足要求。

系统负荷启动时:

系统负荷稳定时:

AIX-Logstash性能

默认配置

单个实例平均采集数:1300/s,折合38GB/天。

系统负荷启动时:

系统负荷稳定时:

调整redis输出配置

output {

#stdout{ codec => rubydebug }

redis{

host=> “10.2.245.74”

port=> 6379

db=> 0

data_type=> “list”

key=> “list_zzm1”

batch => true

batch_events => 2048

}

}

单个实例平均采集数:8400/s,折合218GB/天。优化后,AIX下logstash采集性能提高约6倍。

消费端性能

Linux-Logstash性能

消费端性能即logstash的性能,由于可更改的参数较多,下面对各参数分别进行验证。

可调参数:

| 序号 | 参数 | 类别 | 说明 |

| 1 | LS_HEAP_SIZE | LS | Logstash堆内存大小,默认1g |

| 2 | -w | LS启动 | logstash线程数,默认与cpu数相同 |

| 3 | -b | LS启动 | Batch数,即logstash取多少数据进行一次filter,默认125 |

| 4 | redis.threads | LS input | Redis线程数,默认1 |

| 5 | redis.batch_count | LS input | Redis每次pop的数量,默认1 |

| 6 | es.workers | LS output | Es提交线程,默认1 |

| 7 | es.flush_size | LS output | ESbulk提交数,默认500 |

在ELK-Redis服务器上安装pv,配置logstash输出为dots和ES,启动方式为:

./logstash -f logstash_dots.conf | pv -abt> /dev/null

说明:

1) 由于logstash是java应用,启动过程中随着jvm内存使用提高其处理速率也逐渐提高;

2) pv输出是平均值,而logstash启动过程约8秒,进一步造成显示速率的延迟,下表为启动3个logstash实例一段时间检测到的速率:

| 处理队列 | 5min后 | 10min后 | 20min后 |

| List_zzm1 | 3.7k/s | 4.5k/s | 5.1k/s |

| List_u1z1 | 1.2k/s | 1.6k/s | 1.9k/s |

| List_ngp1 | 1k/s | 1.2k/s | 1.5k/s |

3) 后续记录结果均采用开启3分钟后的数值;

4) 关闭ES输出配置,只输出到dots的情况下,单个logstash实例处理可达20k/s;

默认配置

输出速率:约2.5k/s

ES索引速率:

系统负荷:

启动参数-b 8000

输出速率:5.8k/s

ES索引速率:

系统负荷:

启动参数-w 16

输出速率:4.8k/s

ES索引速率:

系统负荷:

启动参数-w 16 –b 8000

输出速率:6k/s

ES索引速率:

系统负荷:

启动参数-w 16 –b 16000

输出速率:6k/s

ES索引速率:

输入Redis.threads=>8

输出速率:4.6k/s

ES索引速率:

系统负荷:

输入Redis.threads=>8 batch_count=>1024

输出速率:4.7k/s

ES索引速率:

输入Redis.threads=>8 batch_count=>10240

输出速率:4.7k/s

ES索引速率:

输出ES.workers =>8

输出速率:11.3k/s

ES索引速率:

系统负荷:

输出ES.flush_size=>4096

输出速率:4.6k/s

ES索引速率:

系统负荷:

增加workers =>8 flush_size=>4096

输出速率:12k/s

ES索引速率:

综合调整参数

启动参数–b 8192

输入Redis.batch_count=>1024

输出ES.workers=>8 flush_size=>4096

输出速率:8.4k/s

启动多个logstash实例

Agent输出到3个队列:

list_zzm1

list_u1z1

list_ngp1

开启3个logstash收集:

[PVVMBG0008][elk][/app/logstash-2.4.0/bin]#./logstash-f logstash_dots_zzm1.conf -l ./logstash_zzm1.log -b 8000 | pv -abt >/dev/null

6.19MiB 0:23:37 [4.86KiB/s]

[PVVMBG0008][elk][/app/logstash-2.4.0/bin]#./logstash-f logstash_dots_u1z1.conf -l ./logstash_u1z1.log -b 8000 | pv -abt >/dev/null

3.51MiB 0:24:15 [2.73KiB/s]

[PVVMBG0008][elk][/app/logstash-2.4.0/bin]#./logstash-f logstash_dots_ngp1.conf -l ./logstash_ngp1.log -b 8000 | pv -abt > /dev/null

3.69MiB 0:23:51 [2.64KiB/s]

输出速率:4.86+2.74+2.64≈10.2k/s

ES索引速率:

系统负荷:

此时,ES节点负荷:

优化后,消费端logstash性能提高约15倍。

测试记录

3节点2分片1副本

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

2/text/aHR0cDovL2Jsb2cuY3Nkbi5uZXQvZGF2aW5jaXl4dw==/font/5a6L5L2T/fontsize/400/fill/I0JBQkFCMA==/dissolve/70/gravity/Center)

优化后,消费端logstash性能提高约15倍。

测试记录

3节点2分片1副本

[外链图片转存中…(img-bD16xdW3-1715619285198)]

[外链图片转存中…(img-aq3VnHBg-1715619285199)]

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

2029

2029

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?