一、Python所有方向的学习路线

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、Python必备开发工具

工具都帮大家整理好了,安装就可直接上手!

三、最新Python学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、Python视频合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

六、面试宝典

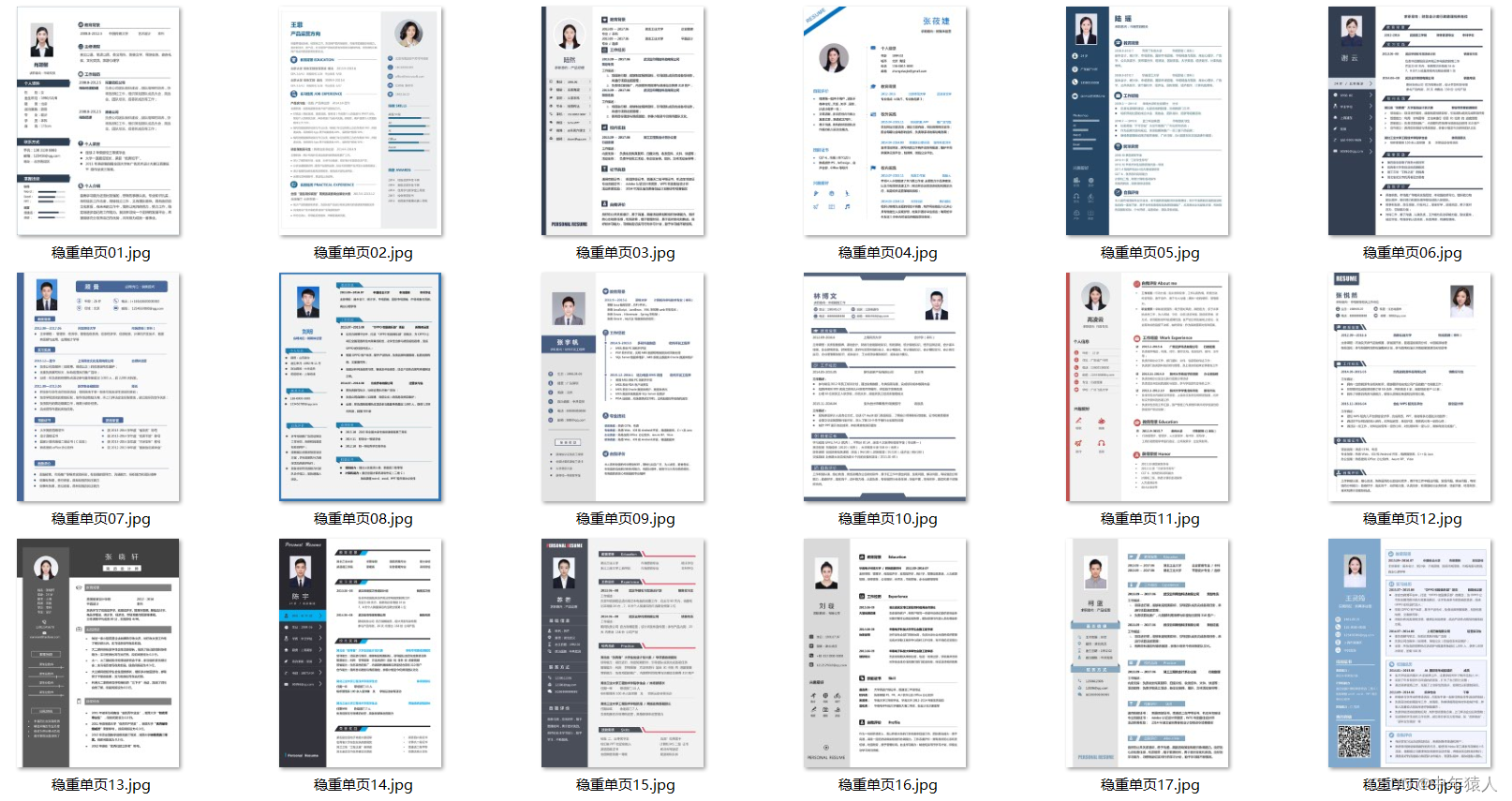

简历模板

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

EDA内容

1.1 输入数据集

train = pd.read_csv(‘./data/train.csv’)

test = pd.read_csv(‘./data/test.csv’)

训练样本

train和test分别是训练集和测试集,分别有 1460 个样本,80 个特征。

SalePrice列代表房价,是我们要预测的。

1.2 房价分布

因为我们任务是预测房价,所以在数据集中核心要关注的就是房价(SalePrice) 一列的取值分布。

sns.distplot(train[‘SalePrice’]);

房价取值分布

从图上可以看出,SalePrice列峰值比较陡,并且峰值向左偏。

也可以直接调用skew()和kurt()函数计算SalePrice具体的偏度和峰度值。

对于偏度和峰度都比较大的情况,建议对SalePrice列取log()进行平滑。

1.3 与房价相关的特征

了解完SalePrice的分布后,我们可以计算 80 个特征与SalePrice的相关关系。

重点关注与SalePrice相关性最强的 10 个特征。

# 计算列之间相关性

corrmat = train.corr()

取 top10

k = 10

cols = corrmat.nlargest(k, ‘SalePrice’)[‘SalePrice’].index

绘图

cm = np.corrcoef(train[cols].values.T)

sns.set(font_scale=1.25)

hm = sns.heatmap(cm, cbar=True, annot=True, square=True, fmt=‘.2f’, annot_kws={‘size’: 10}, yticklabels=cols.values, xticklabels=cols.values)

plt.show()

与SalePrice高度相关的特征

OverallQual(房子材料和装饰)、GrLivArea(地上居住面积)、GarageCars(车库容量)和 TotalBsmtSF(地下室面积)跟SalePrice有很强的相关性。

这些特征在后面做特征工程时也会重点关注。

1.4 剔除离群样本

由于数据集样本量很少,离群点不利于我们后面训练模型。

所以需要计算每个数值特性的离群点,剔除掉离群次数最多的样本。

# 获取数值型特征

numeric_features = train.dtypes[train.dtypes != ‘object’].index

计算每个特征的离群样本

for feature in numeric_features:

outs = detect_outliers(train[feature], train[‘SalePrice’],top=5, plot=False)

all_outliers.extend(outs)

输出离群次数最多的样本

print(Counter(all_outliers).most_common())

剔除离群样本

train = train.drop(train.index[outliers])

detect_outliers()是自定义函数,用sklearn库的LocalOutlierFactor算法计算离群点。

到这里, EDA 就完成了。最后,将训练集和测试集合并,进行下面的特征工程。

y = train.SalePrice.reset_index(drop=True)

train_features = train.drop([‘SalePrice’], axis=1)

test_features = test

features = pd.concat([train_features, test_features]).reset_index(drop=True)

features合并了训练集和测试集的特征,是我们下面要处理的数据。

二. 特征工程

特征工程

2.1 校正特征类型

MSSubClass(房屋类型)、YrSold(销售年份)和MoSold(销售月份)是类别型特征,只不过用数字来表示,需要将它们转成文本特征。

features[‘MSSubClass’] = features[‘MSSubClass’].apply(str)

features[‘YrSold’] = features[‘YrSold’].astype(str)

features[‘MoSold’] = features[‘MoSold’].astype(str)

2.2 填充特征缺失值

填充缺失值没有统一的标准,需要根据不同的特征来决定按照什么样的方式来填充。

# Functional:文档提供了典型值 Typ

features[‘Functional’] = features[‘Functional’].fillna(‘Typ’) #Typ 是典型值

分组填充需要按照相似的特征分组,取众数或中位数

MSZoning(房屋区域)按照 MSSubClass(房屋)类型分组填充众数

features[‘MSZoning’] = features.groupby(‘MSSubClass’)[‘MSZoning’].transform(lambda x: x.fillna(x.mode()[0]))

#LotFrontage(到接到举例)按Neighborhood分组填充中位数

features[‘LotFrontage’] = features.groupby(‘Neighborhood’)[‘LotFrontage’].transform(lambda x: x.fillna(x.median()))

车库相关的数值型特征,空代表无,使用0填充空值。

for col in (‘GarageYrBlt’, ‘GarageArea’, ‘GarageCars’):

features[col] = features[col].fillna(0)

2.3 偏度校正

跟探索SalePrice列类似,对偏度高的特征进行平滑。

# skew()方法,计算特征的偏度(skewness)。

skew_features = features[numeric_features].apply(lambda x: skew(x)).sort_values(ascending=False)

取偏度大于 0.15 的特征

high_skew = skew_features[skew_features > 0.15]

skew_index = high_skew.index

处理高偏度特征,将其转化为正态分布,也可以使用简单的log变换

for i in skew_index:

features[i] = boxcox1p(features[i], boxcox_normmax(features[i] + 1))

2.4 特征删除和新增

对于几乎都是缺失值,或单一取值占比高(99.94%)的特征可以直接删除。

features = features.drop([‘Utilities’, ‘Street’, ‘PoolQC’,], axis=1)

同时,可以融合多个特征,生成新特征。

有时候模型很难学习到特征之间的关系,手动融合特征可以降低模型学习难度,提升效果。

# 将原施工日期和改造日期融合

features[‘YrBltAndRemod’]=features[‘YearBuilt’]+features[‘YearRemodAdd’]

将地下室面积、1楼、2楼面积融合

features[‘TotalSF’]=features[‘TotalBsmtSF’] + features[‘1stFlrSF’] + features[‘2ndFlrSF’]

可以发现,我们融合的特征都是与SalePrice强相关的特征。

最后简化特征,对分布单调的特征(如:100个数据中有99个的数值是0.9,另1个是0.1),进行01处理。

features[‘haspool’] = features[‘PoolArea’].apply(lambda x: 1 if x > 0 else 0)

features[‘has2ndfloor’] = features[‘2ndFlrSF’].apply(lambda x: 1 if x > 0 else 0)

2.6 生成最终训练数据

到这里特征工程就做完了, 我们需要从features中将训练集和测试集重新分离出来,构造最终的训练数据。

X = features.iloc[:len(y), :]

X_sub = features.iloc[len(y):, :]

X = np.array(X.copy())

y = np.array(y)

X_sub = np.array(X_sub.copy())

三. 模型训练

因为SalePrice是数值型且是连续的,所以需要训练一个回归模型。

3.1 单一模型

首先以岭回归(Ridge) 为例,构造一个k折交叉验证模型。

from sklearn.linear_model import RidgeCV

from sklearn.pipeline import make_pipeline

from sklearn.model_selection import KFold

kfolds = KFold(n_splits=10, shuffle=True, random_state=42)

alphas_alt = [14.5, 14.6, 14.7, 14.8, 14.9, 15, 15.1, 15.2, 15.3, 15.4, 15.5]

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

三、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

5750

5750

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?