先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

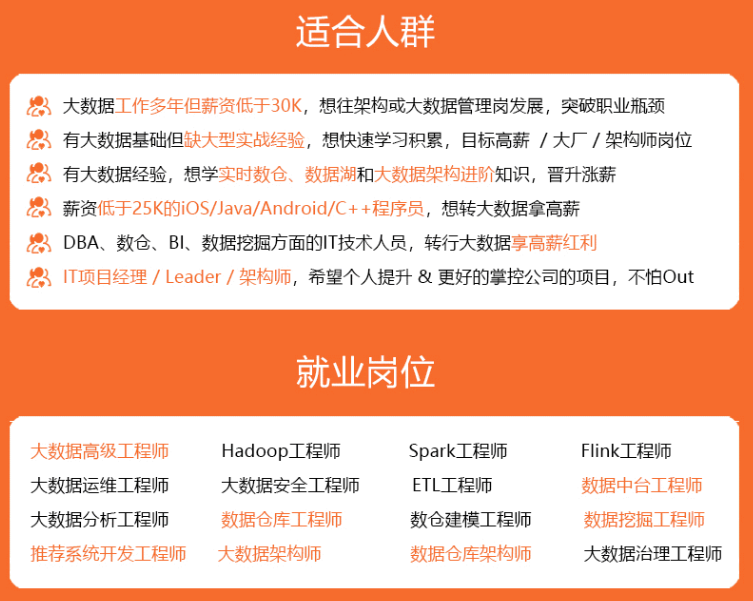

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

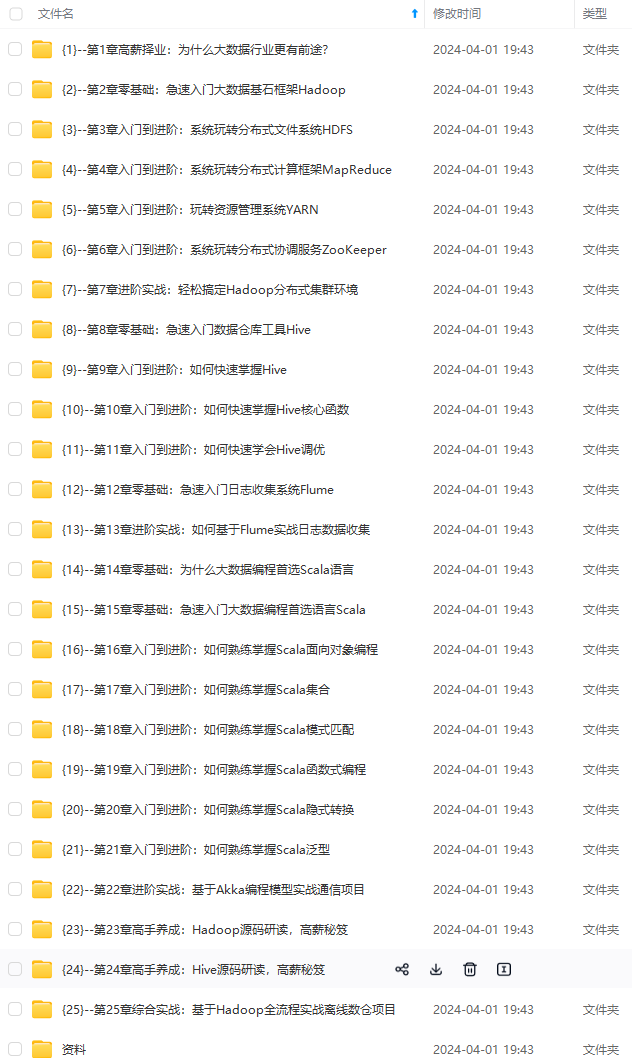

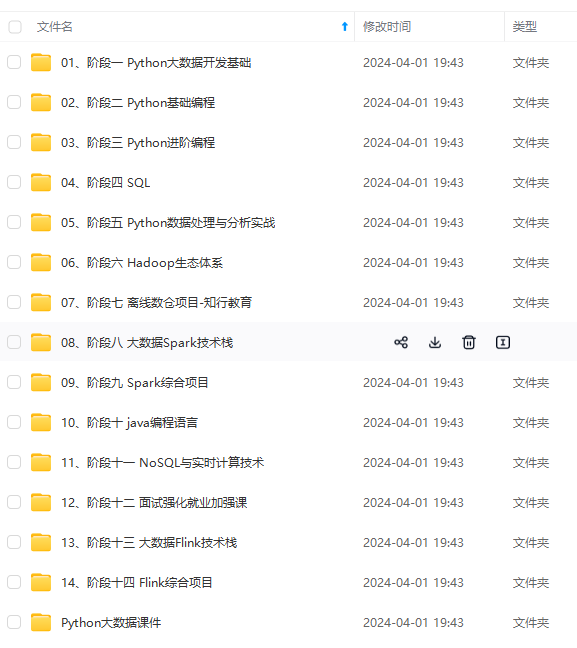

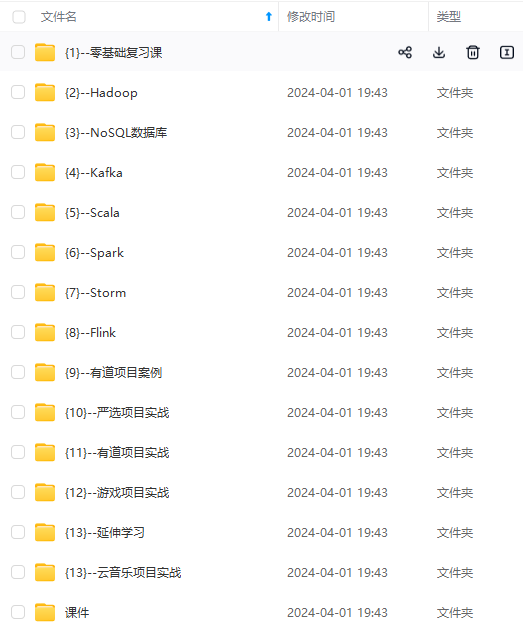

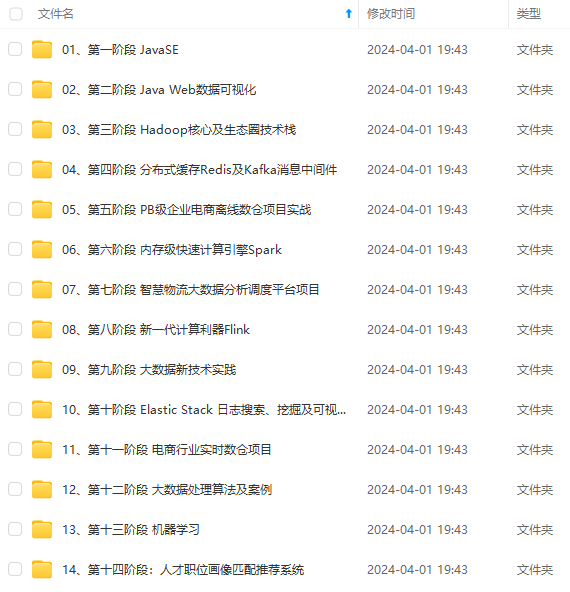

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

172.17.0.4/16

#### 节点、地址对应

* [!] 重启后/etc/hosts的内容被修改,节点ip无法对应,导致启动集群后,Dslave01、Dslave02失败

172.17.0.2 Dmaster

172.17.0.3 Dslave01

172.17.0.4 Dslave02

#### 解决重启失效,写入/etc/hosts

add 2 lines to fix the problem : restart container ,/etc/hosts reset

echo “172.17.0.2 Dmaster” >> /etc/hosts

echo “172.17.0.3 Dslave01” >> /etc/hosts

echo “172.17.0.4 Dslave02” >> /etc/hosts

### 配置文件修改

/usr/local/hadoop/etc/hadoop/

#### core-site

core-site.xml

fs.defaultFS hdfs://Dmaster:9000 hadoop.tmp.dir /home/data/hadoopdata

#### hdfs-site

hdfs-site.xml

dfs.namenode.name.dir /home/data/hadoopdata/name dfs.datanode.data.dir /home/data/hadoopdata/data dfs.replication 1 dfs.namenode.secondary.http-address Dmaster:9868

#### mapred-site

mapred-site.xml

mapreduce.framework.name yarn

#### yarn-site

yarn-site.xml

yarn.resourcemanager.hostname Dmaster yarn.nodemanager.aux-services mapreduce_shuffle

#### workers/slaves

slaves/workers

Dslave01

Dslave02

### 传送到其他节点

#### 测试互联互通

Dmaster ping Dslave01 Dslave02

Dslave01 ping Dmaster Dslave02

Dslave02 ping Dmaster Dslave01

#### 传送

(slaves/workers只需要主机配置)

`/usr/local/hadoop/etc/hadoop`

传送到Dslave01

scp slaves root@Dslave01:/usr/local/hadoop/etc/hadoop/

scp mapred-site.xml root@Dslave01:/usr/local/hadoop/etc/hadoop

scp yarn-site.xml root@Dslave01:/usr/local/hadoop/etc/hadoop/

scp hdfs-site.xml root@Dslave01:/usr/local/hadoop/etc/hadoop

scp core-site.xml root@Dslave01:/usr/local/hadoop/etc/hadoop

scp -r /home/data/hadoopdata root@Dslave01:/home/

传送到Dslave02

scp slaves root@Dslave02:/usr/local/hadoop/etc/hadoop/

scp mapred-site.xml root@Dslave02:/usr/local/hadoop/etc/hadoop

scp yarn-site.xml root@Dslave02:/usr/local/hadoop/etc/hadoop/

scp hdfs-site.xml root@Dslave02:/usr/local/hadoop/etc/hadoop

scp core-site.xml root@Dslave02:/usr/local/hadoop/etc/hadoop

scp -r /home/data/hadoopdata root@Dslave02:/home/

#### 格式化节点

三个机器分别执行

hadoop namenode -format

### 启动集群

/usr/local/hadoop/sbin/start-dfs.sh

/usr/local/hadoop/sbin/stop-dfs.sh

/usr/local/hadoop/sbin/start-yarn.sh

/usr/local/hadoop/sbin/stop-yarn.sh

jps查看信息

jps

查看运行状况

hadoop dfsadmin -report

## hadoop测试

`Dmaster运行`

创建input文件夹

hadoop fs -mkdir /input

hadoop fs -ls /

创建in文本文件,写入内容,添加到/input/下

cd /usr/local/hadoop

touch in.txt

vi in.txt

hadoop fs -put in.txt /input/

切换到mapreduce目录,提交命令

cd share/hadoop/mapreduce

hadoop jar hadoop-mapreduce-examples-2.7.6.jar wordcount /input /output

查看结果

hadoop fs -cat /output/part-r-00000

关闭集群

## hive&mysql

ref

[Hadoop集群安装,mysql安装,hive安装]( )

[Hive安装超详细教程]( )

### 安装部署mysql

#### 安装mysql

wget -i -c http://dev.mysql.com/get/mysql57-community-release-el7-10.noarch.rpm

yum -y install mysql57-community-release-el7-10.noarch.rpm

yum -y install mysql-community-server

报错

报错原因:这是由于MySQL GPG 密钥已过期导致的问题,解决出处需要运行命令, 以2022年为例

rpm --import https://repo.mysql.com/RPM-GPG-KEY-mysql-2022

再运行2、3

#### 启动mysql服务

systemctl start mysqld.service

systemctl status mysqld.service

#### 修改密码、获取权限

获取临时密码

grep “password” /var/log/mysqld.log

登陆mysql

mysql -uroot -p

设置密码规则

set global validate_password_policy=LOW;

set global validate_password_length=6;

修改密码为123456

ALTER USER ‘root’@‘localhost’ IDENTIFIED BY ‘123456’;

允许远程连接

grant all privileges on . to ‘root’@‘%’ identified by ‘123456’ with grant option;

flush privileges;

退出

exit;

登陆mysql

mysql -uroot -p

grant all on . to root@‘%’ identified by ‘123456’;

grant all on . to root@‘localhost’ identified by ‘123456’;

grant all on . to root@‘Dmaster’ identified by ‘123456’;

flush privileges;

#### 创建数据库hive\_13

create database hive_13;

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

ileges;

#### 创建数据库hive\_13

create database hive_13;

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

[外链图片转存中…(img-6Z9Seakj-1713434686567)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

2960

2960

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?