既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

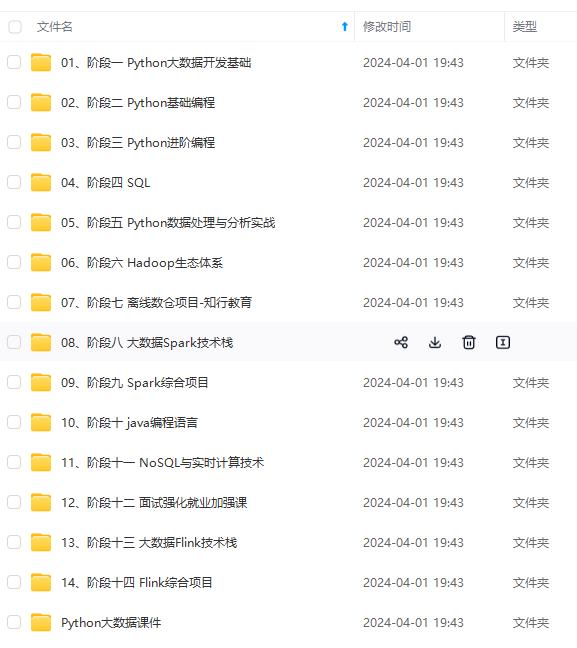

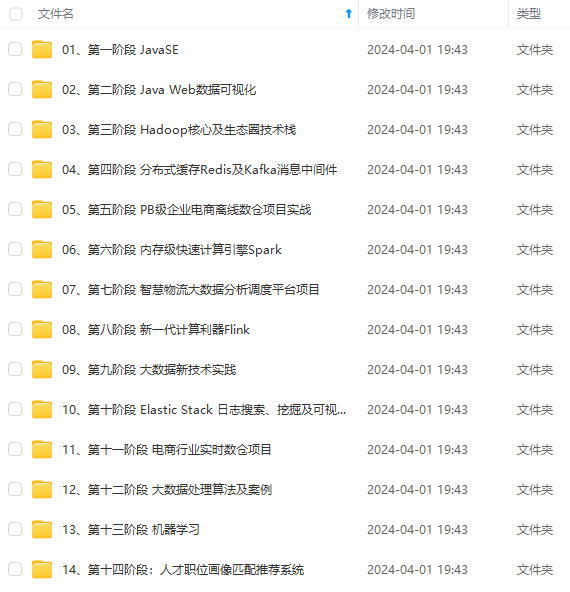

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

"column": [

{

"name": "id",

"type": "INT"

},

{

"name": "name",

"type": "string"

},

{

"name": "age",

"type": "int"

}

],

"writeMode": "append",

"fieldDelimiter": "\t",

"compress":"gzip"

}

}

}

]

}

}

>

> defaultFS 填namenode通信端口

>

>

> path 必须实现在hdfs中完成创建

>

>

> filename 是文件前缀

>

>

>

直接从官网复制下来修改即可 [GitHub - alibaba/DataX: DataX是阿里云DataWorks数据集成的开源版本。]( ),不需要的配置可以删除,如下

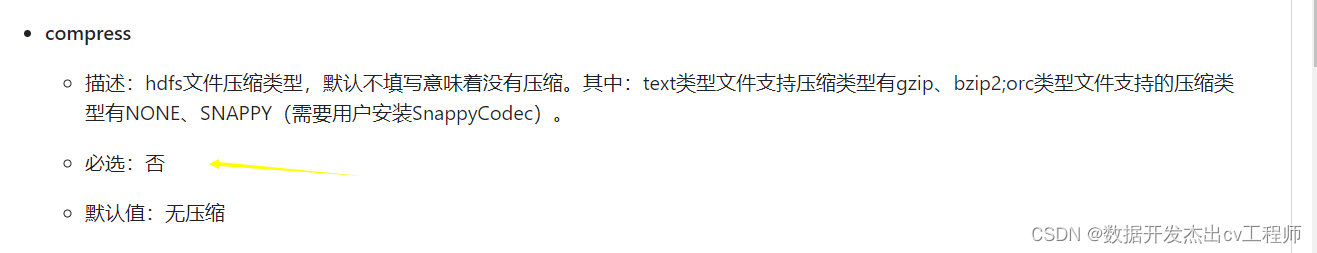

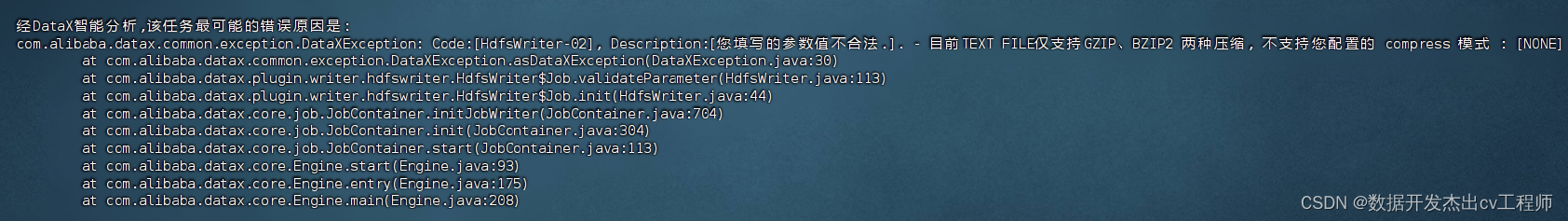

需要注意,text的文件类型,压缩格式必须设置GZIP或者BZIP2,否则会报错。如果使用的orc则不会出现这种问题。

完成建表后,保证hadoop、mysql、hive正常运行,在datax安装目录下执行以下命令(注意,需要修改为自己相应的文件目录)

python /opt/module/datax/bin/datax.py /opt/module/datax/job/test.json

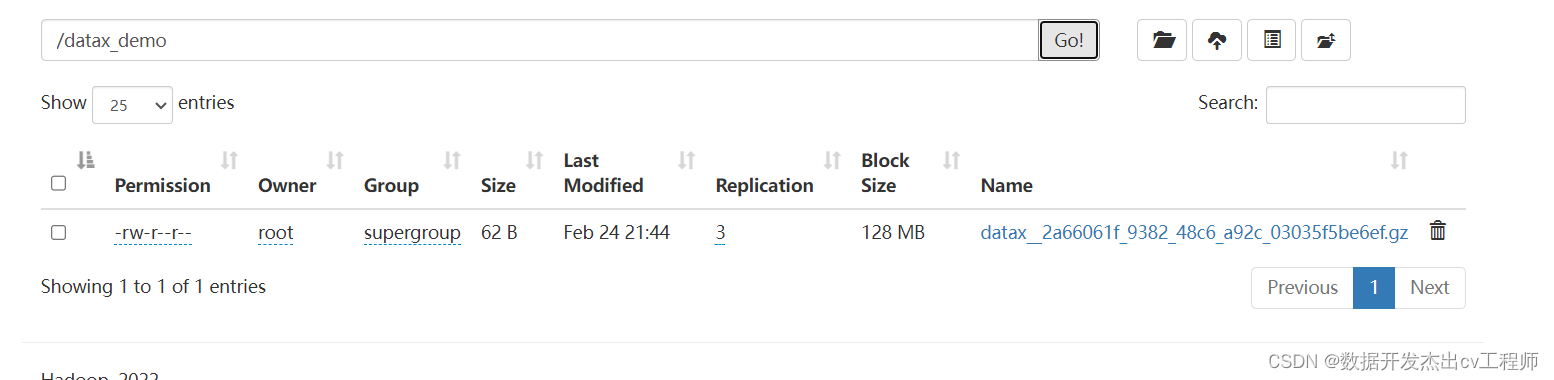

运行后查看结果

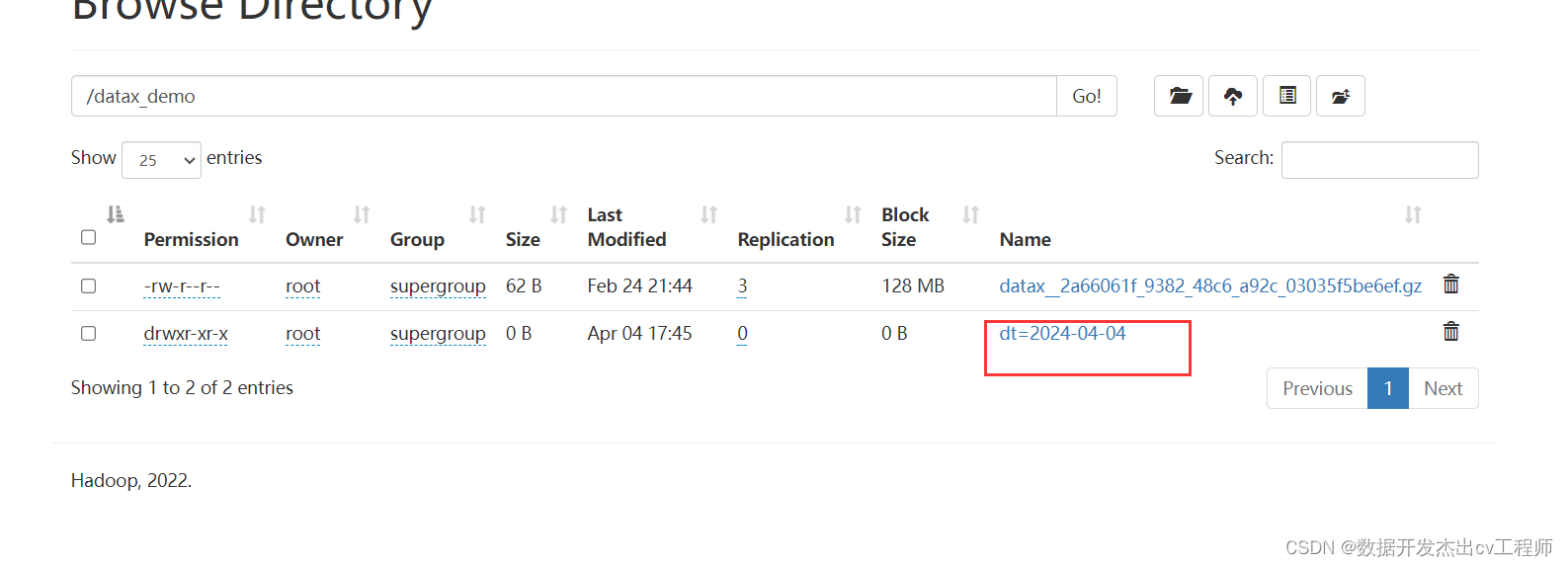

##### 写入指定分区

上面是简单的同步案例,但是hive通常会建分区表,因此我们要考虑怎么将数据读到hive的某一个分区中去,下面我们来实现这个案例。仍然使用mysql的student表,在hive中建一个分区表student2;

create external table student2(id int, name string, age int)

partitioned by (dt string)

row format delimited fields terminated by ‘\t’ location ‘/datax_demo’;

insert into student2 partition(dt=‘2024-04-04’) select 1,‘lily’,19;

>

> 需要注意一点,如果没有执行上面的insert语句,那么在执行datax任务前一定要收到在hdfs里建好文件。

>

>

>

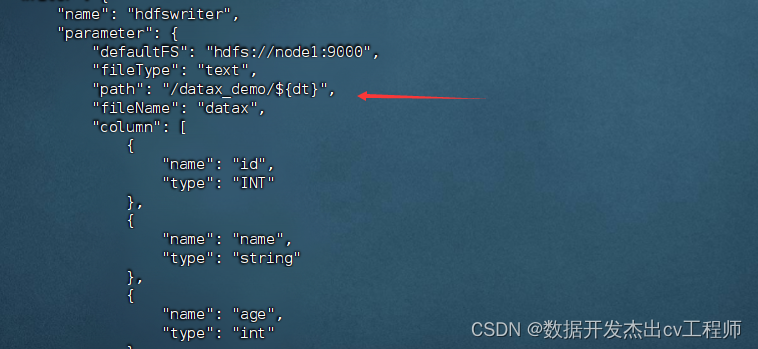

datax的json文件配置仅需要修改hdfs中的writer的path配置

设置一个灵活的传参方式,执行示例如下

python bin/datax.py -p"-Ddt=dt=2024-04-04" job/test_pt.json

>

> 注意,-p后面传入的是参数名和参数值,而这个文件值需要与hdfs中的文件名保持一致。

>

>

>

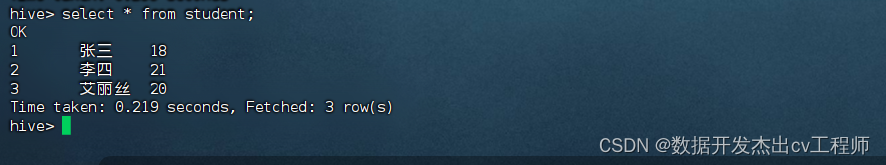

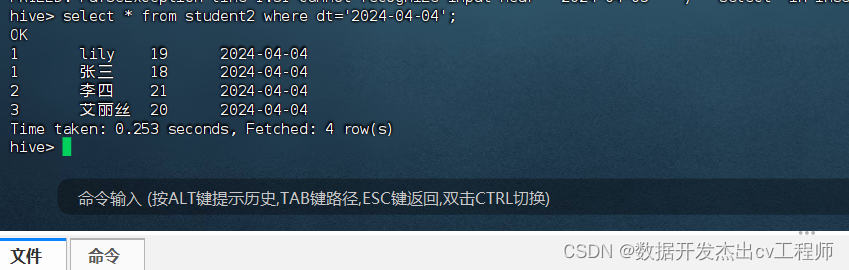

运行后在hive中执行查询

### hive写入mysql

hive的表就使用student2即可,建议写入前将之前insert的00000文件删掉。

mysql DDL

create table if not exists sync_student(id int, name varchar(20), age int);

json文件

{

“job”: {

“setting”: {

“speed”: {

“channel”: 3

}

},

“content”: [

{

“reader”: {

“name”: “hdfsreader”,

“parameter”: {

“path”: “/datax_demo/${dt}/*”,

“defaultFS”: “hdfs://node1:9000”,

“column”: [

{

“type”: “string”,

“index”: 0

},

{

"type": "string",

"index": 1

},

{

"type": "string",

"index": 2

}

],

"fileType": "text",

"encoding": "UTF-8",

"fieldDelimiter": "\t",

"compress":"gzip"

}

},

"writer": {

"name": "mysqlwriter",

"parameter": {

"writeMode": "insert",

"username": "root",

"password": "123456",

"column": [

"id",

"name",

"age"

],

"preSql": [

"truncate table sync_student"

],

"connection": [

{

"jdbcUrl": "jdbc:mysql://node1:3306/test?useSSL=false&allowPublicKeyRetrieval=true&useUnicode=true&characterEncoding=utf-8",

"table": [

"sync_student"

]

}

]

}

}

}

]

}

}

>

> 注意一点,hdfs reader中的数据类型都设置为string,虽然id和age是int类型,但是写成int会报错脏数据,string不会。

>

>

>

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

3157

3157

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?