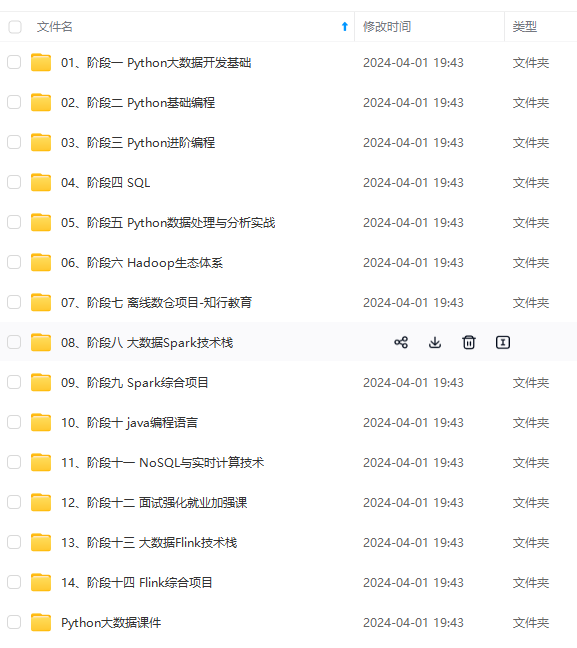

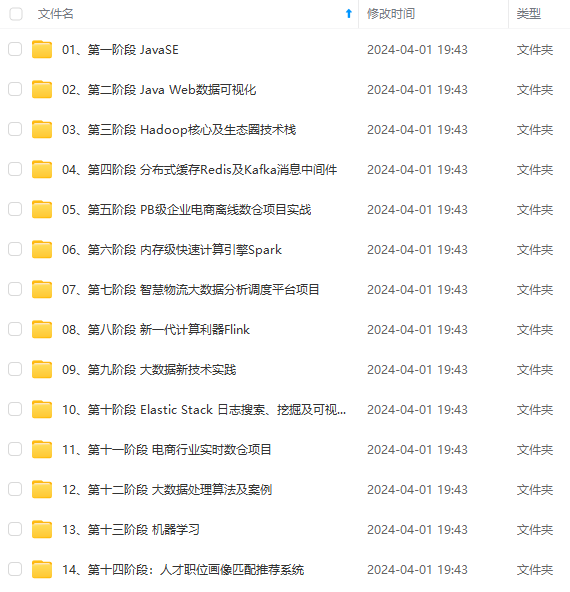

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

大数据常见端口汇总

一、Hadoop

50070:HDFS WEB UI端口

8020 : 高可用的HDFS RPC端口

9000 : 非高可用的HDFS RPC端口

8088 : Yarn 的WEB UI 接口

8485 : JournalNode 的RPC端口

8019 : ZKFC端口

19888:jobhistory WEB UI端口

Hadoop 3.x后,应用的端口有所调整,如下:

二、Zookeeper

2181 : 客户端连接zookeeper的端口

2888 : zookeeper集群内通讯使用,Leader监听此端口

3888 : zookeeper端口 用于选举leader

三、Hbase

16010:Apache的master的WEB UI端口

60010:CDH的master的WEB UI端口

60030:CDH的regionServer的WEB UI 管理端口

四、Hive

9083 : metastore服务默认监听端口

10000:Hive 的JDBC端口

五、Spark

7077 : spark 的master与worker进行通讯的端口 standalone集群提交Application的端口

8080 : master的WEB UI端口 资源调度

8081 : worker的WEB UI 端口 资源调度

4040 : Driver的WEB UI 端口 任务调度

18080:Spark History Server的WEB UI 端口

六、Kafka

9092: Kafka集群节点之间通信的RPC端口

七、Flink

8081 : WEB UI 端口

注意:

- Spark集群后再启动Flink会发现8081端口被Spark占用了

- Kafka的zookeeper和Flink有冲突。

vim flink-conf.yaml

修改或添加(注意:后有一个空格,否则无法生效):

rest.port: 8082

八、Flume

#监听数据来源为本地的xxxx端口

a1.sources.r1.type = xxxx

a1.sources.r1.bind = ip

a1.sources.r1.port = xxxx

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

/topics/618545628)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

1804

1804

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?