BlockSplittingRecursiveEnumerator用于文件能拆分的,会拆分文件块

NonSplittingRecursiveEnumerator文件不能拆分,每个文件作为一个split

- splits

目前关联FileSource是实现了NonSplittingRecursiveEnumerator,最终封装成了一个FileSourceSplit的List列表,这里的参数Parallelism接口里没有用

final String[] hosts =

getHostsFromBlockLocations(fs.getFileBlockLocations(file, 0L, file.getLen()));

target.add(

new FileSourceSplit(

getNextId(),

file.getPath(),

0,

file.getLen(),

file.getModificationTime(),

file.getLen(),

hosts));

- FileSplitAssigner

split分配器,FileSource使用的是LocalityAwareSplitAssigner

这里会有本地文件和远程文件的识别分配,但实际使用的时候还是依赖于上层(SplitEnumerator)的调用,会传入host

最终是由这个类返回一个FileSourceSplit - SplitEnumerator

注意这里传入的参数alreadyProcessedPaths是null,也就是说对于FileSource,每次都是全量扫描

AbstractFileSource里用到了两个实现

StaticFileSplitEnumerator、ContinuousFileSplitEnumerator,分别用于处理有界和无界文件流

3.3.createReader

创建一个阅读器,FileSource的实例是FileSourceReader,大部分功能在基础SourceReaderBase接口中实现了

读取的触发应该由SourceOperator的emitNext接口调用,最终调用到SourceReaderBase的pollNext接口,里面有一个死循环

这里有三层关系:fetch -> split -> record,一层一层获取

循环中有两个处理:1、record列表有数据,走flink的算子间的数据传输流程;2、无数据,则走读取split的流程(split也是一批批读取的,所以这里面包好了两个方法,从当前的split读取数据和读取下一个split)

fetch的获取由SplitFetcherManager控制,最终由FetchTask获取。有一个在各个对象之间传递的elementsQueue对象,存储了fetch列表,FetchTask会向它增加元素,在SourceReaderBase当中读取

3.4.用法

在WordCount里有样例

FileSource.FileSourceBuilder<String> builder =

FileSource.forRecordStreamFormat(

new TextLineInputFormat(), params.getInputs().get());

// If a discovery interval is provided, the source will

// continuously watch the given directories for new files.

params.getDiscoveryInterval().ifPresent(builder::monitorContinuously);

text = env.fromSource(builder.build(), WatermarkStrategy.noWatermarks(), "file-input");

forRecordStreamFormat接口定义数据格式,会在创建FileSourceReader的时候使用

monitorContinuously就是配置流式监控文件

最终是通过env封装成Source

4.SourceTransformation\SourceOperator

Flink数据源的执行表现形式还是SourceOperator,所以最终的执行触发还是在这个结构。算子层面,Source的表现形式为SourceTransformation,由SourceTransformation触发构建SourceOperator

原生的Source是SourceTransformation的一个成员

public SourceTransformation(

String name,

Source<OUT, SplitT, EnumChkT> source,

WatermarkStrategy<OUT> watermarkStrategy,

TypeInformation<OUT> outputType,

int parallelism) {

super(name, outputType, parallelism);

this.source = source;

this.watermarkStrategy = watermarkStrategy;

}

SourceOperator里有三个核心方法:

emitNext:是Operator的统一数据流转接口,即处理一次数据的接口

open\initReader:open里也调用了initReade,主要都是为了做初始化

4.1.initReader

这里面主要是创建了SourceReaderContext,SourceReaderContext里有两个重要的方法,负责向Coordinator发送请求

@Override

public void sendSplitRequest() {

operatorEventGateway.sendEventToCoordinator(

new RequestSplitEvent(getLocalHostName()));

}

@Override

public void sendSourceEventToCoordinator(SourceEvent event) {

operatorEventGateway.sendEventToCoordinator(new SourceEventWrapper(event));

}

4.2.open

核心是对Reader的三步操作:1、初始化,即上面的initReader方法;2、注册,即向Coordinator发送请求,注册reader;3、启动,调用Reader的启动接口

4.3.emitNext

核心是通过SourceReader获取数据

// short circuit the hot path. Without this short circuit (READING handled in the

// switch/case) InputBenchmark.mapSink was showing a performance regression.

if (operatingMode == OperatingMode.READING) {

return convertToInternalStatus(sourceReader.pollNext(currentMainOutput));

}

return emitNextNotReading(output);

5.ScanTableSource

关键接口是getScanRuntimeProvider,有子类实现,返回一个运行时数据读取器

6.相关类集合

- Source - 帮助在运行时创建SplitEnumerator和SourceReader的工厂样式类。

- SourceSplit - 所有拆分类型的接口。

- SplitEnumerator - 发现拆分并将它们分配给SourceReaders

- SplitEnumeratorContext - 向SplitEnumerator提供必要的信息以分配拆分并将自定义事件发送到SourceReaders。

- SplitAssignment - 一个容器类,其中包含每个子任务的源拆分分配。

- SourceReader - 从SplitEnumerator分配的拆分中读取记录。

- SourceReaderContext - 为SourceReader提供必要的功能以与SplitEnumerator通信。

- SourceOutput - 收集器样式接口,用于获取SourceReader发出的记录和时间戳。

- WatermarkOutput -用于发出水印并指示源空闲的接口。

- Watermark - 将在包org.apache.flink.api.common.eventtime 中创建一个新的 Watermark 类。 该类最终将替换org.apache.flink.streaming.api.watermark 中现有的 Watermark。 此更改允许 flink-core 保持独立于其他模块。鉴于我们最终会将所有水印生成放入源中,因此此更改将是必要的。请注意,此 FLIP 并不打算更改水印在源发出后可以在 DataStream 中覆盖的现有方式。

7.SourceCoordinator

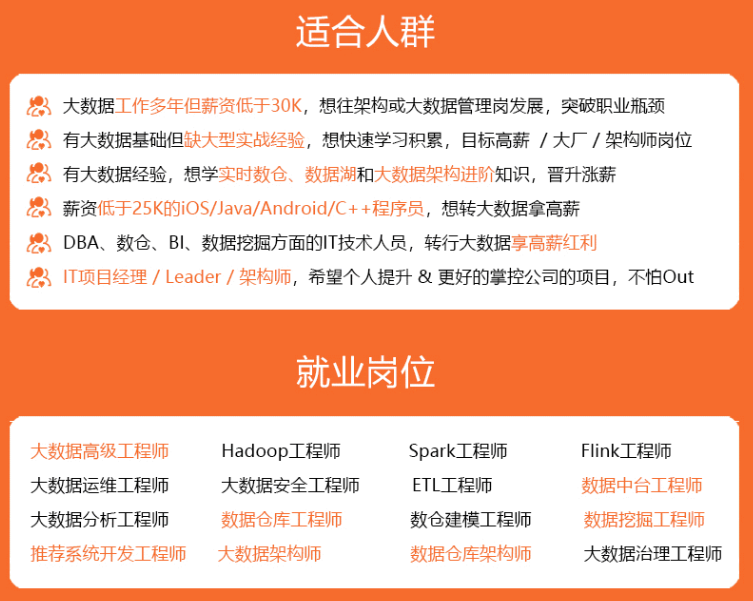

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数大数据工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!

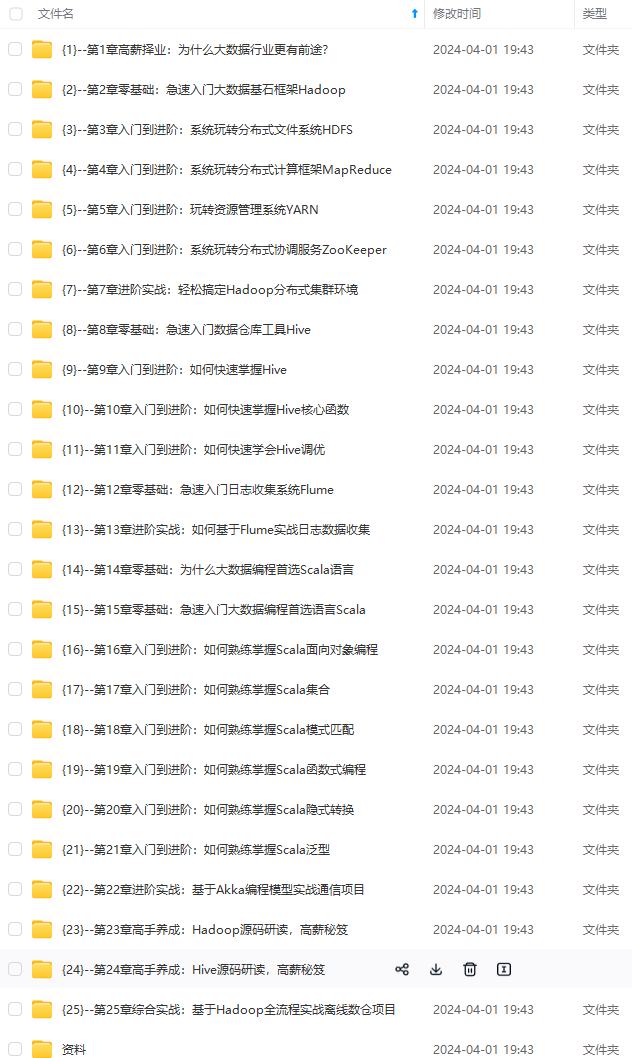

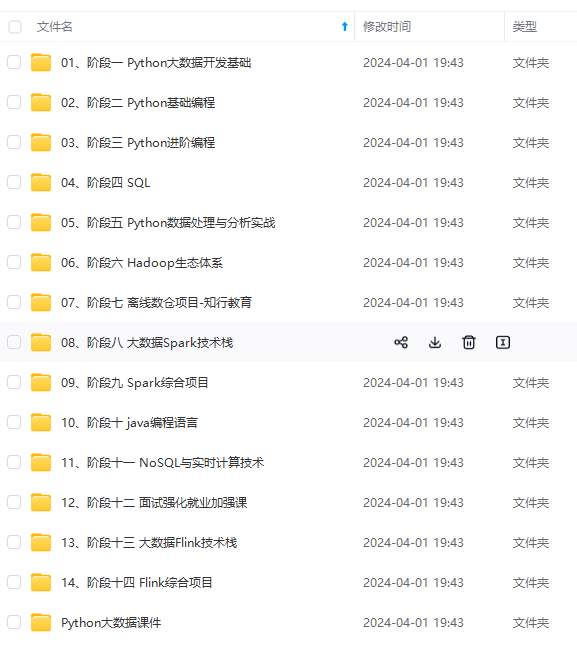

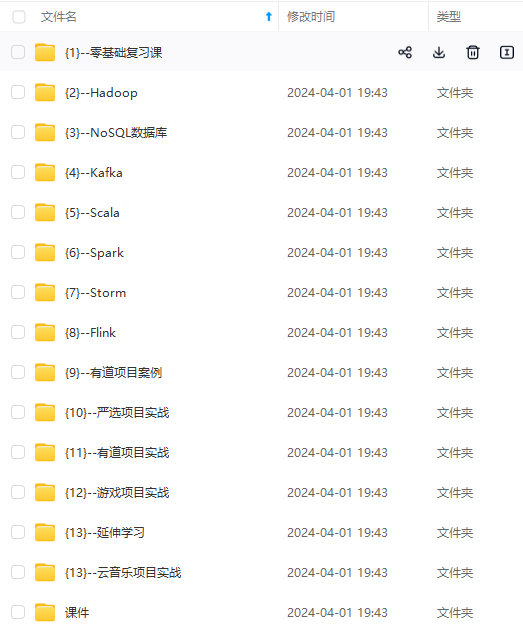

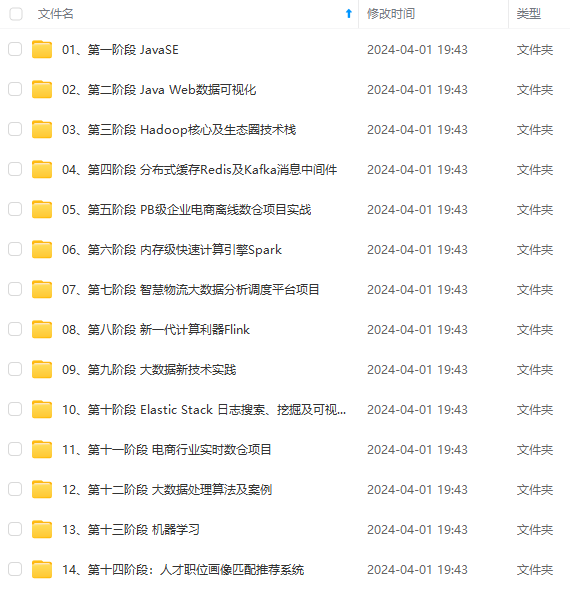

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

容对你有帮助,可以添加VX:vip204888 (备注大数据获取)**

[外链图片转存中…(img-RpZzwU1x-1712962743541)]

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

497

497

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?