网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

source /etc/profile

java -version

**评测!**

**第2关:配置开发环境 - Hadoop安装与伪分布式集群搭建:**

cd /opt ll

tar -zxvf hadoop-3.1.0.tar.gz -C /app

cd /app

mv hadoop-3.1.0/ hadoop3.1

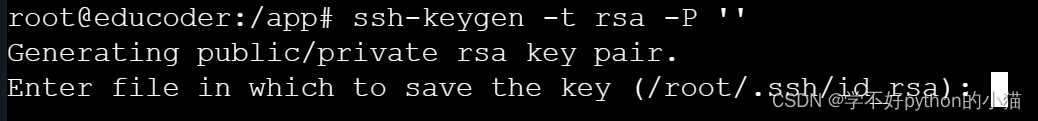

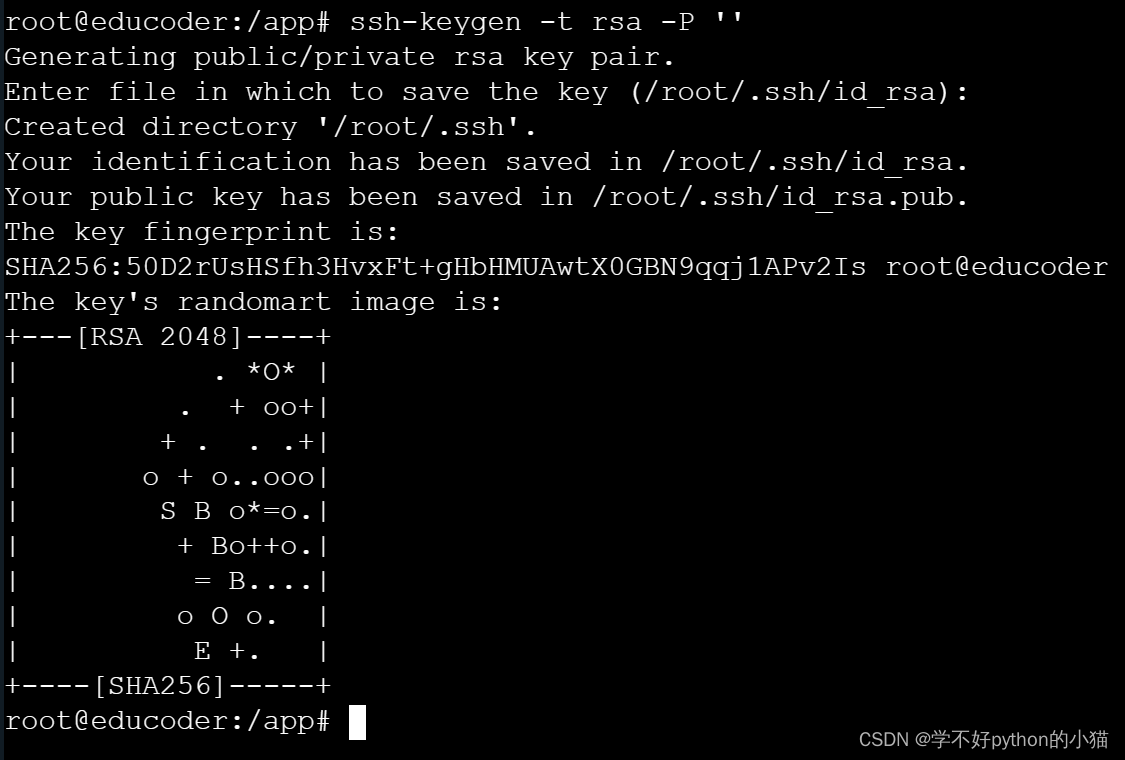

ssh-keygen -t rsa -P ‘’

#两次回车 图3 图4

图3:

图4:

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

chmod 600 ~/.ssh/authorized_keys

>

> **家人们坚持住,一大波vim即将来袭 !!!**

>

>

>

vim /etc/ssh/sshd_config

RSAAuthentication yes # 启用 RSA 认证

PubkeyAuthentication yes # 启用公钥私钥配对认证方式

AuthorizedKeysFile %h/.ssh/authorized_keys # 公钥文件路径

cd /app/hadoop3.1/etc/hadoop

vim hadoop-env.sh

export JAVA_HOME=/app/jdk1.8.0_171

vim yarn-env.sh

export JAVA_HOME=/app/jdk1.8.0_171

>

> **又一大波vim飘过~~~**

>

>

> **插入的内容放在两个<configuration>中。如下图:**

>

>

>

vim core-site.xml

fs.default.name hdfs://localhost:9000 HDFS的URI,文件系统://namenode标识:端口号 hadoop.tmp.dir /usr/hadoop/tmp namenode上本地的hadoop临时文件夹

vim hdfs-site.xml

dfs.name.dir /usr/hadoop/hdfs/name namenode上存储hdfs名字空间元数据 dfs.data.dir /usr/hadoop/hdfs/data datanode上数据块的物理存储位置 dfs.replication 1

vim mapred-site.xml

mapreduce.framework.name yarn

vim yarn-site.xml

yarn.nodemanager.aux-services mapreduce_shuffle yarn.resourcemanager.webapp.address 192.168.2.10:8099 这个地址是mr管理界面的

>

> **最后一波了,挺住!!!**

>

>

>

将Hadoop添加到环境变量中并设置`root`用户可以启动`hadoop`

mkdir /usr/hadoop

mkdir /usr/hadoop/tmp

mkdir /usr/hadoop/hdfs

mkdir /usr/hadoop/hdfs/data

mkdir /usr/hadoop/hdfs/name

vim /etc/profile

在文件末尾插入下面代码:

#set Hadoop Environment

export HADOOP_HOME=/app/hadoop3.1

export PATH=

P

A

T

H

:

PATH:

PATH:HADOOP_HOME/bin:$HADOOP_HOME/sbin

source /etc/profile

hadoop namenode -format

cd /app/hadoop3.1/sbin

>

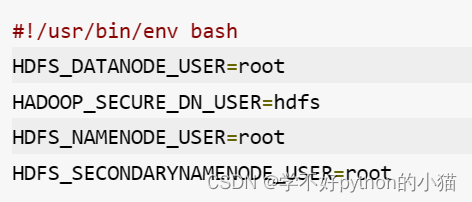

> 下面的vim均在文件头部插入。如图:

>

>

>

vim start-dfs.sh

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=hdfs

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

vim stop-dfs.sh

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=hdfs

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

vim start-yarn.sh

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

-1715079699399)]

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

5436

5436

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?