先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

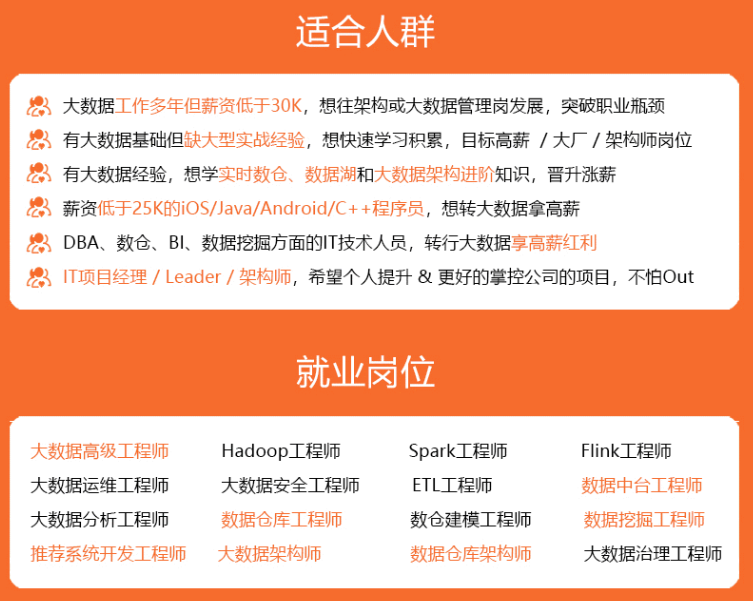

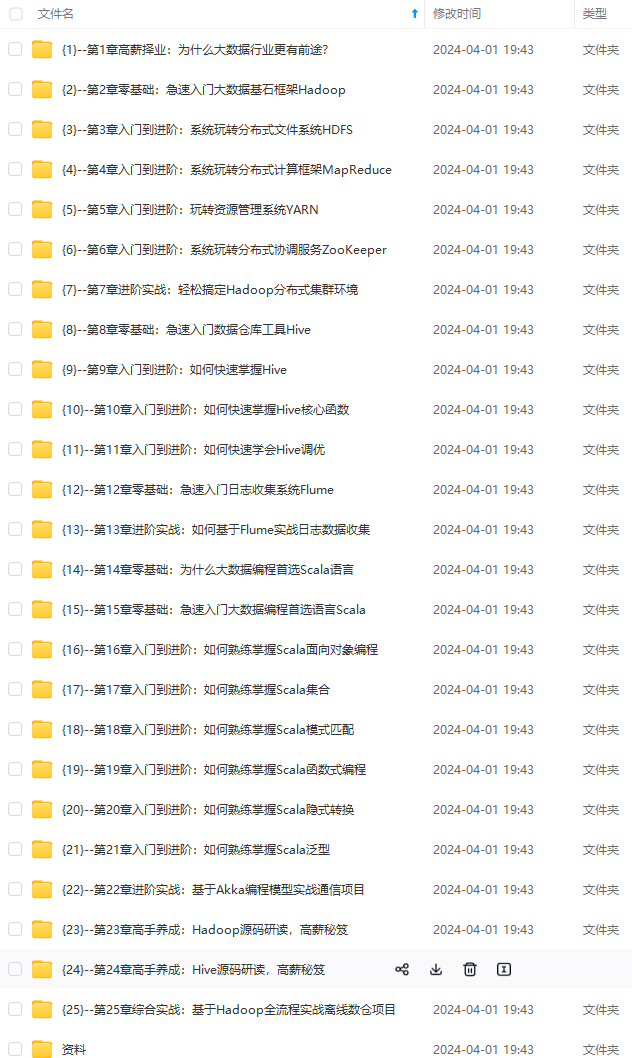

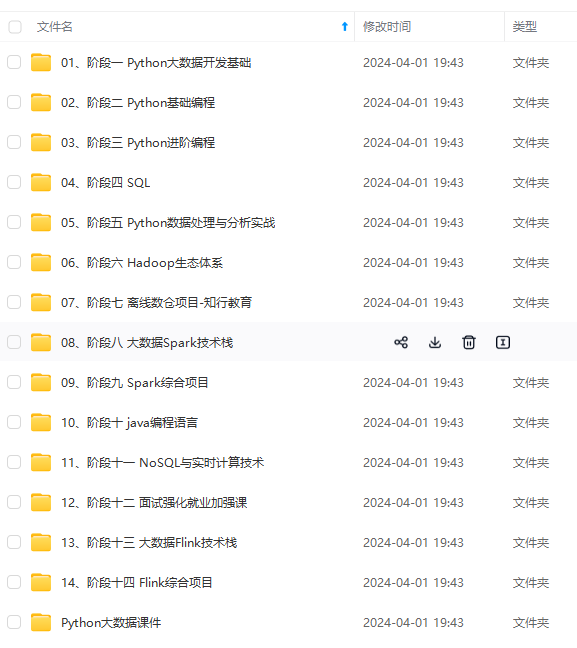

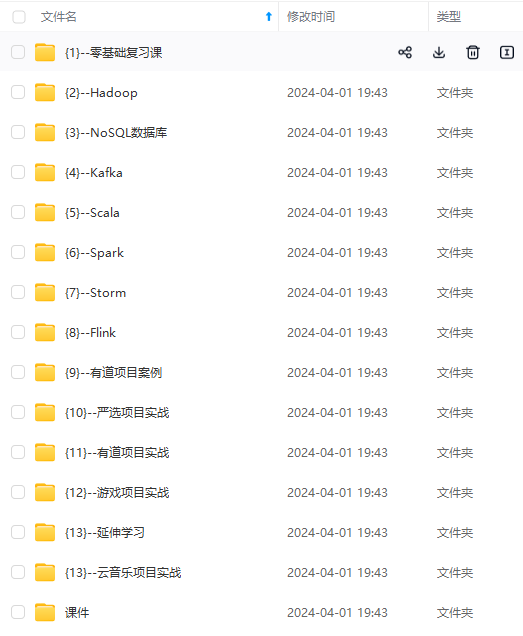

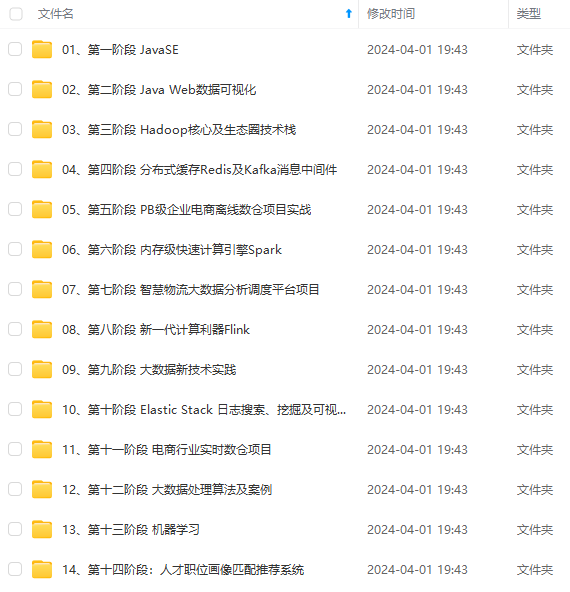

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

val dataStream = env.fromSource(kafkaSource, WatermarkStrategy.noWatermarks(), "03")

- formSource : 从外部数据源创建一个数据流

- kafkaSource : kafka地址及配置

- WatermarkStrategy.noWatermarks() : 不使用水印,用处理时间来处理数据

- 03 : 船体给fromSource方法的第二个参数,表示消费组ID

指定kafka数据 并显示

val transsformDataStream=dataStream

.map(line => {

val data = line.split(",")

(data(1).toInt, data(3),data(6).toInt)

})

.filter(_._2 == "预警")

.filter(_._3%2==0)

.keyBy(_._1)

.window(SlidingProcessingTimeWindows.of(Time.minutes(1),Time.seconds(1)))

.min(0)

.map(x=>SensorReading(x._1,x._3,new SimpleDateFormat("yyyy-MM-dd HH:mm:ss").format(new Date )))

// 获取当前系统时间

transsformDataStream.print()

transsformDataStream.addSink(new JDBCSink)

写入mysql

transsformDataStream.addSink(new JDBCSink)

执行flink程序

env.execute()

创建样例类

case class SensorReading(change_machine_id:Int,totalwarning:Int,window_end_time:String)

创建与MySQL连接方法的类

class JDBCSink() extends RichSinkFunction[SensorReading]{

//定义sql连接、预编译器

var conn: sql.Connection = _

var insertStmt: sql.PreparedStatement = _

var updateStmt: sql.PreparedStatement = _

//_是一个占位符,表示该变量尚未被初始化

override def open(parameters: Configuration): Unit = {

super.open(parameters)

conn=DriverManager.getConnection("jdbc:mysql://localhost:3306/databasename", "root", "密码")

insertStmt = conn.prepareStatement("INSERT INTO threemin_warning_state_agg (change_machine_id, totalwarning, window_end_time) VALUES (?,?,?)")

//updateStmt = conn.prepareStatement("UPDATE threemin_warning_state_agg SET totalwarning = ?,window_end_time=? WHERE change_machine_id = ?")

}

//调用连接,执行sql

override def invoke(value: SensorReading, context: SinkFunction.Context): Unit = {

//执行插入语句

insertStmt.setInt(1,value.change_machine_id)

insertStmt.setInt(2,value.totalwarning)

insertStmt.setString(3,value.window_end_time)

insertStmt.execute()

}

//关闭时做清理工作

override def close(): Unit = {

insertStmt.close()

updateStmt.close()

conn.close()

}

}

完整代码

import com.ibm.icu.text.SimpleDateFormat

import flink.g1.MyRedisMapper

import org.apache.flink.api.common.eventtime.WatermarkStrategy

import org.apache.flink.api.common.serialization.SimpleStringSchema

import org.apache.flink.api.scala.createTypeInformation

import org.apache.flink.configuration.Configuration

import org.apache.flink.connector.kafka.source.KafkaSource

import org.apache.flink.connector.kafka.source.enumerator.initializer.OffsetsInitializer

import org.apache.flink.streaming.api.functions.sink.{RichSinkFunction, SinkFunction}

import org.apache.flink.streaming.api.scala.StreamExecutionEnvironment

import org.apache.flink.streaming.api.windowing.assigners.SlidingProcessingTimeWindows

import org.apache.flink.streaming.api.windowing.time.Time

import java.sql. DriverManager

import java.sql

import java.util.Date

case class SensorReading(change_machine_id:Int,totalwarning:Int,window_end_time:String)

object g3 {

def main(args: Array[String]): Unit = {

val kafkaSource=KafkaSource.builder()

.setTopics("ChangeRecord")

.setBootstrapServers("bigdata1:9092")

.setValueOnlyDeserializer(new SimpleStringSchema())

.setStartingOffsets(OffsetsInitializer.earliest())

.build()

val env:StreamExecutionEnvironment=StreamExecutionEnvironment.getExecutionEnvironment

env.setParallelism(1)

// 实时读取Kafka数据,不设置水印:watermark,目的是使用处理时间

//不设置水印,不生成时间戳 时间戳表示事件时间 不生成则使用处理时间

val dataStream = env.fromSource(kafkaSource, WatermarkStrategy.noWatermarks(), "03")

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

ip204888 (备注大数据)**

[外链图片转存中...(img-Cz6FqVRu-1713180276186)]

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

2003

2003

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?