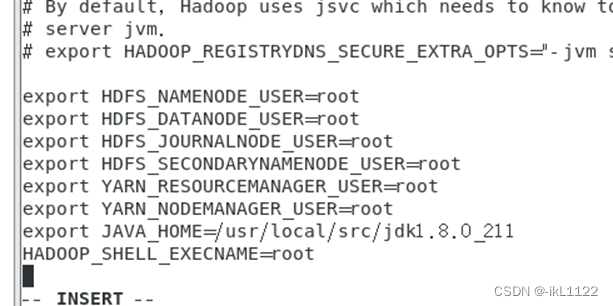

6.配置hadoop-env.sh文件及其他重要文件

首先进入hadoop所在配置文件目录/usr/local/src/Hadoop-3.3.6/etc/hadoop,在此目录打开终端。

vim Hadoop-env.sh

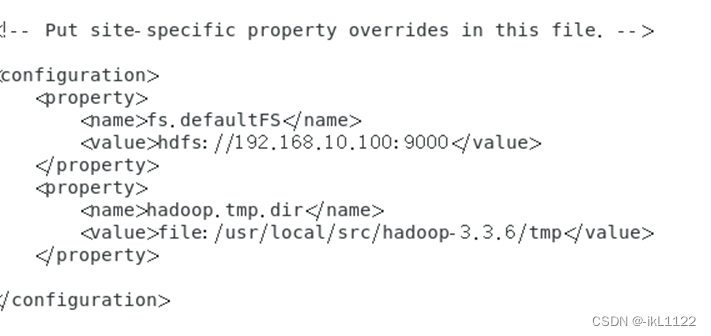

修改core-site.xml, vim core-site.xml

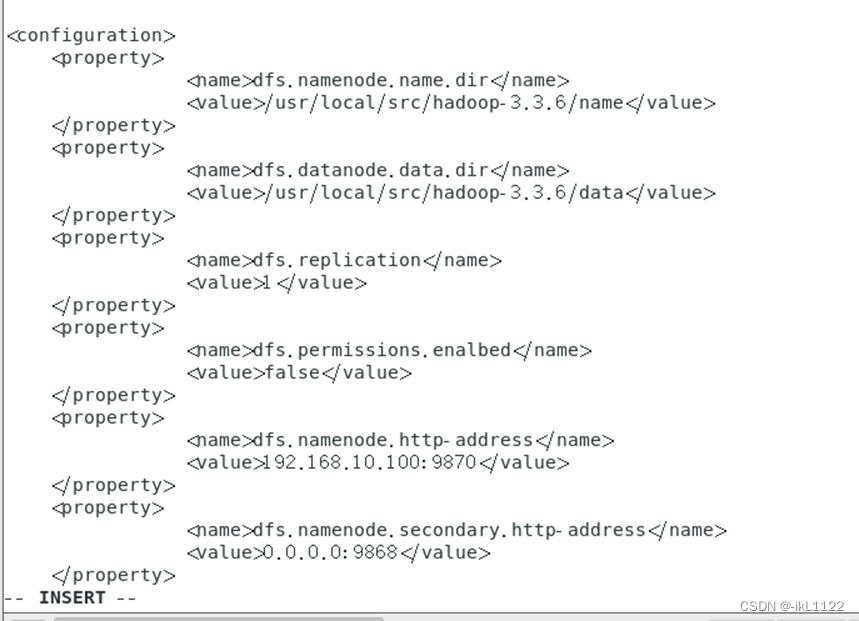

修改hdfs-site.xml文件

修改yarn-site.xml文件

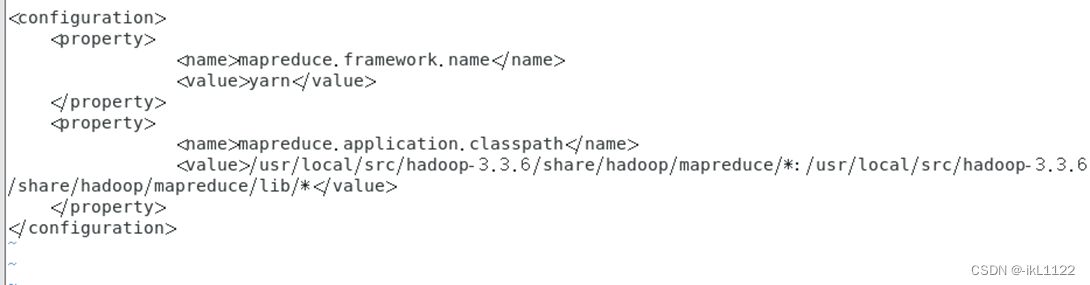

修改mapred-site.xml文件

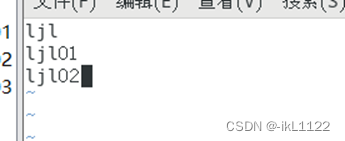

修改workers

7.分发文件

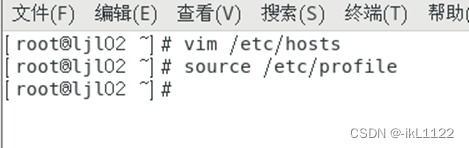

cd /usr/local/src# 分发jdk,$PWD:获取当前所在目录的绝对路径 scp -r jdk1.8.0_211 root@ljl01:$PWD scp -r jdk1.8.0_211 root@ljl02:$PWD # 分发hadoop scp -r hadoop-3.3.6 root@ljl01:$PWD scp -r hadoop-3.3.6 root@ljl02:$PWD # 分发/etc/hosts scp /etc/hosts root@ ljl01:/etc/ scp /etc/hosts root@ ljl02:/etc/ # 分发/etc/profile scp /etc/profile root@ ljl01:/etc/ scp /etc/profile root@ ljl02:/etc/

然后在两个从节点上执行 source /etc/profile

8.启动hadoop集群并测试

启动hdfs

start-dfs.sh

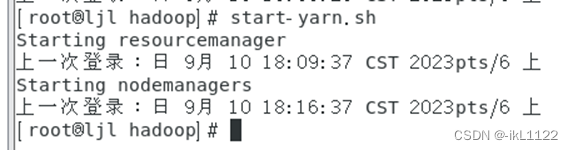

启动yarn

start-yarn.sh

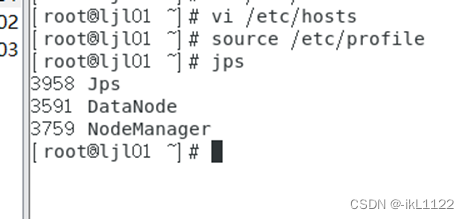

jps 分别查看三个节点的进程

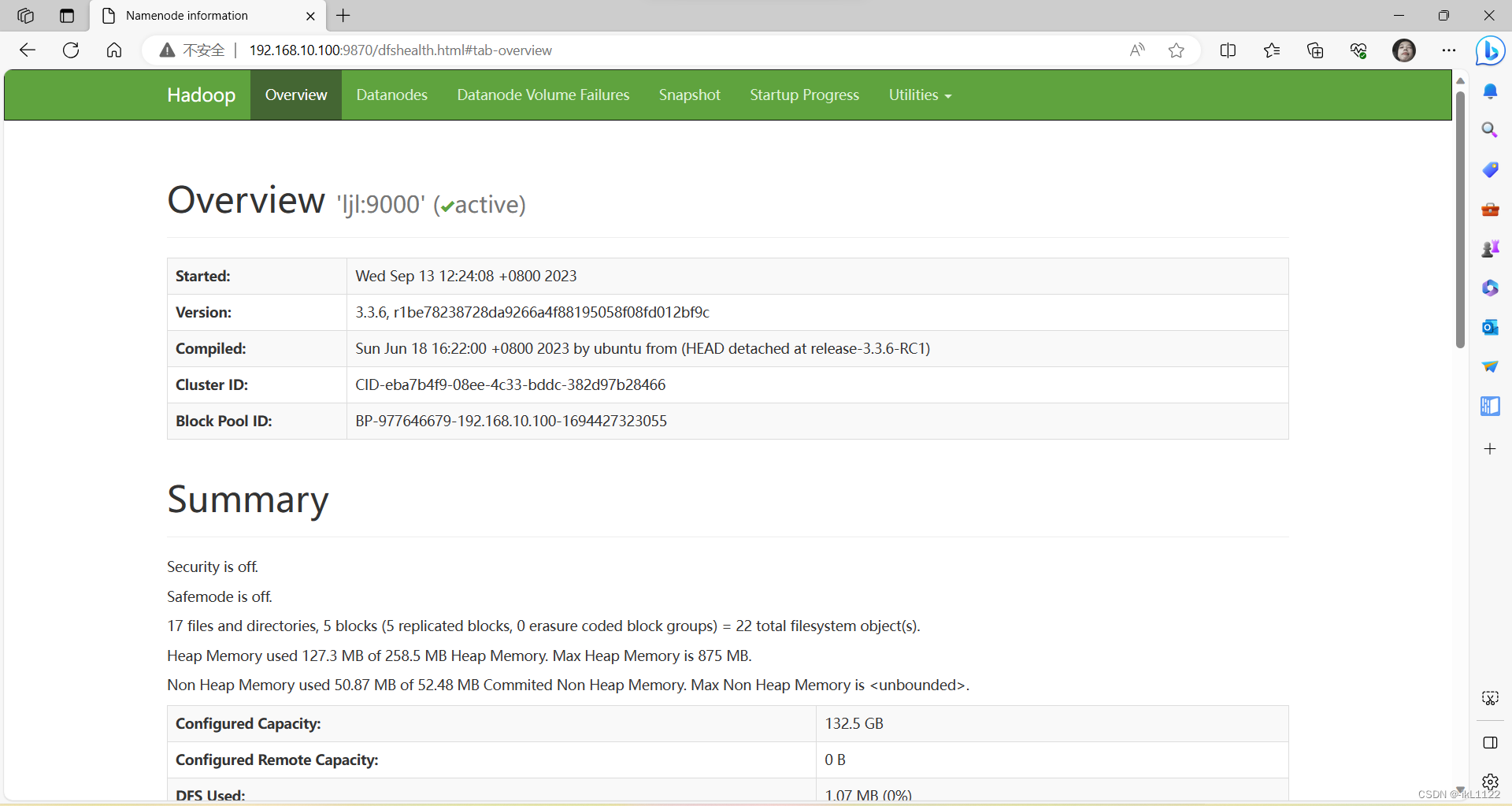

9.访问web界面

主节点的地址+端口号(如:192.168.10.100:9870)

10.运行官方案例

统计每个单词出现的频率

vi words.txt 然后添加如下内容

hadoop hdfs hdfs Hadoop mapreduce mapreduce Hadoop hdfs Hadoop yarn yarn

hdfs dfs -mkdir /input #在hdfs上创建文件夹

hdfs dfs -put words.txt /input/ #把words.txt上传到dfs的input 文件夹中

后运行wordcount

hdfs dfs -ls /output #查看结果

集群搭建结束。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。*

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?