先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

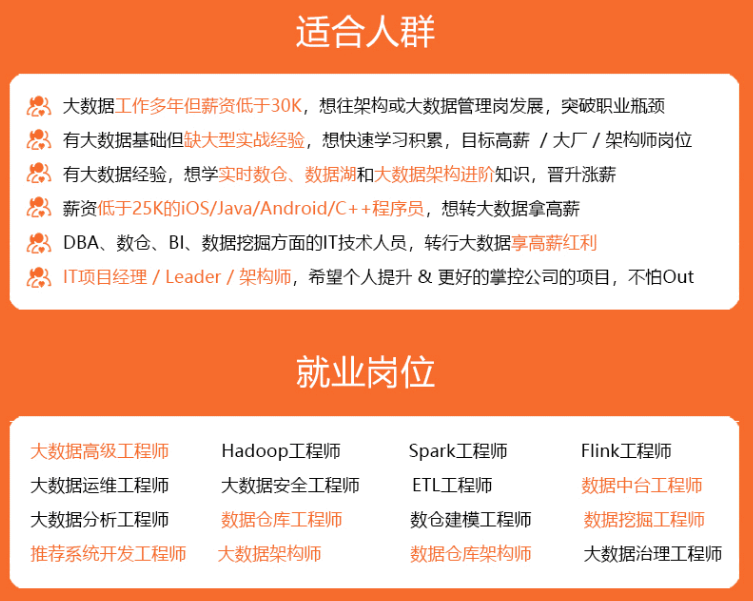

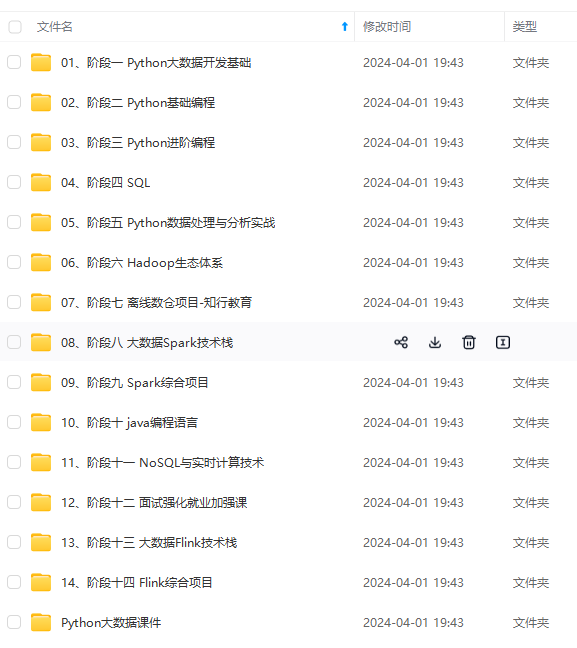

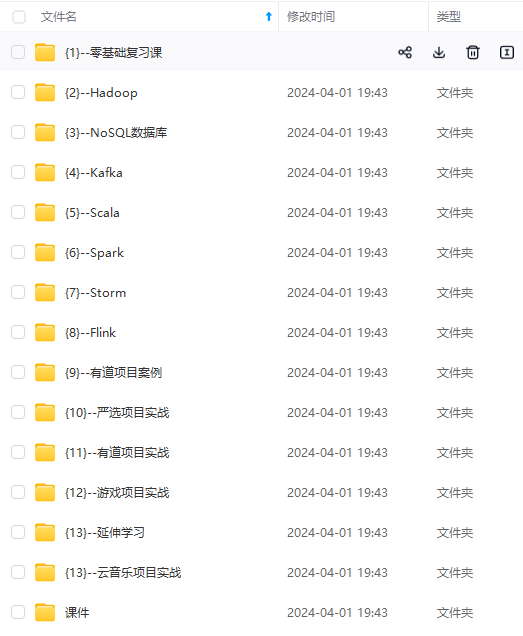

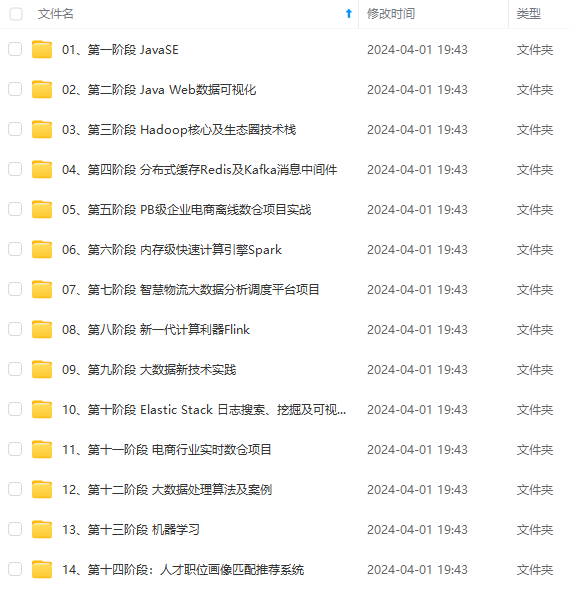

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

- 1、HDFS文件块大小(面试重点)

- 硬盘读写速度

- 在企业中 一般128m(中小公司) 256m (大公司)

- 2、HDFS的Shell操作(开发重点)

- 3、HDFS的读写流程(面试重点)

三、Map Reduce

1、InputFormat

- 1)默认的是TextInputformat kv key偏移量,v :一行内容

- 2)处理小文件CombineTextInputFormat 把多个文件合并到一起统一切片

2、Mapper

- setup()初始化; map()用户的业务逻辑; clearup() 关闭资源;

3、分区

- 默认分区HashPartitioner ,默认按照key的hash值%numreducetask个数

- 自定义分区

4、排序

- 1)部分排序 每个输出的文件内部有序。

- 2)全排序: 一个reduce ,对所有数据大排序。

- 3)二次排序: 自定义排序范畴, 实现 writableCompare接口, 重写compareTo方法

5、Combiner

前提:不影响最终的业务逻辑(求和 没问题 求平均值)

提前聚合map => 解决数据倾斜的一个方法

6、Reducer

- 用户的业务逻辑;

- setup()初始化;

- reduce()用户的业务逻辑;

- clearup() 关闭资源;

7、OutputFormat

- 1)默认TextOutputFormat 按行输出到文件

- 2)自定义

四、Yarn

- 1、Yarn的工作机制(面试题)

- 2、Yarn的调度器

- 1)FIFO/容量/公平

- 2)apache 默认调度器 容量; CDH默认调度器 公平

- 3)公平/容量默认一个default ,需要创建多队列

- 4)中小企业:hive spark flink mr

- 5)中大企业:业务模块:登录/注册/购物车/营销

- 6)好处:解耦 降低风险 11.11 6.18 降级使用

- 7)每个调度器特点:

- 相同点:支持多队列,可以借资源,支持多用户

- 不同点:

- 容量调度器:优先满足先进来的任务执行;

- 公平调度器,在队列里面的任务公平享有队列资源

- 8)生产环境怎么选:

- 中小企业,对并发度要求不高,选择容量

- 中大企业,对并发度要求比较高,选择公平。

添加公众号「信息技术智库」:

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

78922574)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

741

741

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?