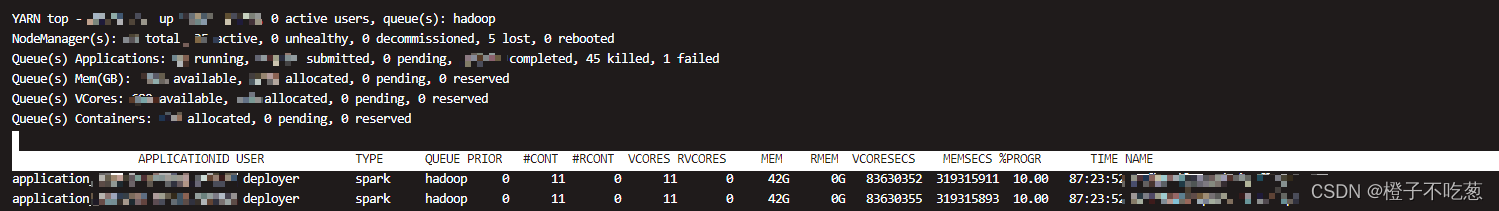

yarn top -queues hadoop

Hadoop集群中资源使用情况的实时视图。YARN是Hadoop的资源管理系统,负责分配系统资源给各个正在运行的应用程序

- YARN top - 09:00:41, up 1d, 23:35, 0 active users, queue(s): hadoop: 这表示在09:00:41的时候,YARN已经运行了1天23小时35分钟,当前没有活跃用户,工作队列名称为

hadoop。 - NodeManager(s): 10 total, 10 active, 0 unhealthy, 0 decommissioned, 5 lost, 0 rebooted: 集群中总共有10个NodeManager(负责管理单个节点的资源),其中10个处于活跃状态,没有不健康的NodeManager,也没有被停用的,有5个丢失,没有重新启动的。

- Queue(s) Applications: 27 running, 10 submitted, 0 pending, 12 completed, 10 killed, 0 failed: 在队列中,有27个应用正在运行,共提交了10个应用,没有等待中的应用,12个已完成,10个被终止,没有失败的。

- Queue(s) Mem(GB): 500 available, 200 allocated, 0 pending, 0 reserved: 在内存资源方面,有500GB可用,已经分配了200GB,没有等待分配的,也没有保留的内存。

- Queue(s) VCores: 200 available, 30 allocated, 0 pending, 0 reserved: 在虚拟CPU核心方面,有200个可用,已经分配了30个,没有等待分配的,也没有保留的核心。

- Queue(s) Containers: 30 allocated, 0 pending, 0 reserved: 在容器方面,已经分配了30个容器,没有等待分配的,也没有保留的容器。

具体的应用程序的信息:

- APPLICATIONID: 应用程序的ID,这里是

application_1664244319391_xxx。 - USER: 提交应用程序的用户,这里是

deployer。 - TYPE: 应用程序类型,这里是

spark。 - QUEUE: 应用程序提交到的队列,这里是

hadoop。 - PRIOR: 应用程序的优先级,这里是0。

- #CONT: 分配给该应用的容器数量,这里是11。

- #RCONT: 保留字段,通常为0。

- VCORES: 分配给该应用的虚拟CPU核心数,这里是11。

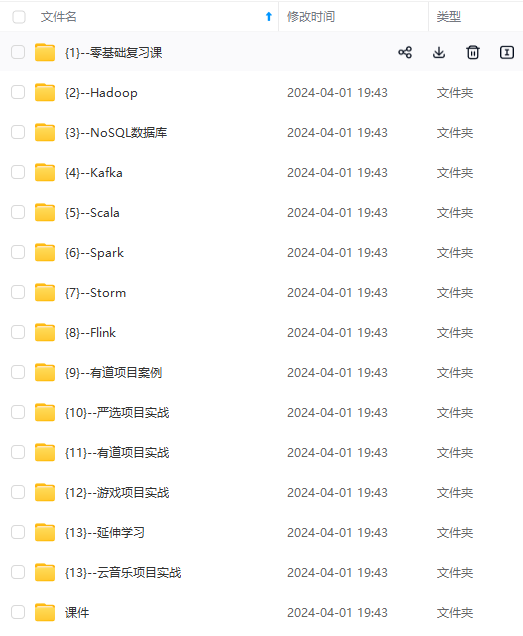

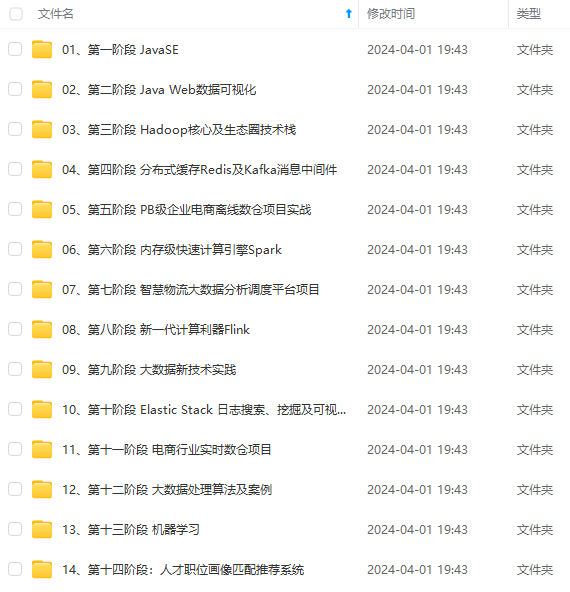

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数大数据工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

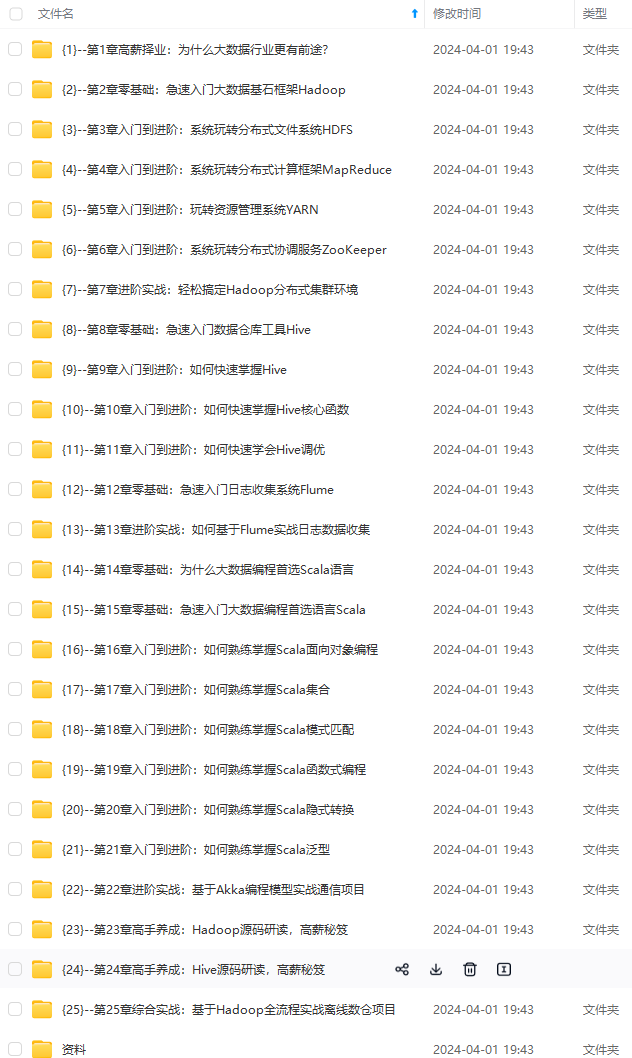

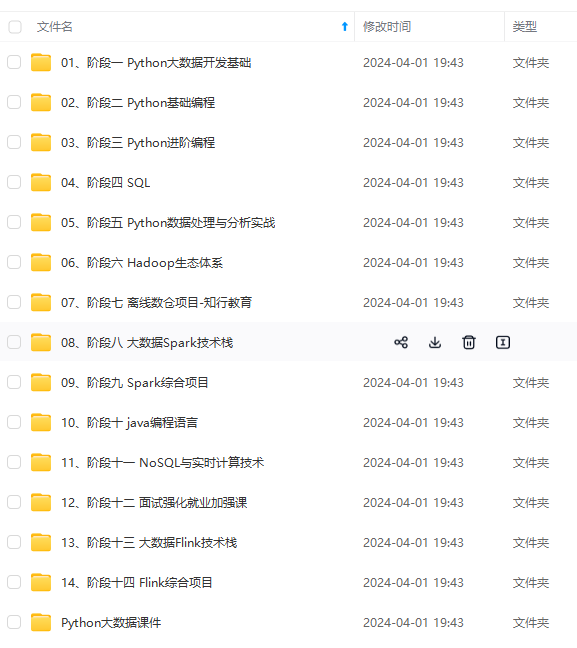

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)

注大数据获取)**

[外链图片转存中…(img-yf4r86F8-1712866112375)]

7万+

7万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?